没有合适的资源?快使用搜索试试~ 我知道了~

第 6 章

特征值与特征向量

6.1 特征值导论

1 特征向量 x 与 Ax 位于同一直线上: Ax = λx 。其特征值为 λ。

2 若 Ax = λx,则有 A

2

x = λ

2

x、A

−1

x = λ

−1

x 及 (A + cI)x = (λ + c)x:相同的 x。

3 若 Ax = λx,则 (A − λI)x = 0、A − λI 是奇异的且 det(A − λI) = 0 。n 个特征值。

4 由 det A = (λ

1

)(λ

1

) ···(λ

n

) 与对角元素和 a

11

+ a

22

+ ··· + a

nn

= λ的和 来检验 λ。

5 投影矩阵具有 λ = 1 与 0。反射矩阵则有 1 与 −1。旋转矩阵则有 e

iθ

与 e

−iθ

:复数!

本章进入线性代数的新部分。第一部分是关于 Ax = b:平衡、能够保持均衡及状态稳定。现在的

第二部分是关于改变。时间的介入——微分方程 du/dt = Au 中的连续时间或差分方程 u

k+1

= Au

k

中的时间步。那些方程不能用消元法求解。

关键思想是要避免由矩阵 A 呈现出的所有复杂性。假设解向量 u(t) 保持在一个固定向量 x 的方

向上。那么我们仅需要找出那个倍数(随时间变化)。一个数比一个向量要容易。我们希望当你乘上 A

时,“特征向量”x 不会改变方向。

一个好范例,它来自于矩阵的幂 A, A

2

, A

3

, . . . 。假设你需要第 100 次幂 A

100

。它的列非常接近其

特征向量 (0.6, 0.4):

A, A

2

, A

3

=

[

0.8 0.3

0.2 0.7

][

0.70 0.45

0.30 0.55

][

0.650 0.525

0.350 0.475

]

A

100

≈

[

0.6000 0.6000

0.4000 0.4000

]

利用 A 的特征值 A

100

得以找出,而非通过乘以 100 个矩阵。那些特征值(这里它们是 λ = 1 和 1/2)

是一个看透矩阵的心的新方式。

为了介绍特征值,我们首先说明特征向量。在与 A 相乘时,几乎所有向量都会改变方向。某些特

别的向量会与 Ax 方向相同。那些是其“特征向量”。A 乘以一个特征向量,向量 Ax 就为一个数 λ 乘

以原先的 x。

基本方程是 Ax = λx。数 λ 是 A 的一个特征值。

特征值 λ 表明特殊向量 x 是被拉伸了还是缩短了还是保持不变——当它与 A 相乘时。我们可能会发

现 λ = 2 或

1

2

或 −1 或 1。特征值 λ 可以是 0!那么 Ax = 0x 意味着此特征向量 x 在其 0 空间内。

若 A 是单位矩阵,则每个向量都有 Ax = x。所有向量都是 I 的特征向量。所有特征值“兰布达”

都为 λ = 1。至少可以说,这是不寻常的。大多数 2 ×2 矩阵有 2 个特征向量方向和 2 个特征值。我们

将证明 det(A − λI) = 0

本节将说明怎么去计算 x 与 λ。它可以在课程的早期出现,是由于我们仅需要一个 2 ×2 矩阵的行

列式。让我用 det(A − λI) 来找出第一个例子的特征值,然后在方程(3)中正确地推导它。

例 1 矩阵 A 有 2 个特征值 λ = 1 和 λ = 1/2。考虑 det(A − λI):

A =

[

0.8 0.3

0.2 0.7

]

det

[

0.8 − λ 0.3

0.2 0.7 − λ

]

= λ

2

−

3

2

λ +

1

2

= (λ − 1)(λ −

1

2

).

我将二次方程分解为 λ −1 乘以 λ −

1

2

,以看到 2 个特征值 λ = 1 和 λ =

1

2

。由于这些数,矩阵 A −λI

变成奇异的(行列式为 0)。其特征向量 x

1

与 x

2

分别在 A − I 与 A −

1

2

I 的 0 空间内。

(A − I)x

1

= 0 是 Ax

1

= x

1

且第一个特征向量为 (0.6, 0.4)。

(A −

1

2

I)x

2

= 0 是 Ax

2

=

1

2

x

2

且第二个特征项是 (1, −1):

x

1

=

[

0

.

6

0.4

]

并且 Ax

1

=

[

0

.

8 0

.

3

0.2 0.7

][

0

.

6

0.4

]

= x

1

(Ax = x 意味着 λ

1

= 1)

x

2

=

[

1

−1

]

并且 Ax

2

=

[

0.8 0.3

0.2 0.7

][

1

−1

]

=

[

0.5

−0.5

]

(这是

1

2

x

2

因此 λ

2

=

1

2

)。

如果 A 再次乘以 x

1

,我们依然会得到 x

1

。A 的每一次幂都会给出 A

n

x

1

= x

1

。A 乘以 x

2

得

1

2

x

2

,

并且再次相乘我们会得到 (

1

2

)

2

乘以 x

2

。

当 A 平方时,特征向量保持不变。特征值平方。

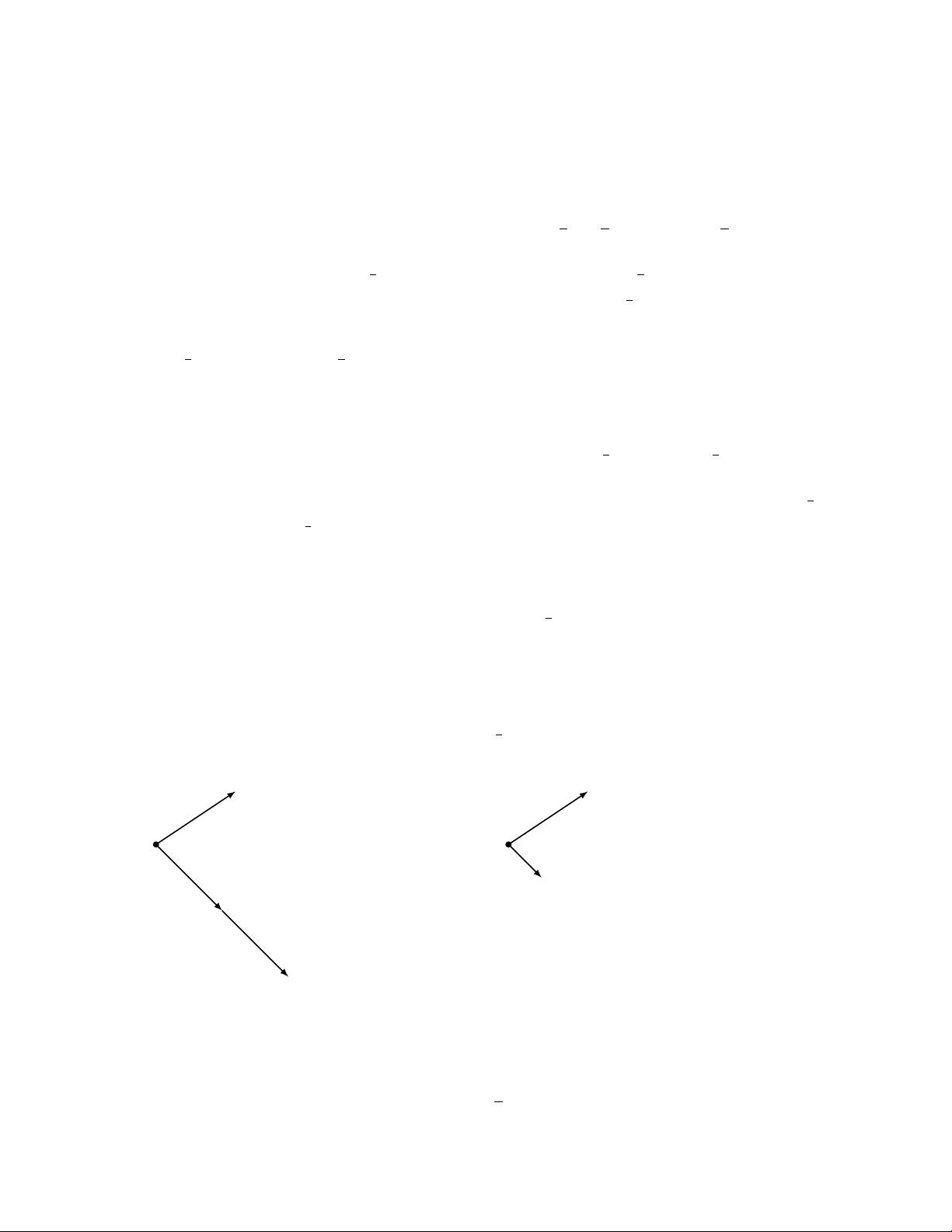

因为特征向量保持在它们自己的方向上(图 6.1)且永远不会混合,所以这种模式会一直持续下去。A

100

的特征向量同样是 x

1

与 x

2

。A

100

的特征值为 1

100

= 1 与 (

1

2

100

) = 非常小的数。

其它向量会改变方向。但所有其它向量都是两个特征向量的组合。A 的第一列是组合 x

1

+ (0.2)x

2

:

分解为特征向量

然后乘以 A

[

0.8

0.2

]

= x

1

+ (0.2)x

2

=

[

0.6

0.4

]

+

[

0.2

−0.2

]

. (1)

当我们分别乘以 x

1

与 (0.2)x

2

时,A 用它的特征值

1

2

乘以 x

2

:

Ax

2

= λ

2

x

2

=

[

0.5

−0.5

]

λ = 0.5

x

2

=

[

1

−1

]

λ = 1

Ax

1

= x

1

=

[

0.6

0.4

]

λ

2

= 1

A

2

x

2

= (0 .5)

2

x

2

=

[

0.25

−0.25

]

λ

2

= 0 .25

A

2

x

2

= (0 .5)

2

=

[

0.25

−0.25

]

Ax = λx

A

2

x = λ

2

x

图 6.1:特征向量保持它们的方向。具有 λ

2

= 1

2

及 (0.5)

2

的 A

2

x = λ

2

x。

每个 x

i

与 λ

i

相乘 A

[

0.8

0.2

]

是 x

1

+

1

2

(0.2)x

2

=

[

0.6

0.4

]

+

[

0.1

−0.1

]

=

[

0.7

0.3

]

.

剩余7页未读,继续阅读

资源推荐

资源评论

2019-08-08 上传

186 浏览量

2022-05-24 上传

2022-04-27 上传

2022-12-26 上传

113 浏览量

119 浏览量

2022-04-13 上传

2022-03-31 上传

143 浏览量

118 浏览量

2022-07-14 上传

129 浏览量

109 浏览量

2020-04-11 上传

135 浏览量

2021-12-15 上传

资源评论

Eric_Saltfish

- 粉丝: 158

- 资源: 31

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 海康威视7832N-K2 最新解绑固件

- HDMI射频测试设备sw19可编辑全套技术资料100%好用.zip

- SpringBoot 集成 Elasticsearch 实现增删改查功能的代码示例

- ELEQ非标自动化组装设备sw16全套技术资料100%好用.zip

- 基于python 3 编程实现常用的排序算法,包括:冒泡排序、直接插入排序、直接选择排序、希尔排序、归并排序、快速排序、堆排序

- 基于javascript实现插入排序,希尔排序,简单选择排序,冒泡排序,快速排序

- FAT AP, 云AP V200R019C00SPC926 版本说明书(word)

- 一个C语言实现希尔排序

- 达梦8 windows安装包

- 大二篇-离散数学学习笔记

- 钣金压平卷弯机器sw18可编辑全套技术资料100%好用.zip

- VI手机测试设备sw18可编辑全套技术资料100%好用.zip

- IMG_1734484801803.png

- 钣金输送机sw18可编辑全套技术资料100%好用.zip

- mongodb-windows-x86-64-5.0.9-signed windows安装包

- python冒泡排序.md

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功