没有合适的资源?快使用搜索试试~ 我知道了~

基于物体路标的仿人机器人实时里程计.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 180 浏览量

2022-11-03

12:04:34

上传

评论

收藏 968KB DOCX 举报

温馨提示

试读

20页

基于物体路标的仿人机器人实时里程计.docx

资源推荐

资源详情

资源评论

0 引言

移动机器人的自定位问题是机器人研究领域的经典问题,研究者们致力于开发精度更高、成本更

低、更加方便实用的定位算法,里程计、航位推算等相关技术在其中担任着重要的角色

[1]

. 移动机器人的

里程计一般由一种或多种低成本传感器计算得到,短时间内精度较高,但存在累计误差,如果不对该误差

进行修正,里程计的性能将快速下降. 所以,里程计的模型误差估计与修正也一直是移动机器人领域人们

研究的热点问题.

传统的轮式机器人里程计模型参数估计和误差修正方法有 UMBmark 校准法

[2]

、最小二乘法

[3]

、路径

比较法(path comparison,PC)

[4]

等,这些方法都是基于轮式机器人的里程计模型,通过校正模型参数以

减小系统误差且是离线运行的. 为了满足不断发展的机器人应用需求,一些更加高效、对模型参数依赖更

小的误差修正方法相继被提出. 文[5]和文[6]将人工神经网络引入到移动机器人里程计中,直接对里程计模

型进行估计,更具有鲁棒性和普适性;Yun 等

[7]

提出一种利用家庭清洁机器人已知的固定定位信息用自适

应扩展卡尔曼滤波(augmented extended Kalman filter,AEKF)来估计系统误差参数的方法.

仿人机器人被认为是机器人技术发展最高水平的体现,其外形、结构及步行方式与人类相似,更适

合在生活和工作环境中与人类协同工作

[8]

. 仿人机器人双足行走的运动方式更加灵活多变,但其里程计的

系统模型更加复杂,误差修正也更加困难,仅仅依靠简单的编码器和惯性测量传感器(inertial

measurement unit,IMU)是不够的. 随着硬件计算能力的不断提高,基于图像流的视觉里程计(visual

odometry,VO)和视觉 SLAM(simultaneous localization and mapping)技术发展迅速.

ORB-SLAM(oriented FAST and rotated BRIEF SLAM)

[9]

通过非线性优化和回环检测修正了视觉里

程计的累计误差. SVO(semi-direct visual odometry)

[10]

结合了特征点法和直接法,进一步提高了视觉里程

计的实时性. 进一步地,为了弥补单目视觉里程计尺度不定等问题,研究者开始在视觉里程计加入 IMU,

形成视觉惯性里程计(VIO),典型的代表有 OKVIS(open keyframe-based visual-inertial SLAM)

[11]

、

visual-inertial ORBSLAM

[12]

、VINS-Mono(visual-inertial system monocular)

[13]

等. 视觉传感器能采集丰富

的环境信息且成本低廉,在仿人机器人机器人领域开始广泛利用视觉信息来修正里程计的定位误差.

Oriolo 等

[14]

通过拓展卡尔曼算法将单目视觉里程计和基于机器人运动学得到的里程计数据进行融合,利用

VSLAM 有效地修正了里程计的误差. 王立玲等

[15]

将机器人状态定义为机器人位姿和速度,分别用运动学

里程计、单目 ORB-SLAM 和 IMU 进行测量,通过拓展卡尔曼的状态测量更新步骤完成多传感器的融合.

基于自然特征点视觉信息修正里程计的方法虽然精度较高,但在纹理较少或动态的环境中,点特征容易缺

失或误匹配. 为了解决这个问题,在最新的研究中,人们将更高层次的环境特征如线、面、物体等加入到

系统中以提高鲁棒性

[16-17]

. 但这些方法在特征提取、数据关联和位姿优化等模块中计算量较大,还不能应

用于实时嵌入式系统中.

针对上述存在的问题,本文提出一种基于环境物体路标的仿人机器人实时里程计算法,算法流程如

图 1 所示. 由正运动学计算得到行走里程计,此时若视觉信息有效,则通过无迹卡尔曼滤波用视觉测量对

里程计进行修正,同时把里程计修正前后的数据加入训练集;若视觉信息无效,则根据训练集数据通过广

义回归神经网络(generalized regression neural network,GRNN)更新回归模型,使用该模型直接对里程

计进行修正. 主要研究内容及贡献有:

图 1 算法流程图 Fig.1 Algorithm flow chart

图选项

1) 算法直接以环境中的物体作路标,通过色彩分割和形态学处理识别并定位路标;并提出一种应用

于仿人机器人特征点三维坐标数值求解及机器人全局位姿估计方法.

2) 提出多路标组合定位方法,将多个路标的测量信息进行组合,并对无迹卡尔曼滤波(unscented

Kalman filter,UKF)框架进行拓展,以实现机器人运动学里程计数据与多组测量信息的融合,完成对里程

计数据的测量修正.

3) 为进一步提高系统鲁棒性,提出一种基于广义回归神经网络模型的里程计实时修正方法. 当视觉

测量无效时,短时间内替代滤波修正.

本文以仿人机器人 NAO 为实验平台通过一系列仿真和实体实验验证了本算法的有效性.

1 视觉位姿测量 1.1 选取路标物体

为了降低机器人对工作环境的要求,避免对环境进行改动,算法直接在环境中选取合适的物体作为

路标. 选取原则是:作为路标的物体色彩在环境中应较为突出,便于识别;物体中心在同一水平面不同方

位的投影点与该物体投影的几何中心重合,即路标物体应具有对称结构,如球体、柱体等. 如图 2 所示,

可选取场景中的玩偶和苹果作为路标. 环境路标物体确定之后,记录所选物体的位置、色彩、形状、尺寸

等信息作为路标的先验信息.

图 2 环境路标选取 Fig.2 Selection of environment landmarks

图选项

1.2 图像处理与路标识别

机器人在行走时采集的图像中存在运动模糊且含有大量噪声和无用的环境信息,如图 3(a)所示. 需

要对原始图像进行处理,消除图像模糊的影响和清除多余的环境信息,再对处理后的图像进行路标的识别

和中心坐标的计算.

图 3 相机图像处理过程 Fig.3 Camera image processing

图选项

1.2.1 图像处理

仿人机器人在行走过程中,头部晃动较大,容易产生运动模糊. 运动模糊对图像细节部分影响较

大,在传统的基于特征角点的视觉里程计中,会导致特征丢失,跟踪失败. 但其对于色块的影响相对较

小,故将对特征角点的识别定位转化为对路标物体中心的定位可一定程度消除图像运动模糊的影响.

根据路标选取的规则可知,路标物体的色彩在场景环境中较为突出,故根据路标的先验色彩信息进

行图像分割,分成路标区域和背景环境,分割的效果如图 3(b)所示. 从图中可以看出,图像分割基本去除

了背景环境且对于存在运动模糊的图像依然可以有效地提取到路标,但图像中还存在一些环境噪声且路标

物体的轮廓粗糙,形状较不规则. 为进一步去除噪声,平滑路标物体区域轮廓,对分割图像再进行形态学

处理. 开运算消除图像中孤立的噪点,闭运算平滑路标区域外轮廓,同时填补区域中的小孔使其完整平

滑,处理后的效果如图 3(c)所示.

1.2.2 路标物体的识别

经过色彩分割和形态学处理后的图像中只含有圆滑的路标块和少许不规则形状的干扰块,此时可通

过标识物体的先验信息如物体的形状、大小及位置信息等对色块进行筛选,定位标识.

首先对分割图像进行粗略的扫描,得到色块的大致位置,再对候选位置周围进行精细的扫描以确定

色块的面积与形状轮廓,根据路标形状大小过滤候选色块,通过式(1) 求剩余候选色块的中心:

(1)

(2)

其中,U,D,L 和 R 为标识区域框边界;p 向量为(u,v)

T

处像素值,定义标识为 1,背景为 0. 最

后,根据机器人先验位姿估计和路标在世界坐标系中的坐标对路标进行重投影,距离重投影点最近的色块

中心即为路标中心的测量值(u

0

,v

0

)

T

,如图 3(d)所示.

1.3 机器人位姿求解

已知路标物体中心在图像中的像素坐标(u,v)

T

及其世界坐标系坐标(x

w

,y

w

,z

w

)

T

,机器人的位姿解

算问题就是一个 n 点透视问题(perspective-n-point,PnP)

[18]

. 传统求解 PnP 的方法,如

P3P(perspective-three-point)、EPnP(efficient PnP)

[19]

,往往需要求解高阶方程组来计算相机三维位姿

(x,y,z,α,β,θ)且至少需要 3 对特征点,求解过程繁琐,运算量大. 一般地,仿人机器人在行走过程

中,质心高度基本保持不变,机器人(相机)的运动可以看作在一个二维水平面上的运动,其位姿只有 3 个

自由度:二维位置和姿态角. 本文根据简化的机器人模型和路标点之间的几何关系对机器人位姿进行估

计,算法总体时间复杂度为 O(1),相比传统方法,更加快速高效.

1.3.1 2D-3D 点求解

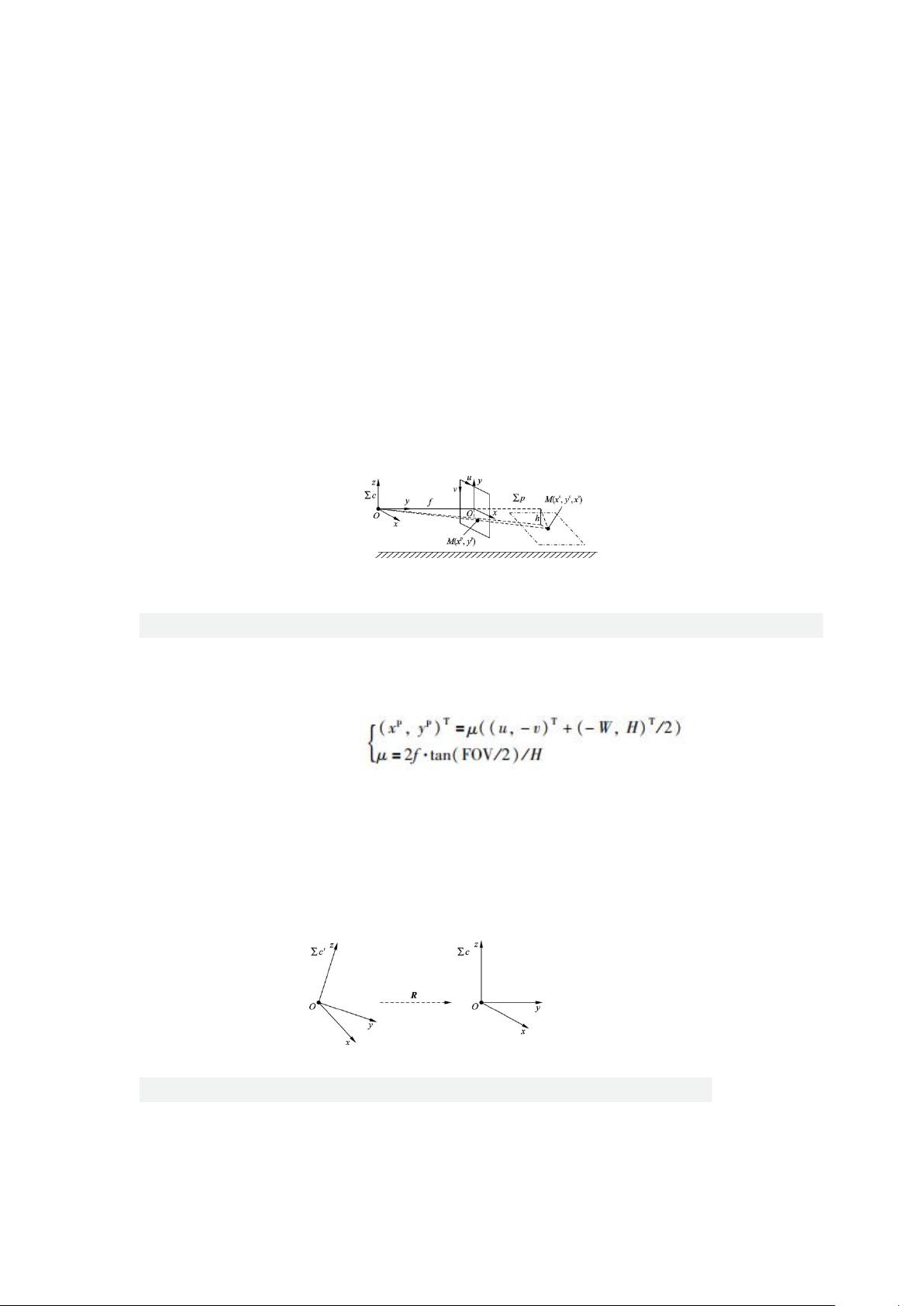

如图 4 所示,建立相机坐标系∑c 和图像坐标系∑p,物体路标中心 M 所在水平面与相机平面的垂直

高度差为 h,M 在相机坐标系下的坐标为(x

c

,y

c

,z

c

)

T

,在成像平面的投影坐标为(x

p

,y

p

)

T

. 机器人的结构

参数,相机的焦距 f,特征点的世界坐标(x

w

,y

w

,z

w

)

T

及其投影坐标(u,v)

T

均为已知量.

图 4 相机、图像坐标系与标识物体及投影点的几何关系 Fig.4 Geometric relationship among camera

coordinate system, image, landmark and its projection point

图选项

中心 M 点的像素坐标为(u,v)

T

,将之转化为图像坐标:

(3)

其中,(W,H)为图像的尺寸,FOV(field of view)为相机视场角.

一般地,仿人机器人头部存在 pitch、yaw 两个自由度,机器人的头部可能会转动,如图 5 所示,

需要对相机进行旋转矫正. 旋转矩阵为

图 5 相机的旋转修正 Fig.5 Correction for camera rotation

图选项

剩余19页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3663

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功