没有合适的资源?快使用搜索试试~ 我知道了~

基于亚像素边缘检测的高精度相机标定方法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 150 浏览量

2023-02-23

20:42:30

上传

评论 1

收藏 644KB DOCX 举报

温馨提示

试读

14页

基于亚像素边缘检测的高精度相机标定方法.docx

资源推荐

资源详情

资源评论

摘要

在许多实际应用场景中,标定图像不清晰、靶标检测精度低常常导致相机标定精度不足,

这制约了测量精度的提高。针对该问题,提出一种基于亚像素边缘检测的双目相机标定方

法。首先,利用自适应双阈值的 Canny 算子获取靶标标识点的整像素边缘初值。然后,以

整像素边缘初值为中心,根据局部区域面积效应估计非连续性边缘模型的二阶边缘参数,

并对亚像素边缘点集进行椭圆拟合,得到靶标标识点的准确位置。最后,通过标识点的排

序位置矫正获取用于求解标定参数的标识点检测点集,实现了复杂环境下相机的高精度标

定。典型标定场景的测试实验结果表明,相较于现有方法,所提方法对常规环境的标定精

度提升了 23%,对低对比度、低相对分辨率的高温烘箱环境的标定精度提升了 68%。

Abstract

In many practical application scenarios, the camera calibration is not highly accurate due

to unclear calibration images and low target detection accuracy, which limits the

improvement of measurement accuracy. To solve this problem, a binocular camera

calibration method based on sub-pixel edge detection is proposed. The initial integer-

pixel edge values of the target identification points are obtained by an adaptive double-

threshold Canny operator. In addition, the initial integer-pixel edge values are taken as

the center to estimate the second-order edge parameters of a discontinuous edge model

based on the partial area effects, and ellipse fitting on the set of sub-pixel edge points is

performed to obtain the accurate position of the target identification points. Finally, the

set of the identification points used to solve the calibration parameters is obtained by

correcting the sorting position of these points, which thus achieves the high precision

calibration of cameras under complex environments. The test experiments on typical

calibration scenarios show that, compared with the existing methods, the proposed

method can improve the calibration accuracy by 23% in a conventional environment and

68% in a high-temperature oven environment with low contrast and relative resolution,

respectively.

1 引言

数字图像相关测试方法

[1-4]

因其非接触性、全场性等优点,已被广泛应用于医疗、土木和

航空航天等领域中,其测试精度往往由图像的匹配精度和相机的标定精度共同决定,相机

的标定精度将直接影响最终的测试精度。低对比度、低相对分辨率(单位为 pixel/mm)和

模糊边缘等因素会严重影响相机标定的精度,传统相机标定方法无法满足测试精度要求。

因此,为确保数字图像相关方法的测量精度满足要求,研究相机标定过程具有重要意义。

目前相机标定技术主要分为三大类:相机自标定

[5-6]

、相机主动视觉标定

[7]

和靶标相机标

定

[8]

。自标定方法通过建立图像上对应特征点的多元方程,求解得到相关标定参数,其原

理简单,但精度低、鲁棒性差。主动视觉标定方法根据相机运动轨迹进行标定参数的求

解,需要明确获取相机的运动轨迹,对实验设备要求较高。靶标相机标定法需要利用制作

的特定靶标标识物进行标定,标定物上存在已知尺寸的特征点,其标定精度较高、鲁棒性

好,且对测试环境要求并不苛刻。

数字图像相关测试技术对标定精度要求高,且在整个测试过程中需对相机位置进行严格固

定,故目前广泛采用的是靶标相机标定法,其中最具代表性的是 Zhang

[8]

在 2000 年提出

的一种针对棋盘格标定板的灵活相机标定方法。为进一步提高标定精度和标定效率,近年

来众多学者分别将各类优化搜索算法

[9]

、K-SVD 等机器学习模型

[10]

和深度神经网络模型

[11-12]

应用于相机标定模型中,对标定的参数优化方面进行了一定程度的改进。

对于复杂环境下的标定过程,影响标定精度的主要原因是标定图像噪声高、质量差,因此

实现高精度标定更迫切要做的是提高靶标检测精度。圆形标定板是一种常用的标定靶标,

为提高靶标中心的检测精度,段振云等

[13]

提出了一种边缘位置补偿方法,从而减轻光照

对中心检测的影响。卢晓冬等

[14]

通过降低图像畸变引起的偏心误差来提高椭圆靶标的检

测精度。Maalek 和 Lichti

[15]

利用基于共焦双曲线的椭圆拟合来提高靶标中心点的拟合精

度。然而,以上方法均是在成功检测靶标中心初值或边缘信息的基础上对中心坐标进行补

偿优化或精确拟合的,因此若无法获得精确的初值信息,后续算法便无从谈起。现有的初

始靶标检测均为基于图像质心或梯度的处理方法,当标定图像质量下降、靶标相对分辨率

低和边缘特征不明显时,靶标检测精度往往无法满足测试需求,进而导致标定误差明显提

高。

为提高双目相机的标定精度,本文从提升靶标边缘检测精度的角度出发,提出了一种基于

亚像素边缘检测的双目相机标定方法。首先,利用传统边缘检测算法和标识点的形态学特

征获取标定板上每一标识点的整像素级边缘初值。然后,根据边缘初值的局部区域面积效

应对每一初值进行亚像素级细化,从而得到精确的亚像素级标识点的中心坐标。最后,利

用张氏标定法获取相机的内外参数,完成相机标定过程。

2 相机标定原理

相机标定的目的是求解由三维空间点(单位为 mm)转换为二维图像点(单位为 pixel)的

成像模型所涉及的参数。本节简要回顾了标准相机的标定方法,并指出复杂环境标定中可

能影响标定精度的因素。

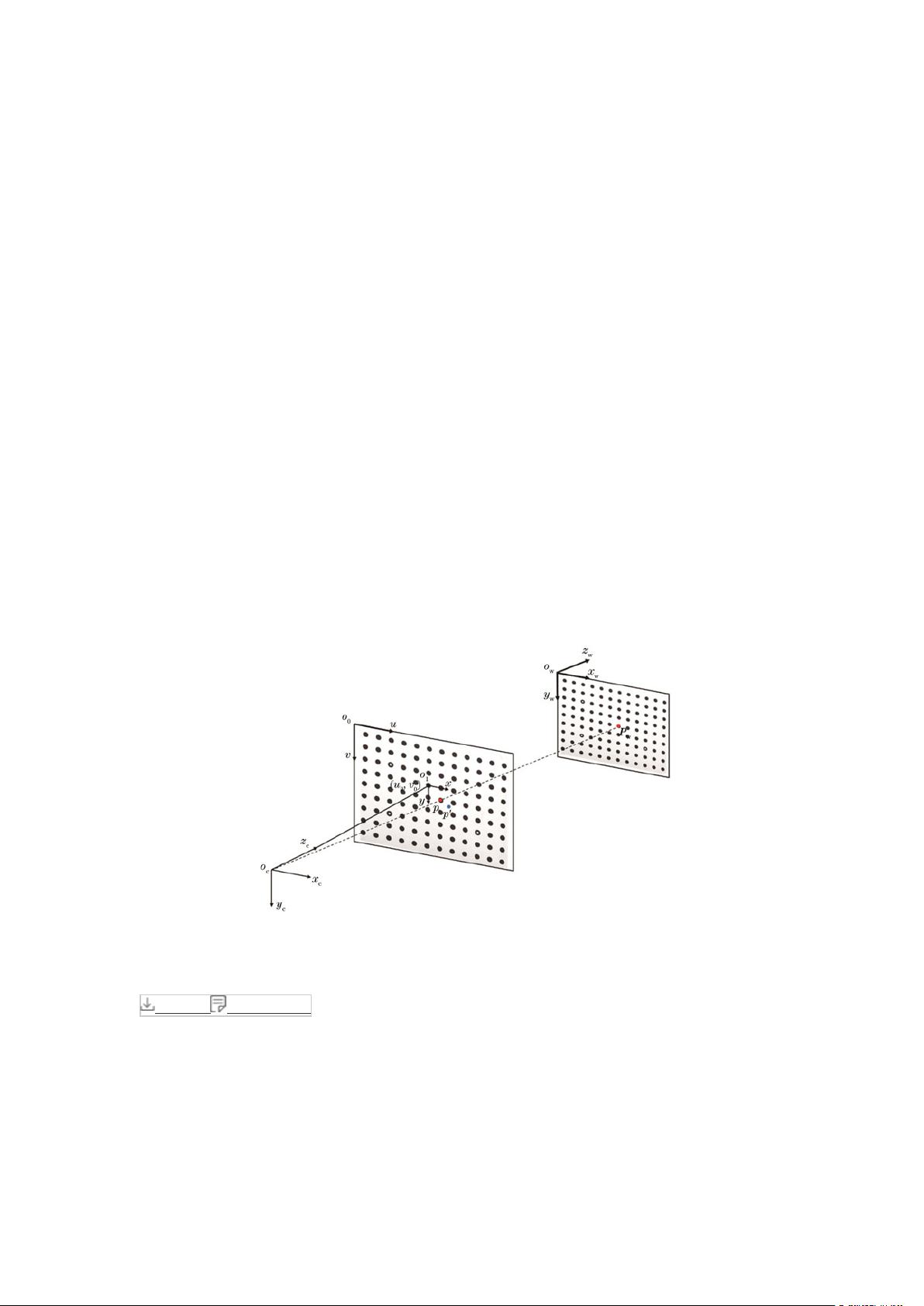

在大多数的测试应用中,测量相机可以视为理想的针孔相机,其成像模型如图 1 所示,其

中(u0, v0)(u0, v0)为相机的主点坐标,p 为世界坐标系下点 PwPw 在图像坐标系下的对应

点,p'p'为图像坐标系下的另一点。给定在世界坐标系 ow-xwywzwow-xwywzw 下的任意

三维点 Pw=[xw yw zw]Pw=[xw yw zw],其在相机坐标系 oc-xcyczcoc-xcyczc 下的点为

(xc,yc,zc)(xc,yc,zc)。同时,通过相机的光学中心投影,并在图像坐标系 oi-uvoi-uv 上形

成图像点 Pi=[u v]Pi=[u v]。一般地,从 PwPw 到 PiPi 的投影变换过程可以表示为

⎧⎩⎨⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪⎪s⎡⎣⎢uv1⎤⎦⎥=K[RT]⎡⎣⎢⎢⎢⎢xwywzw1⎤⎦⎥⎥

⎥⎥K=⎡⎣⎢fx00γfy0cxcy1⎤⎦⎥suv1=KRTxwywzw1K=fxγcx0fycy001 ,(1)

式中:ss 为任意的比例因子;KK 为由相机坐标系 oc-xcyczcoc-xcyczc 投影到图像坐标系

oi-uvoi-uv 的内参数矩阵;[RT]RT 为由世界坐标系 ow-xwywzwow-xwywzw 变换到相机

坐标系 oc-xcyczcoc-xcyczc 的外参数矩阵,其中 RR 为旋转矩阵、TT 为平移矩阵;fxfx

和 fyfy 为沿 x 方向和 y 方向以 pixel 为单位的焦距;(cx,cy)cx,cy 为相机主点坐标;γγ 为

描述两图像轴间倾斜度的系数。

图 1. 理想针孔相机模型示意图

Fig. 1. Schematic diagram of ideal pinhole camera model

下载图片 查看所有图片

在实际测试中,还应该考虑透镜的畸变问题。透镜的畸变模型一般分为径向畸变和切向畸

变。假设理想图像点的坐标为(u,v)u,v,考虑畸变后对应点坐标(ud,vd)ud,vd 的表达式为

[udvd]=(1+k1r2+k2r4+k3r6)[uv]+[2p1uv+p2(r2+2u2)p1(r2+2v2)+2p2uv]udvd=1+

k1r2+k2r4+k3r6uv+2p1uv+p2r2+2u2p1r2+2v2+2p2uv,(2)

剩余13页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3550

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功