没有合适的资源?快使用搜索试试~ 我知道了~

改进BERT的中文评论情感分类模型.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 18 浏览量

2022-06-24

13:33:39

上传

评论

收藏 429KB DOCX 举报

温馨提示

试读

15页

改进BERT的中文评论情感分类模型.docx

资源推荐

资源详情

资源评论

0引言

近年来,深度学习在图像和语音处理领域取得显著进展

[1]

,然而在自然语言处理领域的研究中尚未取

得较大突破。情感分类是自然语言处理任务中的一个子任务,其本质上是对带有情感色彩的主观性文

本进行分析、处理、归纳和推理的过程,例如对电影和电视剧的评论、网购产品评价、微博微信等社

交平台在某一热点事件上的评论等。情感分析有助于使用者获得产品的客观评价并合理地进行舆情监

测,结合本国互联网电商和社交平台的迅速发展以及广大网民热衷于发表网络评论的国情,中文评论

情感分类研究具有重要意义。如何以深度学习网络为基础,构建高效的中文评论情感分类模型已经成

为中文评论情感分类研究的热点问题。

深度学习网络在情感分析方面常用到卷积神经网络(Convolutional Neural Network,CNN)和

循环神经网络(Recurrent Neural Networks,RNN)

[2]

,其中 RNN 是主流网络,因为 RNN 在当

前节点的输出值由当前时刻的输入和上一时刻的输出共同决定,这样使得 RNN 能够充分学习文本前

后文信息。在循环神经网络应用方面常见的是其变体 LSTM

[3]

(Long Short Term Memory),这

种变体可以学习长期依赖信息。GRU(Gated Recurrent Unity)是 LSTM 的一个变体,它进一步

减 少 了 LSTM 网 络 内 部 的 门结 构 , 提 高 了 网 络模 型 的 学 习 效 率 。 双 向循 环 神 经 网 络 BiLSTM

[4]

(Bidirectional Recurrent Neural Networks)和 BiGRU

[5]

(Bidirectional Gated Recurrent

Unity)通过建立双向网络连接,将文本从两个方向同时输入,使模型可以更充分地获取句子间的语

义信息,以这两种网络为基础的情感分类模型都取得了较好效果。

随 着 计 算 机 硬 件 的 发 展 , 一 些 网 络 结 构 更 深 、 更 复 杂 的 深 度 学 习 模 型 也 应 运 而 生 , BERT

[6]

(Bidirectional Encoder Representation from Transformers )就是其中的代表。它是一种基

于 Transformer 中的 Encoder 部分,通过在 Encoder 中引入 Masked Language Model 的预训

练 方 法 , 随 机 MASK 句 子 中 的 部分 Token , 然 后训 练 模 型 从 MASK 的 两 个 方 向预 测 被 去 掉 的

Token,同时借助 Encoder 中的多头注意力机制使模型能动态且并行地获取词向量,最后通过残差

连接和多个 Encoder 结构的堆叠,使模型能充分学习到文本的语义,从而产生较好的实验结果。本

文所用的 RoBERTa

[7]

(A Robustly Optimized BERT Pretraining Approach )模型是一种鲁棒

性更强的 BERT 模型,它主要优化了 MASK 策略,同时使用更大规模的数据训练模型,使模型适应性

更强,任务完成效果更好。

1相关工作

基于传统深度学习网络的情感分类模型在处理文本时不能直接处理文本信息,因为模型内部都是用来

处理数值的函数,其实验所用文本需要转化成词向量的形式,即先将文本转化成数值的形式再将其交

给所用网络作进一步任务处理,该过程也称为词嵌入。目前最流行的词嵌入模型就是 Word2Vec

[8]

,

它是一种有效创建词向量的方法,自 2013 年以来就一直存在。其原理的通俗解释就是将一个词放到

不同的维度标准中进行评分,每种评分代表其在这个维度的一个相似度,所用维度越多,词本身的特

点也就被挖掘得越充分。

在 Word2Vec 得到词向量的基础上,下游连接循环神经网络和 Softmax 层进行文本的情感分类是常

见的处理步骤。梁军等

[9]

在情感分析中引入 LSTM 网络,实现了比传统 RNN 更好的效果;任勉等

[10 ]

提出一种基于双向长短时记忆循环神经网络模型( BiLSTM),通过双向传播机制获取文本中完整的

上下文信息,比传统循环神经网络 LSTM 模型分类效果更好,能达到更高的召回率和准确率;吴小华

等

[11 ]

提出结合 Self-Attention

[12 ]

自注意力机制可以减少外部参数依赖,使模型能学到更多的文本自身

关键特征,解决了双向循环神经网络分类效果依赖分词正确率的问题,提高了分类效果;曹宇等

[13]

将

BiGRU 应用于中文情感分类,模型训练速度比 BiLSTM 快 1.36 倍,并且取得了较高的 F1 值;王伟

等

[14 ]

提出自注意力机制与双向 GRU 结合的 BiGRU-attention 的文本情感分类模型,实现了相较于

BiLSTM-attention 更高的正确率,同时模型训练时间也有效缩短;胡朝举等

[15]

提出一种基于深层注

意力机制的 LSTM 模型,该方法在特定主题情感分析任务中将主题特征与文本特征融合,较之前基于

注意力的情感分析模型在准确率和稳定性上有了进一步提高;谭皓等

[16]

提出一种基于表情符注意力机

制的微博情感分类模型,使用双向循环神经网络( BiLSTM)学习文本的特征表示,利用表情符注意

力机制,得到文本结合表情符号的整体特征表示,与输入纯文本和表情符的 BiLSTM 模型相比,基于

表情符注意力机制的模型正确率有了明显提高;张仰森等

[17]

提出一种基于双重注意力机制的微博情感

分析方法,将情感短语和表情符号提取出来作为情感符号,与原来的文本一起输入到 BiLSTM 中,相

比于其之前提出的模型,正确率和 F1 值都有提高。同时,也有很多学者将在图像识别领域应用较好

的卷积神经网络应用于自然语言处理的情感分析领域。何 炎祥等

[18]

提出一种有效利用表情符号的

EMCNN(Emotion-semantics enhanced Multi-channel Convolutional Neural Network )

模 型 , 为 常 用 表 情 符 号 构 造 情 感 特 征 表 示 矩 阵 , 将 基 于 表 情 符 号 的 情 感 空 间 与 深 度 学 习 模 型

MCNN(Multi-channel Convolutional Neural Network )结合,显著提高了 MCNN 捕捉情感语

义的能力,并在所有性能指标上都超过当时文献中的最好效果。

虽然这些研究取得的成果很多,但很难改变用 Word2Vec 得到静态词向量联系的缺点:在很多语境

中并不能给出合适的对应的语义表示。如:“我去市场买了一个苹果”和“我去手机店买了一个苹果”,这

两句话都含有“苹果”,但是 Word2Vec 却很难表示出这样的区别。而 BERT 所用的 Transformer 中

Encoder 网络结构却可以轻松解决这样一词多义问题,因为 Encoder 中采用了自注意力机制,这可

以让句子学习自身的词与词之间的关系,根据句子的不同,动态地赋予每个词不同的权重,由此可以

更准确地在每个语境下更好地提取句子的语义。同时,BERT 采用了 Masked Language Model,

可以从被 MASK 的词的两边预测被 MASK 的词,解决了 LSTM 及其变体只能从前向后或者从后向前

的预测方法,提高了语义获取效率。王子牛等

[19]

利用大规模语料训练 BERT 模型,将 BERT 应用于命

名实体识别中,提出一种基于 BERT 的中文命名实体识别方法;杨飘等

[20]

提出一种基于 BERT 嵌入的

中文命名实体识别方法,在获取句子语义时,使用 BERT 的预训练模型,有效地提高了实验效果;王

月等

[21 ]

提出一种基于 BERT 的警情文本命名实体识别方法,用 BERT 预训练的词向量代替传统用

Word2Vec 得到的词向量,使实验效果同比有了较大提高。而本文所用的 RoBERTa 主要是在 BERT

的基础上改进了 mask 的策略,RoBERTa 在预处理时并没有执行 MASK,它是在每次向模型提供输

入时动态地生成 mask,因此,MASK 是动态的,在此基础上预测也更高效。同时,RoBERTa 是在

更 大 的 数 据 集 上 经 过 更 长 时 间 训 练 得 来 , 删 减 了 BERT 在 训 练 中 的 NSP ( Next Sentence

Prediction)任务,整体效果比 BERT 更好,模型鲁棒性更强。

2模型结构

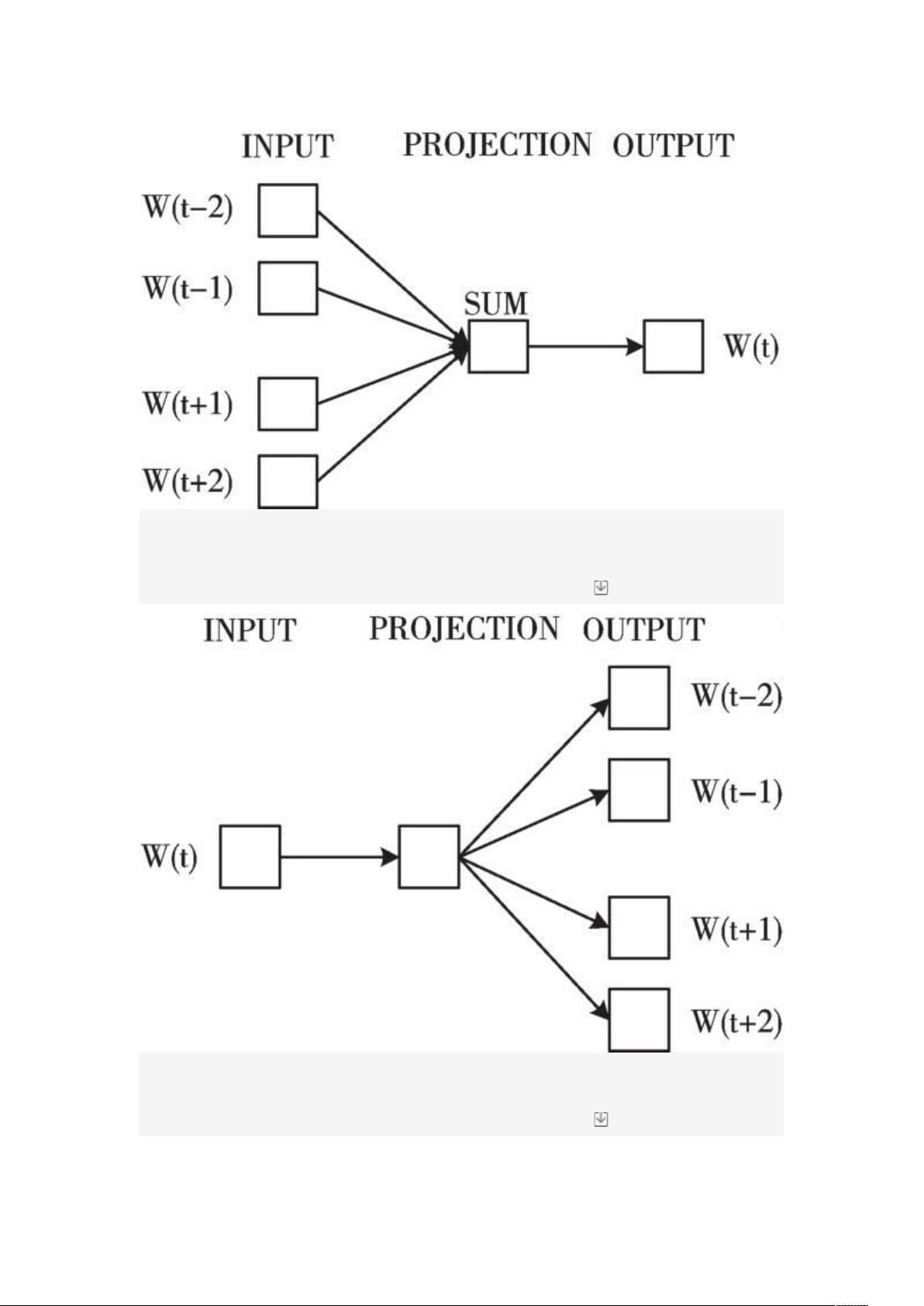

2.1Word2Vec

Google 团队在 2013 年发表了 Word2Vec 工具,其主要是使用无监督的方法从大型语料库中自主地

进行训练,主要方法为:使用目标词左右窗口内的词进行目标词预测,或者使用目标词预测窗口内的

词。这两种方法分别是依靠 Word2Vec 工具中包含的两个模型:连续词袋模型(Continuous Bag

of Words,CBOW)和跳字模型(Skip-gram)。其中,CBOW 模型利用词 w(t)前后各 c(这

里 c=2)个词,去预测当前词,结构如图 1 所示;而 Skip-gram 模型跟 CBOW 模型相反,它利用

词 w(t)去预测它前后各 c(c=2)个词,其结构如图 2 所示。

Fig. 1CBOW model structure

图 1CBOW 模型结构

下载:原图º|高精图º|低精图

Fig. 2Skip-gram model structure

图 2Skip-gram 模型结构

下载:原图º|高精图º|低精图

如上所述,Skip-gram 模型与 CBOW 模型过程相反,本文以 CBOW 模型训练过程为例对其进行介

绍。其中,输入层是词 w(t)的上下文中的 2c 个词向量,而投影层向量 X

w

是这 2c 个词向量的累加

剩余14页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3691

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功