没有合适的资源?快使用搜索试试~ 我知道了~

NLP进入预训练模型时代:从word2vec,ELMo到BERT.pdf

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 113 浏览量

2023-08-12

12:57:58

上传

评论

收藏 1.04MB PDF 举报

温馨提示

试读

9页

NLP进入预训练模型时代:从word2vec,ELMo到BERT.pdf

资源推荐

资源详情

资源评论

NLP的游戏规则从此改写?从word2vec, ELMo到BERT

原创

⼣⼩瑶

2018-10-23⼣⼩瑶的卖萌屋

来⾃专辑

卖萌屋@⾃然语⾔处理

前⾔

还记得不久之前的机器阅读理解领域,微软和阿⾥在SQuAD上分别以R-Net+和SLQA超过⼈类,百度在MS MARCO上凭借

V-Net霸榜并在BLEU上超过⼈类。这些⽹络可以说⼀个⽐⼀个复杂,似乎“如何设计出⼀个更work的task-specific的⽹络"变

成了NLP领域政治正确的研究⽅向。⽽在这种⻛向下,不管word2vec也好,glove也好,fasttext也好,都只能充当⼀个锦上

添花的作⽤。说好的迁移学习、预训练呢?在NLP似乎始终没成主⻆。

⼩⼣写这篇⽂章时也有点惭愧,搞了好⼀段时间的表⽰与迁移,虽然早在直觉上感觉这应该是NLP的核⼼问题,但是也没做

出⼀些令⾃⼰满意的实验结果,直到⼏天前的BERT出来,才感觉是贫穷限制了我的想象⼒╮( ̄▽ ̄””)╭(划掉),才感觉

⾃⼰着眼的点还是太窄了。

每个⼈对于BERT的理解都不⼀样,本⽂就试着从word2vec和ELMo的⻆度说说BERT。下⾯先简单回顾⼀下word2vec和

ELMo中的精华,已经理解很透彻的⼩伙伴可以快速下拉到BERT章节啦。

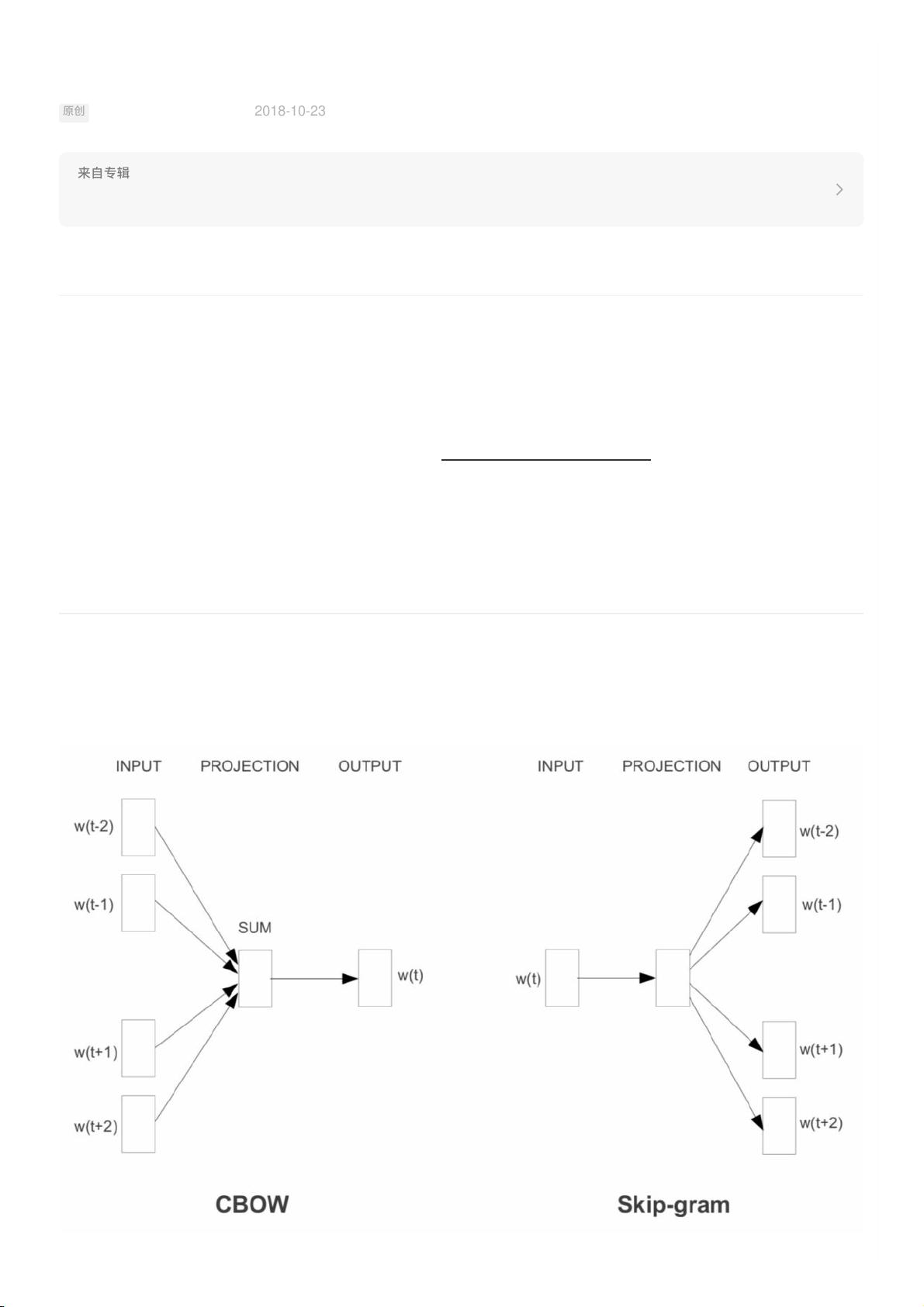

word2vec

说来也都是些俗套⽽乐此不疲⼀遍遍写的句⼦,2013年Google的word2vec⼀出,让NLP各个领域遍地开花,⼀时间好像不

⽤上预训练的词向量都不好意思写论⽂了。⽽word2vec是什么呢?

模型

资源评论

地理探险家

- 粉丝: 1032

- 资源: 5416

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功