中金-AI 十年展望(五):从 ChatGPT 到通用智能,新长征上的新变化

原创 赵丽萍 于钟海等 中金点睛 2023-02-03 07:51 发表于北京

2012 年深度学习元年以来,AI 进入学术和商业界发展新阶段,2017 年大模型

路线以“通用智能”思路降低算法边际成本,逐渐成为学界与产业共识。2022

年下半年,AIGC 及 ChatGPT 关注度大幅提升背后,我们认为其本质是弱人工

智能到强人工智能的阶跃,海外及国内商业落地处在初期,但我们认为新的产业

趋势值得关注。OpenAI 的技术进展及投资方向、海外 AI 独角兽业务进展、国

内龙头 AI 公司的跨模态布局是重要风向标。

本文作者:赵丽萍,于钟海,魏鹳霏

摘要

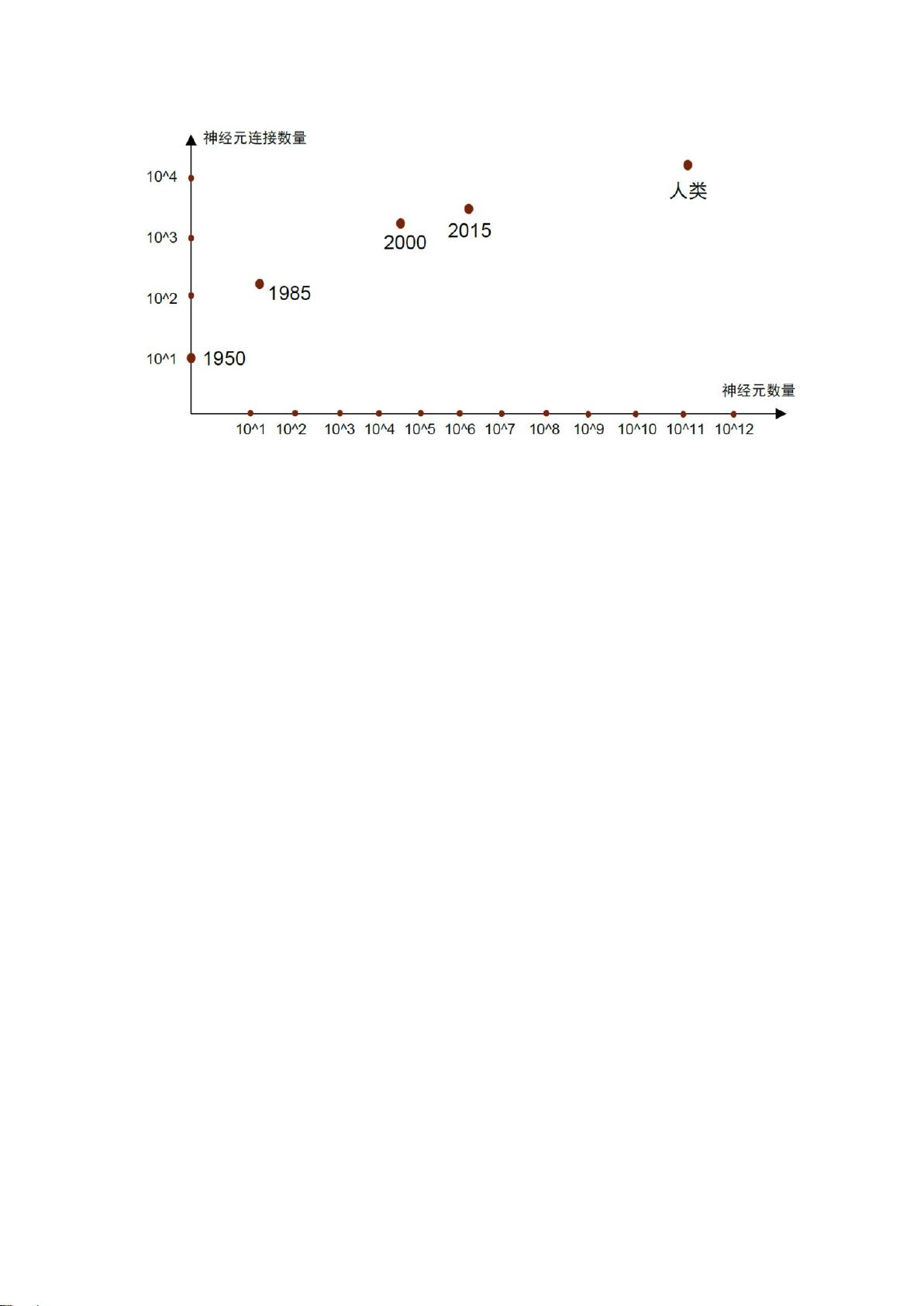

技术层面,ChatGPT 和 AIGC 的持续升温依托于大模型的技术红利。从 2012

年的深度学习元年以来,各界产生了海量的数字化需求,大模型技术路线是降低

边际成本的核心,2017 年大模型(Transformer)路线逐渐成为学术界与国内

外巨头的发展共识。ChatGPT 由 GPT-3.5 大模型加入基于人类反馈的强化学习

训练而成,带来弱人工智能向通用智能的阶跃。

商业层面,以 OpenAI 投资方向为风向标,落地仍在探索期,跨模态打开场景

空间。对于AIGC领域,AI作画等跨模态应用是未来的发展趋势,全球范围