数据挖掘期末实验报告.docx

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

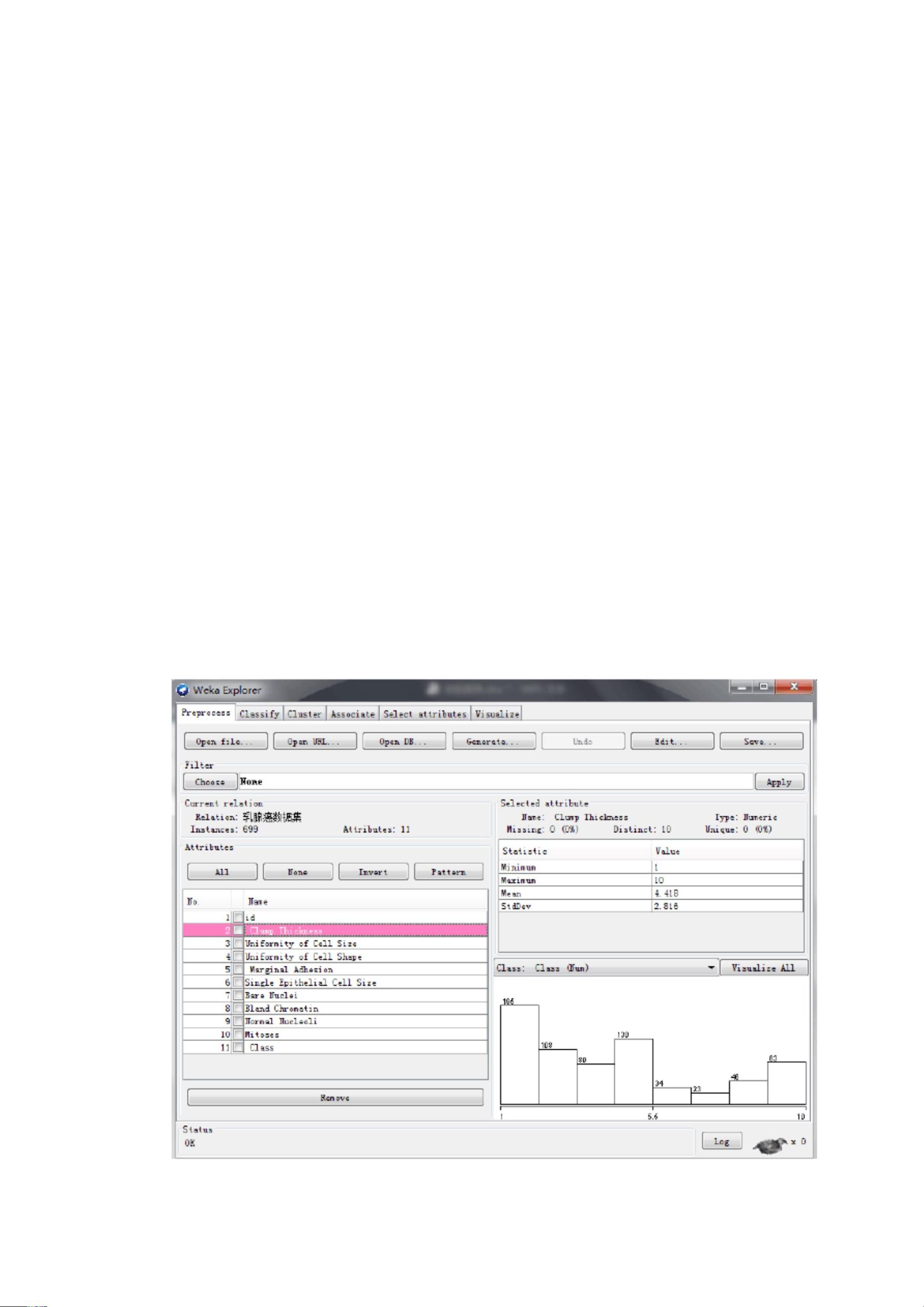

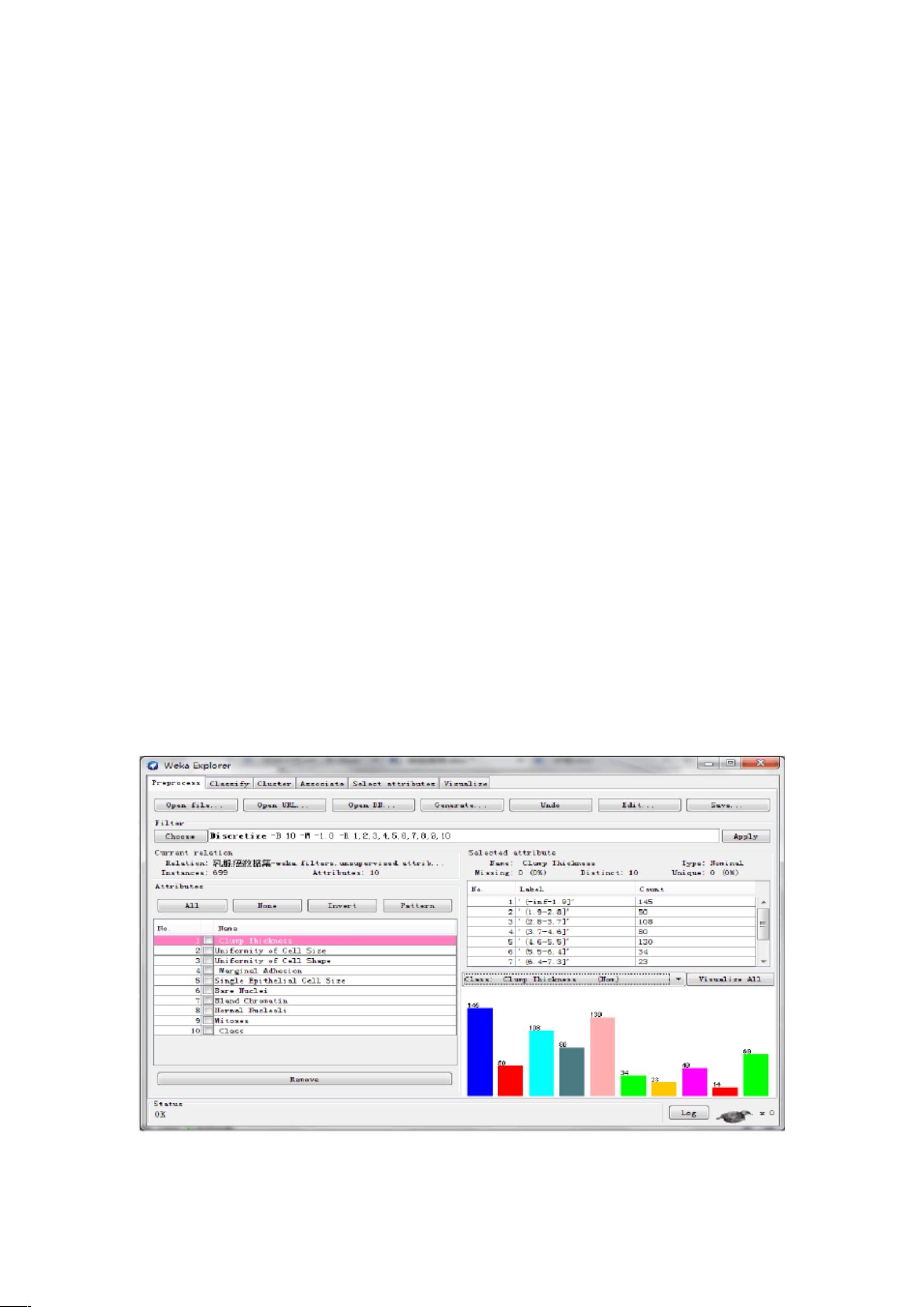

数据挖掘是信息技术领域的一个关键分支,它涉及到从大型数据集中提取有用信息、发现模式和规律的过程。在这个期末实验报告中,学生们使用了Weka这一强大的数据挖掘工具来完成任务。Weka是一个开源的Java应用程序,提供了多种预处理、分类、聚类和关联规则学习等方法。它特别适用于教学和研究,因为它具有用户友好的图形界面,同时支持脚本和编程接口。 实验的主要目标是使用分类算法对UCI公开数据库中的Breast Cancer Wisconsin (Original) Data Set进行分析。这个数据集包含了一些关于乳腺癌患者的特征,如细胞的大小、形状、粘连性等,以及一个分类标签,表示肿瘤是良性还是恶性。通过对这些数据进行预处理和分类,实验旨在了解不同特征如何影响分类结果,以及不同数量的训练集对模型性能的影响。 在数据预处理阶段,离散化是一个重要的步骤。离散化是将连续数值型属性转换为离散或类别属性的过程,有助于简化数据并可能提高某些算法的性能。在这个实验中,除了样本代码(作为标识符)外,其余9个数值属性都进行了离散化,将其分为10个等分,以减少连续值的复杂性并便于后续的分析。 接着,实验使用了K最近邻(K-Nearest Neighbor, KNN)算法进行分类。KNN是一种基于实例的学习方法,它根据测试样本的特征,找到与其最相似的K个训练样本,然后根据这些样本的类别来预测测试样本的类别。KNN的性能通常受到K值选择的影响,较大的K值可以减少噪声影响,但可能导致分类过于平滑;较小的K值则可能过于敏感,易受噪声影响。 实验还对比了决策树和贝叶斯分类器的性能。决策树是一种通过构建树状结构来做出预测的算法,每个内部节点代表一个特征,每个分支代表一个特征值,而叶子节点则代表类别。相比之下,贝叶斯分类器基于贝叶斯定理,它利用先验概率和似然概率来预测未知样本的类别。在实验结果中,决策树的错误率较高,可能是因为过度拟合或特征选择不当。而贝叶斯分类器与KNN相比,错误率也较高,且概率分布可能不清晰,表明这些算法在处理这个特定数据集时可能不如KNN有效。 此外,实验还探讨了训练集大小对模型性能的影响。一般来说,更大的训练集能提供更丰富的信息,有助于提高模型的泛化能力。然而,训练集过大可能会导致过拟合,即模型过于适应训练数据,而在未见过的数据上表现不佳。 通过这个实验,学生能够深入理解数据挖掘过程中的关键步骤,包括数据预处理、模型选择、性能评估和参数调整。同时,他们也获得了比较不同分类算法实际效果的经验,这对于今后在实际问题中应用数据挖掘技术是非常宝贵的。

剩余15页未读,继续阅读

- 粉丝: 4086

- 资源: 1万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 蓝桥杯算法笔记.pdf

- 云贝连锁V2独立版V2.2.2支持微信小程序+完整版与升级包

- Xray被动扫描报告2.html

- Flask应用中地理空间数据处理与Docker镜像构建的API集成

- DELPHI调用CALL通用源码 公开源码!

- keil5 v5.38里使用AC5

- delphi 卸载指定进程内已加载的DLL

- 如何学习C语言并精通C语言.pdf

- 《ARM9嵌入式系统设计基础教程》第10章Bootloader设计基础.ppt

- 电子制作_焊接工具_AxxSolder_31_销售_1741143924.zip

- 《Visual+Basic程序设计项目化案例教程》第1章 认识Visual+Basic+6.ppt

- 3439_107891787.html

- 开源风扇转速控制软件,适用于windows平台

- 临时文件,不用下载,没有积分,看看就行

- 原子上下文详细分析PDF

- 基于lvs+keepalived+nginx的web高性能的集群项目

信息提交成功

信息提交成功