1. 引言

行人重识别是用来判断一个摄像头下出现的行人是否在另一个摄像头下再次出现的方

法.现阶段,行人重识别技术面对的难点有

[1, 2]

:首先光照变化,视角位置,背景复杂,行人

被遮挡导致获得的行人图像分辨率较差,获取不到清晰行人信息.其次,不同摄像机的拍摄

角度不同,行人在不同的摄像机下姿态会发生变化.

目前,大多数的研究是基于图像-图像的行人重识别问题

[3-5]

.现在基于视频

[6]

的行人重

识别也得到越来越广泛地研究.与图像相比视频序列中包含了大量的人的外貌样本信息,这

些样本信息包含了同一行人在不同的姿势、视角和背景下的外貌信息.此外,还可以利用视

频序列的时间信息,建立更好的行人外貌分类模型.本文主要研究基于视频—视频(Video-to-

Video)的行人重识别问题.基于深度学习的行人重识别方法的主要思想是首先使用卷积神经

网络(CNN)或循环神经网络(RNN)

[4]

从视频帧中提取特征,然后对获得的深度学习特征进行

相似性度量

[7]

.网络越深,提取的特征更具鲁棒性,但是随着网络层数不断加深,会出现梯

度消失和退化两个问题,导致不能获得鲁棒性的特征.

在视频序列中存在被遮挡的不完整的行人图片,这些图片会降低重识别模型的准确度

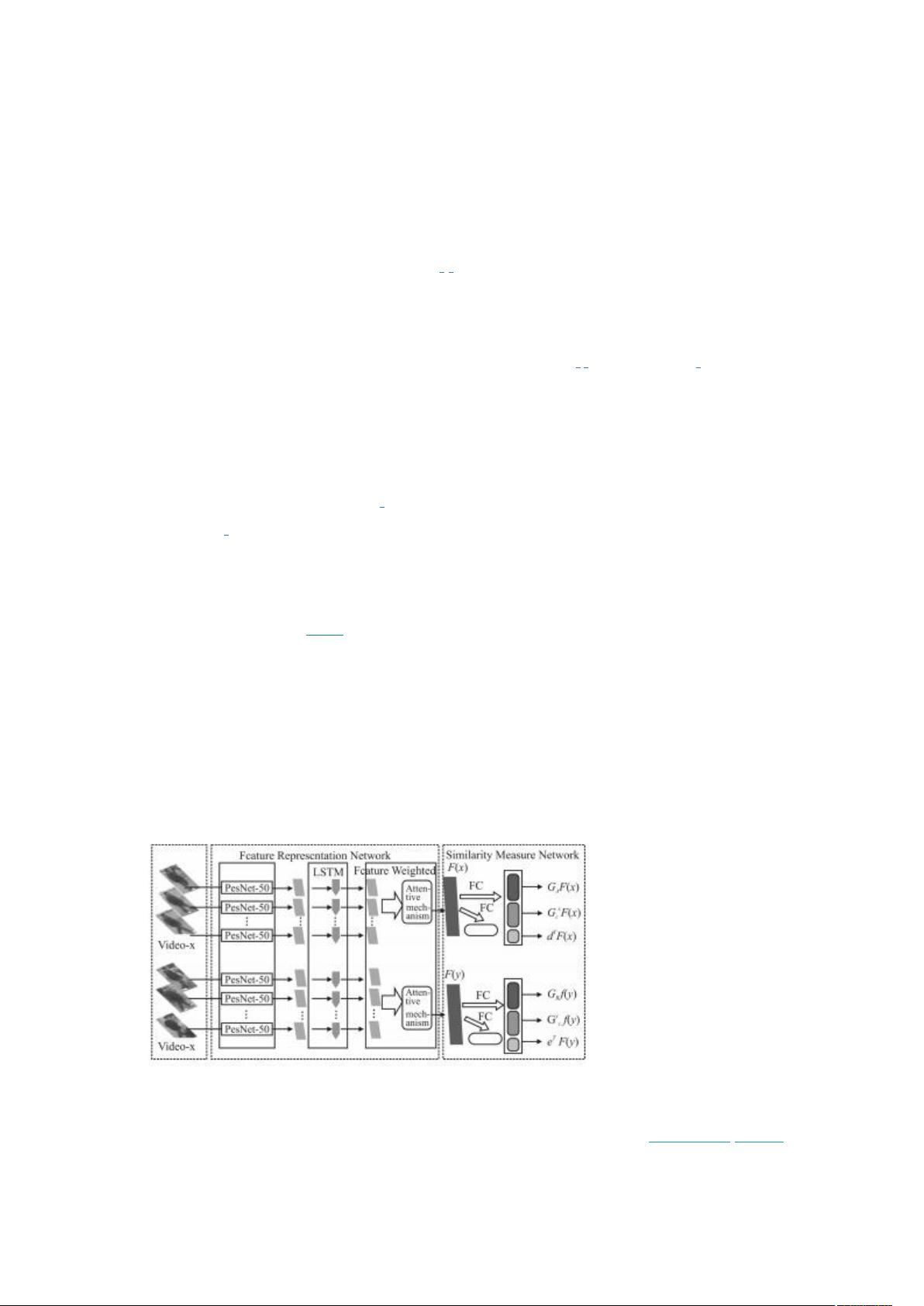

和性能.本文中提出了如图 1 所示的方法,该方法包括了特征表示子网络和相似性度量子网

络.在特征表示子网络中采用深度残差网络来提取视频的特征,克服了随着网络深度增加和

训练样本有限导致的分类精度下降的问题.进一步采用长期短期记忆(LSTM)网络来嵌入视

频的上下文时空特征,增强了模型区分具有相似外观但是并非同一人的能力.在视频中存在

大量的冗余信息和噪声,因此重识别模型需要能够关注那些具有判别性,高质量的特征.因

此为了降低视频中被严重遮挡的行人图片对行人重识别模型性能的影响,在 LSTM 层后添

加一个特征加权模块,该模块中使用了一种注意力机制,自适应为视频的帧分配合适的权

重,最后,使用一种广义相似性度量学习方法来度量两段视频序列之间的相似度.

图 1 全局网络结构

下载: 全尺寸图片 幻灯片