没有合适的资源?快使用搜索试试~ 我知道了~

华泰证券-计算机行业专题研究:大模型深度复盘,科技变革加速-230522.pdf

需积分: 0 0 下载量 13 浏览量

2023-06-20

09:29:43

上传

评论

收藏 6.06MB PDF 举报

温馨提示

试读

39页

华泰证券-计算机行业专题研究:大模型深度复盘,科技变革加速-230522.pdf

资源推荐

资源详情

资源评论

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。

1

证券研究报告

计算机

大模型深度复盘,科技变革加速

华泰研究

计算机

增持 (维持)

研究员

谢春生

SAC No. S0570519080006

SFC No. BQZ938

xiechunsheng@htsc.com

+(86) 21 2987 2036

研究员

郭雅丽

SAC No. S0570515060003

SFC No. BQB164

+(86) 10 5679 3965

研究员

范昳蕊

SAC No. S0570521060004

+(86) 10 6321 1166

联系人

彭钢

SAC No. S0570121070173

+(86) 21 2897 2228

联系人

袁泽世,PhD

SAC No. S0570122080053

+(86) 21 2897 2228

联系人

林海亮

SAC No. S0570122060076

+(86) 21 2897 2228

行业走势图

资料来源:Wind,华泰研究

2023 年 5 月 22 日│中国内地

专题研究

大模型时代已来,AGI 新纪元开启

大语言模型(LLM)是在大量数据集上预训练的巨大模型,在处理各种 NLP

(自然语言处理)任务方面显示出了较大潜力。2017 年 Transformer 编解

码器架构问世后,成了今年 LLM 发展的蓝图,并由此分化出编码器、编解

码器和解码器三条进化路径。其中,编解码器和解码器架构目前仍在不断演

进中,且解码器架构在数量上占据绝对优势。全球视角看,LLM 的典型代表

是 OpenAI 开发的 GPT 系列模型,国内的百度、智源等也在大模型上进行

了深厚的积累。在大模型的赋能下,各种垂类应用和工程实现纷纷落地,包

括 BloombergGPT、AutoGPT 等。LLM 或将开启通用人工智能新纪元。

溯源:从经典神经网络到 Transformer 架构

深度学习可以概括为特征的抽象和结果的预测。深度学习与神经网络密不可

分,主要原因是神经网络模型可以使用误差反向传播算法,较好地解决了深

度学习中的贡献度分配问题。从历史发展看,神经网络诞生于 1943 年提出

的 MP 模型,深度学习概念由 Hinton 于 2006 年正式提出。经过多年的发展,

问世了如卷积神经网络(CNN)、循环神经网络(RNN)、长短时记忆网络

(LSTM)等经典的深度学习算法。2017 年,Transformer 架构的出现成为

了后来 LLM 的基础架构,再次开启了大语言模型快速发展时期。

发展:从 GPT-1 到 GPT-4,开启大模型新纪元

2018 年,OpenAI 提出生成式预训练模型 GPT-1,引入有监督的微调训练。

2019 年,GPT-2 以更大的参数量和多任务训练进行 zero-shot 学习;2020

年,GPT-3 用 few-shot 代替 zero-shot,并将训练参数增加到 1750 亿,再

次提高模型表现性能。2022 年,InstructGPT 引入基于人类反馈的强化学习,

实现了更符合人类预期的模型输出。2022 年 11 月,OpenAI 正式推出对话

交互式模型 ChatGPT,5 天时间突破了 100 万用户。2023 年 3 月,GPT-4

问世,支持多模态输入,并能高水准完成专业考试,支持 API。

延伸:国内大模型快速成长,海外大模型多维拓展

大模型时代到来,模型体系与生态快速扩充,海内外企业坚定发力。受益于

大模型的理解能力、推理能力、泛化能力得到充分验证,海内外企业纷纷加

速大模型相关的产业布局,全面拥抱大模型时代的技术变革。1)国内:国

内大模型发展起步相对较晚,ChatGPT 问世以来国内企业加速大模型研发,

2023 年以百度文心、商汤日日新、讯飞星火等为代表的国产大模型相继发

布,并持续推进模型迭代升级;2)海外:海外大模型发展呈现垂直落地、

工程实现、模态丰富三大发展趋势,模型体系与配套的工程生态日益丰富。

产业链相关公司梳理

以 GPT 为代表的大模型产业链可分为算力、模型、应用三个环节。1)算力:

包括寒武纪、景嘉微、海光信息等芯片厂商以及浪潮信息、中科曙光、工业

富联等服务器厂商;2)模型:包括百度、三六零、科大讯飞、昆仑万维、

商汤科技等科技企业;3)应用:2C 简单包括金山办公、科大讯飞、同花顺、

万兴科技、东方财富、汉仪股份、汉王科技、萤石网络等企业;2B 简单包

括泛微网络、致远互联、上海钢联、彩讯股份等企业;2C 复杂包括中望软

件、索辰科技、广联达等企业;2B 复杂包括恒生电子、石基信息、科大讯

飞、汉王科技、金桥信息等企业。

风险提示:宏观经济波动;大模型技术迭代不及预期;本报告内容基于客观

资料整理,不构成投资建议。

(14)

6

26

46

66

May-22 Sep-22 Jan-23 May-23

(%)

计算机 沪深300

仅供内部参考,请勿外传

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。

2

计算机

正文目录

大模型时代已来,AGI 新纪元开启 ............................................................................................................................... 3

溯源:从经典神经网络到 Transformer 架构 ............................................................................................................... 4

深度学习是基于神经网络的机器学习 .................................................................................................................... 4

关系梳理:人工智能>机器学习>深度学习 .................................................................................................... 4

深度学习与神经网络发展历史(1943-2017) ............................................................................................... 4

CNN:卷积+汇聚+全连接 ..................................................................................................................................... 5

RNN:具有短期记忆的神经网络 ........................................................................................................................... 7

LSTM:将短期记忆进一步延长 ..................................................................................................................... 8

Transformer:基于自注意力机制的新兴架构 ........................................................................................................ 9

发展:从 GPT-1 到 GPT-4,开启大模型新纪元 ......................................................................................................... 11

GPT-1:确定生成式预训练模型基本路线 ........................................................................................................... 11

GPT-1:基于 Transformer 的预训练+微调半监督模型 ................................................................................ 11

模型特点:无监督训练+有监督微调 ............................................................................................................ 11

GPT-2:关注模型的零次学习 Zero-shot 能力 ..................................................................................................... 12

GPT-2:开启“单模型解决多任务”新纪元,大容量技术路线确定 ............................................................ 13

模型特点:多任务学习+大模型容量+无微调建模 ........................................................................................ 13

GPT-3:模型参数达 1750 亿,few-shot 进一步提高性能 ................................................................................... 15

模型特点:大参数量+大训练集+few-shot ................................................................................................... 15

Codex:基于 GPT-3 的代码生成工具 ......................................................................................................... 18

ChatGPT / InstructGPT:增加人类反馈强化学习(RLHF) .............................................................................. 19

优化目标:从提示学习到指示学习,聚焦需求对齐(alignment) .............................................................. 19

训练过程:“三步走”实现人工反馈强化学习 .............................................................................................. 20

GPT-4:多模态确认,在专业和学术上表现亮眼 ................................................................................................ 21

GPT-4:支持多模态输入,安全问题或成为 LLM 关注焦点 ........................................................................ 21

能力测试:在专业和学术基准上表现出了人类的水平 ................................................................................. 22

多模态:支持图片输入,未提供具体算法 ................................................................................................... 23

延伸:国内大模型快速成长,海外大模型多维拓展 .................................................................................................... 24

国内大模型快速成长,多类厂商竞逐发力 ........................................................................................................... 24

百度:文心大模型 2 月发布,新一代知识增强大语言模型 ......................................................................... 24

商汤科技:日日新大模型 4 月发布,加速迈进 AGI 时代 ............................................................................ 25

科大讯飞:星火大模型 5 月发布,AGI 核心能力表现出色 .......................................................................... 27

智源研究院:超大规模“悟道”模型,构建完备大模型生态体系 ............................................................... 28

海外大模型多维拓展,看好垂直落地、工程实现、模态丰富三大趋势 ............................................................... 30

垂直落地:BloombergGPT 提供构建垂直行业大模型的有益参考 .............................................................. 30

工程实现:AutoGPT 充分展现大模型有望重塑人机交互范式 ..................................................................... 32

模态丰富:SAM 模型实现大模型在 CV 领域的模态延展 ............................................................................ 33

产业链相关公司梳理 ................................................................................................................................................... 35

风险提示.............................................................................................................................................................. 35

仅供内部参考,请勿外传

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。

3

计算机

大模型时代已来,AGI 新纪元开启

Transformer 开启大语言模型发展新时期,为人工通用智能铺平了道路。大语言模型(LLM)

是在大量数据集上预训练的巨大模型,且没有针对特定任务调整数据,其在处理各种 NLP

(自然语言处理)任务方面显示出了较大潜力,如自然语言理解(NLU)、自然语言生成任

务等,甚至为人工通用智能(AGI)铺平了道路。而近年来的 LLM,基本都脱胎于 2017 年

Google 提出的 Transformer 编解码器架构,Transformer 开启了 LLM 发展的新时期。

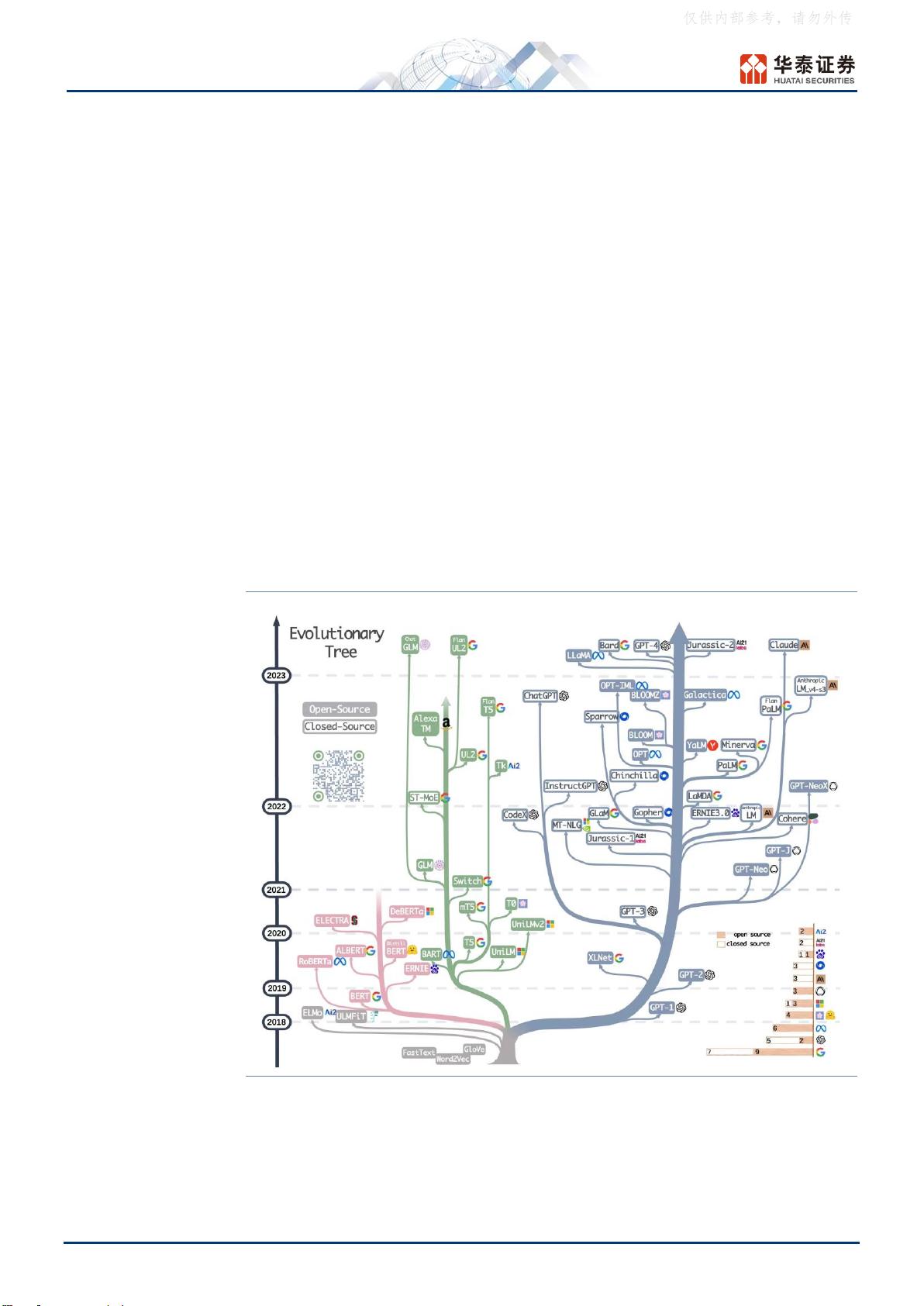

基于 Transformer 架构的三条演进路线中,解码器路线发展最为迅速。从 LLM 近年的发展

情况来看,其路线主要分为三种:1)编码器路线;2)编解码器路线;3)解码器路线。从

发展特点来看:1)解码器路线占据主导,编码器路线趋于落寞,归因于 2020 年 GPT-3 模

型表现出的优异性能;2)GPT 系列模型保持领先,或归因于 OpenAI 对其解码器技术道路

的坚持;3)模型闭源逐渐成为头部玩家的发展趋势,这一趋势同样起源于 GPT-3 模型,

而 Google 等公司也开始跟进;4)编解码器路线仍然在持续发展,但是在模型数量上少于

解码器路线,或归因于其复杂的结构,导致其在工程实现上没有明显的优势。

国内百度、智源等公司和组织在大模型上有较深厚的积累。百度的文心一言基于 ERNIE 系

列模型,该模型最早于 2019 年提出,到 2021 年迭代到 ERNIE3.0 版本,技术路线也从最

初的编码器路线转移到解码器路线,性能提升明显。智源研究院则依托于清华等高等学府

及其研究成果,2021 年提出的 GLM 模型成为智源悟道大模型的重要技术基础。据日经亚

洲信息,微软总裁布拉德认为智源是微软、OpenAI 和 Google 重要竞争对手。

图表1: 大语言模型(LLM)演化树

资料来源:《Harnessing the Power of LLMs in Practice: A Survey on ChatGPT and Beyond》,Yang Jingfeng(2023)、华泰

研究

本部分将从神经网络出发,梳理深度学习方法的发展情况,引出注意力机制与 Transformer

架构,并对全球 LLM 的典型代表——GPT 系列模型进行详细拆解。此外,还将对国内快

速发展的百度文心一言、商汤科技日日新、科大讯飞星火、智源悟道等大模型,以及大模

型在金融垂直领域的重要应用 BloombergGPT 等进行详细解析。

仅供内部参考,请勿外传

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。

4

计算机

溯源:从经典神经网络到 Transformer 架构

深度学习是基于神经网络的机器学习

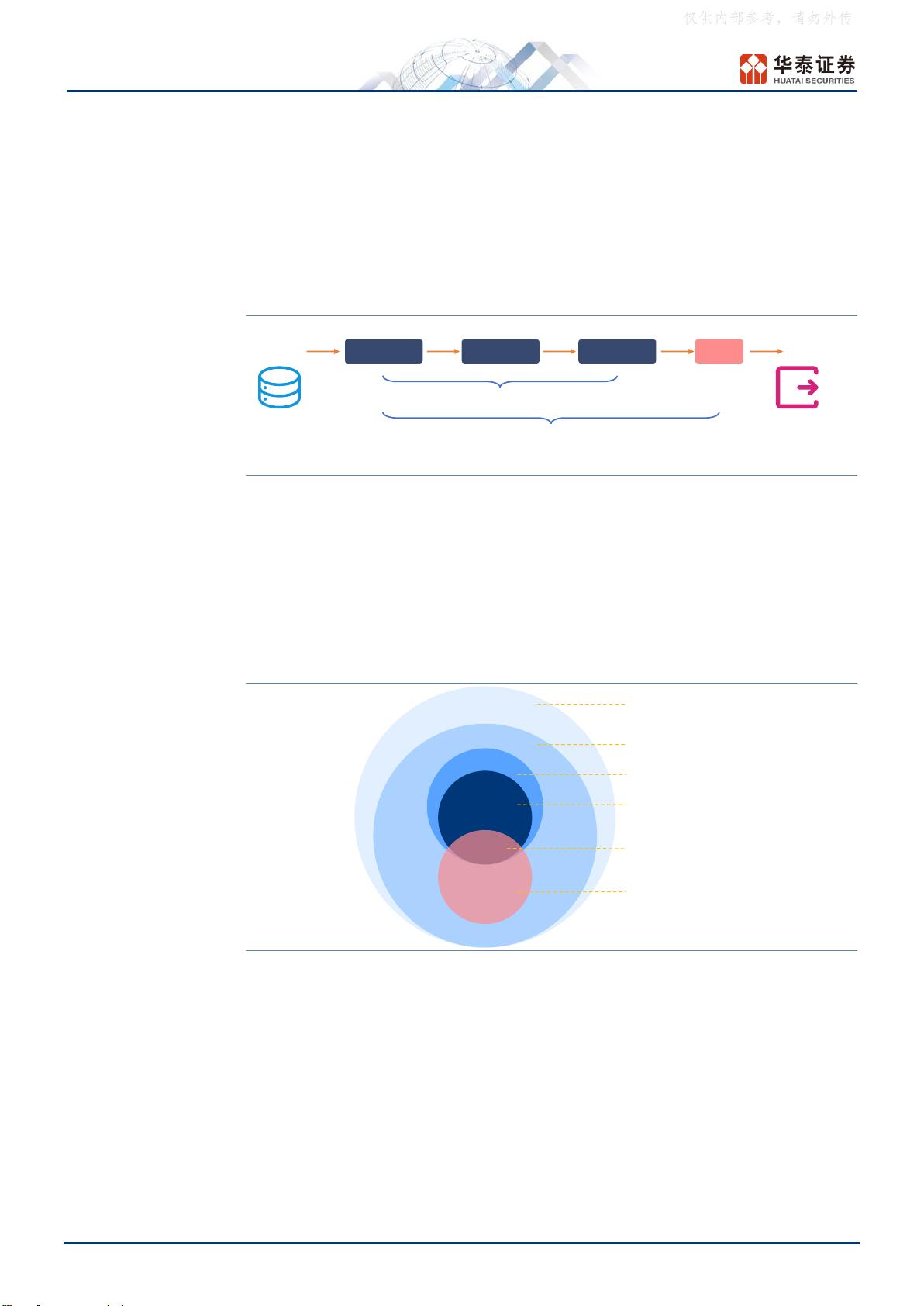

深度学习可以概括为特征的抽象和结果的预测。深度学习是将原始的数据特征通过多步的

特征转换得到一种更高层次、更抽象的特征表示,并进一步输入到预测函数得到最终结果。

深度学习需要解决的关键问题是贡献度分配问题(Credit Assignment Problem,CAP),即

一个系统中不同的组件(component)或其参数对最终系统输出结果的贡献或影响。深度

学习的目标是让模型自动学习出好的特征表示,从而最终提升预测模型的准确率。

图表2: 深度学习的数据处理流程

资料来源:《神经网络与深度学习》(邱锡鹏),ISBN: 9787111649687、华泰研究

关系梳理:人工智能>机器学习>深度学习

人工智能包括机器学习,机器学习包含深度学习。人工智能(AI)的重要组成部分是机器

学习(ML),而神经网络(NN)是 ML 的一个子领域。深度学习可以看做是神经网络的分

支,使用了更复杂和更深层次的网络结构,如卷积神经网络(CNN),来处理更高维度和更

抽象的数据,如图像、声音和文本。此外,逐渐兴起的强化学习也是机器学习的一个分支。

深度学习与强化学习可以相互结合,称为深度强化学习(DRL)。

图表3: 人工智能、机器学习、深度学习关系梳理

资料来源:《The History Began from AlexNet: A Comprehensive Survey on Deep Learning Approaches》,Zahangir(2018)、

《Deep Reinforcement Learning》,Yuxi Li(2017)、华泰研究

深度学习与神经网络发展历史(1943-2017)

神经网络诞生于 1943 年,深度学习崛起于 2006 年。1943 年,心理学家 McCulloch 和数

学家 Pitts 最早提出了一种基于简单逻辑运算的人工神经网络—MP 模型,开启了人工神经

网络研究的序幕。1986 年,Hinton 提出第二代神经网络,并利用误差的反向传播算法来训

练模型,该算法对神经网络的训练具有重要意义。1989 年,Yann LeCun 等提出卷积神经

网络(CNN)用来识别手写体。1997 年,循环神经网络(RNN)的改进型长短时记忆网络

(LSTM)被提出。2006 年,Hinton 首次提出了深度置信网络(Deep Belief Network,DBN)

和深度学习的概念。2014 年,生成对抗网络(GAN)的提出是深度学习的又一突破性进展。

2016 年,AlphaGo 击败围棋世界冠军李世石,将深度学习推向高潮。

底层特征 中层特征 高层特征 预测

原始数据 结果

表示学习

深度学习

人工智能

机器学习

神经网络

深度学习

强化学习

深度强化学习

AI

ML

DL

RL

DRL

仅供内部参考,请勿外传

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。

5

计算机

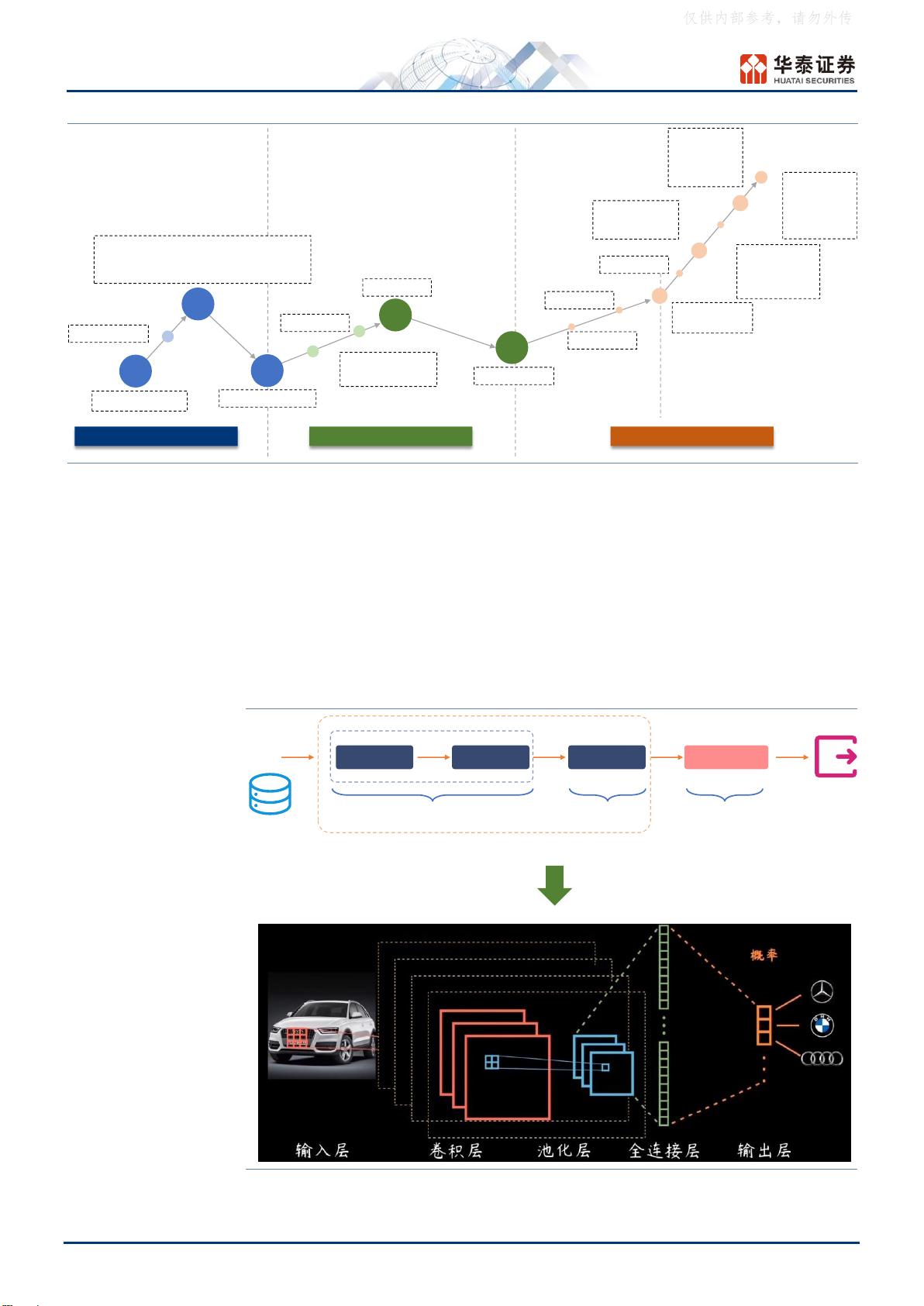

图表4: 深度学习发展历史

注:最大圆圈表示深度学习热度上升与下降的关键转折点,实心小圈圈的大小表示深度学习的突破大小,斜向上的直线表示深度学习热度正处于上升期,斜向下的直线

表示下降期。

资料来源:《深度学习研究综述》,张荣(2018)、华泰研究

CNN:卷积+汇聚+全连接

典型的卷积神经网络是由卷积层、汇聚层、全连接层交叉堆叠而成。其中,一个卷积块包

括连续 M 个卷积层和 b 个汇聚层(M 通常设置为 2∼5,b 为 0 或 1)。一个卷积网络中可以

堆叠 N 个连续的卷积块,然后在后面接着 K 个全连接层(N 的取值区间比较大,比如 1∼100

或者更大;K 一般为 0∼2)。 CNN 能够有效的将大数据量的图片降维成小数据量,并有效的

保留图片特征。

图表5: 常用的卷积网络整体结构

资料来源:《神经网络与深度学习》(邱锡鹏),ISBN: 9787111649687、华泰研究

第一代神经网络 第二代神经网络 第三代神经网络

1943

1969

1986

1998

2006

1958

1989

1997

2010

2011

2012

2013

2014

2015

2016

2017

MP神经元数学模型

单层感知器

Minsky专著《感知器》出版,支出单层感知器不

能解决“异或回路”问题,且当时计算能力无法

满足神经网络计算需求

LSTM

LeNet

Xavier

ReLU

Clarifai

Dropout

AlexNet

GoogleNet

VGGNet

R-CNN

GAN

BN

Faster R-CNN

ResNet

WGAN

AlphaGo

Zero

CapsNet

AlphaGo

InfoGAN

JMT

DCN

GNMT

浅层学习浪潮

反向传播算法

万能逼近定理

卷积神经网络

深度信念网

快速发展潮 爆发期

卷积

ReLU

汇聚层 全连接层

输入

×M ×b

×N

×b

形象

解释

仅供内部参考,请勿外传

剩余38页未读,继续阅读

资源评论

weishaoonly

- 粉丝: 132

- 资源: 1383

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功