Flume的channel和sink.docx

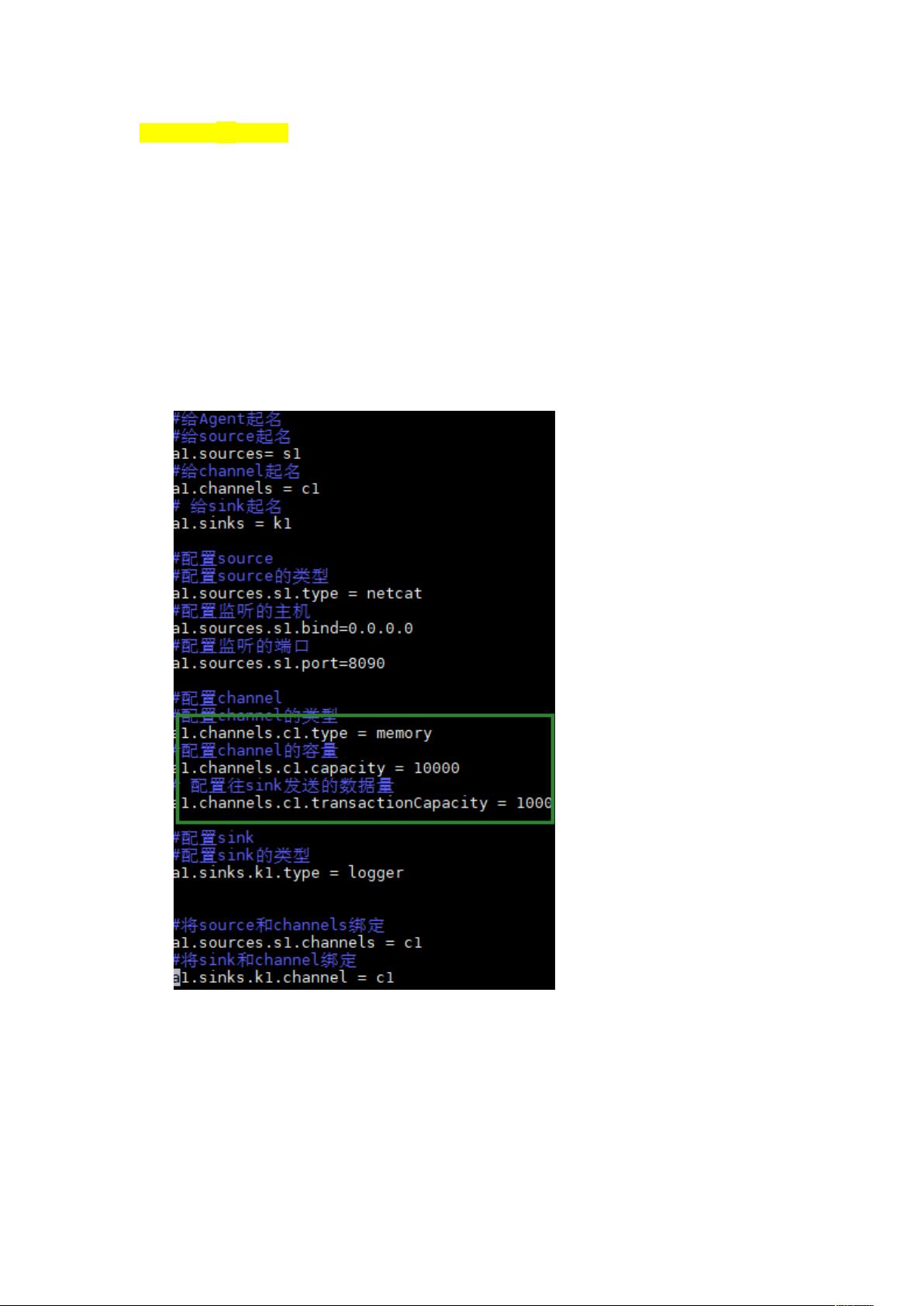

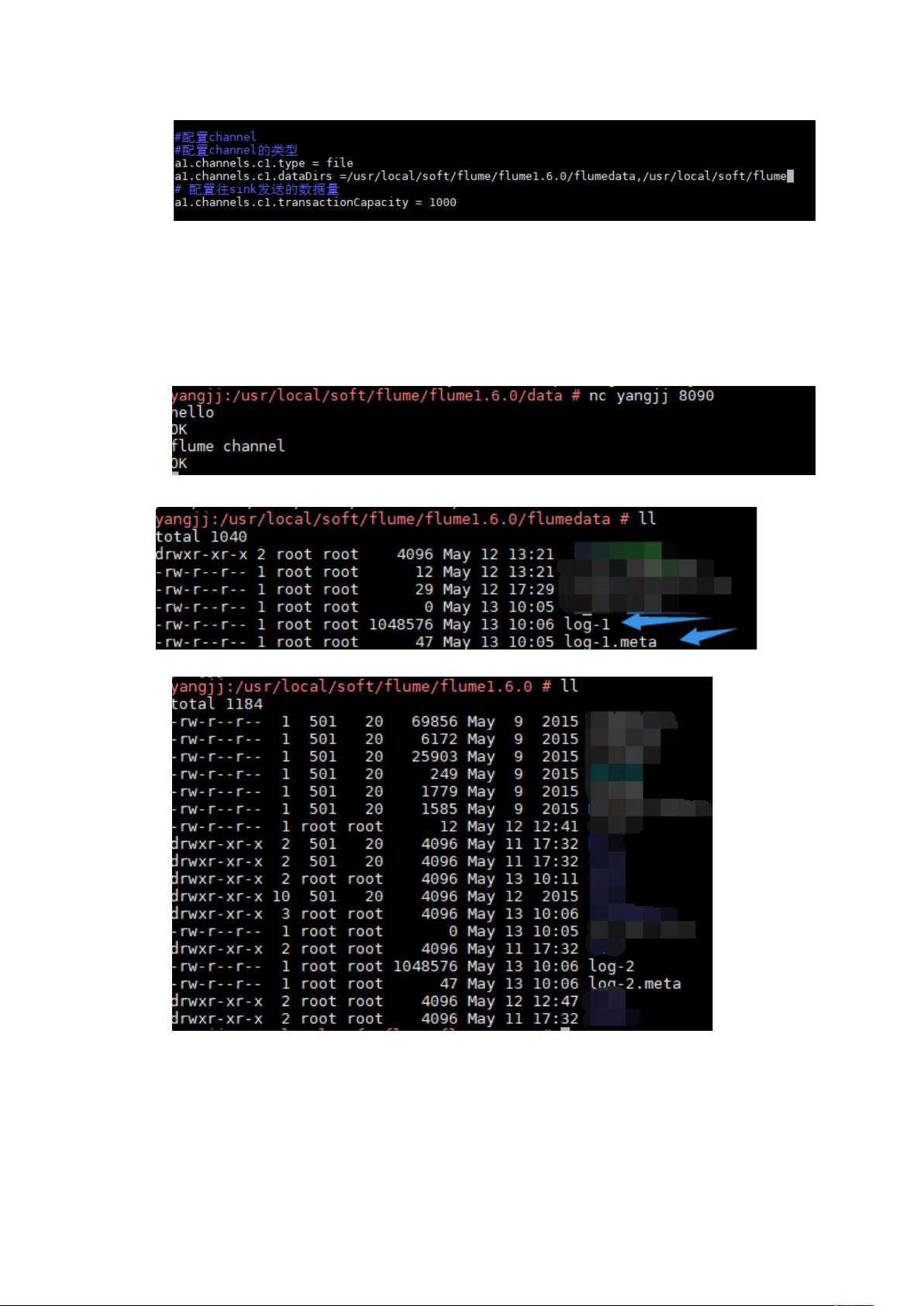

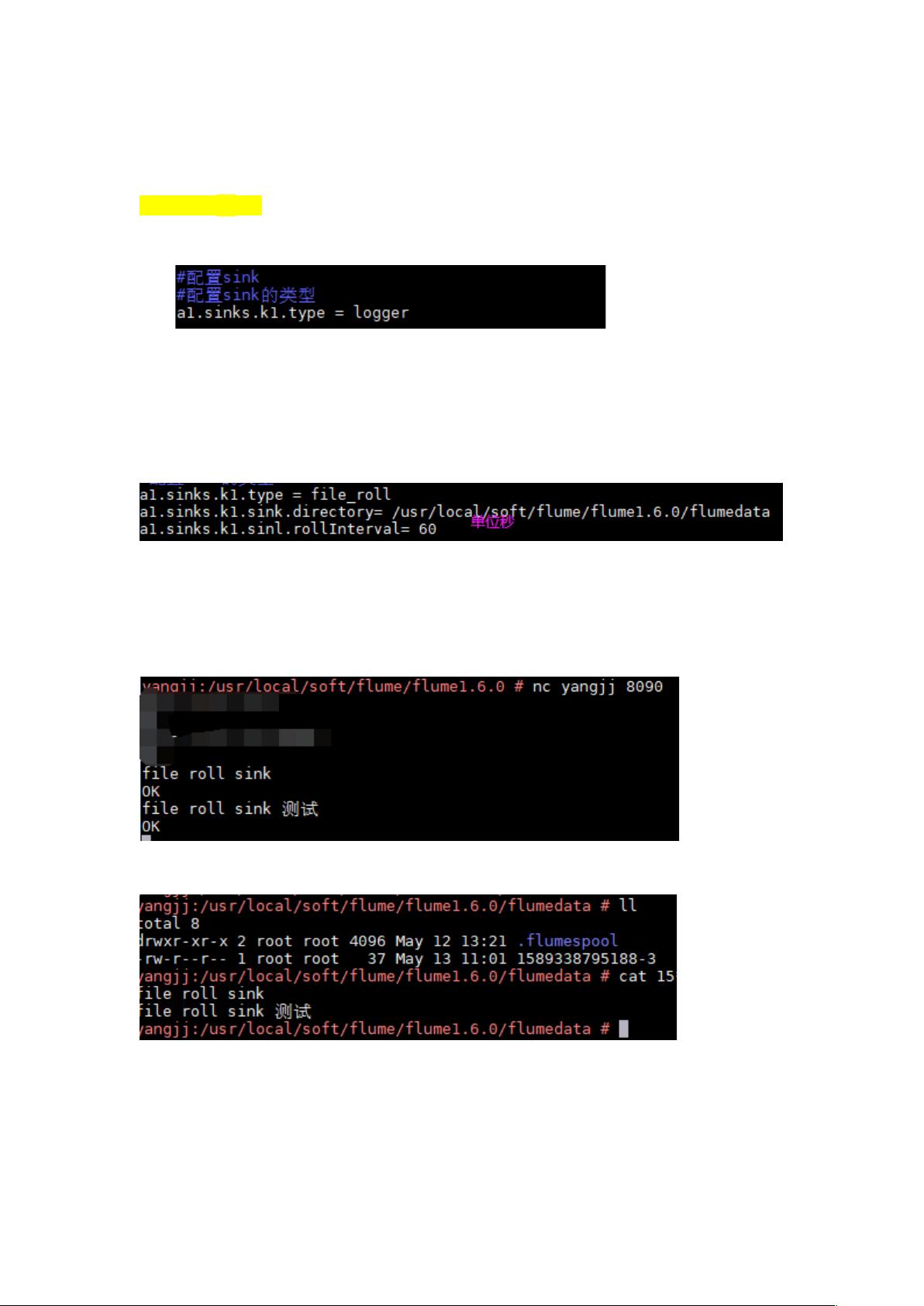

本文讲述了flume中channel和sink简单描述和linux配置 包括:Memory channel、File channel及其它测试阶段的Channel; 及channel通过sink的输出配置Logger Sink、File Roll Sink、HDFS Sink、Avro Sink(多级流动、扇入流动、扇出流动); 及Source端增加的一些选择器、拦截器:多路复用/路由器Selector、timestamp拦截器、Serach And Replace Interceptor、Regex Filter Interceptor、Regex Extractor Interceptor、Host Interceptor、Static Interceptor、UUID Interceptor; 最后讲述了一个channel通过负载均衡机制,匹配多个sink中个一个输出 Apache Flume 是一个分布式、可靠且可用于有效收集、聚合和移动大量日志数据的系统。在Flume中,数据流动的核心组件是`Source`、`Channel`和`Sink`。 **Channel**是Flume中的中介存储,它在Source和Sink之间提供缓冲。以下是几种常见的Channel类型: 1. **Memory Channel**:将事件存储在内存中,适合快速处理但可能丢失数据。配置参数包括`memoryCapacity`(默认100个事件,每个最多100B)和`transactionCapacity`(默认100个事件,建议调整为1000-3000)。 2. **File Channel**:将事件持久化到文件系统,确保数据不丢失。可以通过`bin/flume-ng agent`命令启动并配置。 3. **JDBC Channel**:事件存储在Derby数据库中,仅适用于测试环境,因为Derby仅支持单个连接。 4. **内存溢出 Channel**:在内存满时,将事件溢出到文件中,也用于测试。 **Sink**是Flume用于将事件输出到特定位置的组件,例如: - **Logger Sink**:将事件记录到控制台,限制了16字节的body内容。 - **File Roll Sink**:在本地文件系统中存储事件,并定期滚动生成新文件。 - **HDFS Sink**:将事件写入HDFS,支持不同文件类型,如SequenceFile、DataStream和CompressedStream,并通过`hdfs.rollInterval`设置滚动间隔。 - **Avro Sink**:序列化事件后传输到指定端点,支持多级流动、扇入和扇出流动。 - **多级流动**:数据在多台主机间传递,每台主机通过Avro序列化事件并发送给下一台。 - **扇入流动**:多个Source的数据汇聚到一个Sink。 - **扇出流动**:一个Source的数据流向多个Sink。 **Source选择器与拦截器**用于更精细地控制数据流: - **多路复用/路由器Selector**:基于事件头属性进行路由选择,例如根据"class"属性将事件发送到不同的Channel。 - **Timestamp Interceptor**:添加或修改事件的时间戳。 - **Search And Replace Interceptor**:搜索并替换事件中的内容。 - **Regex Filter Interceptor**:基于正则表达式过滤事件。 - **Regex Extractor Interceptor**:从事件中提取匹配正则表达式的部分。 - **Host Interceptor**:添加主机名作为事件的元数据。 - **Static Interceptor**:添加静态元数据到事件。 - **UUID Interceptor**:为每个事件生成唯一ID。 在高可用场景中,可以通过负载均衡机制将一个Channel的事件均匀分配给多个Sink,确保数据的稳定输出。这种配置能够提高系统的可靠性和性能,同时降低了单点故障的风险。 总结起来,Flume的Channel和Sink是构建高效日志收集和传输系统的关键元素,通过灵活的配置和扩展,可以满足各种日志处理需求。选择合适的Channel类型和Sink类型,以及利用选择器和拦截器,可以优化数据流动的效率和安全性。

剩余18页未读,继续阅读

- 粉丝: 40

- 资源: 8

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功