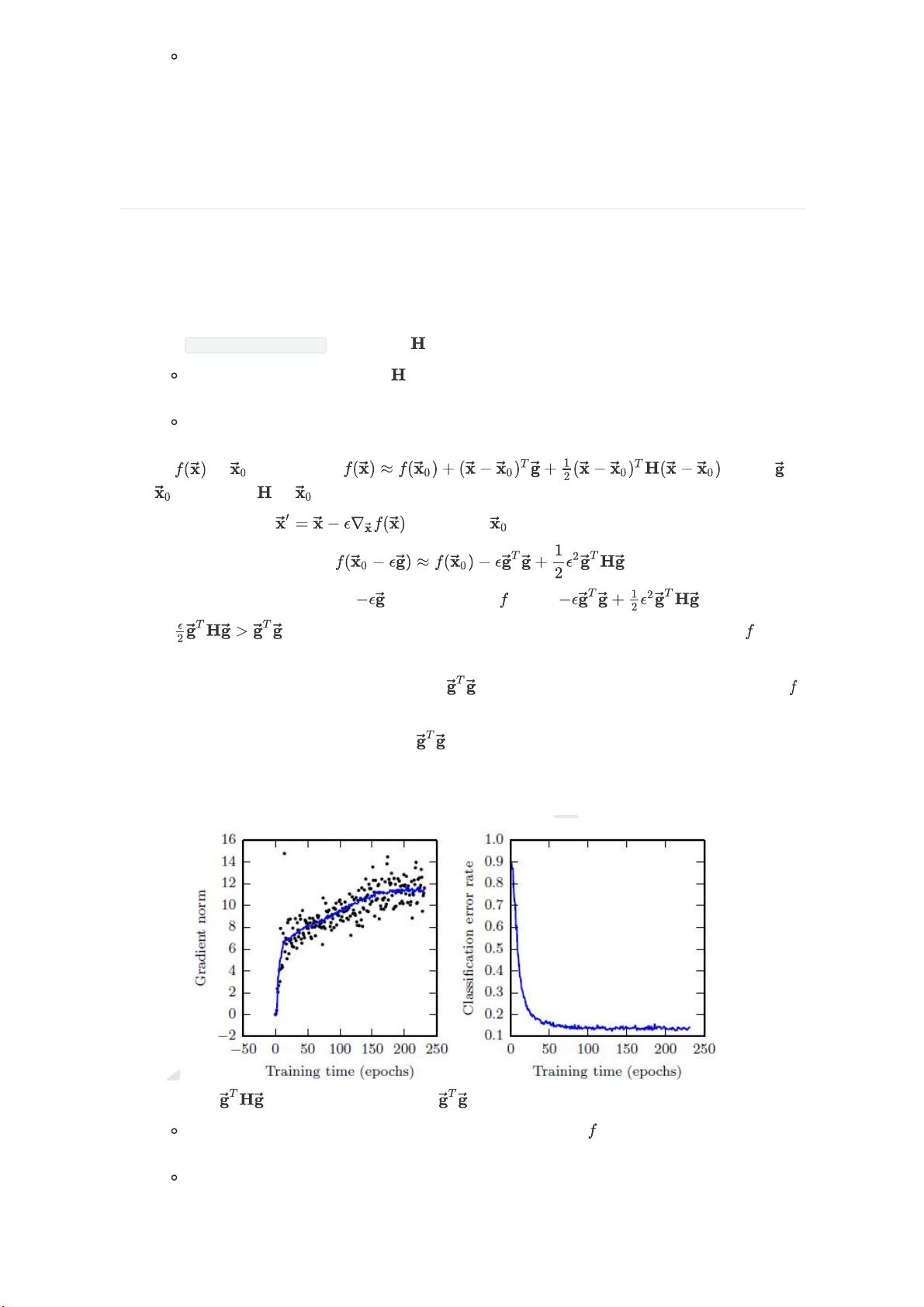

在深度学习领域,最优化问题占据着至关重要的地位,因为它直接影响到模型的训练效果和效率。最优化的目标是寻找能够使代价函数最小化的参数,但这个过程并不简单,因为代价函数往往是复杂的非凸函数,可能导致多种不同的训练结果。深度学习模型的结构和数据集即使完全相同,选择不同的优化算法也可能产生截然不同的训练效果。 我们要理解代价函数在机器学习中的作用。通常,我们不能直接优化测试集上的性能度量,如在图像目标检测中的mAP(mean average precision),因此采用损失函数作为代理,通过降低损失函数来期望提升实际性能。最常见的做法是使用训练集上损失函数的平均值作为经验风险最小化的目标。然而,理论上的最优解是期望在真实数据分布上最小化损失,但在实际中,由于数据分布未知,我们只能依赖训练集,导致可能的过拟合问题。 为了解决这个问题,有时会使用替代损失函数,例如将正类的负对数似然函数作为0-1损失函数的替代,以实现更有效的优化。机器学习的优化通常不追求局部极小值,而是通过替代损失函数和早停策略等手段,寻找在验证集上表现良好的参数设置。 神经网络最优化面临的挑战主要包括非凸优化问题和特定的数学特性。非凸问题可能导致局部极小值,但对可辨认的模型来说,这不是主要障碍。更大的挑战在于病态的海森矩阵(Hessian matrix),这会导致梯度下降法在某些点上无法取得进展,甚至可能导致成本函数增加。病态的海森矩阵意味着模型对参数更新过于敏感,使得学习过程变得困难。此外,实践中往往观察到梯度的平方范数不会随着训练而显著减小,反而可能增加,导致学习速度变慢。 为了应对这些挑战,优化算法如随机梯度下降(SGD)、动量SGD、Adam等被广泛使用。它们通过引入动量项或自适应学习率来改善梯度下降的效果。另外,二阶优化方法如牛顿法虽然理论上在处理病态问题时效果好,但由于计算成本高,通常不直接应用于大规模神经网络。 深度学习的最优化是一个复杂的过程,涉及到代价函数的设计、优化算法的选择以及如何处理非凸优化和数值稳定性问题。选择合适的优化策略和参数初始化方法对于模型的性能至关重要,而理解这些背后的原理有助于我们在实际应用中做出更好的决策。

剩余42页未读,继续阅读

- 粉丝: 37

- 资源: 322

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- HtmlMate标签使用详解中文最新版本

- ATM机旁危险物品检测数据集VOC+YOLO格式1251张5类别.zip

- 网页优化meta标签使用方法及规则中文最新版本

- 网页万能复制 浏览器插件

- IMG_20241123_093226.jpg

- JavaScript的表白代码项目源码.zip

- springboot vue3前后端分离开发入门介绍,分享给有需要的人,仅供参考

- 全国297个地级市城市辖区数据1990-2022年末实有公共汽车出租车数人均城市道路建成区绿地面积供水供气总量医院卫生机构数医生人数GDP第一二三产业增加值分行业从业人员水资源农产品产量利用外资

- Python客流量时间序列预测模型.zip

- 故障预测-灰色预测模型C++源码.zip

信息提交成功

信息提交成功

评论0