没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

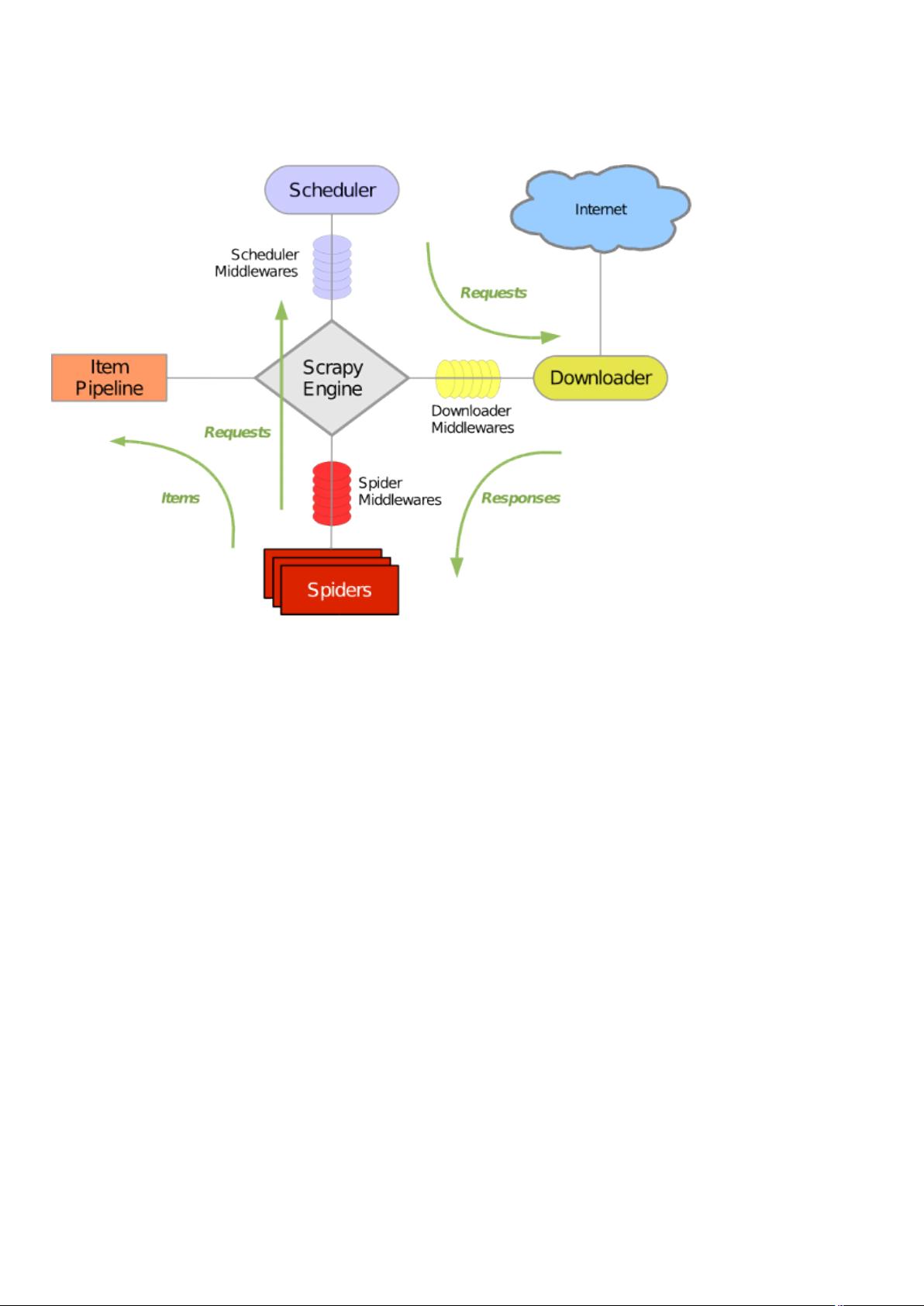

1. Scrapy 架构

2. 主要部件

1. 引擎(Scrapy)

用来处理整个系统的数据流 (框架核心)

2. 调度器(Scheduler)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个 URL(抓取网页的网

址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址

3. 下载器(Downloader)

用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy 下载器是建立在 twisted 这个高效的异步模型上的)

4. 爬虫(Spiders)

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链

接,让 Scrapy 继续抓取下一个页面

5. 项目管道(Pipeline)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页

面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。

6. 下载器中间件(Downloader Middlewares)

位于 Scrapy 引擎和下载器之间的框架,主要是处理 Scrapy 引擎与下载器之间的请求及响应。

7. 爬虫中间件(Spider Middlewares)

介于 Scrapy 引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。

8. 调度中间件(Scheduler Middewares)

介于 Scrapy 引擎和调度之间的中间件,从 Scrapy 引擎发送到调度的请求和响应。

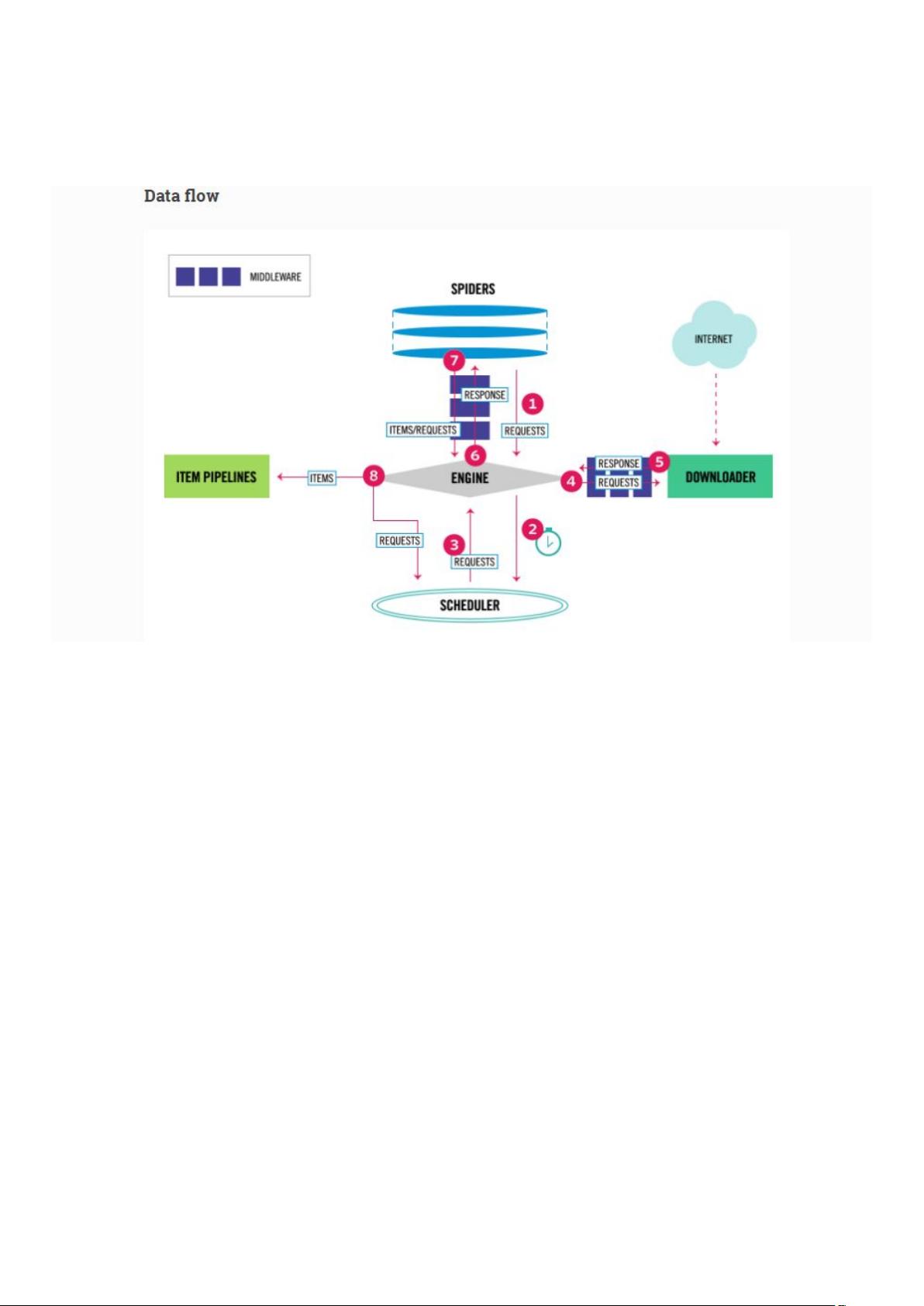

3. Scrapy 运行流程大概如下

Scrapy 中的数据流由执行引擎控制,其过程如下:

1,引擎从 Spiders 中获取到最初的要爬取的请求(Requests)。

2,引擎安排请求(Requests)到调度器中,并向调度器请求下一个要爬取的请求(Requests)。

3,调度器返回下一个要爬取的请求(Requests)给引擎。

4 , 引 擎 将 上 步 中 得 到 的 请 求 ( Requests ) 通 过 下 载 器 中 间 件 ( Downloader Middlewares ) 发 送 给 下 载 器

(Downloader ),这个过程中下载器中间件(Downloader Middlewares)中的 process_request()函数会被调用到。

5,一旦页面下载完毕,下载器生成一个该页面的 Response,并将其通过下载中间件(Downloader Middlewares)发

送给引擎,这个过程中下载器中间件(Downloader Middlewares)中的 process_response()函数会被调用到。

6,引擎从下载器中得到上步中的 Response 并通过 Spider 中间件(Spider Middlewares)发送给 Spider 处理,这个过程中

Spider 中间件(Spider Middlewares)中的 process_spider_input()函数会被调用到。

7,Spider 处理 Response 并通过 Spider 中间件(Spider Middlewares)返回爬取到的 Item 及(跟进的)新的 Request 给引擎,

这个过程中 Spider 中间件(Spider Middlewares)的 process_spider_output()函数会被调用到。

8,引擎将上步中 Spider 处理的其爬取到的 Item 给 Item 管道(Pipeline),将 Spider 处理的 Request 发送给调度器,

并向调度器请求可能存在的下一个要爬取的请求(Requests)。

9,(从第二步)重复直到调度器中没有更多的请求(Requests)。

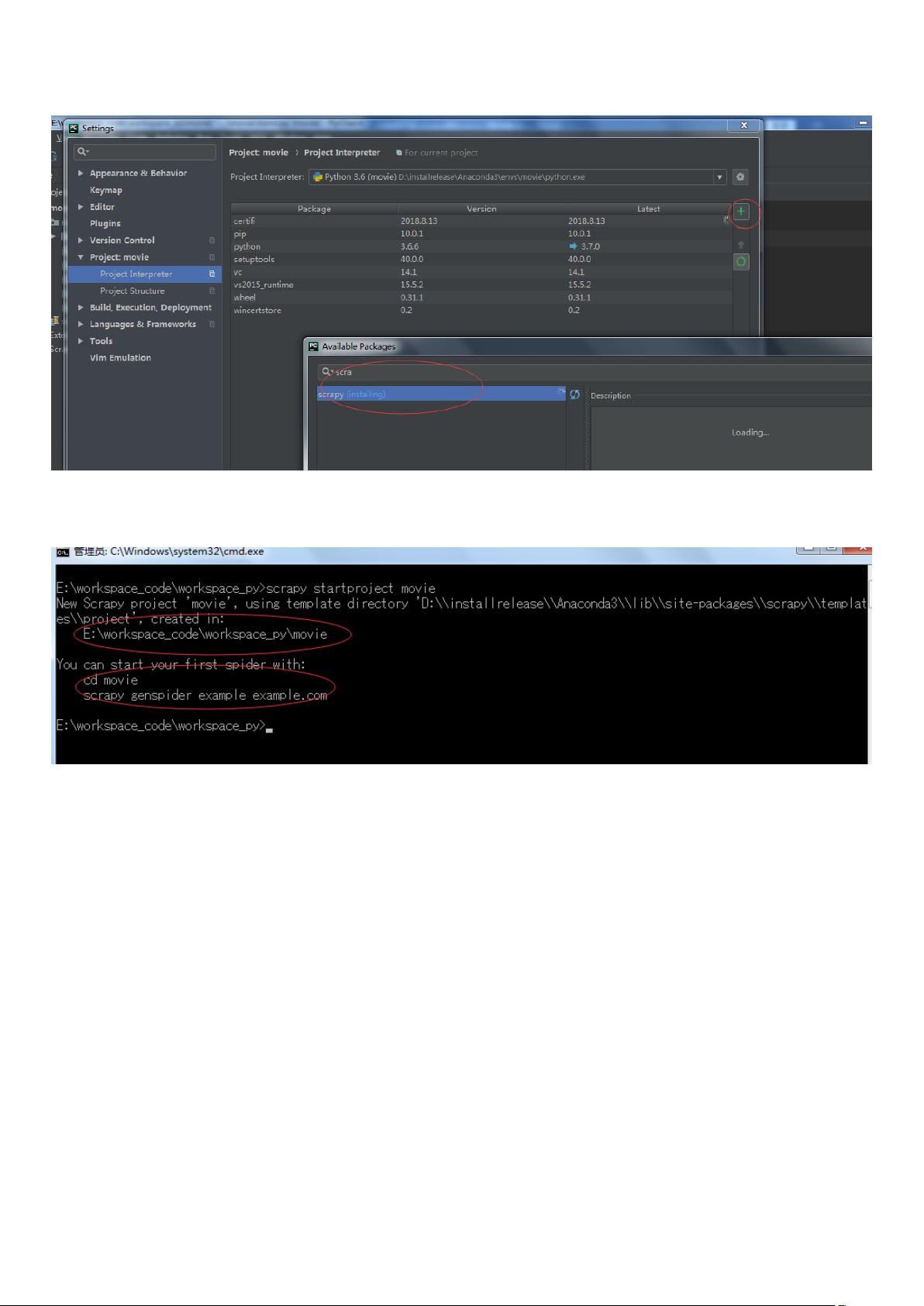

4. 安装 scrapy

Pip install scrapy 等

5. 创建项目

E:\workspace_code\workspace_py>scrapy startproject movie

New Scrapy project 'movie', using template directory 'D:\\installrelease\\Anaconda3\\lib\\site-packages\\scrapy\\templat

es\\project', created in:

E:\workspace_code\workspace_py\movie

6. 创建爬虫

You can start your first spider with:

cd movie

genspider 生成爬虫命令

example 爬虫的名字

example.com 爬取的网站

scrapy genspider example example.com

剩余10页未读,继续阅读

whph

- 粉丝: 18

- 资源: 305

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0