没有合适的资源?快使用搜索试试~ 我知道了~

前言:特征工程是机器学习的重点,直接影响着模型的好坏。数据收集业务的实现需要哪些数据?基于对业务规则的理解,尽可能多的找出对因变量有在进行机器学习之前,收集数据

资源推荐

资源详情

资源评论

业务的实现需要哪些数据? 基于对业务规则的理解,尽可能多的找出对因变量有

影响的所有自变量数据。

1.

数据可用性评估在获取数据的过程中,首先需要考虑的是这个数据获取的成本;

获取得到的数据,在使用之前,需要考虑一下这个数据是否覆盖了所有情况以及

这个数 据的可信度情况。

2.

数据源

用户行为日志数据:记录的用户在系统上所有操作所留下来的日志行为数据业务

数据:

商品/物品的信息、用户/会员的信息......

第三方数据:爬虫数据、购买的数据、合作方的数据....

•

数据储存

一般情况下,用于后期模型创建的数据都是存在在本地磁盘、关系型数据库或者

一些相关的分布式数据存储平台的。 本地磁盘 MySQL Oracle HBase HDFS

Hive

•

预处理

在数据预处理过程主要考虑两个方面,如下: 选择数据处理工具:关系型数据库

或者Python 查看数据的元数据以及数据特征:一是查看元数据,包括字段解

释、数据来源等一切可以描述数据的信息;另外是抽取一部分数据,通过人工查

看的方式,对数据本身做一个比较直观的了解,并且初步发现一些问题,为之后

的数据处理做准备。

•

格式内容错误数据清洗

时间、日期、数值、半全角等显示格式不一致:直接将数据转换为一类格式即

可,该问 题一般出现在多个数据源整合的情况下。

内容中有不该存在的字符:最典型的就是在头部、中间、尾部的空格等问题,这

种情况下,需要以半自动校验加半人工方式来找出问题,并去除不需要的字符。

内容与该字段应有的内容不符:比如姓名写成了性别、身份证号写成手机号等问

题。

•

去除不需要的数据

一般情况下,我们会尽可能多的收集数据,但是不是所有的字段数据都是可以应

用到模型构建过程的,也不是说将所有的字段属性都放到构建模型中,最终模型

的效果就一定会好,实际上来讲,字段属性越多,模型的构建就会越慢,所以有

时候可以考虑将不要的字段进行删除操作。在进行该过程的时候,要注意备份原

始数据。

•

关联性验证

如果数据有多个来源,那么有必要进行关联性验证,该过程常应用到多数据源合

并的过程中,通过验证数据之间的关联性来选择比较正确的特征属性,比如:汽

车的线下购买信息和电话客服问卷信息,两者之间可以通过姓名和手机号进行关

联操作,匹配两者之间的车辆信息是否是同一辆,如果不是,那么就需要进行数

•

数据清洗

分区 计算机专业课 的第

2

页

联操作,匹配两者之间的车辆信息是否是同一辆,如果不是,那么就需要进行数

据调整。

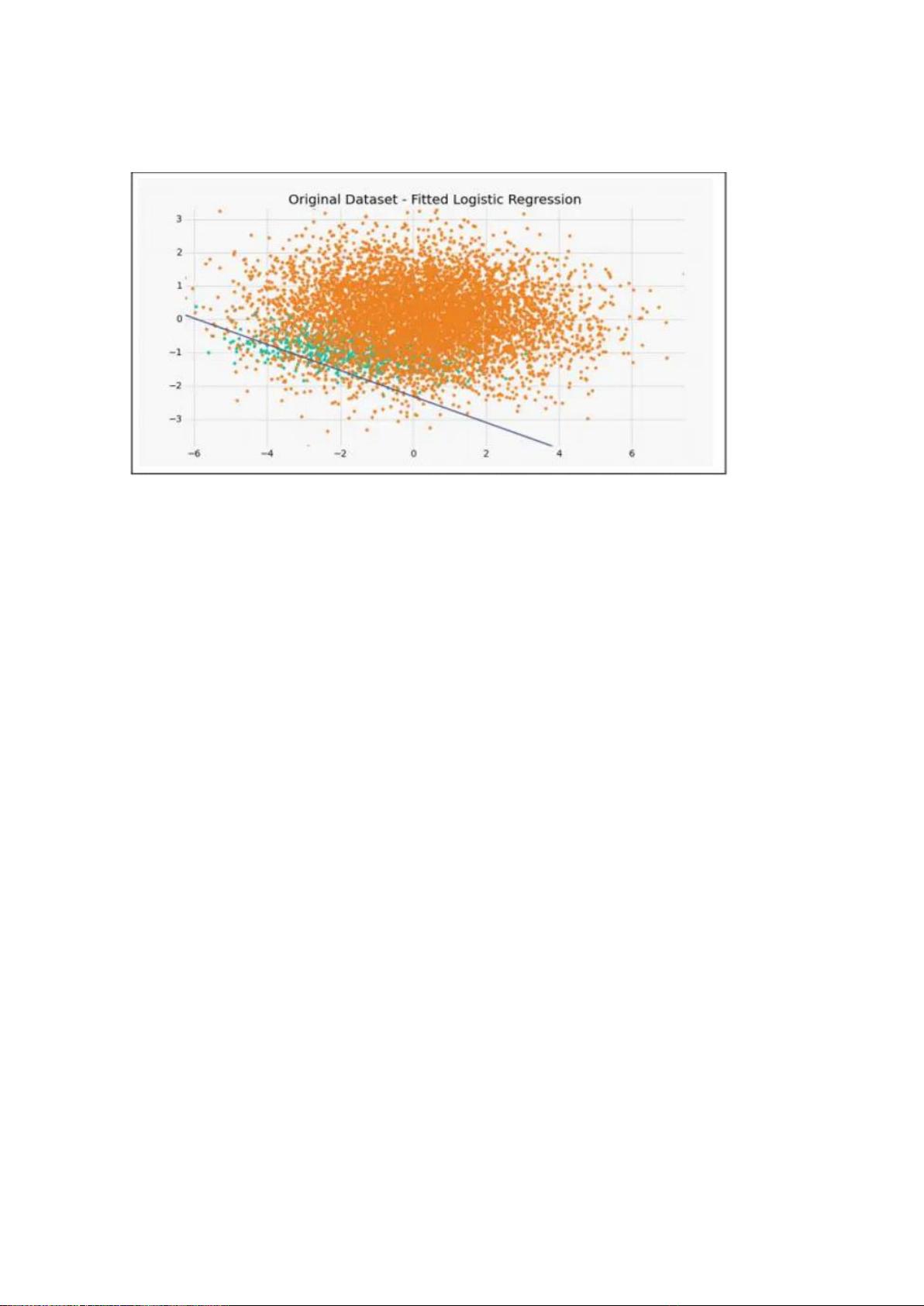

设置损失函数的权重,使得少数类别数据判断错误的损失大于多数类别数据判断

错误的损失,即当我们的少数类别数据预测错误的时候,会产生一个比较大的损

失值,从而导致模型参数往让少数类别数据预测准确的方向偏。可以通过

scikitlearn中的class_weight参数来设置权重。

•

下采样/欠采样(under sampling):从多数类中随机抽取样本从而减少多数类别

样本数据,使数据达到平衡的方式。

•

采用数据合成的方式生成更多的样本,该方式在小数据集场景下具有比较成功的

案例。常见算法是SMOTE算法,该算法利用小众样本在特征空间的相似性来生

成新样本。

•

数据不平衡

特征转换

文本数据转换为数值型数据

•

缺省值填充

•

定性特征属性哑编码

•

定量特征属性二值化

•

特征标准化与归一化

•

特征转换主要指将原始数据中的字段数据进行转换操作,从而得到适合进行算法模型

构建的输入数据(数值型数据),在这个过程中主要包括但不限于以下几种数据的处

理:

文本特征属性转换

机器学习的模型算法均要求输入的数据必须是数值型的,所以对于文本类型的特征属

性,需要进行文本数据转换,也就是需要将文本数据转换为数值型数据。常用方式如

下:

词袋法(BOW/TF)

TF-IDF(Term frequency-inverse document frequency)

HashTF

Word2Vec(主要用于单词的相似性考量)

分区 计算机专业课 的第

3

页

剩余10页未读,继续阅读

资源评论

Crazyanti

- 粉丝: 19

- 资源: 303

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功