没有合适的资源?快使用搜索试试~ 我知道了~

chap11-概率图模型1

需积分: 0 0 下载量 165 浏览量

2022-08-03

12:26:32

上传

评论

收藏 678KB PDF 举报

温馨提示

试读

33页

第 11 章概率图模型概率论只不过是把常识归纳为计算问题。— 皮诶尔·西蒙·拉普拉斯概率图模型(Probabilistic Graphical Model,PG

资源详情

资源评论

资源推荐

第 11 章 概率图模型

概率论只不过是把常识归纳为计算问题。

— 皮诶尔·西蒙·拉普拉斯

概率图模型(Probabilistic Graphical Model,PGM),简称图模型(Graphical

Model,GM),是指一种用图结构来描述多元随机变量之间条件独立关系的概

率模型,从而给研究高维空间中的概率模型带来了很大的便捷性。

对于一个 K 维随机向量 X = [X

1

, X

2

, ··· , X

K

]

T

,其联合概率为高维空间

中的分布,一般难以直接建模。假设每个变量为离散变量并有 m 个取值,在不

作任何独立假设条件下,则需要 m

K

− 1 个参数才能表示其概率分布。当 m =

2, K = 100 时,参数量约为 10

30

,远远超出了目前计算机的存储能力。

一种有效减少参数量的方法是独立性假设。K 维随机向量的联合概率分解

为 K 个条件概率的乘积,

p(x) , P (X = x) (11.1)

= p(x

1

)p(x

2

|x

1

) ···p(x

K

|x

1

, ··· , x

K−1

), (11.2)

=

K

k=1

p(x

k

|x

1

, ··· , x

k−1

), (11.3)

其中 x

k

表示变量 X

k

的取值。如果某些变量之间存在条件独立,其参数量就可

以大幅减少。

假设有四个二值变量X

1

, X

2

, X

3

, X

4

,在不知道这几个变量依赖关系的情况

下,可以用一个联合概率表来记录每一种取值的概率 p(x

1:4

),共需要 2

4

−1 = 15

个参数。假设在已知 X

1

时,X

2

和 X

3

独立,即有

p(x

2

|x

1

, x

3

) = p(x

2

|x

1

), (11.4)

p(x

3

|x

1

, x

2

) = p(x

3

|x

1

). (11.5)

258 2019 年 4 月 4 日 第 11 章 概率图模型

在已知 X

2

和 X

3

时,X

4

也和 X

1

独立,即有

p(x

4

|x

1

, x

2

, x

3

) = p(x

4

|x

2

, x

3

), (11.6)

那么其联合概率 p(x) 可以分解为

p(x) = p(x

1

)p(x

2

|x

1

)p(x

3

|x

1

, x

2

)p(x

4

|x

1

, x

2

, x

3

), (11.7)

= p(x

1

)p(x

2

|x

1

)p(x

3

|x

1

)p(x

4

|x

2

, x

3

), (11.8)

是 4 个局部条件概率的乘积。如果分别用 4 个表格来记录这 4 个条件概率的话,

只需要 1 + 2 + 2 + 4 = 9 个独立参数。

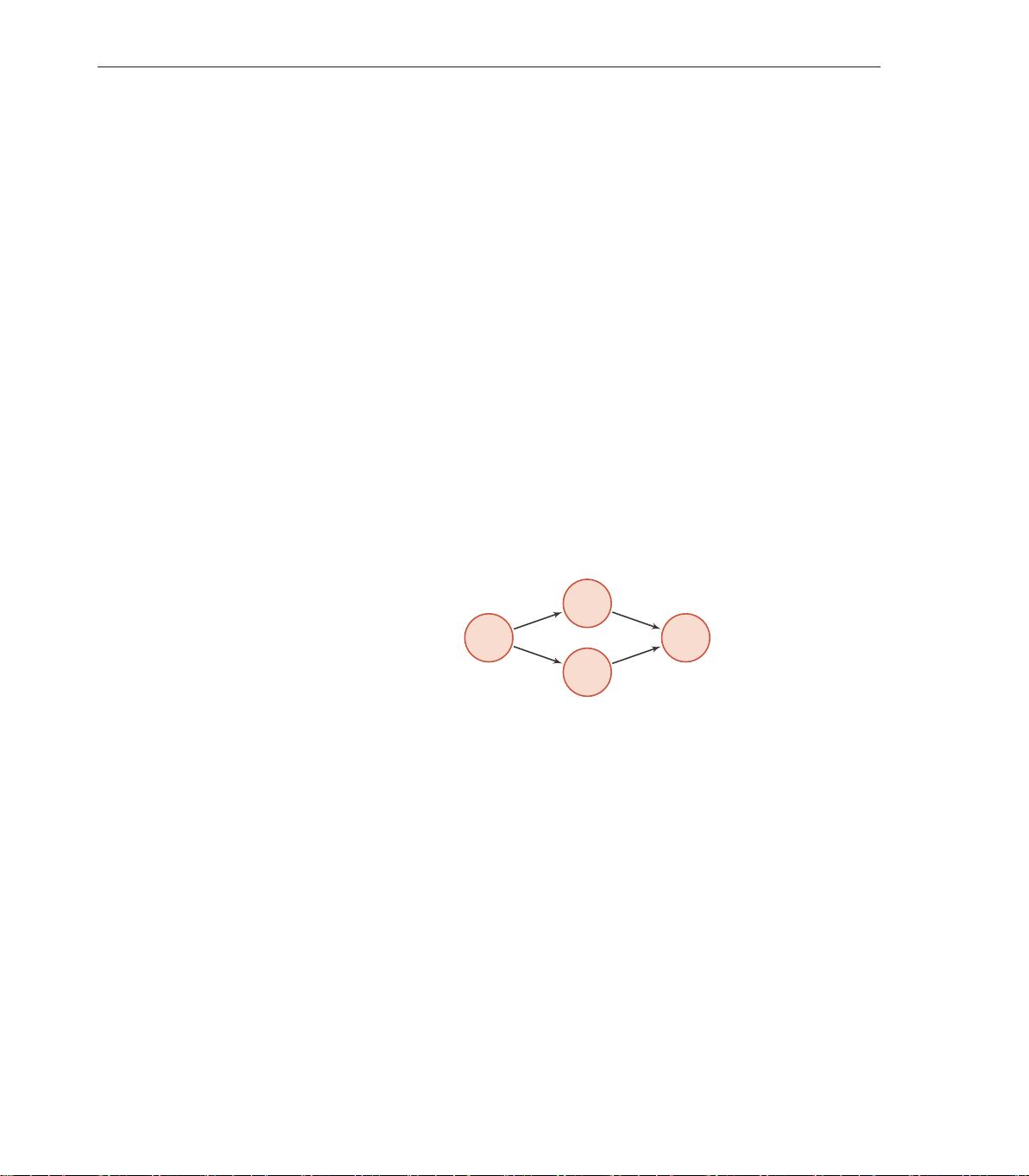

当概率模型中的变量数量比较多时,其条件依赖关系也比较复杂。我们可

以使用图结构的方式将概率模型可视化,以一种直观、简单的方式描述随机变

量之间的条件独立性的性质,并可以将一个复杂的联合概率模型分解为一些简

单条件概率模型的组合。图11.1给出了上述例子中 4 个变量之间的条件独立性的

图形化描述。图中每个节点表示一个变量,每条连边变量之间的依赖关系。对

于一个非全连接的图,都存在一个或多个条件独立性假设,可以根据条件独立

性将联合概率分布进行分解,表示为一组局部条件概率分布的乘积。

X

1

X

2

X

3

X

4

图 11.1 变量 X

1

, X

2

, X

3

, X

4

之间条件独立性的图形化表示

图模型的基本问题 图模型有三个基本问题:

1. 表示问题:对于一个概率模型,如何通过图结构来描述变量之间的依赖

关系。

2. 推断问题:在已知部分变量时,计算其它变量的后验概率分布。

3. 学习问题:图模型的学习包括图结构的学习和参数的学习。在本章我们只

关注在给定图结构时的参数学习,即参数估计问题。

图模型与机器学习 很多机器学习模型都可以归结为概率模型,即建模输入和输

出之间的条件概率分布。因此,图模型提供了一种新的角度来解释机器学习模

型,并且这种角度有很多优点,比如了解不同机器学习模型之间的联系,方便设

计新模型等。在机器学习中,图模型越来越多地用来设计和分析各种学习算法。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

11.1 模型表示 2019 年 4 月 4 日 259

11.1 模型表示

图由一组节点和节点之间的边组成。在概率图模型中,每个节点都表示一

个随机变量(或一组随机变量),边表示这些随机变量之间的概率依赖关系。

常见的概率图模型可以分为两类:有向图模型和无向图模型。有向图模型

的图结构为有向非循环图,如果两个节点之间有连边,表示对于的两个变量为

因果关系。无向图模型使用无向图来描述变量之间的关系。每条边代表两个变

量之间有概率依赖关系,但是并不一定是因果关系。

图11.2给出了两个代表性图模型(有向图和无向图)的示例,分别表示了

四个变量 {X

1

, X

2

, X

3

, X

4

}之间的依赖关系

X

1

X

2

X

3

X

4

(a) 有向图:贝叶斯网络

X

1

X

2

X

3

X

4

(b) 无向图:马尔可夫随机场

图 11.2 有向图和无向图示例。带阴影的节点表示可观测到的变量,不带阴影的

节点表示隐变量,连边表示两变量间的条件依赖关系

11.1.1 有向图模型

有向图模型(Directed Graphical model),也称为贝叶斯网络(Bayesian

Network),或信念网络(Belief Network,BN),是指用有向图来表示概率分

布的图模型。假设一个有向图 G(V, E),节点集合 V = {X

1

, X

2

, ··· , X

K

}表示

K 个随机变量,节点 k 对应随机变量 X

k

。E 为边的集合,每条边表示两个变量

之间的因果关系。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

260 2019 年 4 月 4 日 第 11 章 概率图模型

定义 11.1 – 贝叶斯网络: 对于一个随机向量 X = [X

1

, X

2

, ··· , X

K

]

T

和一个有 K 个节点的有向非循环图 G,G 中的每个节点都对应一个随

机变量,可以是可观测的变量,隐变量或是未知参数。G 中的每个连

接 e

ij

表示两个随机变量 X

i

和 X

j

之间具有非独立的因果关系。X

π

k

表

示变量 X

k

的所有父节点变量集合,每个随机变量的局部条件概率分

布(local conditional probability distribution)为 P (X

k

|X

π

k

)。

如果 X 的联合概率分布可以分解为每个随机变量 X

k

的局部条件

概率的连乘形式,即

p(x) =

K

k=1

p(x

k

|x

π

k

), (11.9)

那么 (G, X) 构成了一个贝叶斯网络。

在本章后文中,“节点”与

“随机变量”、“变量”的概念

会经常混用。每个节点对应

一个随机变量。

条件独立性 在贝叶斯网络中,如果两个节点是直接连接的,它们肯定是非条件

独立的,是直接因果关系。父节点是“因”,子节点是“果”。

如果两个节点不是直接连接的,但是它们之间有一条经过其它节点的路径

来连接,那么这两个节点之间的条件独立性就比较复杂。以三个节点的贝叶斯

网络为例,给定三个节点 X

1

, X

2

, X

3

,X

1

和 X

3

是不直接连接的,可以通过节

点 X

2

连接。这三个节点之间可以有四种连接关系,如图11.3所示。

X

1

X

2

X

3

(a)

X

1

X

2

X

3

(b)

X

2

X

1

X

3

(c)

X

2

X

1

X

3

(d)

图 11.3 三个变量的依赖关系示例。在 (a)(b) 中,X

1

⊥⊥ X

3

|∅,但 X

1

⊥⊥ X

3

|X

2

;

在 (c) 中,X

1

⊥⊥ X

3

|∅,但 X

1

⊥⊥ X

3

|X

2

;在 (d) 中,X

1

⊥⊥ X

3

|∅,但 X

1

⊥⊥ X

3

|X

2

间接因果关系(图11.3a) 当X

2

已知时,X

1

和X

3

为条件独立,即X

1

⊥⊥ X

3

|X

2

;

间接果因关系(图11.3b) 当X

2

已知时,X

1

和X

3

为条件独立,即X

1

⊥⊥ X

3

|X

2

;

共因关系(图11.3c) 当 X

2

未知时,X

1

和 X

3

是不独立的;当 X

2

已知时,X

1

和 X

3

条件独立,即 X

1

⊥⊥ X

3

|X

2

;

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

11.1 模型表示 2019 年 4 月 4 日 261

共果关系(图11.3d) 当 X

2

未知时,X

1

和 X

3

是独立的;当 X

2

已知时,X

1

和

X

3

不独立,即 X

1

⊥⊥ X

3

|X

2

。

局部马尔可夫性质 对一个更一般的贝叶斯网络,其局部马尔可夫性质为:每个

随机变量在给定父节点的情况下,条件独立于它的非后代节点。

从公式 (11.3) 和 (11.9) 可得

到。参见习题11-3。

X

k

⊥⊥ Z|X

π

k

, (11.10)

其中 Z 为 X

k

的非后代变量。

11.1.2 常见的有向图模型

很多经典的机器学习模型可以使用有向图模型来描述,比如朴素贝叶斯分

类器、隐马尔可夫模型、深度信念网络等。

深度信念网络参见第??节。

11.1.2.1 sigmoid 信念网络

为了减少模型参数,可以使用参数化模型来建模有向图模型中的条件概率

分布。一种简单的参数化模型为 sigmoid 信念网络 [Neal, 1992]。sigmoid 信念网

更复杂的深度信念网络,参

见第??节。

络(sigmoid belief network,SBN)中的变量取值为 {0, 1}。对于变量 X

k

和它

的父节点集合 π

k

,其条件概率分布表示为

P (X

k

= 1|x

π

k

, θ) = σ(θ

0

+

x

i

∈x

π

k

θ

i

x

i

), (11.11)

其中 σ(·) 是 Logistic sigmoid 函数,θ

i

是可学习的参数。假设变量 X

k

的父节点

数量为 M ,如果使用表格来记录条件概率需要 2

M

个参数,如果使用参数化模

型只需要 M + 1 个参数。如果对不同的变量的条件概率都共享使用一个参数化

模型,其参数数量又可以大幅减少。

值得一提的是,Sigmoid 信念网络与 Logistic 回归模型都采用 Logistic 函数

来计算条件概率。如果假设 Sigmoid 信念网络中只有一个叶子节点,其所有的父

节点之间没有连接,且取值为实数,那么 sigmoid信念网络的网络结构和Logistic

回归模型类似,如图11.4所示。但是,这两个模型区别在于 Logistic 回归模型中

的 x 作为一种确定性的参数,而非变量。因此,Logistic 回归模型只建模条件概

Logistic 回归模型也经常解

释一种条件无向图模型。

率 p(y|x),是一种判别模型;而 sigmoid 信念网络建模 p(x, y),是一种生成模型。

11.1.2.2 朴素贝叶斯分类器

朴素贝叶斯分类器(Naive Bayes Classifier,NB)是一类简单的概率分类

器,在强(朴素)独立性假设的条件下运用贝叶斯公式来计算每个类别的后验

概率。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

剩余32页未读,继续阅读

普通网友

- 粉丝: 16

- 资源: 319

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0