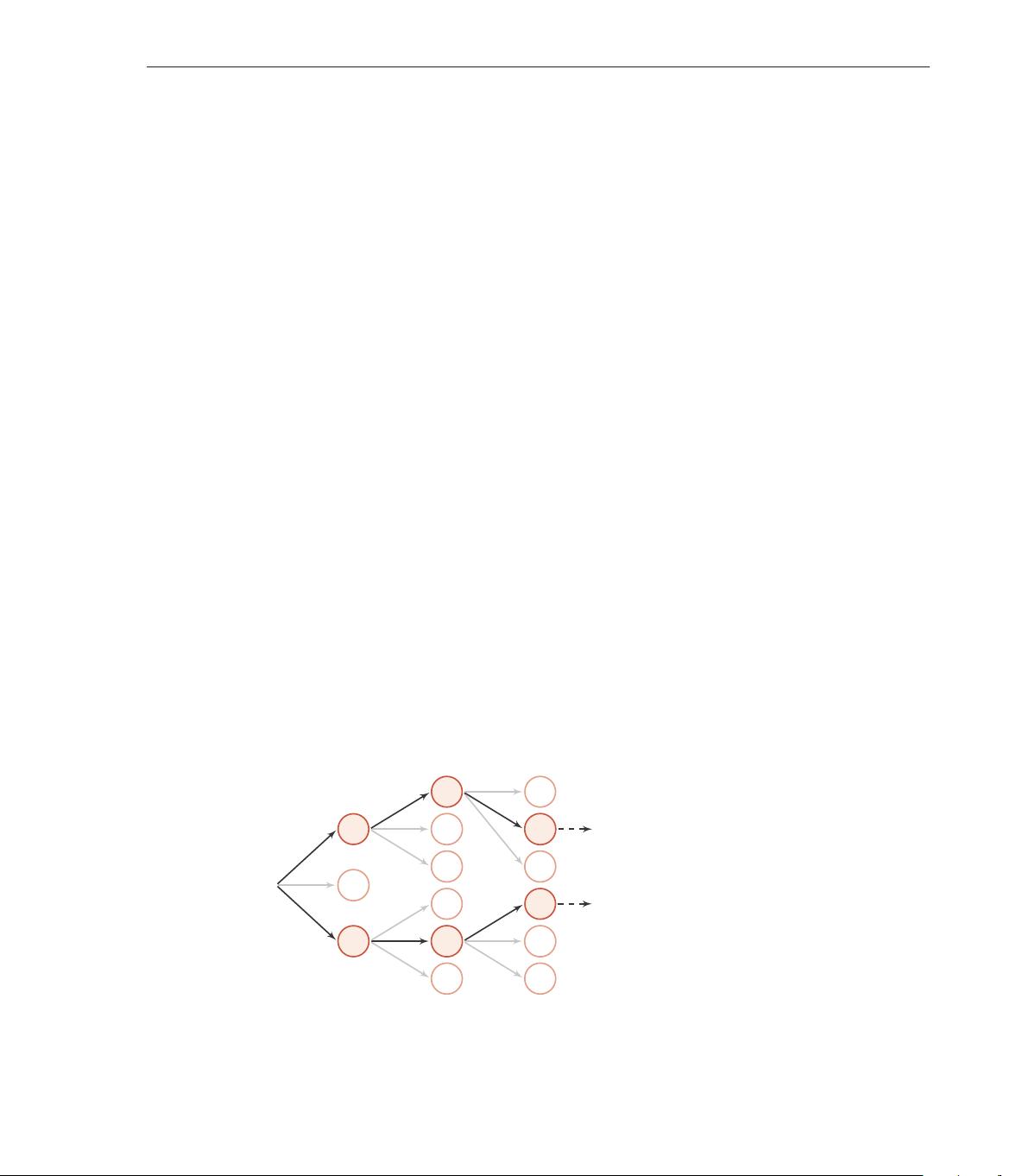

【序列生成模型】序列生成模型主要用于处理如声音、语言、视频等序列形式的数据。它们试图模拟和理解自然语言中的复杂语法和语义规则,通过概率分布来表达这些规则。在自然语言处理中,一个句子可以被视为词的有序序列,而语言规则则可以看作是这些词的联合概率分布。 【自回归生成模型 (Autoregressive Generative Model)】自回归模型是一种常见的序列概率模型,它利用序列中先前元素的信息来预测当前元素的概率。序列的概率可以通过条件概率的乘积表示,即每个单词出现的概率基于前面所有单词的出现情况。自回归模型在每一步都依赖于之前生成的输出,以此方式逐步生成序列,直到达到预设的终止条件,如遇到特殊符号“<eos>”。 【学习问题与生成问题】序列模型面临两个主要任务:学习问题,即从给定的序列数据中估计出概率分布;生成问题,即使用学到的模型生成新的、符合概率分布的序列样本。 【条件概率与乘法规则】序列的概率可以通过概率的乘法规则计算,即每个单词xt在给定前t-1个单词x1:(t-1)的条件下出现的概率的乘积。这种分解使得序列概率密度估计转化为条件概率p(xt|x1:(t-1))的估计问题。 【对数似然函数与参数估计】在训练序列模型时,通常使用最大似然估计最大化数据集的整体对数似然函数,以便找到最佳模型参数θ。这涉及求解条件概率的参数,使得整个序列的对数概率总和最大。 【N元统计模型】N元模型是序列概率模型的一种简单形式,它基于历史n个词来预测下一个词。例如,二元模型考虑当前词和前一个词,三元模型则考虑当前词、前一个词和前前一个词。N元模型通常假设条件概率服从多项式分布,并可以通过统计方法进行估计。 【深度序列模型】随着深度学习的发展,使用神经网络的深度序列模型变得越来越流行。这些模型能够捕获更复杂的序列依赖关系,例如循环神经网络(RNN)、长短时记忆网络(LSTM)和门控循环单元(GRU),以及后来的Transformer模型等。 【拉格朗日乘子与拉格朗日函数】在优化问题中,拉格朗日乘子λ用于处理约束条件,而拉格朗日函数Λ(θ, λ)结合了目标函数和约束条件,使得在满足约束的情况下寻找最优解成为可能。在本章节的上下文中,可能是用于约束模型的某些性质,如正则化项,以防止过拟合。 序列生成模型是深度学习和自然语言处理中的核心概念,它们通过学习和理解数据中的模式来生成新的序列。这些模型的构建和训练涉及概率论、统计学和优化理论,同时利用现代深度学习技术来提高性能和表达能力。

剩余29页未读,继续阅读

- 粉丝: 28

- 资源: 307

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

评论0