chap-深度生成模型1

需积分: 0 104 浏览量

更新于2022-08-04

收藏 866KB PDF 举报

深度生成模型概率生成模型概率统计和机器学习中的一类重要模型指一系列用于随机生成可观测数据的模型。

概率生成模型是根据一些可观测的样本来学习一个参数化的模型pθ(x)来近似未知分布Pr(X),并可以用这个模型来生成一些样本,使得“生成”的样本和“真实”的样本尽可能地相似。生成模型的应用十分广泛,可以用来不同的数据进行建模,比如图像、文本、声音等。

深度生成模型就是利用深层神经网络可以近似任意函数的能力来建模一个复杂的分布 pr(x)。深度生成模型可以用来图像生成、文本生成、声音生成等。

概率生成模型一般具有两个基本功能:密度估计和生成样本。密度估计是根据数据集来估计其概率密度函数 pθ(x)。生成样本就是给定一个概率密度函数为 pmoel(x) 的分布,生成一些服从这个分布的样本。

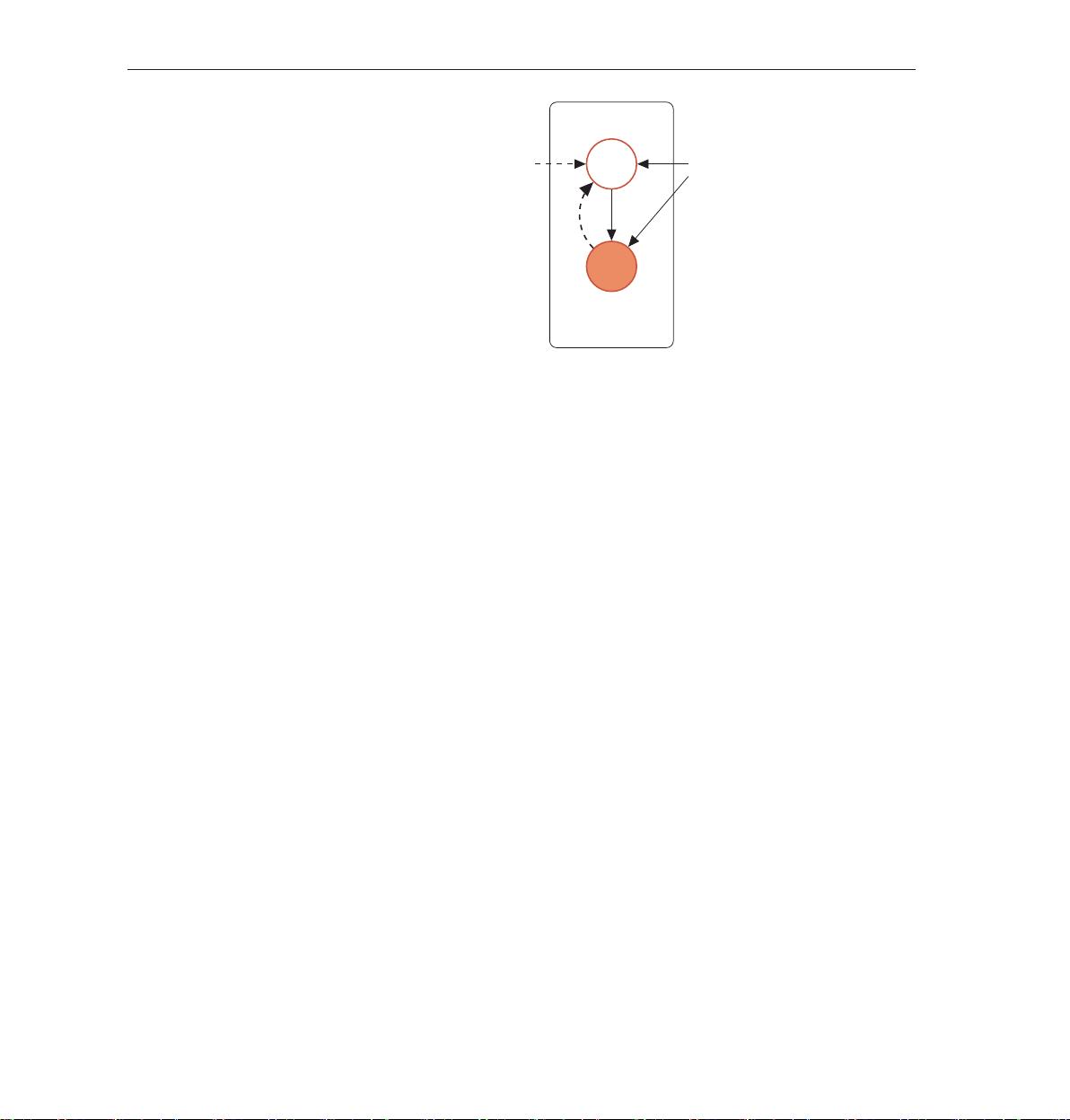

变分自动编码器是一种深度生成模型,它可以用来学习一个潜在的分布p(z)和一个生成模型p(x|z),以便生成新的样本。变分自动编码器的优点是可以学习到一个连续的潜在空间,从而生成更加多样化的样本。

对抗生成式网络是一种深度生成模型,它可以用来学习一个生成模型p(x)和一个判别模型p(y|x),以便生成新的样本。对抗生成式网络的优点是可以生成更加逼真的样本,并且可以学习到一个判别模型,从而提高生成模型的性能。

概率生成模型可以应用于监督学习和无监督学习。在监督学习中,概率生成模型可以用来建模输出标签的条件概率密度函数 p(y|x)。在无监督学习中,概率生成模型可以用来学习一个概率密度函数 pθ(x),以便生成新的样本。

判别模型和生成模型是两种不同的监督学习模型。判别模型直接建模条件概率密度函数p(y|x),并不建模其联合概率密度函数 p(x, y)。生成模型可以用来学习一个概率密度函数 pθ(x),以便生成新的样本,并且可以用来学习一个判别模型。

在机器学习中,密度估计是一种非常典型的无监督学习问题。如果要建模密度估计,可以使用EM算法来进行密度估计。EM 算法可以用来学习一个概率密度函数 pθ(x),以便生成新的样本。

概率生成模型是一种非常重要的机器学习模型,它可以用来学习一个概率密度函数 pθ(x),以便生成新的样本,并且可以应用于监督学习和无监督学习。

曹多鱼

- 粉丝: 29

- 资源: 314

最新资源

- 【微信小程序源码】京东首页demo

- 《大闹天宫》动画美术风格中的中国传统元素分析_张星辉.caj

- VCU Simulink需求与功能开发文档:集成档位控制、ON Start启动、上下电管理、扭矩调控、能量优化与滑行回收的全方位控制系统需求说明,VCU Simulink需求与功能开发文档:集成档位控

- 基于COMSOL Multiphysics的三维岩石酸化过程模拟:探讨酸液在碳酸盐岩储层中的流动、传质与反应机制,利用COMSOL Multiphysics模拟三维岩石酸化过程:探讨酸液在碳酸盐岩储层

- 台达DVP PLC与西门子V20变频器通讯程序:可靠控制,自动化调整,接线与设置指南,台达DVP PLC与西门子V20变频器通讯程序:可靠控制,自动化调整,接线与设置指南,台达DVP PLC与3台西门

- 基于Python的Django-vue基于大数据的学习资源推送系统实现源码-说明文档-演示视频.zip

- PHP API 客户端,可让您与 deepseek API 进行交互 deepseek-php-client-2.0.3

- 【微信小程序源码】和茶网

- 自然启发MPPT优化技术,霜冰优化算法RIME在MPPT中对光伏局部遮阴情况的性能提升研究,霜冰算法RIME优化mppt,光伏mppt , 局部遮阴光伏mppt 2023年,H Su等人受到自然界霜冰

- 使用 PHP Deepseek 实现问答 ask-deepseek

- COMSOL Multiphysics中的comsol支架静态分析:基本原理、操作与结果分析,COMSOL Multiphysics中的comsol支架静态分析:基本原理、操作与结果分析,comsol

- 基于Python的Django-vue基于大数据的银行信用卡用户的数仓系统源码-说明文档-演示视频.zip

- 翱捷功能机常见空间问题的解决

- 西门子博途1500双驱同步编程实例分享,结构化编程、伺服同步运行、多用户权限登录,开发者必备的学习参考(版本v16),西门子博途V16全新双驱同步与三轴码垛程序:结构化编程框架,多用户权限控制,高值学

- DotSpatial库学习

- Delphi 12.5 控件之delphi实现腾讯签名算算法源代码.rar