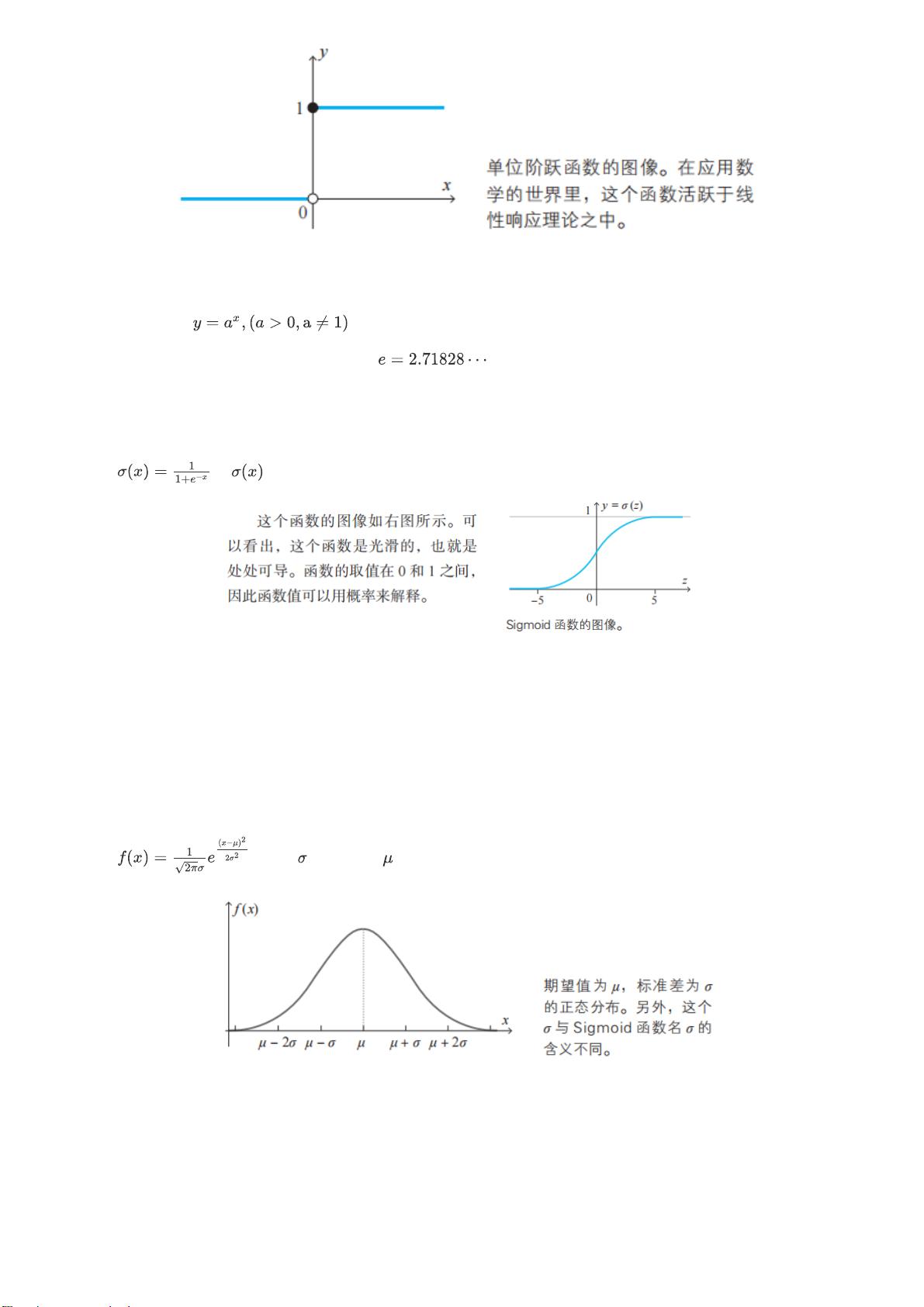

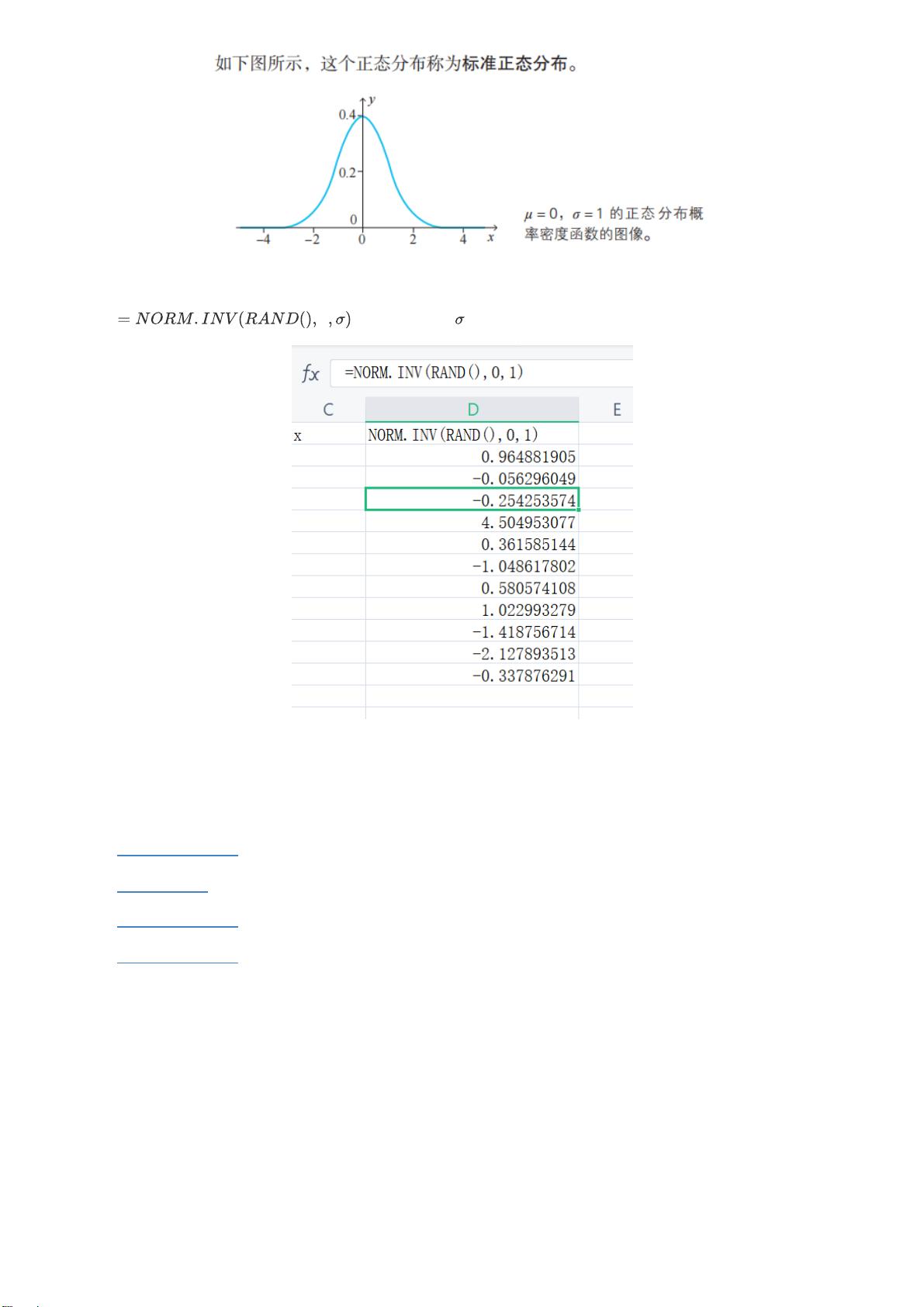

在人工智能领域,数学是不可或缺的基础,它为理解和构建复杂的算法提供了必要的工具。本文将深入探讨与人工智能相关的数学知识,包括函数、数列、求和符号、导数、偏导数、链式法则、近似公式、梯度下降法以及概率论。 一、函数 函数是数学中的基本概念,用于描述变量之间的关系。在人工智能中,我们经常遇到一次函数和二次函数。一次函数通常用于简单的线性关系,如神经网络中神经元的加权输入。二次函数在机器学习的代价函数中广泛使用,如损失函数的平方误差总和,它的性质决定了存在全局最小值,这是优化算法的目标。 二、数列 数列在神经网络的前向传播和反向传播过程中扮演着重要角色。递推公式用于描述数列的动态变化,这对于理解和实现神经网络中的计算至关重要。等差数列和等比数列的通项公式和递推公式是基础,而神经网络中每个神经元的计算过程可以看作是数列的连续应用。 三、∑符号的理解和使用 Σ(求和符号)在统计和计算中表示对序列的累加。理解其性质,如常数倍的求和与求和的常数倍,有助于处理神经网络中的批量数据或计算损失函数的总和。 四、向量和矩阵 向量和矩阵是线性代数的核心,用于表示和操作数据。向量的大小(范数)和内积是衡量向量间关系的关键。矩阵则用于表示多维数据和线性变换,如权重矩阵在神经网络中的应用。矩阵的运算如乘法、转置和逆矩阵在解决线性方程组和优化问题时非常重要。 五、导数与偏导数 导数是微积分的基础,描述了函数的局部变化率。在神经网络中,导数用于计算梯度,是反向传播算法的关键。偏导数处理多变量函数,帮助我们找到函数的局部最优解。 六、链式法则 复合函数的链式法则在计算神经网络中多层结构的梯度时尤为关键。它允许我们逐层反向传播误差,从而更新权重。 七、近似公式 基于导数的近似公式,如梯度下降法的基础,用于寻找函数的局部最小值。在机器学习中,这用于优化模型的参数。 八、梯度下降法 梯度下降法是一种优化算法,通过沿着梯度的负方向迭代更新参数,以最小化损失函数。理解梯度的含义和公式,以及如何调整学习率(η),对于训练神经网络至关重要。 九、概率论 概率论为处理不确定性提供了理论框架。在机器学习中,我们用概率来描述模型的不确定性,理解随机变量、概率分布、条件概率和贝叶斯公式对于建立概率模型非常关键。 人工智能的数学基础涵盖了从基本的函数和数列到高级的微积分和概率论。这些知识不仅为理解和实现AI算法提供了基础,也为解决实际问题提供了强大工具。深入掌握这些概念,对于在AI领域进行研究和开发至关重要。

剩余30页未读,继续阅读

- 粉丝: 29

- 资源: 332

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- YOLOv8完整网络结构图详细visio

- LCD1602电子时钟程序

- 西北太平洋热带气旋【灾害风险统计】及【登陆我国次数评估】数据集-1980-2023

- 全球干旱数据集【自校准帕尔默干旱程度指数scPDSI】-190101-202312-0.5x0.5

- 基于Python实现的VAE(变分自编码器)训练算法源代码+使用说明

- 全球干旱数据集【标准化降水蒸发指数SPEI-12】-190101-202312-0.5x0.5

- C语言小游戏-五子棋-详细代码可运行

- 全球干旱数据集【标准化降水蒸发指数SPEI-03】-190101-202312-0.5x0.5

- spring boot aop记录修改前后的值demo

- 全球干旱数据集【标准化降水蒸发指数SPEI-01】-190101-202312-0.5x0.5

信息提交成功

信息提交成功

评论0