《网络数据采集》第3章课件201911221

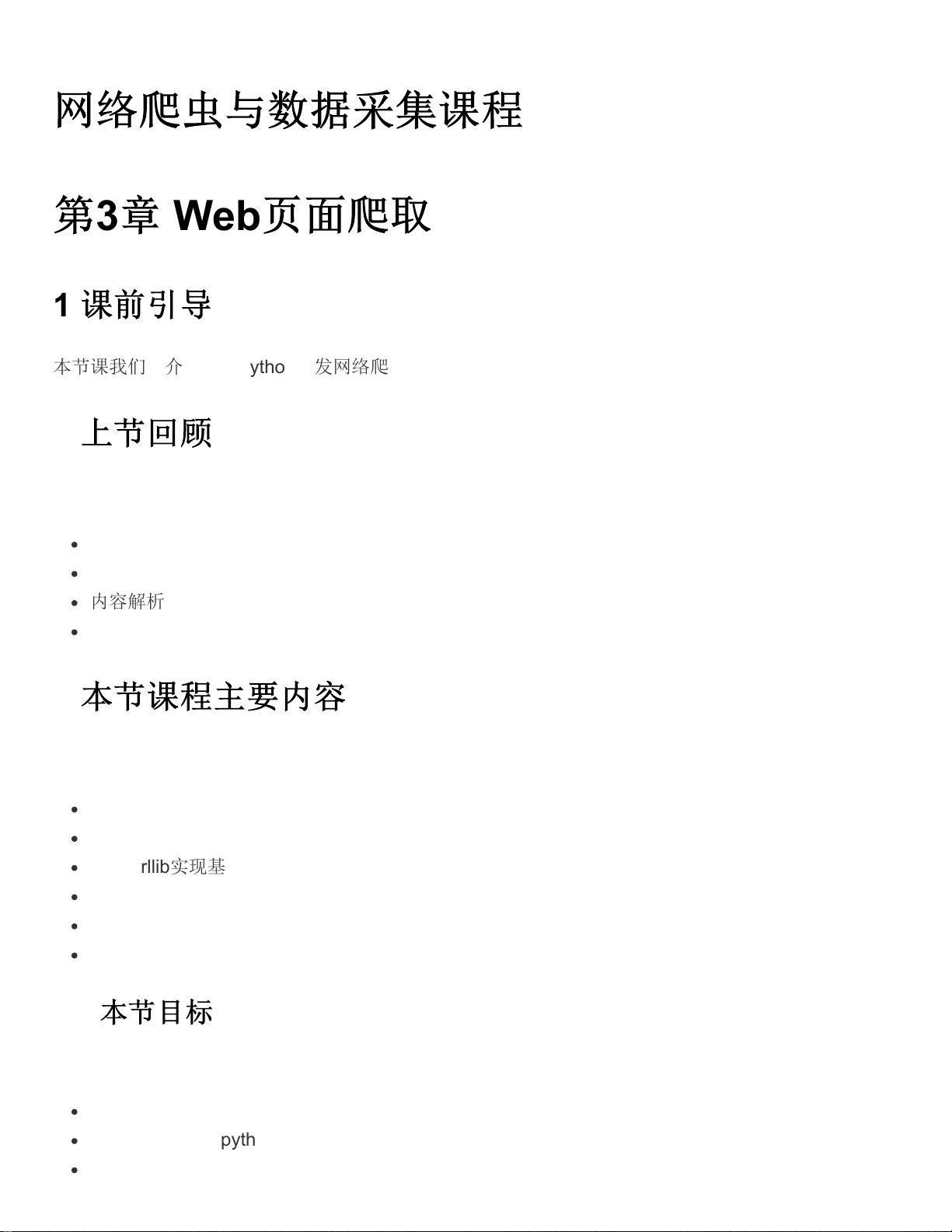

【网络数据采集】是关于如何使用技术手段获取网络上的信息,特别是Web页面内容的主题。本章节专注于使用Python语言开发网络爬虫,以便高效地抓取和处理网页信息。网络爬虫是一个自动遍历互联网的程序,它能按照一定规则抓取网页并提取所需数据。 在【第3章 Web页面爬取】中,首先介绍了网络爬虫的基本工作流程,分为五个关键步骤: 1. **确定目标URL**:明确要爬取的网页地址,并将其作为初始的爬取种子。 2. **发送HTTP请求**:模拟浏览器行为,向服务器发送请求以获取网页内容。 3. **解析HTML文档**:接收服务器返回的HTML响应,解析其中的目标数据和新的URL。 4. **存储数据和资源**:将提取的数据按需格式化存储,同时下载如图片、视频等其他资源。 5. **继续爬取**:将新发现的URL加入待爬取队列,重复以上步骤直至队列为空。 接着,课程讲解了使用Python的两个库——Urllib和Requests,来实现网络爬虫的功能: - **Urllib基础**:Urllib是Python标准库中的一个模块集合,用于处理URL相关的各种操作。学习如何使用Urllib构建简单的爬虫程序,涉及打开URL、读取网页内容等基本功能。 - **Requests优化**:Requests是一个更高级且易于使用的库,它可以更好地处理HTTP请求,包括设置HTTP头、处理cookies、管理会话等,从而提升爬虫程序的效率和稳定性。 在实践中,课程可能会通过案例分析和模块练习来帮助学生巩固这些概念。例如,创建一个简单的Python脚本来抓取并解析一个网页,提取出特定的信息,如文章标题、链接等。 安装和配置开发环境也是课程的一部分。推荐使用Anaconda,因为它是一个包含Python及许多科学计算库的集成环境。安装Anaconda后,会利用其内置的Jupyter Notebook作为交互式开发工具,便于编写和运行Python代码,同时也方便数据可视化和文档记录。 通过本章的学习,学生应能理解网络爬虫的工作原理,掌握使用Python Urllib和Requests库进行网页爬取的基本技巧,以及如何在实际环境中设置和使用这些工具。这为后续深入的数据分析和挖掘奠定了基础。

剩余37页未读,继续阅读

- 粉丝: 24

- 资源: 303

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜 信息提交成功

信息提交成功

评论0