斯坦福机器学习讲义(全)Stanford-Machine-Leaning

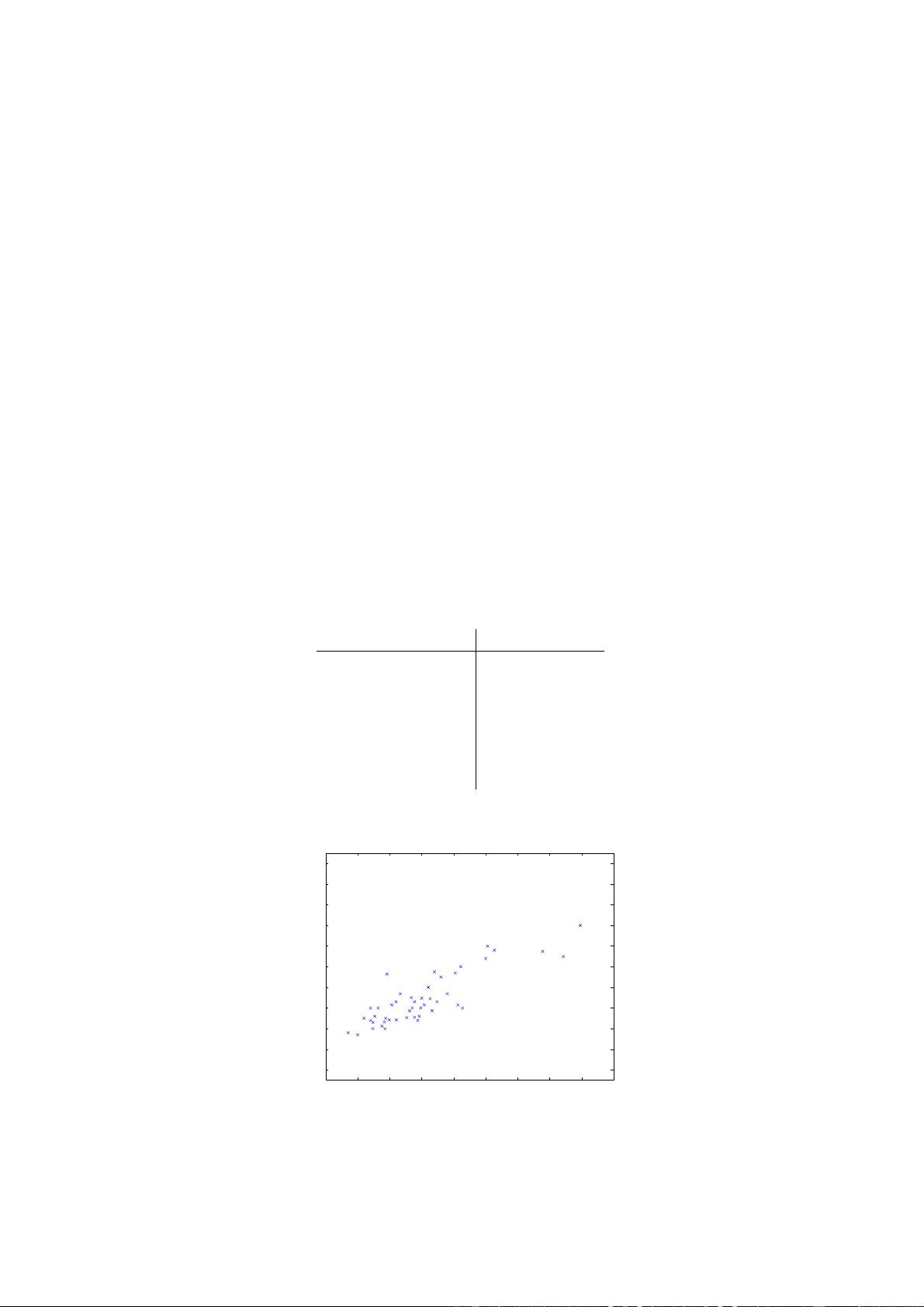

在提供的文件信息中,我们看到了一个关于斯坦福机器学习课程讲义的概述,其中详细描述了监督学习的一些基础概念,以及线性回归的入门知识。下面我们将详细梳理这些知识点。 讲义提到了监督学习问题的几个例子,通过具体的房屋面积和价格数据集来展示监督学习的应用场景。在这个例子中,我们试图根据房屋的面积来预测房价。这里引入了监督学习中的一个基本概念——训练集(Training set),它是由一系列的训练样例(Training examples)组成的,每个训练样例是一个输入-输出对,用来表示我们想要预测的变量。 为了形式化描述监督学习问题,文档定义了输入变量(input variables),也称为输入特征(input features),并用x(i)来表示;输出变量(output variable)或目标变量(target variable),用y(i)来表示。一个输入-输出对(x(i), y(i))被称为一个训练样例。整个数据集被称为训练集,记作 {(x(i), y(i)); i=1, ..., m}。其中上标(i)仅仅是一个索引,并不是指数运算。 监督学习的目标是使用训练集来学习一个函数h,该函数能够预测给定输入x时对应的输出y,即寻找函数h:X→Y。在历史上,这个函数被称为假设(hypothesis)。例如,在房屋面积和价格的例子中,我们试图学习一个能根据房屋面积预测价格的函数。 当目标变量是连续的,比如房价,我们称之为回归问题(regression problem)。如果目标变量只能取几个离散值,例如根据房屋面积预测房屋是独立屋还是公寓,这种情况被称为分类问题(classification problem)。 随后,文档转入线性回归(Linear Regression)的讨论。为了使房屋价格的例子更有趣,讲义引入了一个更为丰富的数据集,其中除了房屋面积外,还包括了卧室的数量。在这个例子中,输入特征x是从R2空间中取值的二维向量。例如,x(i)1表示第i个房屋的面积。 线性回归的目标是找到一个函数h,它描述了输入特征和目标变量之间的线性关系。在这里,hθ(x)通常表示为θ0 + θ1x1 + ... + θnxn,其中n是输入特征的数量。学习算法的目标是为参数θ选择合适的值,以便最好地预测训练集中给定的x与y之间的关系。 文档还可能介绍了如何通过最小化代价函数(cost function)来学习最佳的θ值。常用的代价函数是均方误差(Mean Squared Error, MSE),它衡量的是预测值和实际值之间的平方差的平均值。通过优化算法(比如梯度下降,Gradient Descent)来最小化这个代价函数,我们可以求得一组最优的θ值,使得学习得到的假设函数hθ(x)与实际数据尽可能吻合。 总结以上知识点,我们可以归纳出以下几个核心概念: - 监督学习问题的定义,包括输入特征、目标变量、训练集等概念。 - 学习函数h的动机和定义,及其在回归问题和分类问题中的不同表现形式。 - 线性回归作为最基础的回归技术,其目标是通过训练数据学习线性关系,并用最小均方误差等标准寻找最佳拟合模型。 - 代价函数的引入和优化算法的选择,以实现对模型参数的调整和模型的训练过程。 以上内容不仅涵盖了监督学习和线性回归的基本概念,还可能涉及到参数估计、模型评估和优化策略等重要知识点,为深入理解机器学习中的回归分析和模型构建打下坚实的基础。

剩余133页未读,继续阅读

- 粉丝: 45

- 资源: 16

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 3e53940d22a0327bf2fe77db43da8529 (1).png

- 基于小程序的傣族节日及民间故事推广小程序源码(小程序毕业设计完整源码+LW).zip

- 基于Java多语言开发的小程序商城系统设计源码

- 基于Vue框架的排课项目前端设计源码

- 基于的学生宿舍管理系统+node源码(小程序毕业设计完整源码).zip

- 基于指纹识别技术的社区矫正人员管理平台设计源码

- 基于Java的选课管理系统GUI设计源码

- 基于C#开发的医院病人出入院管理系统设计源码

- 基于小程序的农产品商城小程序源码(小程序毕业设计完整源码).zip

- 集冲模、装配和检测于一体的装配机sw19可编辑全套技术资料100%好用.zip

- 基于小程序的“健康早知道”源码(小程序毕业设计完整源码+LW).zip

- 基于HUST2024软件工程项目的儿童学习系统CSS设计源码

- 基于光电心率检测技术的Heartrate设计源码

- 基于小程序的“口腔助手”小程序的设计与实现源码(小程序毕业设计完整源码+LW).zip

- 基于PHP的简单轻巧灵活工作流引擎设计源码

- 流水线风干机sw18可编辑全套技术资料100%好用.zip

信息提交成功

信息提交成功