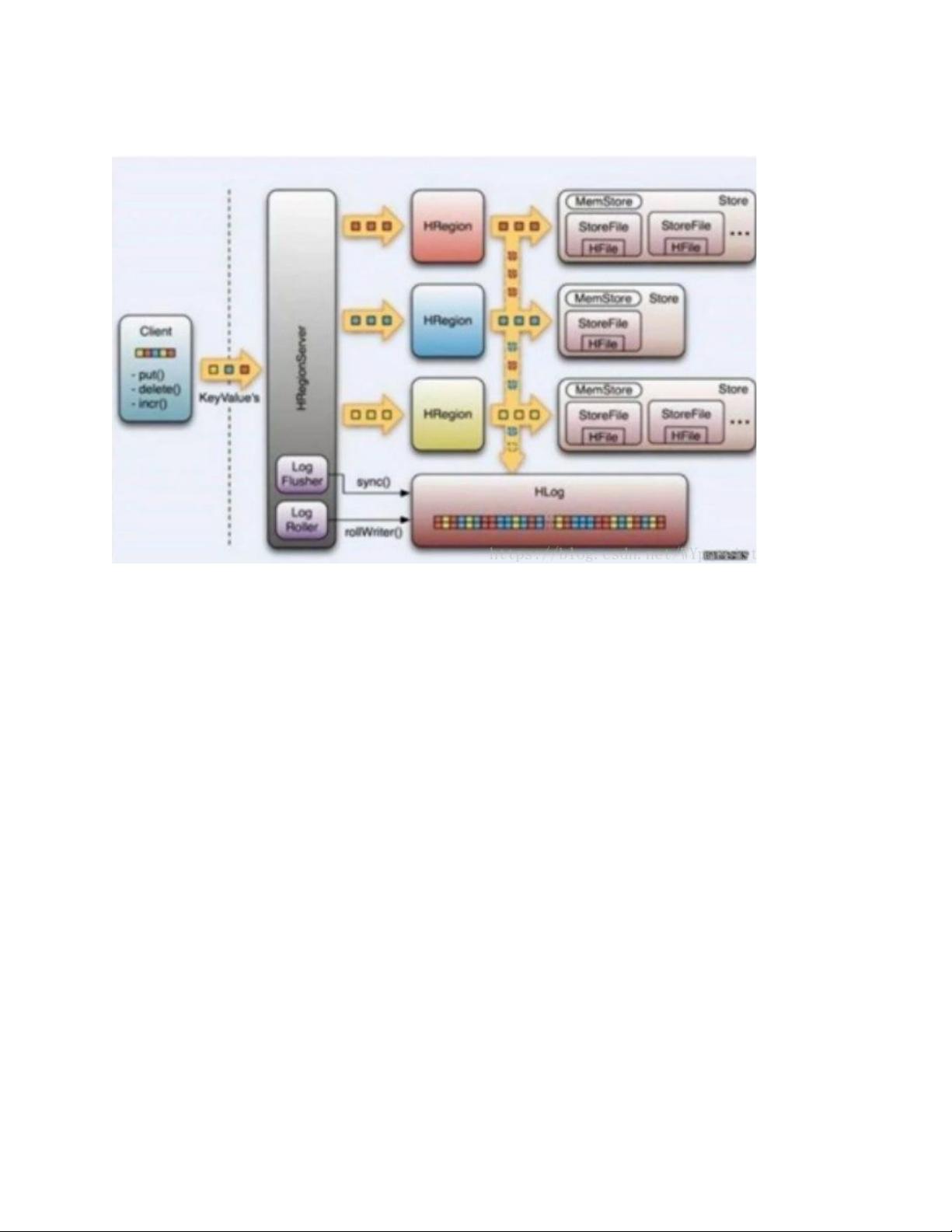

HBase RowKey 设计与协处理器运用 HBase 是一个基于 HDFS 的分布式、面向列的 NoSQL 数据库,具有高性能、可靠性和扩展性等特点。本文将详细介绍 HBase 的 RowKey 设计和协处理器运用。 HBase 的介绍 HBase 是一个基于 HDFS 的分布式、面向列的 NoSQL 数据库,具有高性能、可靠性和扩展性等特点。HBase 的特点包括: 1. 面向列:HBase 是面向列的存储和权限控制,并支持独立索引。 2. 多版本:HBase 每一个列的存储有多个 Version。 3. 稀疏性:为空的列不占用存储空间,表可以设计得非常稀疏。 4. 扩展性:底层依赖 HDFS。 5. 高可靠性:WAL 机制保证了数据写入时不会因集群异常而导致写入数据丢失,Replication 机制保证了在集群出现严重的问题时,数据不会发生丢失或损坏。 6. 高性能:底层的 LSM 数据结构和 Rowkey 有序排列等架构上的独特设计,使得 HBase 具有非常高的写入性能。 HBase 的读写过程 HBase 的读写过程可以分为两部分:写数据流程和读数据流程。 写数据流程 写数据流程主要包括以下步骤: 1. 客户端将数据写入到 RegionServer 的 HLog 中。 2. RegionServer 将数据写入到 MemStore 中。 3. 当 MemStore 中的数据达到一定的阈值时,将数据刷成一个 StoreFile 文件。 4. 多个 StoreFile 文件达到一定的大小时,会触发紧凑合并操作,合并为一个 StoreFile。 5. 在紧凑合并操作中,同时进行版本的合并和数据删除。 读数据流程 读数据流程主要包括以下步骤: 1. 客户端从元表中找到对应的区域信息。 2. 根据命名空间、表名和 RowKey 在元表中找到对应的区域信息。 3. 找到这个区域对应的 RegionServer 的。 4. 查找对应的区域。 5. 先从 MemStore 中找数据,如果没有,再到 StoreFile 上读。 Client-Server 交互逻辑 Client-Server 交互逻辑主要包括以下步骤: 1. 客户端根据配置文件中的 zookeeper 地址连接 zookeeper,并读取/<hbase-rootdir>/meta-region-server 节点信息。 2. 根据 hbase:meta 所在 RegionServer 的访问信息,客户端会将该元数据表加载到本地并进行缓存。 3. 根据数据所在 RegionServer 的访问信息,客户端会向该 RegionServer 发送真正的数据读取请求。 RegionServer 的处理流程 RegionServer 接收到客户端的 get/scan 请求之后,先后做了两件事情: 1. 构建 scanner 体系(实际上就是做一些 scan 前的准备工作)。 2. 在此体系基础上一行一行检索。 HBase RowKey 设计 HBase RowKey 是 HBase 中的一种关键设计,决定了数据的存储和检索方式。RowKey 的设计需要考虑到数据的分布、读写性能和数据的一致性等因素。 HBase 协处理器运用 HBase 协处理器是一种高级的数据处理机制,可以对数据进行实时处理和分析。协处理器可以应用于数据清洁、数据转换、数据聚合等场景。 HBase 是一个功能强大且高性能的 NoSQL 数据库,具有广泛的应用前景。 RowKey 设计和协处理器运用是 HBase 中两个非常重要的概念,需要细心设计和实施。

剩余10页未读,继续阅读

- 粉丝: 0

- 资源: 26

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功