没有合适的资源?快使用搜索试试~ 我知道了~

温馨提示

试读

27页

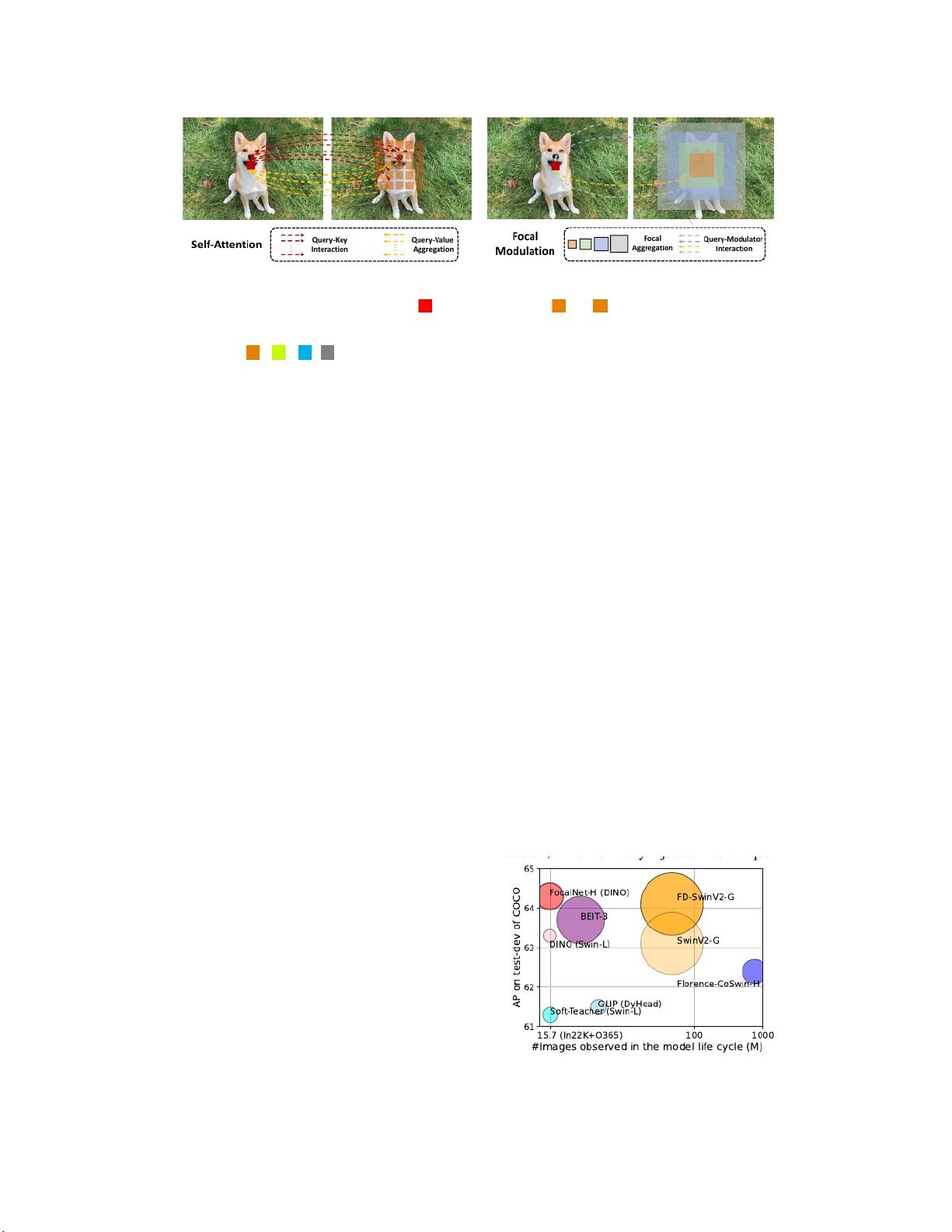

本文介绍了使用Focal Modulation替代自注意力(self-attention)的FocalNet(Focal Modulation Network)网络,新模块具有更好的token交互效果。 近些年,Transformers在自然语言处理、图像分类、目标检测和图像分割上均取得了较大的成功,归根结底是自注意力(SA :self-attention)起到了关键性的作用,因此能够支持输入信息的全局交互。但是由于视觉tokens的大量存在,自注意力的计算复杂度高,尤其是在高分辨的输入时,因此针对该缺陷,本文提出了FocalNet网络。

资源推荐

资源详情

资源评论

1

1

2

2

1

1

2

+ AI {jianwyan,chunyl,xidai,luyuan,

jfgao}@microsoft.com

1:(FocalNet)-

CAM[117]Grad-CAM[61]

(FocalNets)(SA)

:(i)

;(ii)

;(iii)

FocalNets(1)

SoTA SA(SwinFocal

)FocalNetsImageNet-1K82.3%

83.9%top-1224-2ImageNet-22K224-2384-

2top-186.5%87.3%Mask R-CNN

[29]1xFocalNetSwin2.13x

Swin(49.0 vs . 48.5)UPerNet[90]FocalNet

Swin 2.4Swin (50.5 vs . 49.7)

FocalNetMask2former[13]ADE20K58.5 mIoUCOCO

57.9 PQFocalNetDINO[106]COCO

minivaltest-dev64.364.4 mAPSwinv2-G[53]BEIT-3[84]

SoTA

1

1

Code and models are available at: https://github.com/microsoft/FocalNet.

arXiv: 2203.11926 v3 [csCV: 2022115

https://fanyi.youdao.com/download

2:(window-wise) Self-Attention (SA)[79,22,54]

()SA

()SA

1

[79](NLP)(ViT)[22]

[75,82,89,54,108,78][3,120,114,18][80,86,14][45,112,4,9,81,41]

(SA)

SA

[82]

[54,78,108][60,98,59][95,15]SA

()SA[89,25,94,23,21,

40,7,20]

:SA

?SA2vit[22]Swin Transformer[54]

()SA

()()(

)?

2

(),

[95]

-

SA

FocalNet

3:SoTACOCO

FocalNets

2

SoTA SAFocalNet

82.3%83.9%SwinFocal Transformer

224-

2

ImageNet-22KFocalNets224-

2

384-

2

86.5%87.3%Swin

COCO[49]FocalNets

Mask R-CNN 1x46.149.0mAPSwin3x(46.048.5mAP)

ADE20k[118]FocalNet50.5

mIoUSwin (49.7 mIoU)FocalNet

Mask2formerADE20K58.5 mIoUCOCO57.9 PQ[12]

FocalNetDINO[106]COCO minivaltest-dev64.364.4 mAP

(Swinv2-G[53]BEIT-3[84])COCOSoTA3

vit

2

Self-attentionsTransformer[79]vision Transformer (ViT)[22]

ViTs(SA)ResNet

(ConvNets)[30][22,75][5,82,94][89,25,

46][54,108,15,95][101]

[38,27,38]SA

[95]

Poolformer[100]

Swin

MLPmlp:(i)mlpMLP-Mixer[72]ResMLP[74]

(spatial-wise projection)

[51,58,70,71](ii)mlp

[99,32,48,8,26]Mix-Shift-MLP[113]mlp

[95]MLP

-

ConvNetsVGG[63]

InceptionNet[67]ResNet[30]ConvNets

MobileNet[33]ShuffleNet[111]effentnet[69]ConvNets

SE-Net[35]Non-local Network[85]GCNet[2]LR-Net[34]C3Net[97]

ConvNetsInvolution[43]DyConv[10]ConvNets

:(i)SA[89,25,46,23][76];(ii) ResNets

ViTs[88]()SA[28,55]

Swin

3

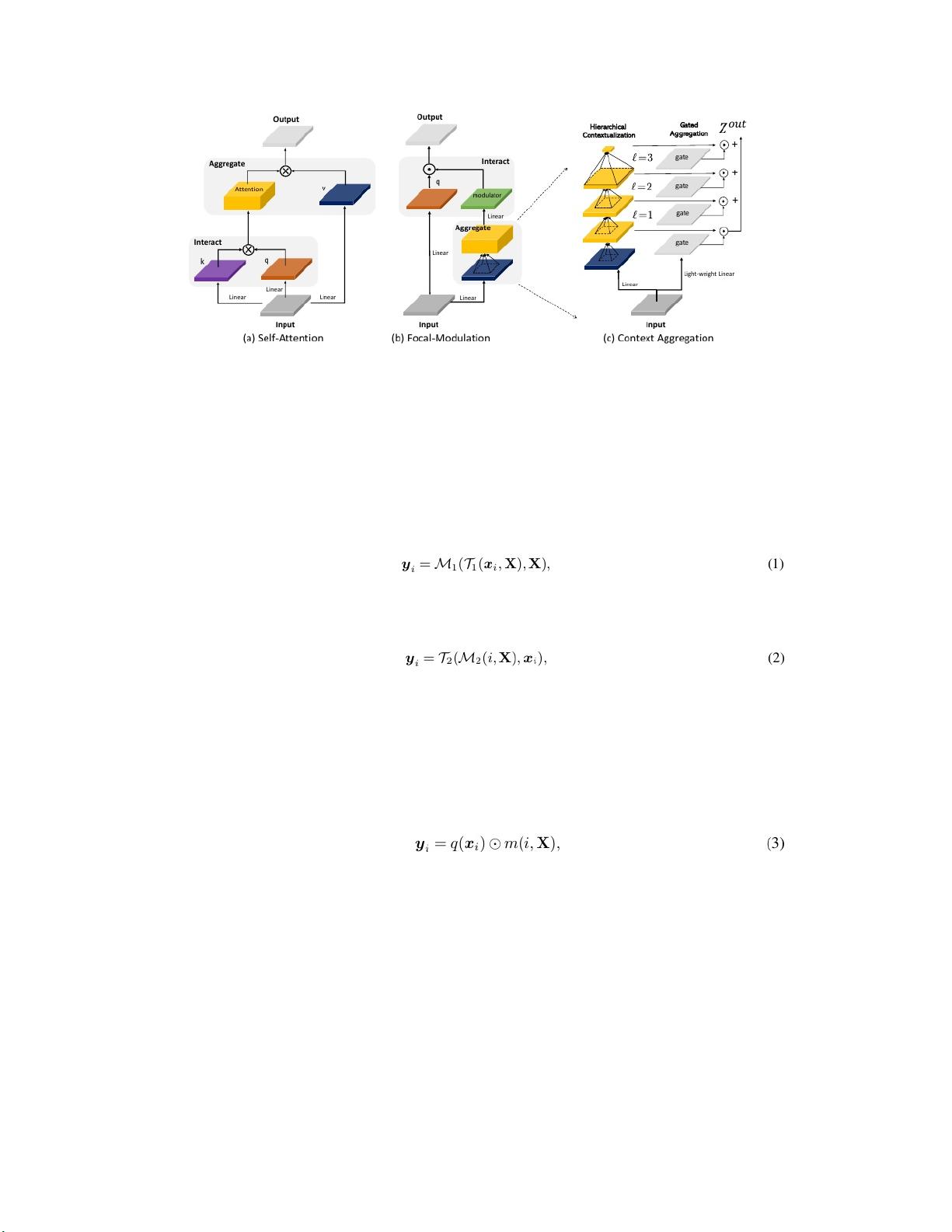

4::SA (a)(b):(c)

3

3.1

X

R

HWCX(

)TM()x

i

R

C

y

i

R

C

Self-attention

T

1

XM

1

y

i

iM

2

T

2

y

i

Eq.(1)Eq.(2)(i) M

2

()

SAM

1

;(ii)

T

2

T

1

Eq.(2)

q()M()

4(a)(b):

q()m()i

X

input-dependencym()i

im()

Q()m()

Eq.(3)m()

4

5:ImageNet-1KFocalNet (L = 3)Eq.

(5)G

123

6:(Eq.(6))

FocalNet

3.2 m()

[95,21,55]

[95]

4 (c):(hierarchical contextualization)

(gated aggregation)

1:

XZ

0

=f

z

(X)R

HWC

L'{1 L}Z

`

:

f

a

`

' -thDWConvk

`

GeLU

[31]Eq.(4)

[100,35]

Eq.(4)L'r ' =1 + P ' i=1(k '1)

k 'l

Z

L+1

=Avg-Pool(Z

L

)(L + 1){Z

`

}

L+

1

`=1

2:(Gated Aggregation)

(L + 1)

()

G = fg(X)RHW (L+1)

X

Z

out

G

`

R

HW1

G5

FocalNet

h(.)

5

剩余26页未读,继续阅读

资源评论

梨涡的漫漫求学路

- 粉丝: 143

- 资源: 1

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功