没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

Attention 概述

Attention 用于计算"相关程度",例如在翻译过程中,不同的英文对中文的依赖程度不

同, 通常可以进行如下描述,表示为将 query(Q)和 key-value pairs 映射

到输出上,其中 query、每个 key、每个 value 都是向量,输出是 V 中所有 values 的

加权,其中权重是由 Query 和每个 key 计算出来的,

计算方法分为三步:

第一步:计算比较 和 的相似度,用 函数来表示:

f

(

Q , K

i

)

i=1,2,3 , …

第二步:将得到的相似度进行 操作,进行归一化:

α

i

=softmax

(

f

(

Q , K

i

)

)

=

e

f

(

Q, K

i

)

∑

j=1

m

e

f

(

Q , K

i

)

i=1,2,3 ,…

第三步 :针 对计算 出来 的 权重

α

i

,对 中 所有 的 进行加 权求和 计算 , 得到

向量:

∑

i=1

m

α

i

V

i

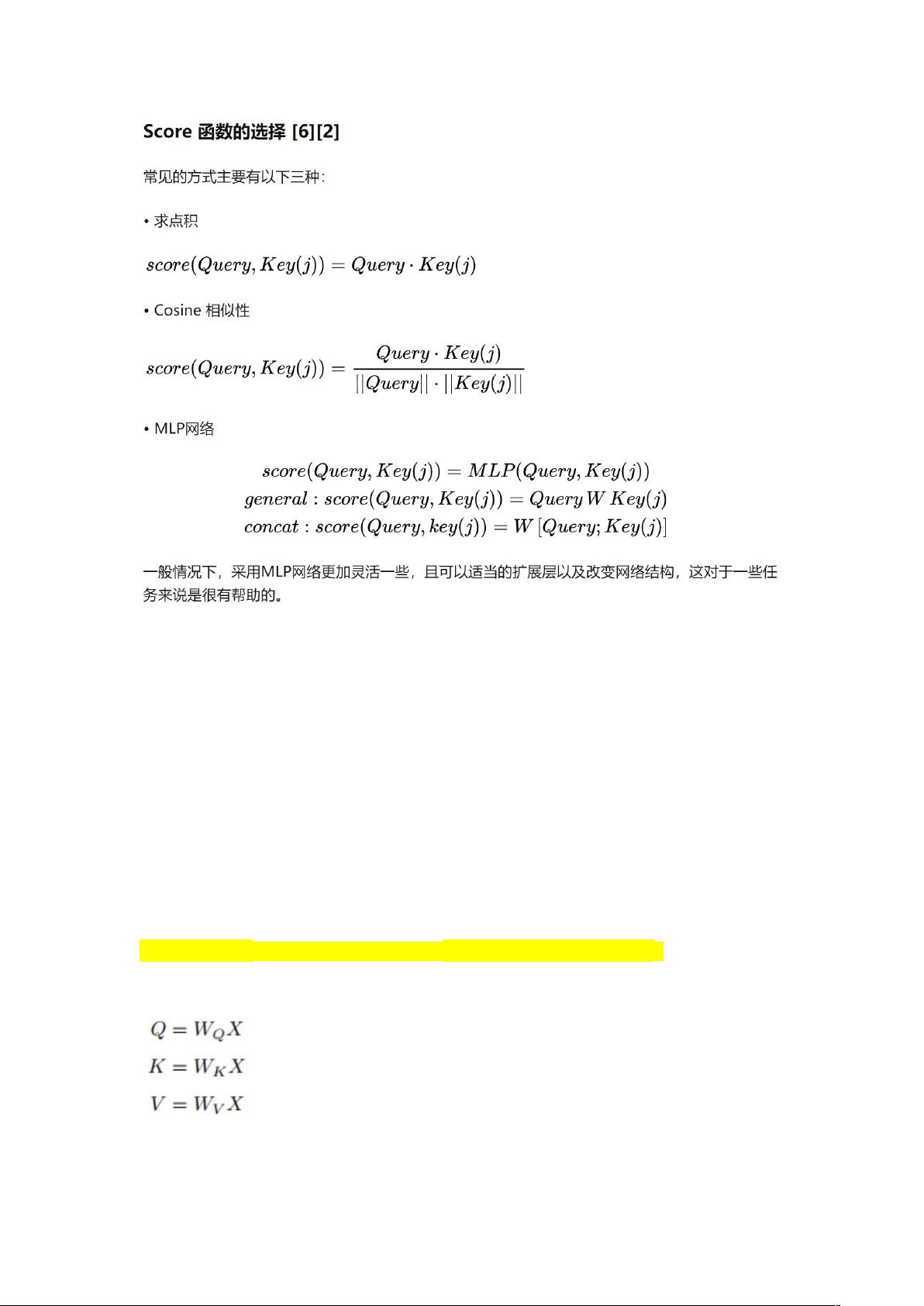

相似度函数 f 有四种计算方式:

! " 深 度 学 习 中 的 注 意 力 机 制

#$%&&'()*%)(++

!",-"*"".#%"/*"0"1*

Self-attention 模型

这时我们就可以利用注意力机制来“动态”地生成不同连接的权重,这就是自注意力模型

(."%)。

自注意力模型(self-Attention model)具体的计算流程是怎样的呢?

同样,给出信息输入:用 2"3" +4"5"5"5"4"/"!表示 /"个输入信息;通过线性变换得到为查

询向量序列,键向量序列和值向量序列:

上面的公式可以看出,self-Attention 中的 Q 是对自身(self)输入的变换,而在传统

的 Attention 中,Q 来自于外部。

剩余12页未读,继续阅读

果子果实

- 粉丝: 986

- 资源: 1

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0