没有合适的资源?快使用搜索试试~ 我知道了~

韩炳涛先生的文章,整理在一起,耗费了一点点时间,合成一个文档供大家学习。

资源推荐

资源详情

资源评论

[关闭]

@hanbingtao 2017-08-28 19:35 字数 5679 阅读 240109

零基础入门深度学习(1) - 感知器

机器学习 深度学习入门

无论即将到来的是大数据时代还是人工智能时代,亦或是传统行业使用人工智能在云上处理大数据的时代,

作为一个有理想有追求的程序员,不懂深度学习(Deep Learning)这个超热的技术,会不会感觉马上就out

了?现在救命稻草来了,《零基础入门深度学习》系列文章旨在讲帮助爱编程的你从零基础达到入门级水

平。零基础意味着你不需要太多的数学知识,只要会写程序就行了,没错,这是专门为程序员写的文章。虽

然文中会有很多公式你也许看不懂,但同时也会有更多的代码,程序员的你一定能看懂的(我周围是一群狂

热的Clean Code程序员,所以我写的代码也不会很差)。

文章列表

零基础入门深度学习(1) - 感知器

零基础入门深度学习(2) - 线性单元和梯度下降

零基础入门深度学习(3) - 神经网络和反向传播算法

零基础入门深度学习(4) - 卷积神经网络

零基础入门深度学习(5) - 循环神经网络

零基础入门深度学习(6) - 长短时记忆网络(LSTM)

零基础入门深度学习(7) - 递归神经网络

深度学习是啥

在人工智能领域,有一个方法叫机器学习。在机器学习这个方法里,有一类算法叫神经网络。神经网络如下图所示:

上图中每个圆圈都是一个神经元,每条线表示神经元之间的连接。我们可以看到,上面的神经元被分成了多层,层与层

之间的神经元有连接,而层内之间的神经元没有连接。最左边的层叫做输入层,这层负责接收输入数据;最右边的层叫

输出层,我们可以从这层获取神经网络输出数据。输入层和输出层之间的层叫做隐藏层。

隐藏层比较多(大于2)的神经网络叫做深度神经网络。而深度学习,就是使用深层架构(比如,深度神经网络)的机

器学习方法。

那么深层网络和浅层网络相比有什么优势呢?简单来说深层网络能够表达力更强。事实上,一个仅有一个隐藏层的神经

网络就能拟合任何一个函数,但是它需要很多很多的神经元。而深层网络用少得多的神经元就能拟合同样的函数。也就

是为了拟合一个函数,要么使用一个浅而宽的网络,要么使用一个深而窄的网络。而后者往往更节约资源。

深层网络也有劣势,就是它不太容易训练。简单的说,你需要大量的数据,很多的技巧才能训练好一个深层网络。这是

个手艺活。

感知器

看到这里,如果你还是一头雾水,那也是很正常的。为了理解神经网络,我们应该先理解神经网络的组成单元——神经

元。神经元也叫做感知器。感知器算法在上个世纪50-70年代很流行,也成功解决了很多问题。并且,感知器算法也是非

常简单的。

感知器的定义

下图是一个感知器:

可以看到,一个感知器有如下组成部分:

• 输入权值 一个感知器可以接收多个输入 ,每个输入上有一个权值 ,此外还有一个

偏置项 ,就是上图中的 。

• 激活函数 感知器的激活函数可以有很多选择,比如我们可以选择下面这个阶跃函数 来作为激活函数:

• 输出 感知器的输出由下面这个公式来计算

如果看完上面的公式一下子就晕了,不要紧,我们用一个简单的例子来帮助理解。

公式

例子:用感知器实现and函数

我们设计一个感知器,让它来实现and运算。程序员都知道,and是一个二元函数(带有两个参数 和 ),下面是它

的真值表:

0 0 0

0 1 0

1 0 0

1 1 1

为了计算方便,我们用0表示false,用1表示true。这没什么难理解的,对于C语言程序员来说,这是天经地义的。

我们令 ,而激活函数 就是前面写出来的阶跃函数,这时,感知器就相当于and函数。不明

白?我们验算一下:

输入上面真值表的第一行,即 ,那么根据公式(1),计算输出:

也就是当 都为0的时候, 为0,这就是真值表的第一行。读者可以自行验证上述真值表的第二、三、四行。

例子:用感知器实现or函数

同样,我们也可以用感知器来实现or运算。仅仅需要把偏置项 的值设置为-0.3就可以了。我们验算一下,下面是or运算

的真值表:

0 0 0

0 1 1

1 0 1

1 1 1

我们来验算第二行,这时的输入是 ,带入公式(1):

也就是当 时, 为1,即or真值表第二行。读者可以自行验证其它行。

感知器还能做什么

事实上,感知器不仅仅能实现简单的布尔运算。它可以拟合任何的线性函数,任何线性分类或线性回归问题都可以用感

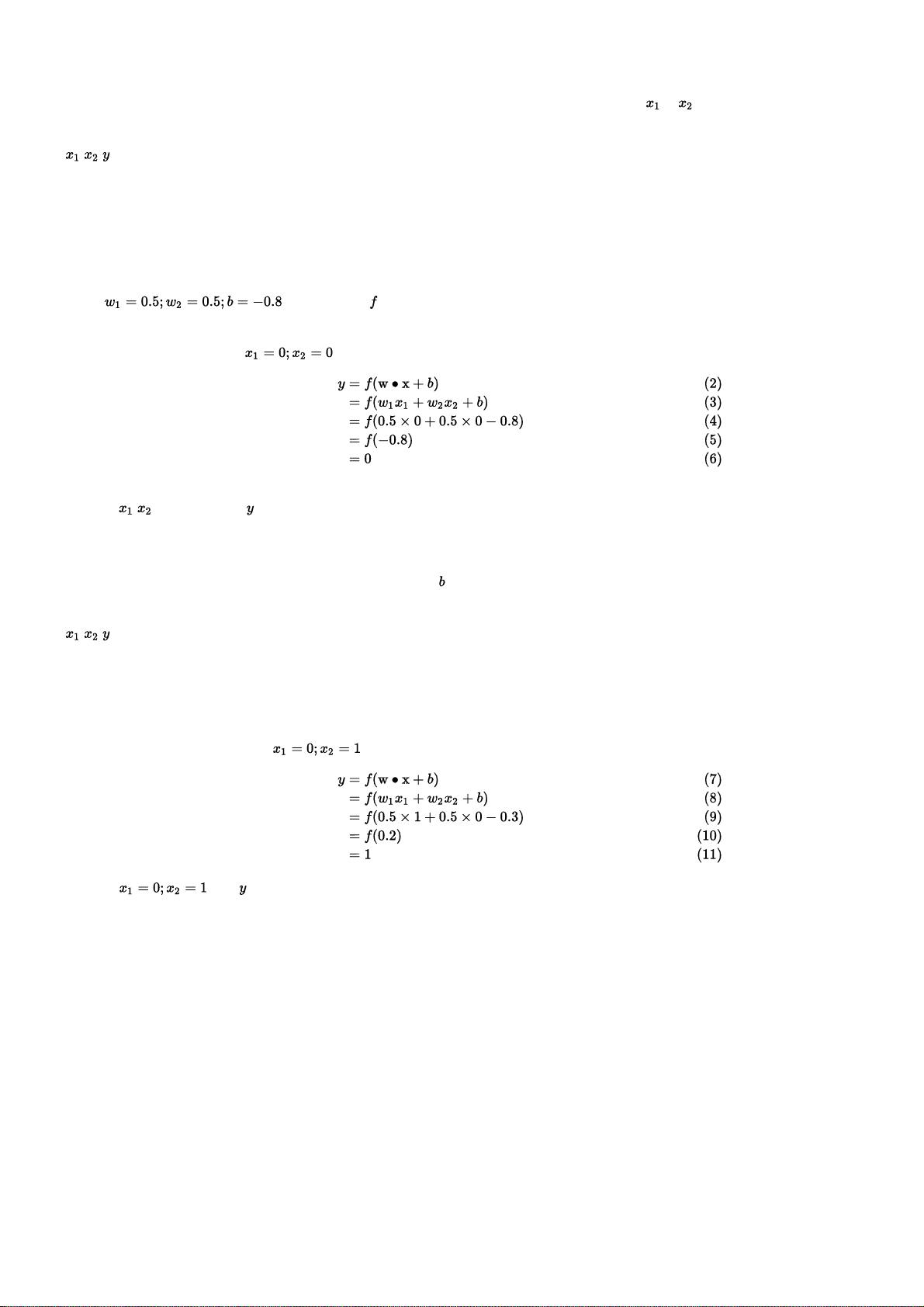

知器来解决。前面的布尔运算可以看作是二分类问题,即给定一个输入,输出0(属于分类0)或1(属于分类1)。如下

面所示,and运算是一个线性分类问题,即可以用一条直线把分类0(false,红叉表示)和分类1(true,绿点表示)分

开。

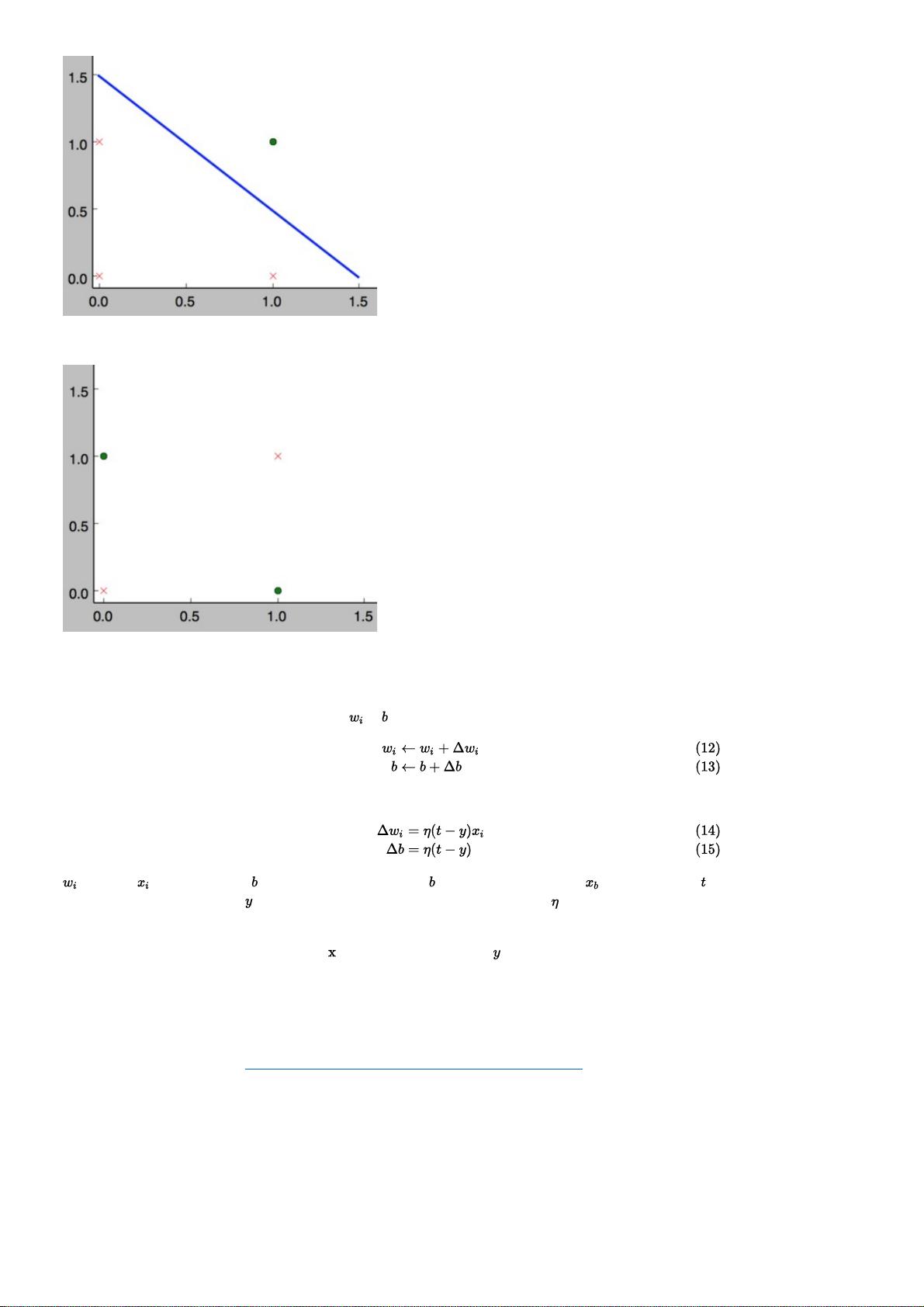

然而,感知器却不能实现异或运算,如下图所示,异或运算不是线性的,你无法用一条直线把分类0和分类1分开。

感知器的训练

现在,你可能困惑前面的权重项和偏置项的值是如何获得的呢?这就要用到感知器训练算法:将权重项和偏置项初始化

为0,然后,利用下面的感知器规则迭代的修改 和 ,直到训练完成。

其中:

是与输入 对应的权重项, 是偏置项。事实上,可以把 看作是值永远为1的输入 所对应的权重。 是训练样本的

实际值,一般称之为label。而 是感知器的输出值,它是根据公式(1)计算得出。 是一个称为学习速率的常数,其作用

是控制每一步调整权的幅度。

每次从训练数据中取出一个样本的输入向量 ,使用感知器计算其输出 ,再根据上面的规则来调整权重。每处理一个

样本就调整一次权重。经过多轮迭代后(即全部的训练数据被反复处理多轮),就可以训练出感知器的权重,使之实现

目标函数。

编程实战:实现感知器

完整代码请参考GitHub: https://github.com/hanbt/learn_dl/blob/master/perceptron.py (python2.7)

对于程序员来说,没有什么比亲自动手实现学得更快了,而且,很多时候一行代码抵得上千言万语。接下来我们就将实

现一个感知器。

下面是一些说明:

• 使用python语言。python在机器学习领域用的很广泛,而且,写python程序真的很轻松。

• 面向对象编程。面向对象是特别好的管理复杂度的工具,应对复杂问题时,用面向对象设计方法很容易将复杂问

题拆解为多个简单问题,从而解救我们的大脑。

• 没有使用numpy。numpy实现了很多基础算法,对于实现机器学习算法来说是个必备的工具。但为了降低读者理解

的难度,下面的代码只用到了基本的python(省去您去学习numpy的时间)。

下面是感知器类的实现,非常简单。去掉注释只有27行,而且还包括为了美观(每行不超过60个字符)而增加的很多换

行。

1. class Perceptron(object):

2. def __init__(self, input_num, activator):

3. '''

4. 初始化感知器,设置输入参数的个数,以及激活函数。

5. 激活函数的类型为double -> double

6. '''

7. self.activator = activator

8. #

权重向量初始化为

0

9. self.weights = [0.0 for _ in range(input_num)]

10. #

偏置项初始化为

0

11. self.bias = 0.0

12.

13. def __str__(self):

14. '''

15. 打印学习到的权重、偏置项

16. '''

17. return 'weights\t:%s\nbias\t:%f\n' % (self.weights, self.bias)

18.

19.

20. def predict(self, input_vec):

21. '''

22. 输入向量,输出感知器的计算结果

23. '''

24. #

把

input_vec[x1,x2,x3...]

和

weights[w1,w2,w3,...]

打包在一起

25. #

变成

[(x1,w1),(x2,w2),(x3,w3),...]

26. #

然后利用

map

函数计算

[x1*w1, x2*w2, x3*w3]

27. #

最后利用

reduce

求和

28. return self.activator(

29. reduce(lambda a, b: a + b,

30. map(lambda (x, w): x * w,

31. zip(input_vec, self.weights))

32. , 0.0) + self.bias)

33.

34. def train(self, input_vecs, labels, iteration, rate):

35. '''

36. 输入训练数据:一组向量、与每个向量对应的label;以及训练轮数、学习率

37. '''

38. for i in range(iteration):

39. self._one_iteration(input_vecs, labels, rate)

40.

41. def _one_iteration(self, input_vecs, labels, rate):

42. '''

43. 一次迭代,把所有的训练数据过一遍

44. '''

45. #

把输入和输出打包在一起,成为样本的列表

[(input_vec, label), ...]

46. #

而每个训练样本是

(input_vec, label)

47. samples = zip(input_vecs, labels)

48. #

对每个样本,按照感知器规则更新权重

49. for (input_vec, label) in samples:

50. #

计算感知器在当前权重下的输出

51. output = self.predict(input_vec)

52. #

更新权重

53. self._update_weights(input_vec, output, label, rate)

54.

55. def _update_weights(self, input_vec, output, label, rate):

56. '''

57. 按照感知器规则更新权重

58. '''

59. #

把

input_vec[x1,x2,x3,...]

和

weights[w1,w2,w3,...]

打包在一起

60. #

变成

[(x1,w1),(x2,w2),(x3,w3),...]

61. #

然后利用感知器规则更新权重

62. delta = label - output

63. self.weights = map(

64. lambda (x, w): w + rate * delta * x,

65. zip(input_vec, self.weights))

66. #

更新

bias

67. self.bias += rate * delta

接下来,我们利用这个感知器类去实现and函数。

1. def f(x):

2. '''

3. 定义激活函数f

4. '''

5. return 1 if x > 0 else 0

6.

7.

剩余105页未读,继续阅读

资源评论

gaoleikidkidkid

- 粉丝: 38

- 资源: 4

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 生菜生长记录数据集(3K+ 记录,7特征) CSV

- 国际象棋检测2-YOLO(v5至v9)、COCO、CreateML、Darknet、Paligemma、TFRecord数据集合集.rar

- RGMII delay问题

- Python结合Pygame库实现圣诞主题动画和音乐效果的代码示例

- 国际象棋检测2-YOLO(v5至v11)、COCO、CreateML、Paligemma、TFRecord、VOC数据集合集.rar

- ssd5课件图片记录保存

- 常用算法介绍与学习资源汇总

- Python与Pygame实现带特效的圣诞节场景模拟程序

- 国际象棋检测11-YOLO(v7至v9)、COCO、Darknet、Paligemma、VOC数据集合集.rar

- 使用Python和matplotlib库绘制爱心图形的技术教程

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功