# 基于Luong attention机制的seq2seq2的chatbot

使用seq2seq架构搭建聊天机器人。 灵感是pytorch的[chatbot_tutorial](https://pytorch.org/tutorials/beginner/chatbot_tutorial.html)

torch官方使用了`batch_first=False`的数据组织方式,我则使用了`batch_first=True`的方式(单纯觉得`batch_first=True`更加符合我的理解)

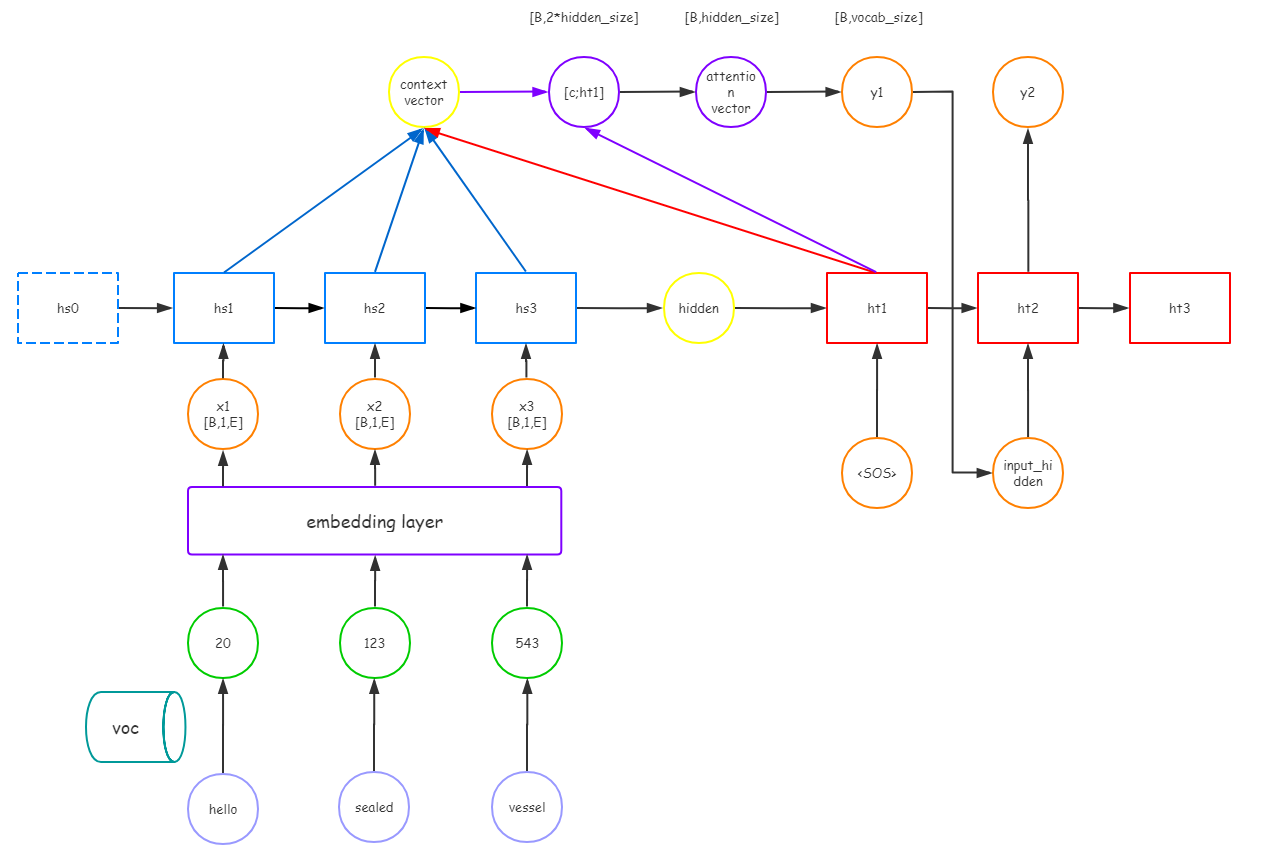

encoder-decoder(Luong attention机制)的图大致如下:

使用Cornell的电影对话数据集,[链接](https://www.cs.cornell.edu/~cristian/Cornell_Movie-Dialogs_Corpus.html) (项目中已经包含数据集,无需额外下载)

## 训练模型

```bash

python main.py --train --root="data" --device="cuda" --batch_size=64 --save_dir="chatbot" --teacher_forcing_ratio=0.95 --learning_rate=0.003 --epoch=15 --print_interval=100 --save_interval=1000

```

## 测试性能

```bash

python main.py --test --root="data" --state_dict=<saved state dict>

```

## 进行推理

推理为一问一答式的开放式问答

```bash

python play.py --state_dict=<saved state dict> --show_confidence

```

通过命令行来进行简单的交互:

baidu_16992441

- 粉丝: 311

- 资源: 1041

最新资源

- 广电大数据可视化项目实战

- 电缆、树木检测15-YOLO(v5至v11)、COCO、CreateML、Paligemma、TFRecord、VOC数据集合集.rar

- 基于smic40nm工艺,SAR ADC ,逐次逼近型 10bit,50MHZ,适合新手入门学习使用,有配套的教程 基于smic40nm工艺,采样时钟异步,含有冗余设计,电路包括但不限于栅压自举开关

- 去嗡嗡嗡钱钱钱嗡嗡嗡钱钱钱

- Java中使用AES进行加解密示例代码AESExample.zip

- 基于ECMS搭建的混合动力汽车simulink模型 可用于能量管理研究 模型运行无误 联系赠送模型搭建参考文献一份,赠送nedc、udds等常用工况数据表,可自行更改工况进行模型开发

- eladmin-jpa 版本:项目基于 Spring Boot 2.1.0 、 Jpa、 Spring Security、redis、Vue的前后端分离的后台管理系统

- python hhhhhhhh

- 电缆植被检测16-YOLO(v5至v11)、COCO、CreateML、Paligemma、VOC数据集合集.rar

- 【诚通证券-2024研报】伊利股份2024年三季报点评:业绩持续承压,年底或有望企稳.pdf

- 爬虫火车头解决滑块认证,手写个vps自动拨号脚本,达到更换ip效果(附源码)

- Admin.NET(ZRAdmin)是一款前后端分离的、跨平台基于RBAC的通用权限管理后台 ORM采用SqlSugar

- Delphi 12 控件之3KHGEM2.rar

- 基于SpringBoot2/3+Sa-Token+Mybatis-Plus和Vue3+Ant Design Vue+Uni-App+Uni-UI,并以高质量代码为核心,简洁、高效、安全的快速开发平台

- 多思计组实验(计算机组成原理上机实验):实验4 总线与微命令

- 空中俯视物体人检测7-YOLO(v5至v9)、COCO、CreateML、Darknet、Paligemma、TFRecord数据集合集.rar

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈