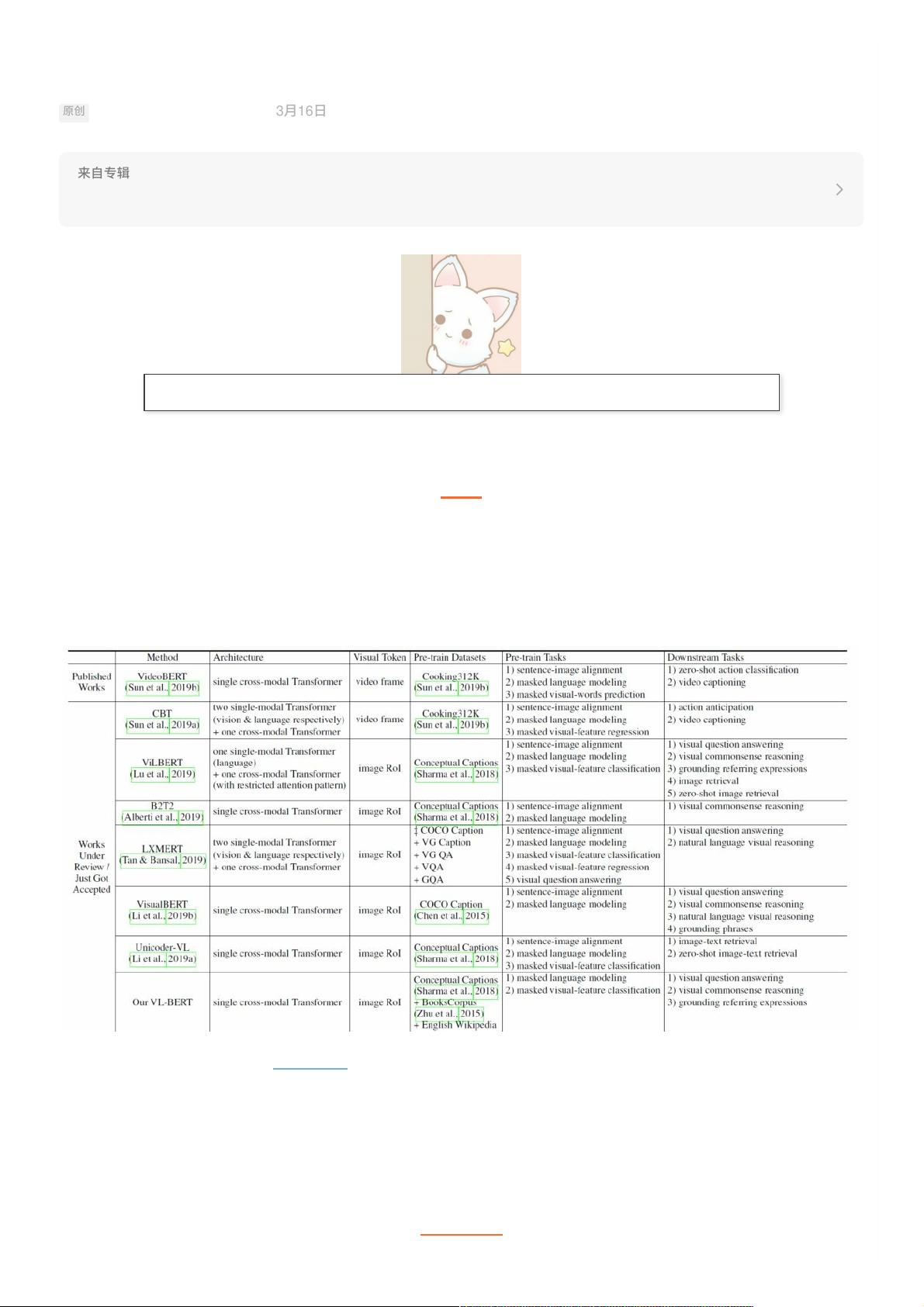

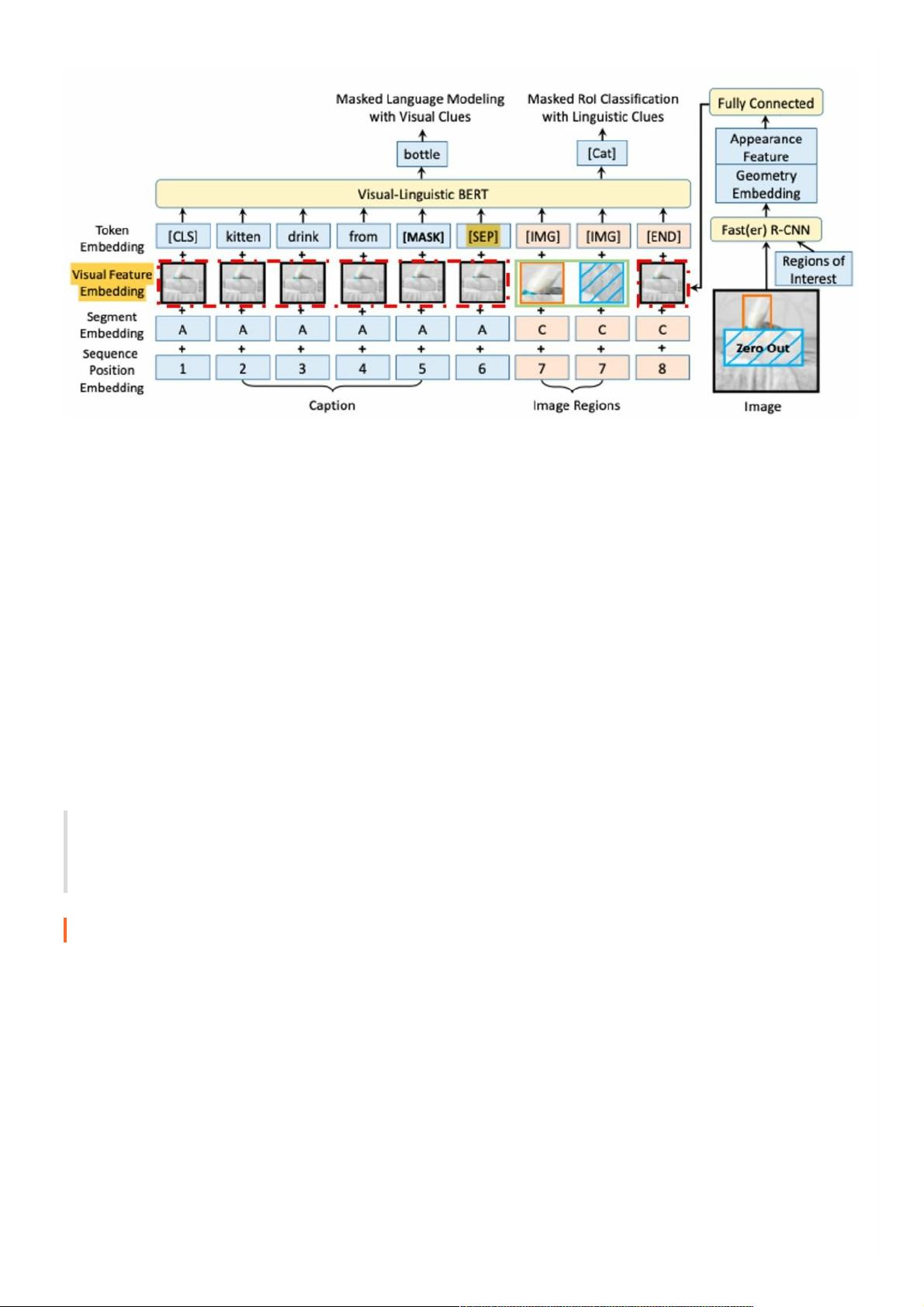

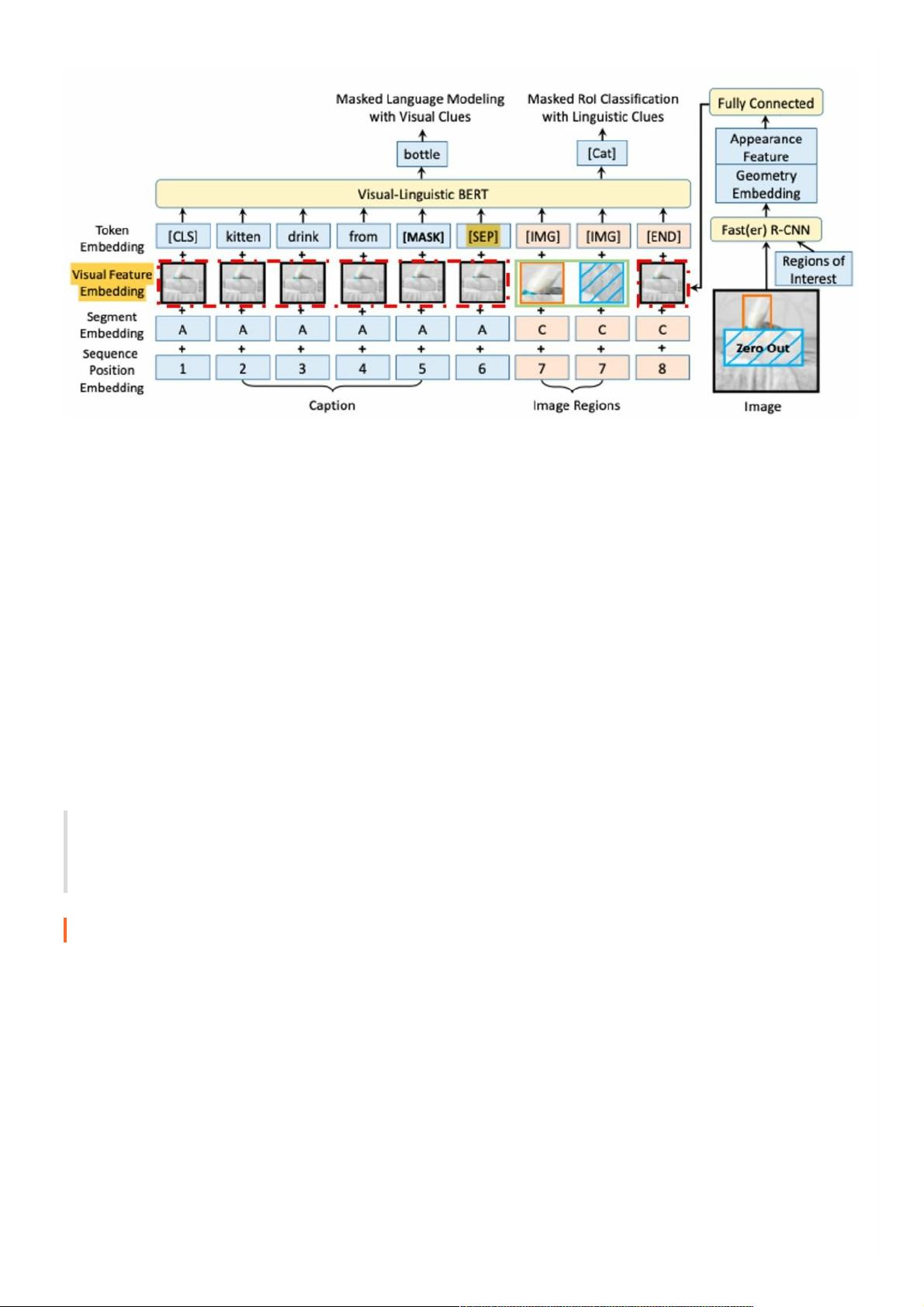

VL-BERT模型以transformer为⻣⼲,将BERT的输⼊扩展为⽂本+图像。那么问题来了,怎样将两者花式融合呢?让我们揣测⼀下

作者的炼丹思路:

1. 图⽚和⽂本没法直接对⻬,暴⼒输⼊整张图

于是就有了图中⽤红⾊虚线框起来的部分,直接将图像、⽂本、segment和position embeding加和输⼊。这样做MLM任务是没问

题了,但怎样确定模型能准确提取图像信息呢?

2. 提取图像中的重要部分,增加⽆⽂本的图像输⼊

由于整张图⽚的粒度远⼤于⽂本token,⼀次性输⼊整张图⽚显然不利于图像和⽂本信息的交互。所以使⽤了⽬标检测⼯具对图⽚

进⾏分块,提取图像中感兴趣的核⼼部分RoI(region-of-interest),加上[IMG]标识,输⼊到模型中(图中浅绿⾊实线框起来的

部分)。 为了不失掉全局信息,在[END]对应的位置⼜加上了整张图像。另外,我们假设图⽚的不同区域是没有顺序可⾔的,即

position embedding是⼀样的。

类⽐⽂本输⼊,模型实际上接受的是⽂本token(subword)对应的word embedding,所以我们会对所有图像输⼊(不管是整

张图⽚还是局部RoIs)使⽤pre-trained R-CNN提取2048维的visual feature embedding输⼊到模型中。

⾃监督学习任务(pretrain)

结合上⽂介绍的模型结构,再强调⼀下两个预训练任务:

1. Masked Language Model with visual Clues

根据⽂本+图像信息预测⽂本token,升级版的MLM。 唯⼀不同的是被mask的word除了根据没被mask的⽂本来预测还可以根据视

觉的信息来辅助。⽐如上图中的例⼦,被mask后的word sequence是kitten drinking from [MASK],如果没有图⽚给我们的视觉信

息是⽆法预测出被mask的词是bottle。

2. Masked RoI Classification with LinguisticClues

根据⽂本+图像信息预测RoIs的类别,针对图像的“MLM”。 以下图为例,⾸先对图⽚使⽤⽬标检测⼯具提取RoIs并获得所属类

别,然后随机mask局部区域(树叶部分)。需要注意的是,由于模型会接收整张图⽚的输⼊,为了避免信息泄露,整张图⽚对应