后BERT时代:15个预训练模型对⽐分析与关键点探究

JayLou

2019-08-17⼣⼩瑶的卖萌屋

前⾔

在⼩⼣之前写过的《NLP的游戏规则从此改写?从word2vec, ELMo到BERT》 ⼀⽂中,介绍了从word2vec到ELMo再到BERT的发展路径。⽽

在BERT出现之后的这⼤半年的时间⾥,模型预训练的⽅法⼜被Google、Facebook、微软、百度、OpenAI等极少数⼏个玩得起游戏的核⼼玩

家反复迭代了若⼲版,⼀次次的刷新我们这些吃⽠群众的案板上的⽠。

有没有感觉出⽠速度太快以⾄于吃速跟不上?不⽤担⼼,⼩⼣帮你们找来了这篇总结的恰到好处的⽂章,对ELMo以来的15个代表性的预训

练语⾔模型进⾏了多维度的对⽐和分析。尤其是近期找⼯作的⼩伙伴们注意啦,这篇⽂章⾥⾯提出来的⼀些问题很适合作为⾯试考点(划

掉,交流点)噢~

本⽂转载⾃知乎专栏《⾼能NLP之路》并进⾏了剪切和少量修改,作者JayLou,原⽂链接

https://zhuanlan.zhihu.com/p/76912493

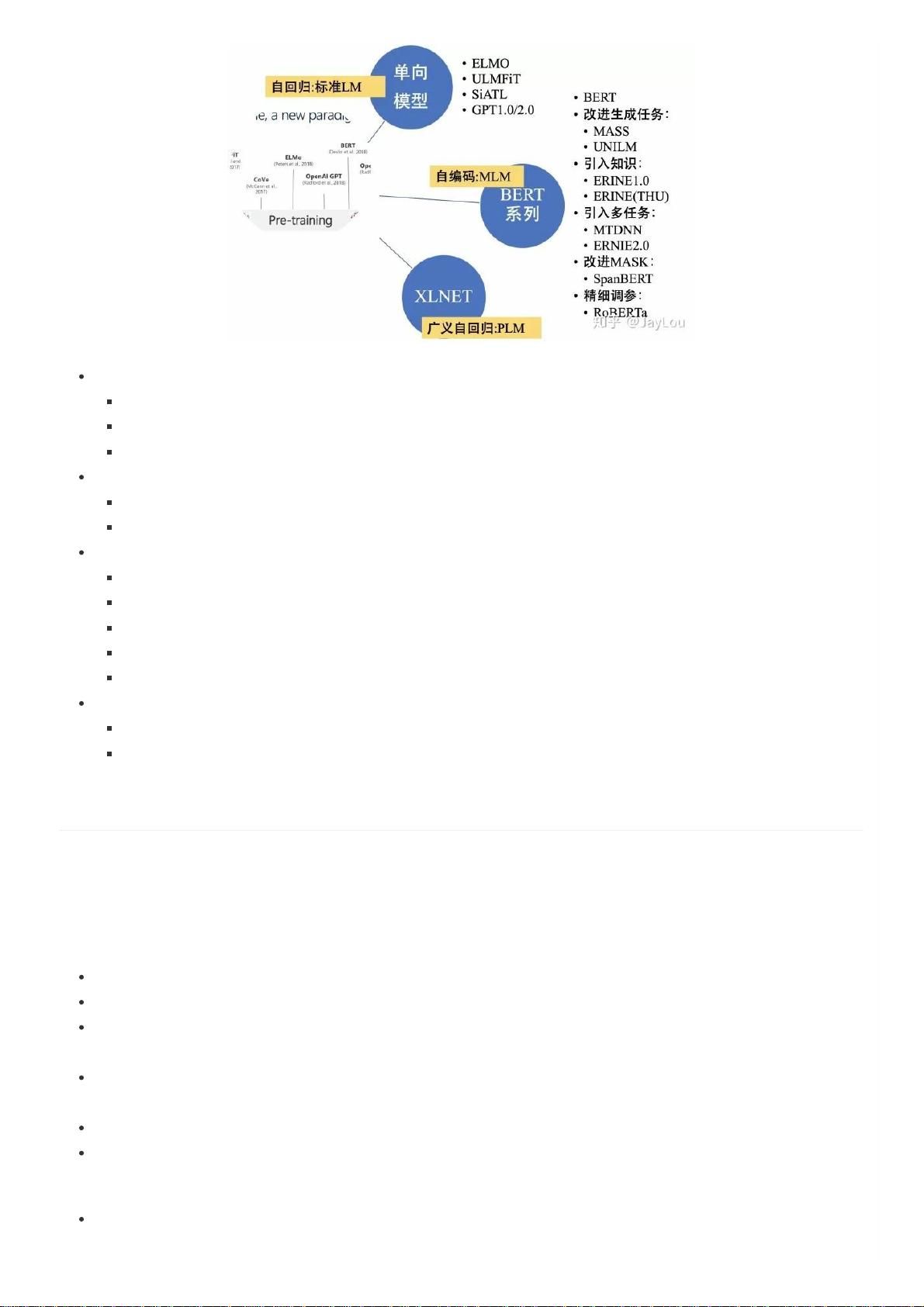

⾸先上⼀张镇楼专⽤图,看⼀下ELMo以来的预训练语⾔模型发展的概况

然后上本⽂正餐,⼀个⾼能的question list,这也是本⽂写作的主线。

Question List

Q1:从不同维度对⽐各【预训练语⾔模型】?

Q2:基于深度学习的NLP特征抽取机制有哪些?各有哪些优缺点?

Q3:⾃回归和⾃编码语⾔模型各有什么优缺点?

Q4:单向模型的内核机制是怎样的?有哪些缺点?

Q5:Transformer内部机制的深⼊理解:

为什么是缩放点积,⽽不是点积模型?