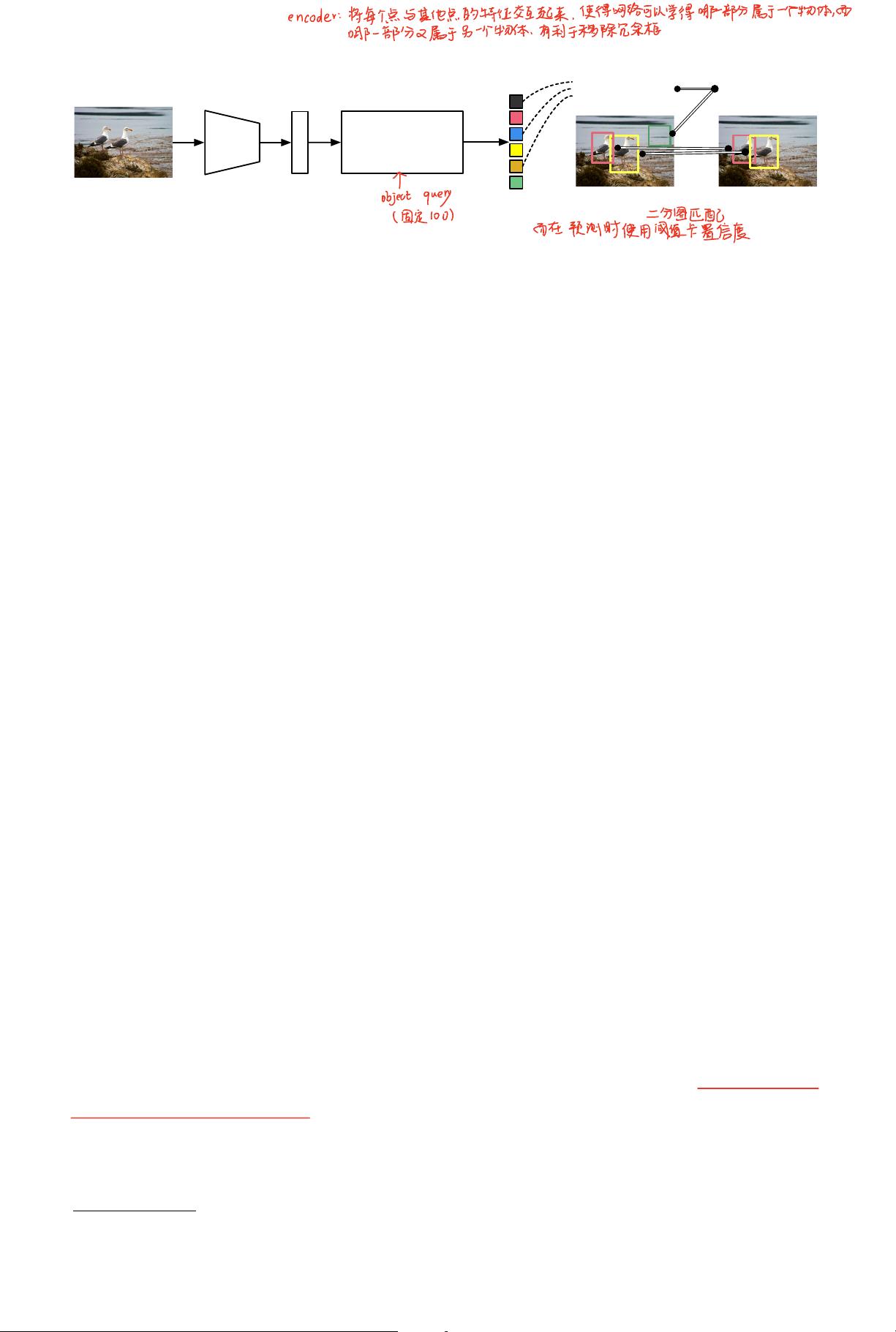

《End-to-End Object Detection with Transformers》这篇论文探讨了一种新的对象检测方法,该方法将对象检测视为直接的集合预测问题。传统的对象检测框架通常包含许多手动设计的组件,如非极大值抑制(Non-Maximum Suppression, NMS)和锚框生成(Anchor Generation),这些组件基于对任务的先验知识进行编码。而DEtection TRansformer(DETR)模型则摒弃了这些繁琐的步骤,以更简洁的方式实现对象检测。 DETR的核心是基于Transformer的编码器-解码器架构和一个集合理论损失函数。Transformer最初在自然语言处理领域取得显著成果,DETR将其引入计算机视觉,用于理解图像中的物体关系和全局上下文。模型使用一组固定的学习对象查询(Object Queries)作为输入,通过Transformer直接并行地输出最终的预测集合,无需NMS等后处理步骤。 DETR的工作流程如下:编码器对输入图像进行特征提取,然后解码器通过与固定数量的对象查询交互来生成预测。每个对象查询可以被视为潜在物体的表示,解码器通过学习这些查询与图像特征的相互作用来预测物体的边界框和类别。由于采用了集合理论损失,DETR能够通过二分匹配(Bipartite Matching)强制预测结果的唯一性,从而确保每个真实物体仅对应一个预测。 在COCO对象检测数据集上,DETR的表现与高度优化的Faster R-CNN基线相当,同时在运行时间和准确性方面具有竞争力。此外,DETR还能轻易扩展到产生统一的全景分割任务,并且在这一领域超越了竞争基准。值得注意的是,DETR的实现不依赖于特定的库,这使得它在实际应用中更具灵活性。 论文的贡献主要体现在以下几个方面: 1. 提出了一种新的端到端对象检测框架,消除了传统方法中的手工设计组件,简化了检测流程。 2. 引入Transformer架构,利用其强大的序列建模能力来捕捉图像中的物体关系和上下文信息。 3. 设计了集合理论损失函数,通过二分匹配解决了多预测问题,确保预测的唯一性。 4. 展示了DETR在COCO数据集上的优秀性能,并且可以扩展到其他视觉任务,如全景分割。 DETR的出现标志着对象检测领域的创新,它为后续研究提供了新的思路,即如何更高效、更直接地解决集合预测问题,同时也展示了Transformer在计算机视觉领域的广阔应用前景。随着深度学习和Transformer技术的不断发展,未来可能会有更多类似DETR的模型出现,进一步推动对象检测和其他视觉任务的技术进步。

剩余25页未读,继续阅读

- 粉丝: 165

- 资源: 4

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 00-【管理制度】08-公司新员工入职培训管理制度.doc

- 01-【培训计划】13-新入职员工培训方案计划书(修改版).doc

- 02-【培训方案】04-新员工入职培训方案 .doc

- 02-【培训方案】03-新员工入职培训方案.doc

- 01-【培训计划】18-公司新员工入职培训计划.doc

- 02-【培训方案】07-新员工入职培训课程体系.doc

- 04-【培训通知】06-新员工入职培训通知.doc

- 06-【培训手册】06-新员工入职培训手册.doc

- 05-【培训签到】06-员工培训签到表(模板).doc

- 06-【培训手册】09-超市新员工培训内容.doc

- 06-【培训手册】08-新入职员工培训手册.doc

- 08-【考核管理】06-新员工入职试用考核评价表.doc

- 09-【确认书】04-入职培训确认书.doc

- 09-【确认书】03-新员工入职培训确认书.doc

- 11-【其他】06-新员工入职培训登记表.doc

- 11-【其他】10-新进职员教育.doc

信息提交成功

信息提交成功