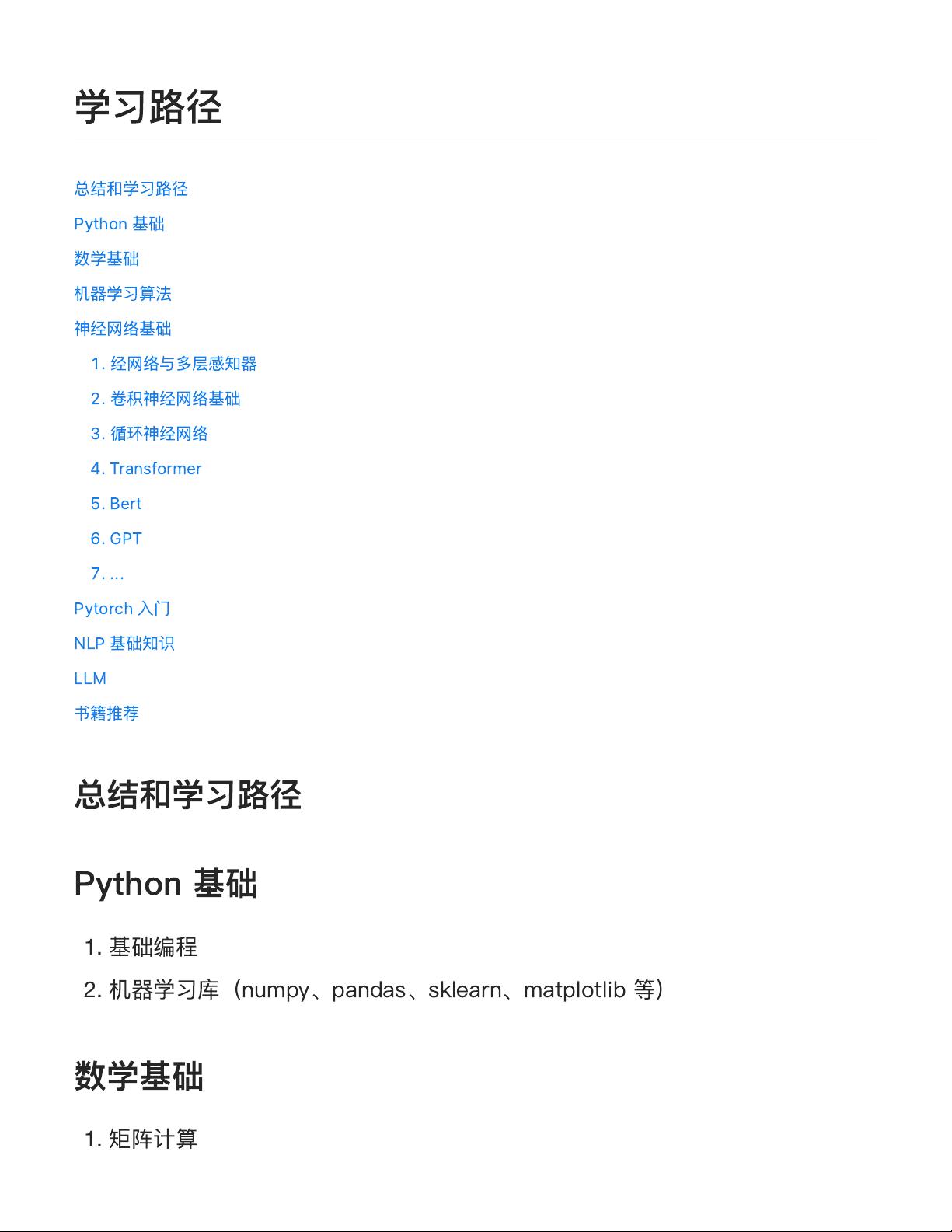

学习路径

总结和学习路径

Python 基础

数学基础

机器学习算法

神经网络基础

经网络与多层感知器

卷积神经网络基础

循环神经网络

Transformer

Bert

6

. GPT

7

. ...

Pytorch 入门

NLP 基础知识

LLM

书籍推荐

### 自然语言处理大模型学习路径规划

#### 学习路径概述

自然语言处理(Natural Language Processing, NLP)作为人工智能领域的一个重要分支,近年来取得了显著进展,这得益于大规模预训练模型的发展。为了掌握NLP领域的核心技能并深入了解最新技术趋势,本指南提供了一个系统的学习路径,帮助学习者从基础知识到高级技术逐步深入。

#### Python基础

Python是NLP领域最常用的语言之一,其简洁易读的语法以及丰富的第三方库支持,使其成为初学者的理想选择。学习Python的基础包括变量类型、控制流、函数定义、面向对象编程等基本概念。

#### 数学基础

数学是理解NLP算法和技术的核心工具。学习者应该掌握以下数学概念:

- **线性代数**:矩阵运算、向量空间、特征值与特征向量。

- **概率论与统计**:概率分布、随机变量、假设检验。

- **微积分**:导数、梯度、积分及其在优化中的应用。

- **信息论**:熵、交叉熵、KL散度等概念对于理解NLP中的模型至关重要。

#### 机器学习算法

了解各种监督学习和非监督学习算法对后续深入研究非常有帮助。关键算法包括但不限于:

- **逻辑回归**:适用于二分类问题。

- **支持向量机**(SVM):处理线性和非线性可分数据集的强大工具。

- **决策树与随机森林**:用于分类和回归任务。

- **聚类算法**(如K-means):无监督学习中常用的方法。

#### 神经网络基础

神经网络是现代NLP技术的基石,理解其工作原理对于构建高效的NLP模型至关重要。

- **人工神经元**:从简单的MP模型开始,理解如何通过加权输入和激活函数来计算输出。

- **多层感知器**(MLP):了解多层神经网络如何通过堆叠多层实现复杂的函数映射。

- **激活函数**:如sigmoid、tanh和ReLU等,这些函数可以为神经网络引入非线性特性。

- **反向传播**:通过梯度下降法调整权重以最小化损失函数的过程。

- **正则化技术**:如L1、L2正则化和Dropout,用以防止过拟合。

#### 卷积神经网络基础

卷积神经网络(Convolutional Neural Network, CNN)广泛应用于图像处理,但也在NLP领域找到了应用场景。

- **卷积层**:了解卷积操作如何提取局部特征。

- **池化层**:通过下采样减少计算量,同时保持重要特征不变。

- **LeNet-5**:一个经典的CNN架构,最初设计用于手写数字识别,也适用于简单的文本分类任务。

#### 循环神经网络

循环神经网络(Recurrent Neural Network, RNN)特别适合处理序列数据。

- **RNN基本单元**:学习如何通过隐藏状态来捕捉序列中的依赖关系。

- **长短期记忆网络**(Long Short-Term Memory, LSTM):解决长期依赖问题的有效方法。

- **门控循环单元**(Gated Recurrent Unit, GRU):一种简化版的LSTM,具有更少的参数。

#### Transformer架构

Transformer是一种基于自注意力机制的架构,在许多NLP任务上超越了传统的RNN和CNN模型。

- **自注意力机制**:允许模型关注输入序列的不同部分。

- **编码器-解码器结构**:通过多头注意力和位置编码处理长距离依赖。

- **Bert**:双向编码器表示,通过预训练和微调的方式提高了下游任务的表现。

- **GPT**:生成式预训练转换器,侧重于无监督学习,擅长文本生成。

#### PyTorch入门

PyTorch是一个强大的深度学习框架,提供了灵活且强大的API,非常适合NLP任务的开发。

- **环境搭建**:安装PyTorch并配置必要的软件包。

- **张量操作**:理解Tensor的基本操作,这是PyTorch的核心。

- **自动求导**:利用自动求导功能快速计算梯度。

- **模型定义与训练**:定义自己的神经网络,并学习如何进行前向传播和反向传播。

- **高级功能**:如模型保存与加载、使用GPU加速训练等。

#### NLP基础知识

NLP涉及多个子领域,了解这些基础知识有助于构建更复杂的应用程序。

- **词向量**:如Word2Vec、GloVe等,将词汇映射到连续向量空间。

- **句子级与文档级的表示**:通过CNN或RNN等方式获取句子或文档的向量表示。

- **序列到序列模型**:用于机器翻译、聊天机器人等任务。

- **注意力机制**:增强模型对输入序列中重要部分的关注能力。

#### 书籍推荐

为了进一步深化理论知识,推荐阅读以下书籍:

- **《Deep Learning》**:Ian Goodfellow等人编著,全面介绍了深度学习的基本概念和技术。

- **《Speech and Language Processing》**:Daniel Jurafsky和James H. Martin编著,涵盖了NLP领域的各个方面。

- **《Natural Language Processing with Python》**:Steven Bird等人编著,适合Python编程入门者的实用指南。

通过遵循以上学习路径,学习者不仅能够掌握NLP的基本概念和技术,还能跟上该领域的最新发展,从而在实际项目中取得成功。