没有合适的资源?快使用搜索试试~ 我知道了~

机器学习算法总结_决策树 (2).pdf

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 100 浏览量

2022-07-03

13:13:26

上传

评论

收藏 1022KB PDF 举报

温馨提示

试读

20页

机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf机器学习算法总结_决策树 (2).pdf

资源推荐

资源详情

资源评论

第三章 决策树

决策树(Decision Tree)是在已知各种情况发生概率的基础上,通过构成决

策树来求取净现值的期望值大于等于零的概率,评价项目风险,判断其可行性的

决策分析方法,是直观运用概率分析的一种图解法。由于这种决策分支画成图形

很像一棵树的枝干,故称决策树。在机器学习中,决策树是一个预测模型,他代

表的是对象属性与对象值之间的一种映射关系。Entropy = 系统的凌乱程度,使

用算法 ID3, C4.5 和 C5.0 生成树算法使用熵。这一度量是基于信息学理论中熵

的概念。

2.1 决策树模型与学习

2.1.1 决策树模型

定义 2.1(决策树) 分类决策树模型是一种描述对实例进行分类的树形结

构。决策树由结点(node)和有向边(directed edge)组成。

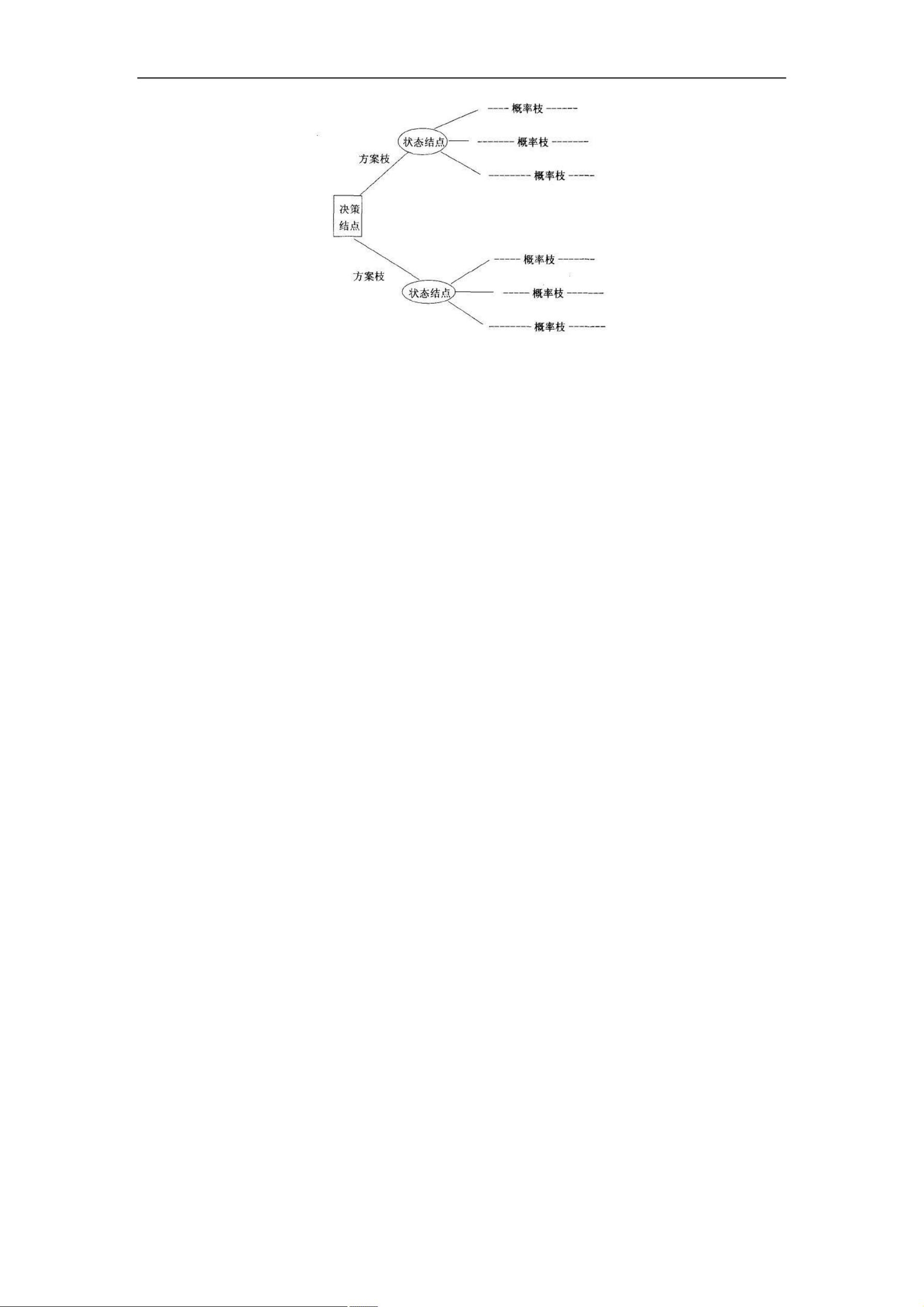

□——决策点,是对几种可能方案的选择,即最后选择的最佳方案。如果决

策属于多级决策,则决策树的中间可以有多个决策点,以决策树根部的决策点为

最终决策方案为最终决策方案。

○——状态节点,代表备选方案的经济效果(期望值),通过各状态节点的

经济效果的对比,按照一定的决策标准就可以选出最佳方案。由状态节点引出的

分支称为概率枝,概率枝的数目表示可能出现的自然状态数目每个分枝上要注明

该状态出现的概率。

△——结果节点,将每个方案在各种自然状态下取得的损益值标注于结果节

点的右端。

.

2.1.2 决策树学习

决策树是以实例为基础的归纳学习算法。

它从一组无次序、无规则的元组中推理出决策树表示形式的分类规则。它采

用自顶向下的递归方式,在决策树的内部结点进行属性值的比较,并根据不同的

属性值从该结点向下分支,叶结点是要学习划分的类。从根到叶结点的一条路径

就对应着一条合取规则,整个决策树就对应着一组析取表达式规则。 1986 年

Quinlan 提出了著名的 ID3 算法。在 ID3 算法的基础上,1993 年 Quinlan 又提出

了 C4.5 算法。为了适应处理大规模数据集的需要,后来又提出了若干改进的算

法 , 其 中 SLIQ(super-vised learning in quest) 和 SPRINT (scalable

parallelizableinduction of decision trees)是比较有代表性的两个算法。

2.1.3 决策树分析法

决策树分析法是常用的风险分析决策方法。该方法是一种用树形图来描述各

方案在未来收益的计算。比较以及选择的方法,其决策是以期望值为标准的。它

利用了概率论的原理,并且利用一种树形图作为分析工具。

它利用了概率论的原理,并且利用一种树形图作为分析工具。其基本原理是

用决策点代表决策问题,用方案分枝代表可供选择的方案,用概率分枝代表方案

可能出现的各种结果,经过对各种方案在各种结果条件下损益值的计算比较,为

决策者提供决策依据。

.

2

.

决策树分析法是常用的风险分析决策方法。该方法是一种用树形图来描述各

方案在未来收益的计算。比较以及选择的方法,其决策是以期望值为标准的。人

们对未来可能会遇到好几种不同的情况。每种情况均有出现的可能,人们目前无

法确知,但是可以根据以前的资料来推断各种自然状态出现的概率。在这样的条

件下,人们计算的各种方案在未来的经济效果只能是考虑到各种自然状态出现的

概率的期望值,与未来的实际收益不会完全相等。

如果一个决策树只在树的根部有一决策点,则称为单级决策;若一个决策不

仅在树的根部有决策点,而且在树的中间也有决策点,则称为多级决策。

科学的决策是现代管理者的一项重要职责。我们在企业管理实践中,常遇到

的情景是:若干个可行性方案制订出来了,分析一下企业内、外部环境,大部分

条件是己知的,但还存在一定的不确定因素。每个方案的执行都可能出现几种结

果,各种结果的出现有一定的概率,企业决策存在着一定的胜算,也存在着一定

的风险。这时,决策的标准只能是期望值。即,各种状态下的加权平均值。

针对上述问题,用决策树法来解决不失为一种好的选择。

决策树法作为一种决策技术,已被广泛地应用于企业的投资决策之中,它是

随机决策模型中最常见、最普及的一种规策模式和方法此方法,有效地控制了决

策带来的风险。所谓决策树法,就是运用树状图表示各决策的期望值,通过计算,

最终优选出效益最大、成本最小的决策方法。决策树法属于风险型决策方法,不

同于确定型决策方法,二者适用的条件也不同。应用决策树决策方法必须具备以

下条件:

1 有决策者期望达到的明确目标;

2 存在决策者可以选择的两个以上的可行备选方案;

3 存在着决策者无法控制的两种以上的自然状态(如气候变化、市场行情、经

济发展动向等);

4 不同行动方案在不同自然状态下的收益值或损失值(简称损益值)可以计算

出来;

5 决策者能估计出不同的自然状态发生概率。

.

3

.

2.2 特征选择

2.2.1 特征选择问题

1、为什么要做特征选择

在有限的样本数目下,用大量的特征来设计分类器计算开销太大而且分类性能

差。

2、特征选择的确切含义

将高维空间的样本通过映射或者是变换的方式转换到低维空间,达到降维的目

的,然后通过特征选取删选掉冗余和不相关的特征来进一步降维。

3、特征选取的原则

获取尽可能小的特征子集,不显著降低分类精度、不影响类分布以及特征子集

应具有稳定适应性强等特点

4、特征选择需要考虑的问题

a、确定选择算法,在允许的时间内以最小的代价找出最小的、最能描述类别

的特征组合,b、确定评价标准,衡量特征组合是否是最优,得到特征获取操作

的停止条件。

5、特征获取方法

a、按照特征子集的形成方式可以分为三种,穷举法( exhaustion)、启发法

(heuristic)和随机法(random)。穷举法需要遍历特征空间中所有的特征组合,

所以方法复杂度最大,实用性不强;启发法通过采用期望的人工机器调度规则,

重复迭代产生递增的特征子集,复杂度略低于穷举法,但是只能获取近似最优解;

随即方法分为完全随机方法和概率随机方法两种,对参数设置的依赖性较强。

b、按照特征评价标准来分,根据评价函数与分类器的关心,可以分为筛选器

和封装器两种,筛选器的评价函数与分类器无关,封装器采用分类器的错误概率

作为评价函数。筛选器的评价函数可以细分为距离测度、信息测度、相关性测度

和一致性测度。距离测度用距离来衡量样本之间的相似度,信息测度用利用最小

不确定性特征来分类。

6、特征获取方法的选取原则

a、处理的数据类型

.

4

剩余19页未读,继续阅读

资源评论

G11176593

- 粉丝: 6643

- 资源: 3万+

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功