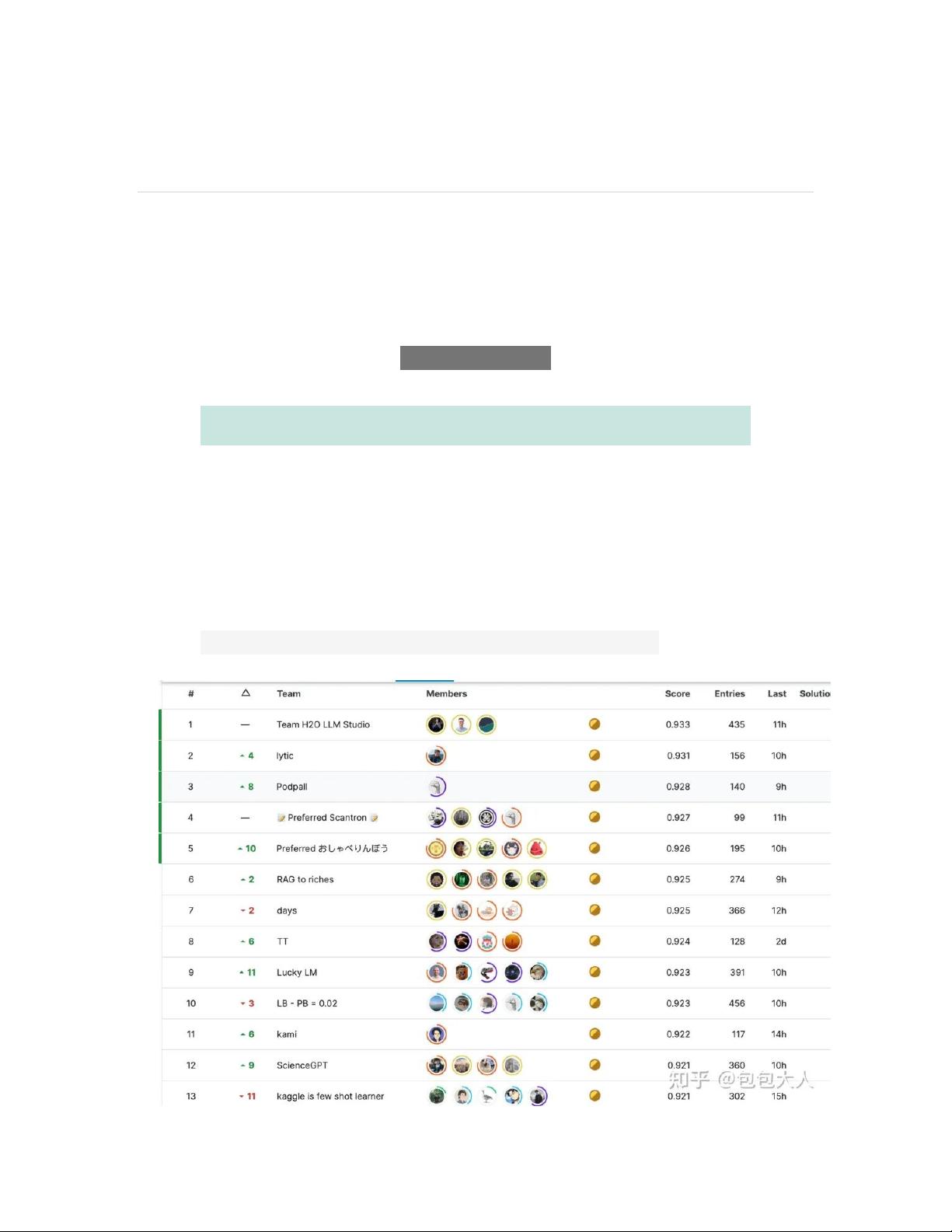

kaggle竞赛资料,AI人工智能算法介绍,技术详解 kaggle竞赛资料,AI人工智能算法介绍,技术详解 kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解kaggle竞赛资料,AI人工智能算法介绍,技术详解 【大模型Kaggle比赛首秀金牌总结】 2023年10月11日,Kaggle举办了首次与大模型相关的人工智能竞赛,标志着大模型在NLP(自然语言处理)领域的崭新应用。这场比赛的独特之处在于,它采用了一种黑盒测试的方式,参赛者需要使用有限的计算资源在9小时内完成对4000条未知数据的预测,以区别于传统的堆模型融合策略。比赛中,参赛者主要使用了各种规模的预训练模型,如DeBERTa、7B、13B甚至是70B参数的模型,并结合RAG(检索增强生成)技术进行模型融合。 RAG是一种创新的模型架构,它将检索系统与大模型相结合,允许模型利用大量语料库中的相关信息来生成更准确的答案。在这种方法中,检索系统召回与问题相关的文档片段,而大模型则利用这些片段生成回答。这种机制在处理需要额外知识的问题时尤其有效,弥补了大模型零样本学习(zeroshot)的不足。比赛中,所有队伍都采用了RAG技术,表明了它在当前AI竞赛中的重要地位。 微调仍然是优化模型性能的关键步骤,尤其是在需要模型适应特定领域或场景时。在这次竞赛中,小模型通过微调在特定场景下的表现超过了大模型的零样本学习。例如,13B/7B模型的微调加上RAG和模型融合策略,使得它们达到了“荣耀王者”的段位。另一方面,虽然70B模型的零样本学习在没有RAG的情况下(即“黄金”段位)不如微调后的模型,但它们在RAG的支持下(“钻石”段位)表现显著提升。 参赛者们普遍使用维基百科作为外部知识源,通过向量检索、TF-IDF相似度计算和BM25等方法召回相关文档,然后结合问题和选项来引导模型生成答案。例如,他们会构造二分类或五分类的问题,利用召回的文档信息来辅助模型做出判断。值得注意的是,第一名团队的成功策略包括了RAG、维基百科文档、e5向量模型以及其他关键技术和数据增强方法。 这次Kaggle比赛展示了大模型在NLP竞赛中的巨大潜力,同时也强调了微调和利用外部知识的重要性。尽管大模型具有广泛的应用价值,但针对特定场景的微调依然不可忽视。随着技术的不断发展,我们期待看到更多创新的解决方案在未来的AI竞赛中涌现。

- 粉丝: 1w+

- 资源: 7755

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功