没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

4/23/23, 2:05 PM

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记 | Redian新闻

https://redian.news/wxnews/287351

1/32

Redian新闻

> 公众号

>

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读

笔记

公众号新闻

2 个月前

来自:老刘说NLP

进NLP群—>加入NLP交流群

Meta最近提出了LLaMA(开放和高效的基础语言模型)模型参数包括从7B到65B等多个版本。最

值得注意的是,LLaMA-13B的性能优于GPT-3,而体积却小了10倍以上,LLaMA-65B与

Chinchilla-70B和PaLM-540B具有竞争性。

Meta表示,该模型在数以万亿计的token上进行训练,并表明有可能完全使用公开的数据集来

训练最先进的模型,而不需要求助于专有的和不可获取的数据集。

特别的,LLaMA-13B在大多数基准上超过了GPT-3(175B),LLaMA-65B与最好的模型

Chinchilla-70B和PaLM-540B具有明显竞争力。

为了了解该工作,本文主要通过研读该论文,供大家一起参考。

4/23/23, 2:05 PM

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记 | Redian新闻

https://redian.news/wxnews/287351

2/32

该论文介绍了对模型架构的修改(Vaswani等人,2017),给出了具体的训练方法,并报告了

模型的性能以及在一组标准基准上与其他LLMs进行了比较。

地址:https://github.com/facebookresearch/llama

一、工作简介与问题的提出

在大量的文本语料库中训练的大型语言模型(LLMs)已经显示出它们能够从文本指令或少数

例子中形成新的任务(Brown等人,2020)。

在将模型扩展到足够大的规模时,首次出现了这些少见的特性(Kaplan等人,2020年),从

而形成了一个专注于进一步扩展这些模型的工作路线(Chowdhery等人,2022年;Rae等人,

2021年)。

这些努力都是基于这样的假设:更多的参数会带来更好的性能。然而,Hoffmann等人

(2022)最近的工作表明,在给定的计算预算下,最好的性能不是由最大的模型实现的,

而是由在更多数据上训练的较小的模型实现的。

Hoff-mann等人(2022)的缩放定律的目标是确定如何在特定的训练计算预算下最佳地扩

展数据集和模型大小。然而,这个目标忽略了推理预算,而推理预算在大规模服务语言模型

时变得至关重要。

在这种情况下,给定一个目标性能水平,首选的模型不是训练速度最快的,而是推理速度

最快的,尽管训练一个大的模型以达到一定的性能水平可能更便宜,但训练时间较长的小模

型最终会在推理中更便宜。

例如,Hoffmann等人(2022年)曾建议在200B的token上训练一个10B的模型,但研究发现

7B的模型的性能甚至在1T的token之后还能继续提高。

因此,该工作的重点是训练一系列语言模型,通过对比通常使用的更多的token进行训

练,在不同的推理预算下达到最佳的性能。

该工作得到的模型被称为LLaMA,参数范围从7B到65B,与现有的最佳LLM相比,具有竞争力

的性能。

尽管LLaMA-13B比GPT-3小10倍,但在大多数基准测试中都超过了GPT-3。这个模型将有助

于增强对LLM的访问和研究,因为它可以在单个GPU上运行。此外,65B参数模型也可以与最

4/23/23, 2:05 PM

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记 | Redian新闻

https://redian.news/wxnews/287351

3/32

好的大型语言模型(如Chinchilla或PaLM-540B)竞争。

特别的,与Chinchilla、PaLM或GPT-3不同的是,该工作只使用公开可用的数据,这使得工作

符合开源原则,而大多数现有模型所依赖的数据要么没有公开可用,要么没有记录(例如 "书

籍-2TB "或 "社交媒体对话")。

接下来,我们分别从训练数据等方面进行介绍。

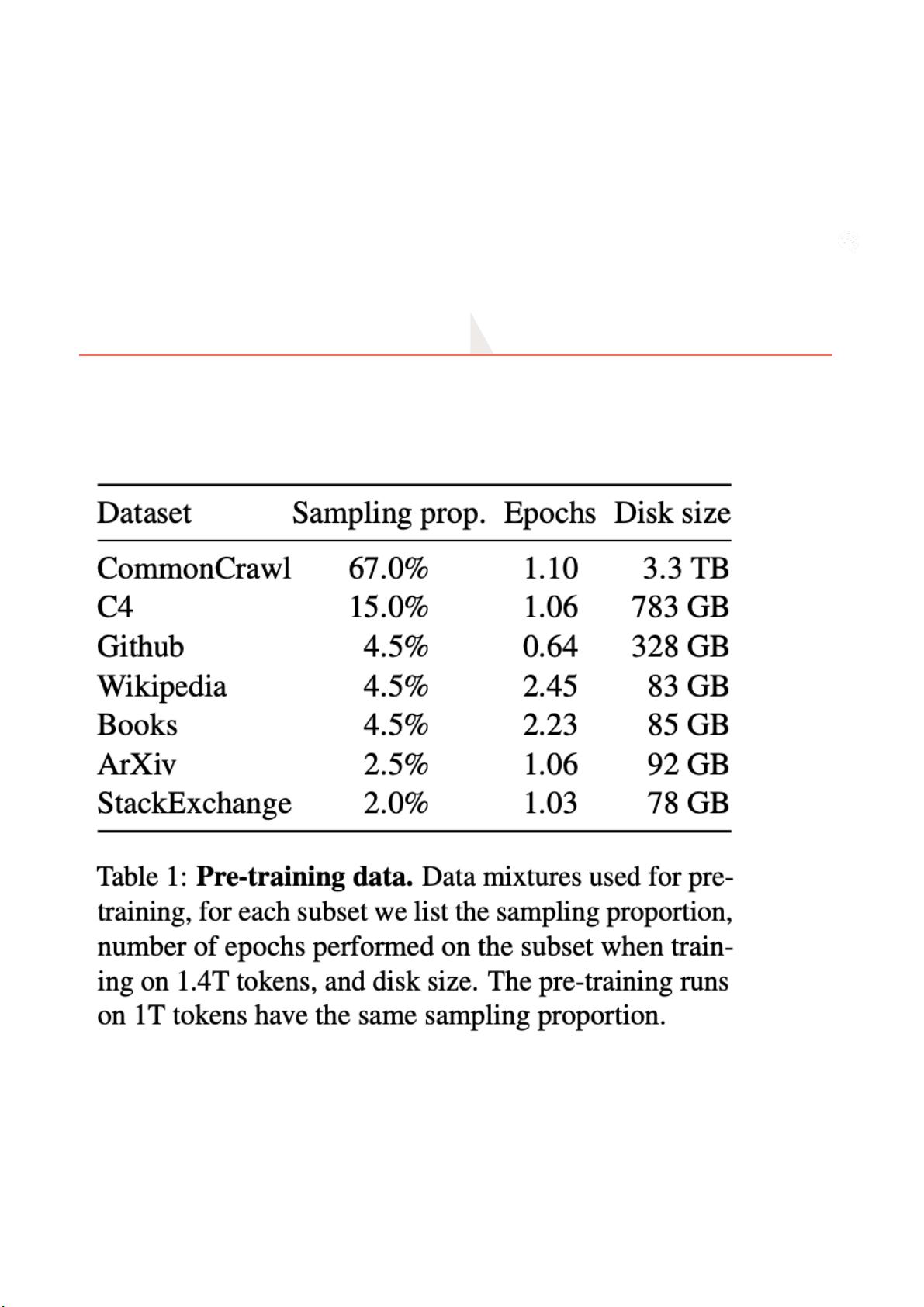

二、预训练数据的来源与清洗策略

LLaMA的训练数据集由几个来源混合而成,涵盖了各种不同的领域,如下表所示:

1、英语CommonCrawl,占比67%

由于CommonCraw数据较为杂乱,该工作采用CCNet pipleline的方式(Wenzek等人,2020)

预处理了从2017年到2020年的CommonCrawl网页。

4/23/23, 2:05 PM

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记 | Redian新闻

https://redian.news/wxnews/287351

4/32

具体的,

该工作首先在行的层面上对数据进行了删除,用fastText线性分类器进行语言识别,以去

除非英语页面,并用n -gram语言模型过滤低质量内容。

其次,训练了一个线性模型来对维基百科中用作参考的页面与随机抽样的页面进行分

类,并丢弃了未被归类为参考的页面。

2、C4,占比15%

在探索性实验中,该工作观察到,使用不同的预处理Com-monCrawl数据集可以提高性能。

因此,该工作将公开的C4数据集(Raffel等人,2020)也纳入我们的数据。

C4的预处理也包含重复数据删除和语言识别步骤,其与CCNet的主要区别在于质量过滤,它

主要依赖于不存在的标点符号或网页中的单词和句子数量等判例。

3、Github,占比4.5%

在代码方面,该工作使用了谷歌BigQuery上的GitHub公共数据集,并只保留在Apache、BSD和

MIT许可下发布的项目。

此外,为了提高数据质量,还用基于行长或字母数字字符比例的启发式方法过滤了低质

量的文件,并用规范的表达式删除了如标题在内的模板化内容。

最后在文件层面上对结果数据集进行重复计算,并进行精确匹配。

4、维基百科,占比4.5%

该工作添加了2022年6月至8月期间的维基百科转储数据,涵盖20种语言,这些语言使用拉丁

字母或西里尔字母,具体是:BG、CA、CS、DA、DE、EN、ES、FR、HR、HU、IT、NL、

PL、UP、RO、RU、SL、SR、SV、UK。

4/23/23, 2:05 PM

Meta最新语言模型LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记 | Redian新闻

https://redian.news/wxnews/287351

5/32

此外,该工作对数据进行处理,以删除超链接、评论和其他格式化的模板。

5、GutenbergProject和Books3,占比4.5%

书籍也是重要的语料来源,该工作的训练数据集包括两个书籍语料库:古腾堡计划

(GutenbergProject)和ThePile(Gao等人,2020)的Books3部分,后者是一个可用于训练大

型语言模型的公开数据集。

在数据处理上,该工作在书的层面上进行了去重处理,删除了内容重叠度超过90%的

书。

6、ArXiv,占比2.5%

科研文献对于提升专业性也有重要作用,该工作对arXiv的Latex文件进行处理,将科学数据添

加到预训练数据集中。

按照Lewkowycz等人(2022年)的做法,该工作删除了第一节之前的所有内容以及书

目。

此外,还删除了.tex文件中的评论,以及用户写的内联扩展定义和宏,以增加论文之间的

一致性。

7、StackExchange,占比2%

QA数据对于提升垂直的专业问题也有帮助。

该工作还使用了Stack Exchange的开放数据,Stack Exchange是一个高质量的问题和答案的网

站,涵盖了从计算机科学到化学的不同领域。

具体的,该工作保留了28个最大的网站的数据,从文本中去除HTML标签,并按分数(从高到

低)对答案进行排序。

剩余31页未读,继续阅读

资源评论

IT徐师兄

- 粉丝: 1950

- 资源: 2689

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功