想想这一年来你最常听到过哪些词

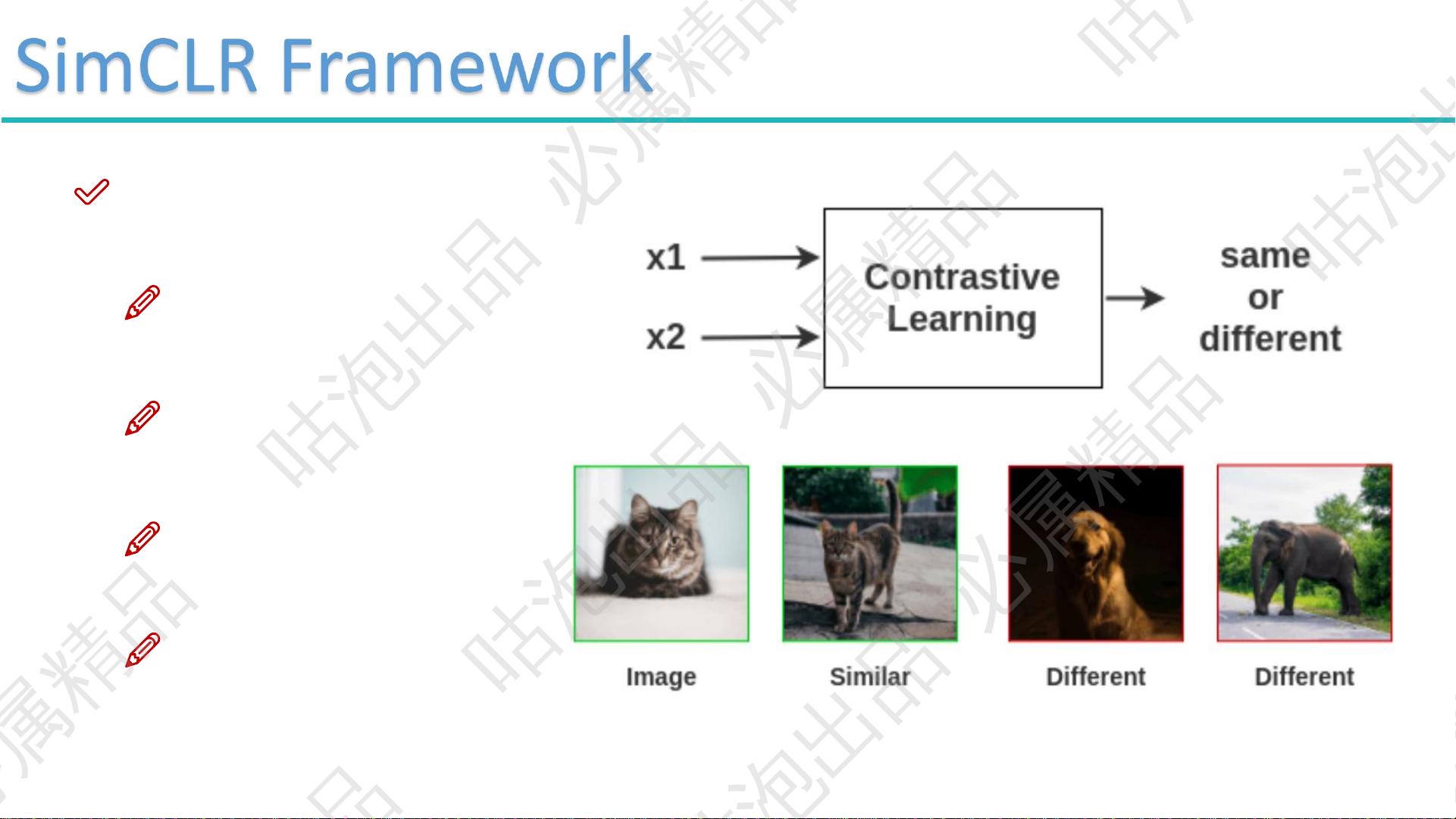

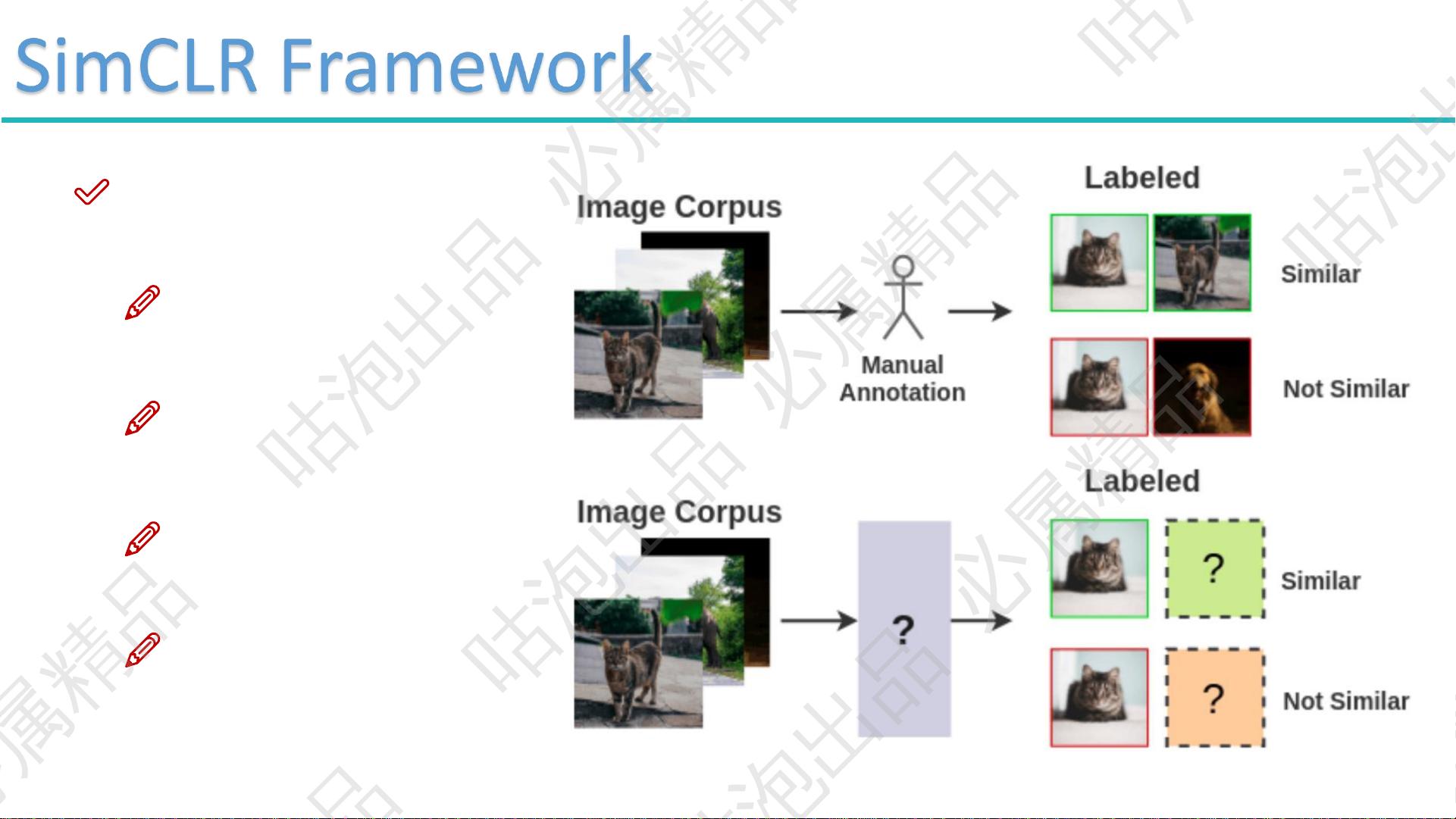

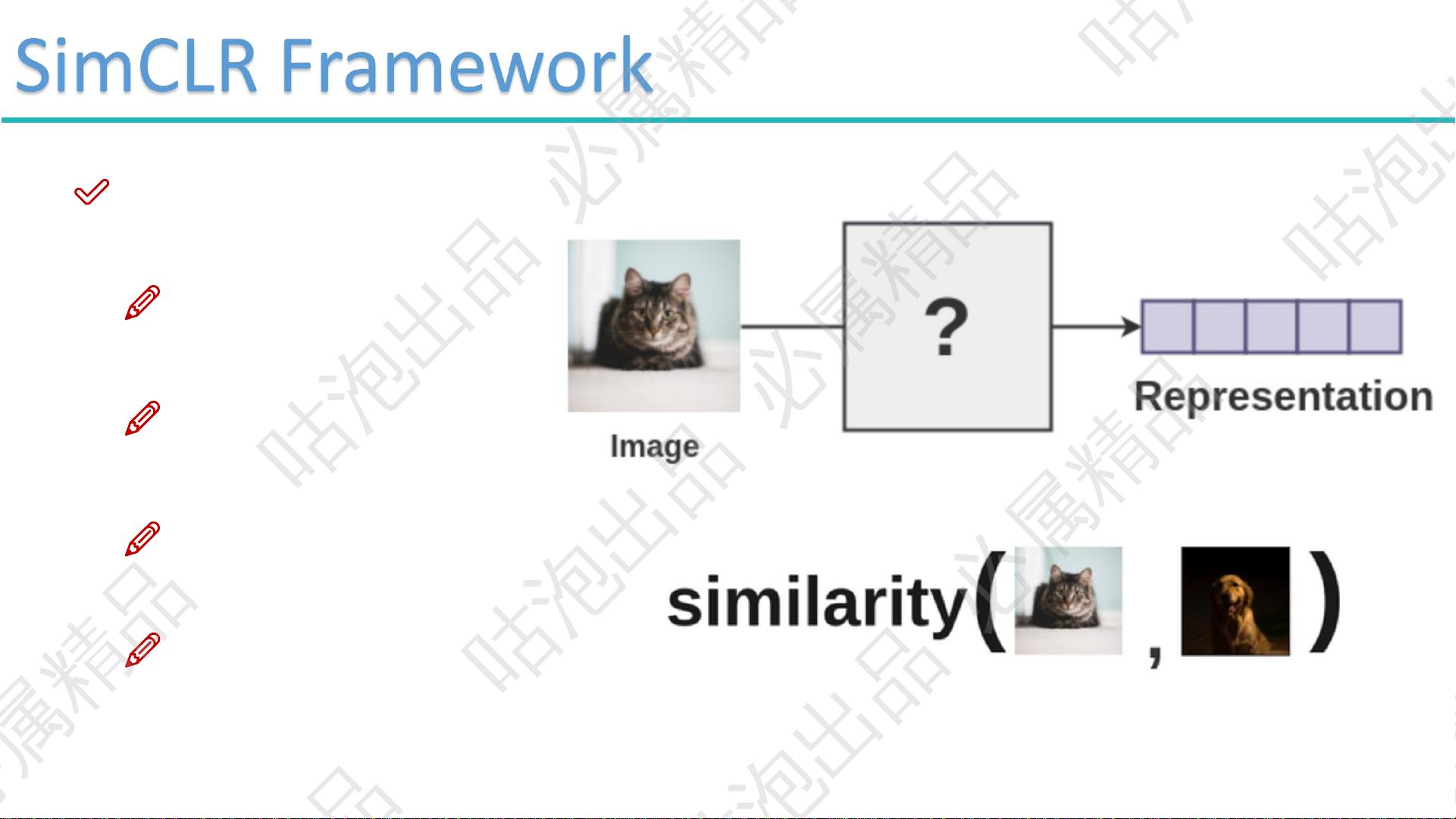

自监督学习,对比学习等,这些事好像都不需要我们准备标签

Openai开创了GPT系列,CLIP,Dalle等,都在告诉我们一件事

模型在训练的时候,不要被标签所束缚,模型的潜力应该由他自己挖掘

我们给定了标签,限制了模型就干啥,就比如我就被限制要好好学习从而没能。。

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

咕泡出品 必属精品

UNet++模型本身并不是直接用于图片分类的,而是主要用于图像分割任务,特别是医学图像分割。UNet++是UNet模型的一个改进版本,通过引入深度监督和密集跳跃连接来增强特征提取和融合的能力,从而提高了分割精度。 然而,如果你希望使用类似UNet++的结构进行图片分类任务,你可以进行一些调整。一种可能的方法是将UNet++的解码器部分(即上采样和特征融合部分)替换为一个全局平均池化层和一个全连接层,以便输出分类结果。 以下是一个大致的步骤,描述如何将UNet++结构适应于图片分类任务: 编码器部分:保持UNet++的编码器部分不变,这部分主要用于从输入图像中提取特征。编码器通常由多个下采样块组成,每个块包含卷积层、归一化层和激活函数。 特征融合:在编码器部分,不同层次的特征图可以通过跳跃连接进行融合。这些融合的特征图有助于捕获不同尺度的信息。 替换解码器:在UNet++中,解码器部分负责将融合后的特征图上采样到与原始输入图像相同的尺寸。然而,在图片分类任务中,我们不需要这样的上采样过程。因此,你可以将解码器部分替换为一个全局平均池化层,用于将特征图转换为一个固定大小的特征向量

E.zip (2个子文件)

E.zip (2个子文件)  unet++.zip 409.6MB

unet++.zip 409.6MB 对比学习.pdf 1.96MB

对比学习.pdf 1.96MB

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益

我的收益  我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜

信息提交成功

信息提交成功