没有合适的资源?快使用搜索试试~ 我知道了~

温馨提示

试读

12页

随机森林算法 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学习5—分类算法之随机森林(Random Forest).pdf 机器学

资源推荐

资源详情

资源评论

随机森林(随机森林(Random Forest))

前言

一、随机森林

1.什么是随机森林

2.随机森林的特点

3.随机森林的生成

二、随机森林的函数模型

三、随机森林算法实现

1.数据的读取

2.数据的清洗和填充

3.数据的划分

4.代码的实现

总结

前言前言

随机森林(随机森林(Random Forest)) 是Bagging(一种并行式的集成学习方法)的一个拓展体,它的基学习器固定为决策

树,多棵树也就组成了森林,而“随机”则在于选择划分属性的随机,随机森林在训练基学习器时,也采用有放回采样的

方式添加样本扰动,同时它还引入了一种属性扰动,即在基决策树的训练过程中,在选择划分属性时,Random Forest

先从候选属性集中随机挑选出一个包含K个属性的子集,再从这个子集中选择最优划分属性,一般推荐K=log2(d)。

这样随机森林中基学习器的多样性不仅来自样本扰动,还来自属性扰动,从而进一步提升了基学习器之间的差异度。

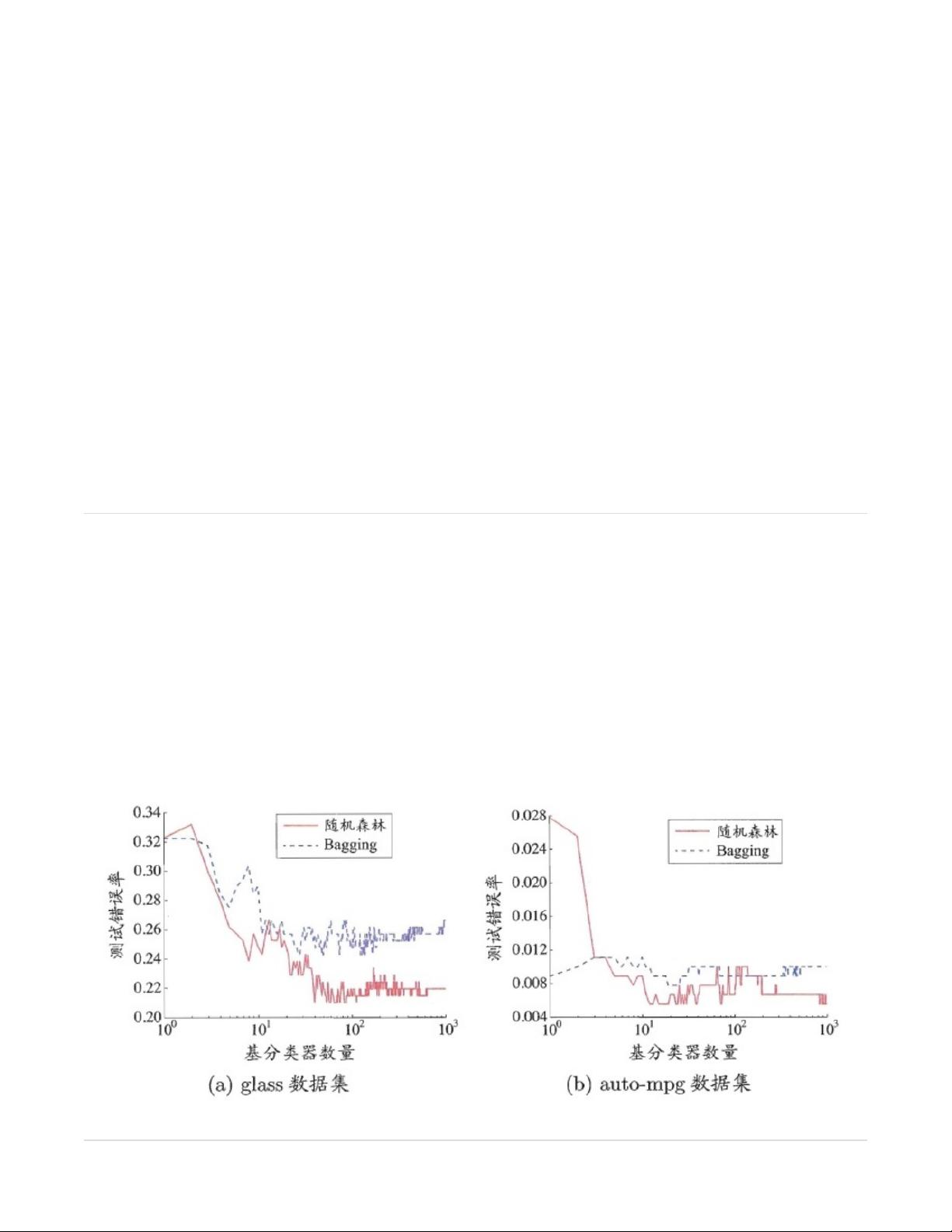

相比决策树的Bagging集成,随机森林的起始性能较差(由于属性扰动,基决策树的准确度有所下降),但随着基学

习器数目的增多,随机森林往往会收敛到更低的泛化误差。同时不同于Bagging中决策树从所有属性集中选择最优划

分属性,随机森林只在属性集的一个子集中选择划分属性,因此训练效率更高。

提示:以下是本篇文章正文内容,下面案例可供参考

一、随机森林一、随机森林

1.什么是随机森林什么是随机森林

随机森林就是通过集成学习的思想将多棵树集成的一种算法,它的基本单元是决策树,而它的本质属于机器学习的一大

分支——集成学习(Ensemble Learning)方法。随机森林的名称中有两个关键词,一个是“随机”,一个就是“森林”。“森

林”我们很好理解,一棵叫做树,那么成百上千棵就可以叫做森林了,这样的比喻还是很贴切的,其实这也是随机森林的

主要思想–集成思想的体现。

从直观角度来解释,每棵决策树都是一个分类器(假设现在针对的是分类问题),那么对于一个输入样本,N棵树会有N

个分类结果。而随机森林集成了所有的分类投票结果,将投票次数最多的类别指定为最终的输出,这就是一种最简单的

Bagging 思想。

2.随机森林的特点随机森林的特点

随机森林主页:Random Forest。

随机森林的优缺点随机森林的优缺点

优点:优点:

1) 每棵树都选择部分样本及部分特征,一定程度避免过拟合;

2) 每棵树随机选择样本并随机选择特征,使得具有很好的抗噪能力,性能稳定;

3) 能处理很高维度的数据,并且不用做特征选择(不需要降维处理);

4) 适合并行计算;

5) 实现比较简单。

缺点:缺点:

1) 参数较复杂;

2) 模型训练和预测都比较慢。

3.随机森林的生成随机森林的生成

随机森林中有许多的分类树。我们要将一个输入样本进行分类,我们需要将输入样本输入到每棵树中进行分类。打个形

象的比喻:森林中召开会议,讨论某个动物到底是老鼠还是松鼠,每棵树都要独立地发表自己对这个问题的看法,也就

是每棵树都要投票。该动物到底是老鼠还是松鼠,要依据投票情况来确定,获得票数最多的类别就是森林的分类结果。

森林中的每棵树都是独立的,99.9%不相关的树做出的预测结果涵盖所有的情况,这些预测结果将会彼此抵消。少数优

秀的树的预测结果将会超脱于芸芸“噪音”,做出一个好的预测。将若干个弱分类器的分类结果进行投票选择,从而组成

一个强分类器,这就是随机森林bagging的思想(关于关于bagging的一个有必要提及的问题:的一个有必要提及的问题:bagging的代价是不用单的代价是不用单

棵决策树来做预测,具体哪个变量起到重要作用变得未知,所以棵决策树来做预测,具体哪个变量起到重要作用变得未知,所以 bagging改进了预测准确率但损失了解释改进了预测准确率但损失了解释

性。性。 )。下图可以形象地描述这个情况:

森林中树的生成规则为:

1)如果训练集大小为N,对于每棵树而言,随机且有放回地从训练集中的抽取N个训练样本(这种采样方式称为

bootstrap

sample方法),作为该树的训练集;

剩余11页未读,继续阅读

资源评论

BJWcn2023-07-27这个文件的语言通俗易懂,让我即使是初学者也能够轻松理解其中的概念和原理。

BJWcn2023-07-27这个文件的语言通俗易懂,让我即使是初学者也能够轻松理解其中的概念和原理。 柔粟2023-07-27这个文件给出了一些常见问题和解决方案,对我理解随机森林算法的思路有了很大帮助。

柔粟2023-07-27这个文件给出了一些常见问题和解决方案,对我理解随机森林算法的思路有了很大帮助。 查理捡钢镚2023-07-27这个文件很详细地介绍了随机森林算法,让我对它有了更深入的了解。

查理捡钢镚2023-07-27这个文件很详细地介绍了随机森林算法,让我对它有了更深入的了解。 焦虑肇事者2023-07-27这个文件还介绍了一些随机森林算法的扩展和改进方法,让我对其未来的发展方向有了一些思考。

焦虑肇事者2023-07-27这个文件还介绍了一些随机森林算法的扩展和改进方法,让我对其未来的发展方向有了一些思考。 邢小鹏2023-07-27这个文件提供了很多实例和案例,帮助我更好地理解随机森林算法的应用场景。

邢小鹏2023-07-27这个文件提供了很多实例和案例,帮助我更好地理解随机森林算法的应用场景。

快乐无限出发

- 粉丝: 1126

- 资源: 7260

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- Screenshot_20240427_031602.jpg

- 网页PDF_2024年04月26日 23-46-14_QQ浏览器网页保存_QQ浏览器转格式(6).docx

- 直接插入排序,冒泡排序,直接选择排序.zip

- 在排序2的基础上,再次对快排进行优化,其次增加快排非递归,归并排序,归并排序非递归版.zip

- 实现了7种排序算法.三种复杂度排序.三种nlogn复杂度排序(堆排序,归并排序,快速排序)一种线性复杂度的排序.zip

- 冒泡排序 直接选择排序 直接插入排序 随机快速排序 归并排序 堆排序.zip

- 课设-内部排序算法比较 包括冒泡排序、直接插入排序、简单选择排序、快速排序、希尔排序、归并排序和堆排序.zip

- Python排序算法.zip

- C语言实现直接插入排序、希尔排序、选择排序、冒泡排序、堆排序、快速排序、归并排序、计数排序,并带图详解.zip

- 常用工具集参考用于图像等数据处理

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功