没有合适的资源?快使用搜索试试~ 我知道了~

卷积神经网络CNN原理、改进及应用.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 108 浏览量

2023-03-13

20:11:07

上传

评论

收藏 3.32MB DOCX 举报

温馨提示

试读

35页

。

资源推荐

资源详情

资源评论

--本页仅作为文档封面,使用时请直接删除即可--

--内页可以根据需求调整合适字体及大小--

卷积神经网络(CNN)

一、简介

卷积神经网络(Convolutional Neural Networks,简称 CNN)是近年发展起

来,并引起广泛重视的一种高效的识别方法。

1962 年,Hubel 和 Wiesel 在研究猫脑皮层中用于局部敏感和方向选择的神

经元时发现其独特的局部互连网络结构可以有效地降低反馈神经网络的复杂

性,继而提出了卷积神经网络 (Convolutional Neural Networks-简称 CNN)

[1]

7863

。现在,CNN 已经成为众多科学领域的研究热点之一,特别是在模式分类领

域,由于该网络避免了对图像的复杂前期预处理,可以直接输入原始图像,因

而得到了更为广泛的应用。

Fukushima 在 1980 年基于神经元间的局部连通性和图像的层次组织转换,

为解决模式识别问题,提出的新识别机(Neocognitron)是卷积神经网络的第

一个实现网络 。他指出,当在不同位置应用具有相同参数的神经元作为前一层

[2]

的 patches 时,能够实现平移不变性 。随着 1986 年 BP 算法以及 T-C 问题

1296

[3]

(即权值共享和池化) 的提出,LeCun 和其合作者遵循这一想法,使用误差

9508

梯度(the error gradient)设计和训练卷积神经网络,在一些模式识别任务中

获得了最先进的性能 。在 1998 年,他们建立了一个多层人工神经网络,被

[4][5]

称为 LeNet-5 ,用于手写数字分类,这是第一个正式的卷积神经网络模型 。

[5]

3579

类似于一般的神经网络,LeNet-5 有多层,利用 BP 算法来训练参数。它可以获

得原始图像的有效表示,使得直接从原始像素(几乎不经过预处理)中识别视

觉模式成为可能。然而,由于当时大型训练数据和计算能力的缺乏,使得

2

LeNet5 在面对更复杂的问题时,如大规模图像和视频分类,不能表现出良好

的性能。

因此,在接下来近十年的时间里,卷积神经网络的相关研究趋于停滞,原

因有两个:一是研究人员意识到多层神经网络在进行 BP 训练时的计算量极其

之大,当时的硬件计算能力完全不可能实现;二是包括 SVM 在内的浅层机器学

习算法也渐渐开始暂露头脚。直到 2006 年,Hinton 终于一鸣惊人,在《科

学》上发表文章,使得 CNN 再度觉醒,并取得长足发展。随后,更多的科研工

作者对该网络进行了改进。其中,值得注意的是 Krizhevsky 等人提出的一个经

典的 CNN 架构,相对于图像分类任务之前的方法,在性能方面表现出了显着的

改善 。他们方法的整体架构,即 AlexNet (也叫 ImageNet),与 LeNet5

2674

[9]

相似,但具有更深的结构。它包括 8 个学习层(5 个卷积与池化层和 3 个全连

接层),前边的几层划分到 2 个 GPU 上,(和 ImageNet 是同一个)并且它在

卷积层使用 ReLU 作为非线性激活函数,在全连接层使用 Dropout 减少过拟

合。该深度网络在 ImageNet 大赛上夺冠,进一步掀起了 CNN 学习热潮。

一般地,CNN 包括两种基本的计算,其一为特征提取,每个神经元的输入

与前一层的局部接受域相连,并提取该局部的特征。一旦该局部特征被提取

后,它与其它特征间的位置关系也随之确定下来;其二是特征映射,网络的每

个计算层由多个特征映射组成,每个特征映射是一个平面,平面上所有神经元

的权值相等。特征映射结构采用影响函数核小的 sigmoid 函数作为卷积网络的

激活函数,使得特征映射具有位移不变性。此外,由于一个映射面上的神经元

共享权值,因而减少了网络自由参数的个数。这两种操作形成了 CNN 的卷积

层。此外,卷积神经网络中的每一个卷积层都紧跟着一个用来求局部平均与二

3

次提取的计算层,即池化层,这种特有的两次特征提取结构减小了特征分辨

率。

CNN 主要用来识别位移、缩放及其他形式扭曲不变性的二维图形。由于

CNN 的特征检测层通过训练数据进行学习,所以在使用 CNN 时,避免了显式

地特征抽取,而隐式地从训练数据中进行学习;再者由于同一特征映射面上的

神经元权值相同,所以网络可以并行学习,这也是卷积网络相对于神经元彼此

相连网络的一大优势。卷积神经网络以其局部权值共享的特殊结构在语音识别

和图像处理方面有着独特的优越性,其布局更接近于实际的生物神经网络,权

值共享降低了网络的复杂性,特别是多维输入向量的图像可以直接输入网络这

一特点避免了特征提取和分类过程中数据重建的复杂度。

注:红色数字表示相应文献的引用量。

二、卷积神经网络 vs 神经网络

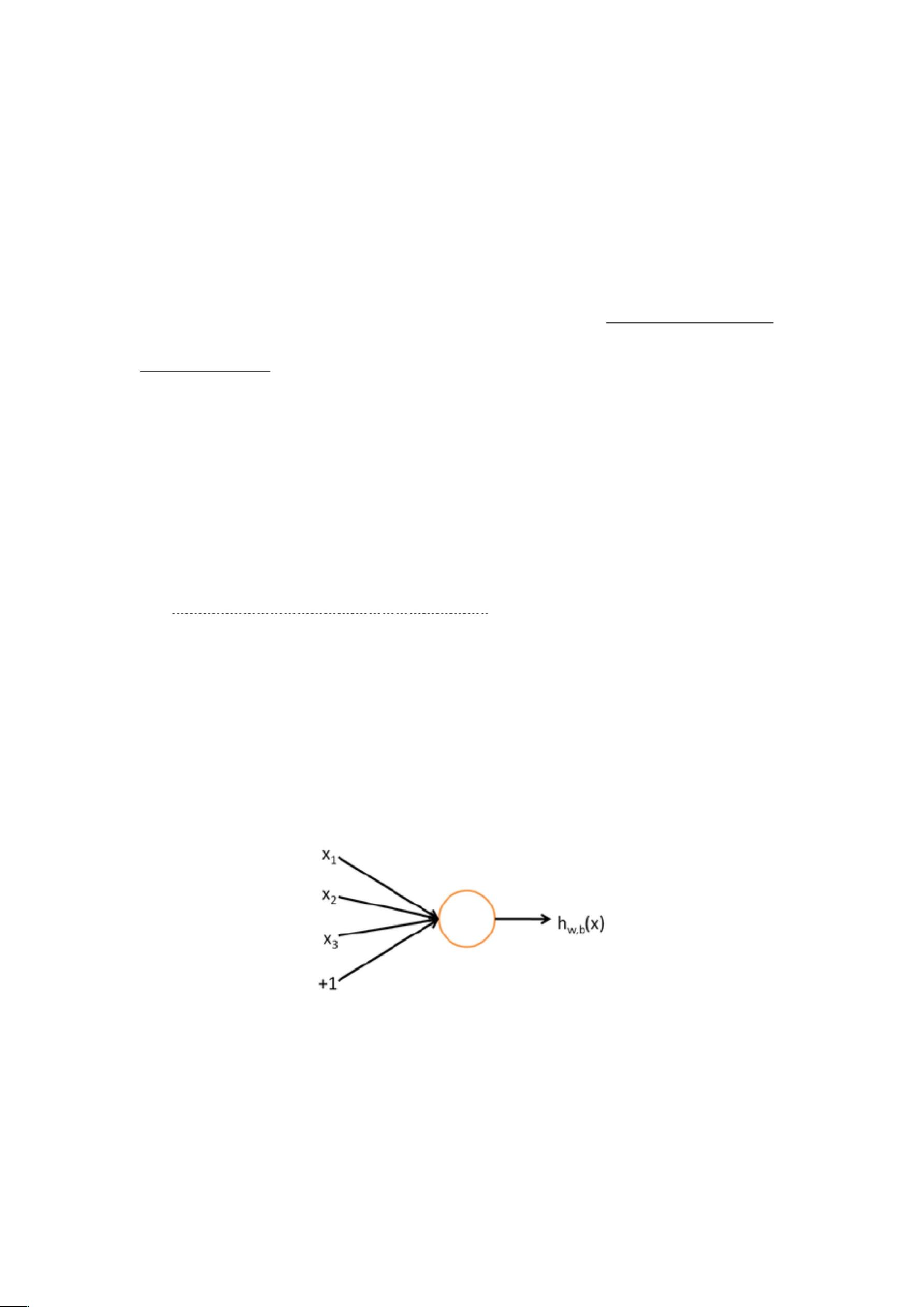

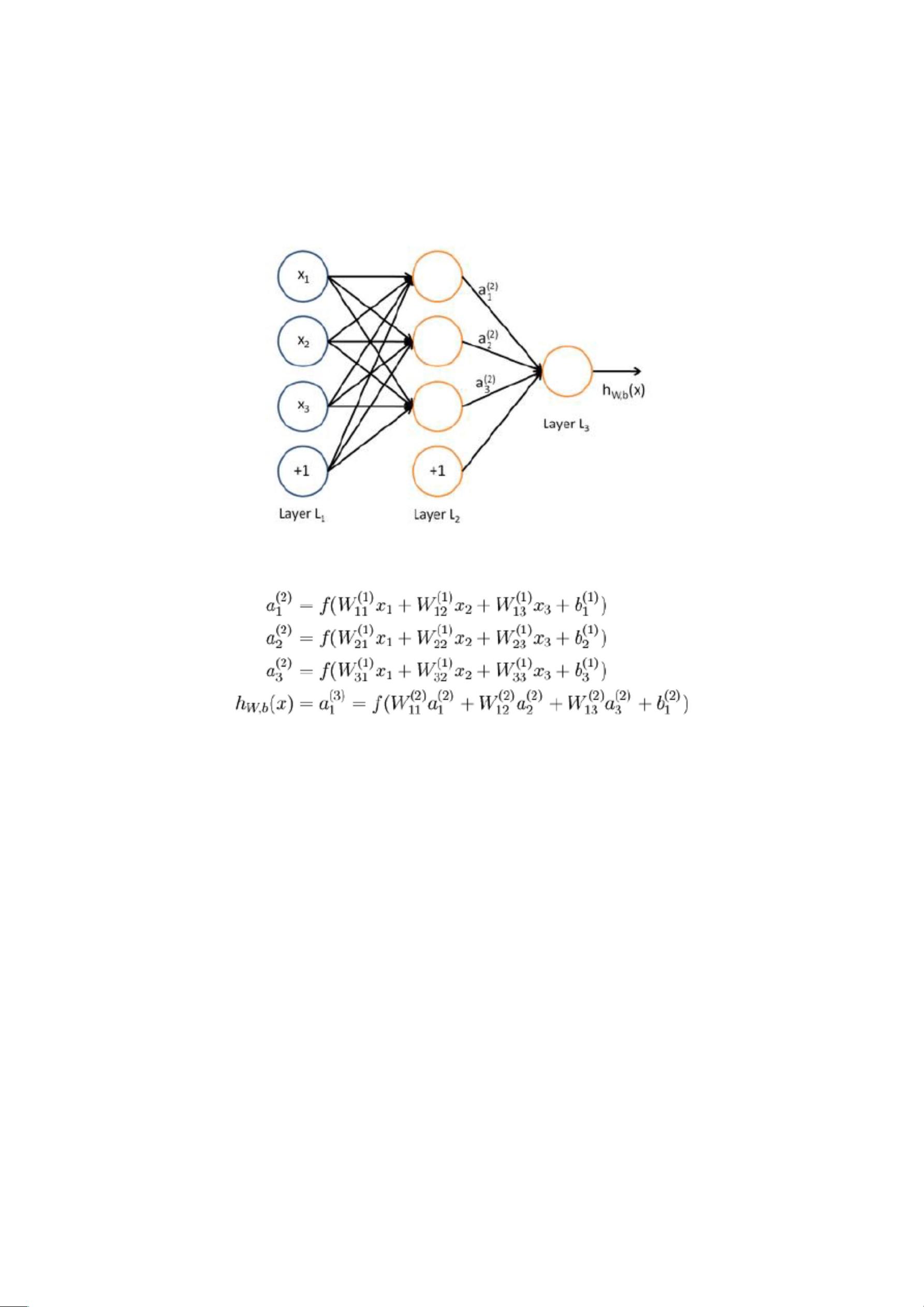

神经网络

首先简要介绍下神经网络。神经网络的每个单元如下:

其对应的公式如下:

3

ℎ

ℎ

,

ℎ

(

ℎ

) =

ℎ

(

ℎ

ℎ) ℎ

ℎ ℎ

+ ℎ)

ℎ

= (∑

ℎ

ℎ

ℎ=1

4

其中,该单元也可以被称作是 Logistic 回归模型。当将多个单元组合起来并

具有分层结构时,就形成了神经网络模型。下图展示了一个具有一个隐含层的

神经网络。

其对应的公式如下:

比较类似的,可以拓展到有2,3,4,5, …个隐含层。

神经网络的训练方法也同 Logistic 类似,不过由于其多层性,还需要利用链

式求导法则对隐含层的节点进行求导,即梯度下降+链式求导法则,专业名称

为反向传播。

神经网络的权值调整过程如下(BP 算法):

5

剩余34页未读,继续阅读

资源评论

若♡

- 粉丝: 6193

- 资源: 1万+

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功