没有合适的资源?快使用搜索试试~ 我知道了~

大数据原理与应用课程设计

需积分: 0 4 下载量 96 浏览量

2023-06-24

11:08:26

上传

评论 3

收藏 6.74MB DOCX 举报

温馨提示

试读

34页

已经学习过大数据相关课程(比如入门级课程《大数据技术原理与应用》),了解大数据相关技术的基本概念与原理,了解Windows操作系统、Linux操作系统、大数据处理架构Hadoop的关键技术及其基本原理、列族数据库HBase概念及其原理、数据仓库概念与原理、关系型数据库概念与原理、R语言概念与应用等。 本数据内容有 步骤一:本地数据集上传到数据仓库Hive 步骤二:Hive数据分析 步骤三:Hive、MySQL、HBase数据互导 步骤四:利用R进行数据可视化分析

资源推荐

资源详情

资源评论

大数据课程综合实验案例

1.案例目的

1) 熟悉 Linux 系统、MySQL、Hadoop、HBase、Hive、R、Eclipse 等系统和软件的安

装和使用;

2) 了解大数据处理的基本流程;

3) 熟悉数据预处理方法;

4) 熟悉在不同类型数据库之间进行数据相互导入导出;

5) 熟悉使用 R 语言进行可视化分析;

6) 熟悉使用 Eclipse 编写 Java 程序操作 HBase、Hive 和 MySQL。

2.预备知识

需要案例使用者,已经学习过大数据相关课程(比如入门级课程《大数据技术原理与应

用》),了解大数据相关技术的基本概念与原理,了解 Windows 操作系统、Linux 操作系统、

大数据处理架构 Hadoop 的关键技术及其基本原理、列族数据库 HBase 概念及其原理、数

据仓库概念与原理、关系型数据库概念与原理、R 语言概念与应用等。

3.时间安排

建议一周左右完成案例内容

4.硬件要求

本案例可以在单机上完成,也可以在集群环境下完成。单机上完成本案例实验时,建议

计算机硬件配置为:50GB 以上硬盘,8GB 以上内存。

5.软件工具

1) Linux: Ubuntu16.04(或 18.04)

2) MySQL: 5.7.29

3) Hadoop: 3.1.3

4) HBase:2.2.2

5) Hive:3.1.2

6) R:3.2.3

7) Eclipse:3.8

6.数据集

见 PPT 或者资料。

7.案例任务

为了顺利完成本案例各项实验,需要完成以下系统和软件的安装:

1) 安装 Linux 系统:如果未安装,请参照“第 2 章 Linux 系统的安装和使用” 的相关内

容,完成 Linux 系统的安装。

2) 安装 Hadoop:如果未安装,请参照“第 3 章 Hadoop 的安装和使用” 的相关内容,

完成 Hadoop 的安装。

3) 安装 MySQL:如果未安装,请参照“附录 B:Linux 系统中的 MySQL 安装及常用操

作”的相关内容,完成 MySQL 的安装。

4) 安装 HBase:如果未安装,请参照“第 5 章 HBase 的安装和基础编程”中的相关内

容,完成 HBase 的安装。

5) 安装 Hive:如果未安装,请参照“第 8 章 数据仓库 Hive 安装和使用”的相关内容,

完成 Hive 的安装。

6) 安装 Eclipse:如果未安装,请参照“第 2 章 Linux 系统的安装和使用”的相关内容,

在 Linux 系统的安装 Eclipse。

8.实验步骤概述

本案例共包含 4 个实验步骤:

步骤一:本地数据集上传到数据仓库 Hive

步骤二:Hive 数据分析

步骤三:Hive、MySQL、HBase 数据互导

步骤四:利用 R 进行数据可视化分析

9.报告形式

分别按照实验步骤形式,完成上述四个步骤,可结合 PPT 中代码和内容。

1. 本地数据集上传到数据仓库 Hive

(1)把数据集 user.zip 文件下载到 Linux 系统的“/home/hadoop/下载/”目录下面,把

user.zip 进行解压缩,需要首先建立一个用于运行本案例的目录 bigdatacase,运行 PPT 中代

码,粘贴代码以及运行结果截图。

(2)执行命令取出前面 10 条记录命令及其结果截图。

(3)删除文件某行记录(即字段名称)

(4)对字段进行预处理

(5)导入数据库相关代码和结果截图,(上传 HDFS 和 Hive 创建数据库、创建外部表、

查询数据)

2. Hive 数据分析(要求截屏代码和结果截图)

1) 简单查询分析

2) 查询条数统计分析

3) 关键字条件查询分析

4) 根据用户行为分析

5) 用户实时查询分析

3. Hive、MySQL、HBase 数据互导(按照 PPT 操作,代码截图和运行结果截图)

1) Hive 预操作

2) 使用 Java API 将数据从 Hive 导入 MySQL

3) 使用 HBase Java API 把数据从本地导入到 HBase 中

4.利用 R 进行数据可视化分析(按照 PPT 操作,代码截图和运行结果截图)

1) 安装 R

2) 安装依赖库

3) 可视化分析

5.完成本次课程设计过程中遇到的问题和解决过程。

6.完成本次课程设计的心得体会和感受。

10 报告模板

实验报告题目:

学号:

姓 名:

日期:2023-6-23

实验环境:

实验内容与完成情况:

1. 本地数据集上传到数据仓库 Hive

(1)把数据集 user.zip 文件下载到 Linux 系统的“/home/hadoop/下载/”目录下面,

把 user.zip 进行解压缩,需要首先建立一个用于运行本案例的目录 bigdatacase,运行 PPT

中代码,粘贴代码以及运行结果截图。

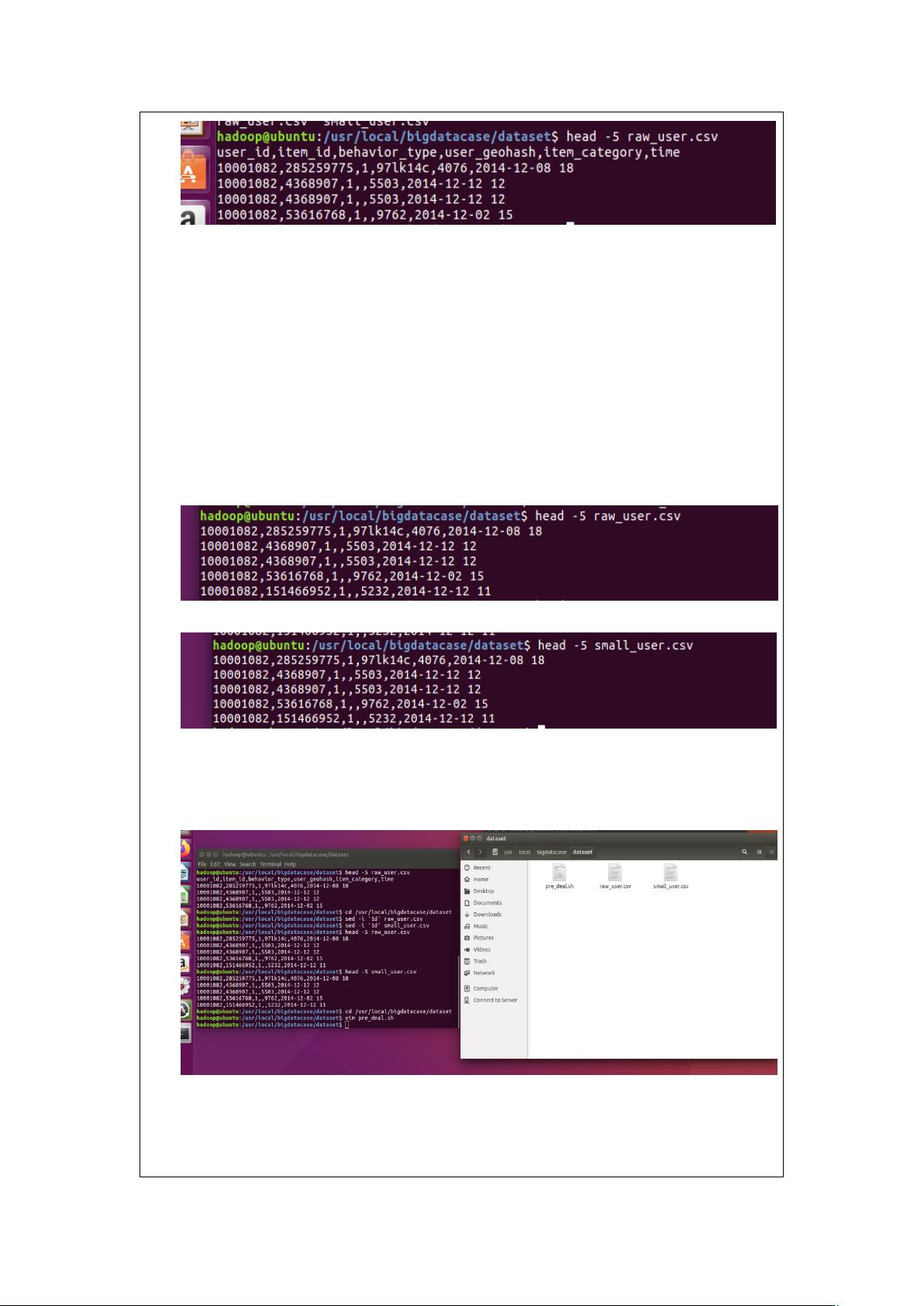

$ cd /usr/local

$ ls

$ sudo mkdir bigdatacase

$ sudo chown -R hadoop:hadoop ./bigdatacase

$ cd bigdatacase

$ mkdir dataset

$ cd ~ //表示进入 hadoop 用户的目录

$ cd Dwonloads

$ ls

$ unzip user.zip -d /usr/local/bigdatacase/dataset

$ cd /usr/local/bigdatacase/dataset

$ ls

$ head -5 raw_user.csv

(2)删除文件某行记录(即字段名称)

$ cd /usr/local/bigdatacase/dataset

#下面删除 raw_user 中的第 1 行

$ sed -i '1d' raw_user.csv

#上面的 1d 表示删除第 1 行,同理,3d 表示删除第 3 行,nd 表示删除第 n 行

#下面删除 small_user 中的第 1 行

$ sed -i '1d' small_user.csv

#下面再用 head 命令去查看文件的前 5 行记录,就看不到字段名称这一行了

$ head -5 raw_user.csv

$ head -5 small_user.csv

(3)对字段进行预处理

$ cd /usr/local/bigdatacase/dataset

$ vim pre_deal.sh

$ cd /usr/local/bigdatacase/dataset

(4)执行命令取出前面 10 条记录命令及其结果截图。

$ bash ./pre_deal.sh small_user.csv user_table.txt

剩余33页未读,继续阅读

资源评论

Tender675

- 粉丝: 0

- 资源: 1

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功