没有合适的资源?快使用搜索试试~ 我知道了~

基于深度学习的高噪声图像去噪算法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 52 浏览量

2023-02-23

20:16:19

上传

评论

收藏 358KB DOCX 举报

温馨提示

试读

12页

基于深度学习的高噪声图像去噪算法.docx

资源推荐

资源详情

资源评论

在实际应用中, 数字图像在传输过程中往往会受到成像设备与外部噪声环境干扰等因

素的影响, 导致采集的图像质量明显下降.鉴于计算机视觉等许多科学领域对图像质量提出

更高的要求, 因此图像去噪仍然是图像处理领域的热点研究课题之一.

在过去的几十年里, 随着对图像噪声的深入研究, 许多学者不断地提出新的图像去噪

算法.三维块匹配(Block-matching and 3D filtering, BM3D)算法

[1]

能够充分挖掘自然图像中存

在的自相似特性, 通过对相似块进行域变换进而达到图像的去噪效果.非局部算法

[2]

从图像

整体的角度出发, 同时利用了局部平滑与全局自相似等特性, 取得了很好的去噪效果.

随着深度学习逐渐成为机器学习领域的研究热点, 深度卷积神经网络

[3-5]

在图像特征提

取与识别

[6-8]

等领域的成功应用为解决图像去噪问题提供了新的思路, 尤其是高噪声环境下

的图像去噪问题.与传统的图像去噪方法相比, 深度卷积神经网络具有更强大的学习能力,

通过使用大量含噪图像样本数据进行训练, 能够有效地提高网络模型对不同标准噪声的适

应能力, 并使其具有更强的泛化能力.

在文献[9]中, Jain 等提出一种全新的卷积神经网络结构, 并将其应用于图像去噪, 实验

结果表明该网络模型能够取得与马尔科夫随机场(Markov random field, MRF)模型相当甚至

更好的去噪效果. Burger 等

[10]

提出的算法将多层感知机(Multi-layer perceptron, MLP)成功地

应用于图像去噪.文献[11]提出一个可训练的非线性反应扩散模型 TNRD (Trainable nonlinear

reaction diffusion), 该模型通过展开固定数量的梯度下降前馈深度网络, 提高了图像的去噪

性能.文献[12]中, Xie 等将堆叠稀疏去噪自编码器方法应用于解决高斯噪声的移除并且实现

了与 K-SVD (Singular value decomposition)

[13]

相当的去噪效果.文献[14]中, Zhang 等提出一

种基于深度学习的去噪算法 DnCNN (Feed-forward denoising convolutional neural networks,

DnCNN).该算法采用训练单一的去噪模型实现图像去噪的任务, 同时对未知噪声水平的图

像也有比较好的去噪效果.实验结果表明, 该算法的去噪性能和效率均优于 BM3D.

上述这些经典的图像去噪算法虽然在训练目标设计、训练特征选择以及训练集规模上

各不相同, 并且在低噪声环境下都能取得很好的去噪效果.但是, 这些算法在高噪声环境下

的去噪效果却不太理想.为了进一步改善高噪声环境下的图像去噪质量, 本文提出一种对称

式扩充卷积残差网络图像去噪算法.该算法首先通过对称式结构的卷积网络对输入噪声图像

进行特征提取与学习, 然后对提取的图像特征进行重构, 最后通过整合残差学习和批量标准

化实现图像与噪声的有效分离, 并输出与输入图像尺寸相同的残差图像.为了解决卷积操作

导致的网络内部协变量转移问题, 本文使用批量标准化进行校正, 有效地提高了网络训练的

效率.另外, 本文算法对非卷积后的图像进行零填充操作, 保证在图像大小不变的情况下, 降

低了图像的边界伪影.实验结果表明, 本文提出的算法在去噪性能和效率上都表现得非常好.

1. 深度卷积神经网络相关技术原理

1.1 残差学习

卷积神经网络的残差学习最初的灵感来自于在不断增加网络的深度时, 会出现一个训

练精度退化的问题, 即神经网络的训练精度先上升然后达到饱和, 再持续增加网络深度时则

会导致训练精度下降.因此, 残差学习的提出起初是用来解决神经网络性能的退化问题.在这

里, 它是通过假设残差映射是很容易被学习并且有一个浅层的网络已达到了饱和的准确率,

后面再加上几个 y=xy=x 的全等映射层, 起码误差不会增加, 即更深的网络不应该带来训练

集误差的上升问题, 这里提到的使用全等映射直接将前一层输出传递到后一层的思想就是

残差网络通过一些堆叠层明确地学习残差映射思想的来源.采用残差学习策略使得深度卷积

神经网络很容易被训练并且能更好地提升图像分类和目标检测的精确度.本文与之不同之处

在于采用两个复合残差单元来预测残差图像.

1.2 批量标准化

目前小批量随机梯度下降算法(Stochastic gradient descent, SGD)已广泛用于神经网络模

型的训练.该算法虽然简单有效, 但是在网络训练过程中容易出现内部协变量转移, 进而改

变网络内部非线性输入分配, 导致训练效率降低.因此, 批量标准化(Batch normalization,

BN)

[15]

的提出可以用来解决网络内部协变量转移, 克服深度神经网络难以训练的缺陷, 有效

预防梯度弥散.本文中, 我们在神经网络每一层非线性化之前引入批量标准化操作, 然后结

合归一化、缩放与移位变化等操作来解决网络内部协变量转变的问题.每一个激活函数在批

量标准化过程中只需要添加两个参数, 它们通过反向传播进行更新.这种机制能够加快训练

过程中的收敛速度, 提高模型的精确度, 降低模型初始化具有的敏感性.

1.3 高噪声环境下 Leaky ReLU 函数的作用

Leaky ReLU 函数

[16-17]

的提出是基于 ReLU 函数的改进, 它不仅具有 ReLU 函数的优点,

而且能够修正数据分布, 在网络的训练过程中使得阈值为负的神经元得到了训练和更新, 这

样阈值为负的神经元信息就得到了一定的保留, 同时也提升了网络的拟合能力.鉴于高噪声

环境下, 图像内部可利用的有效信息相对较少, 因此在网络训练过程中, 我们需要更加充分

地挖掘和利用图像的有效信息, 提取和学习图像特征. Leaky ReLU 函数在网络训练过程中

能够更好地保留图像的有效信息, 获得最佳的去噪效果.另外, 本文采用 Msra 高斯分布对神

经网络的权重值进行初始化, 并且该权重初始化服从(0,2/n)(0,2/n)的高斯分布.实验证明这

种初始化方法能够更好地适应 Leaky ReLU 函数, 加快梯度在网络结构中更新, 从而使得本

文算法在高噪声环境下也能够取得较好的去噪效果.

2. 基于深度学习的高噪声图像去噪算法

本文研究的高噪声图像去噪算法是针对加性白高斯噪声, 其模型定义为

Y=X+NY=X+N

(1)

其中, XX 是原始无噪图像, NN 是分布为 N(0,σ2)N(0,σ2)的噪声图像, σσ 为噪声标准

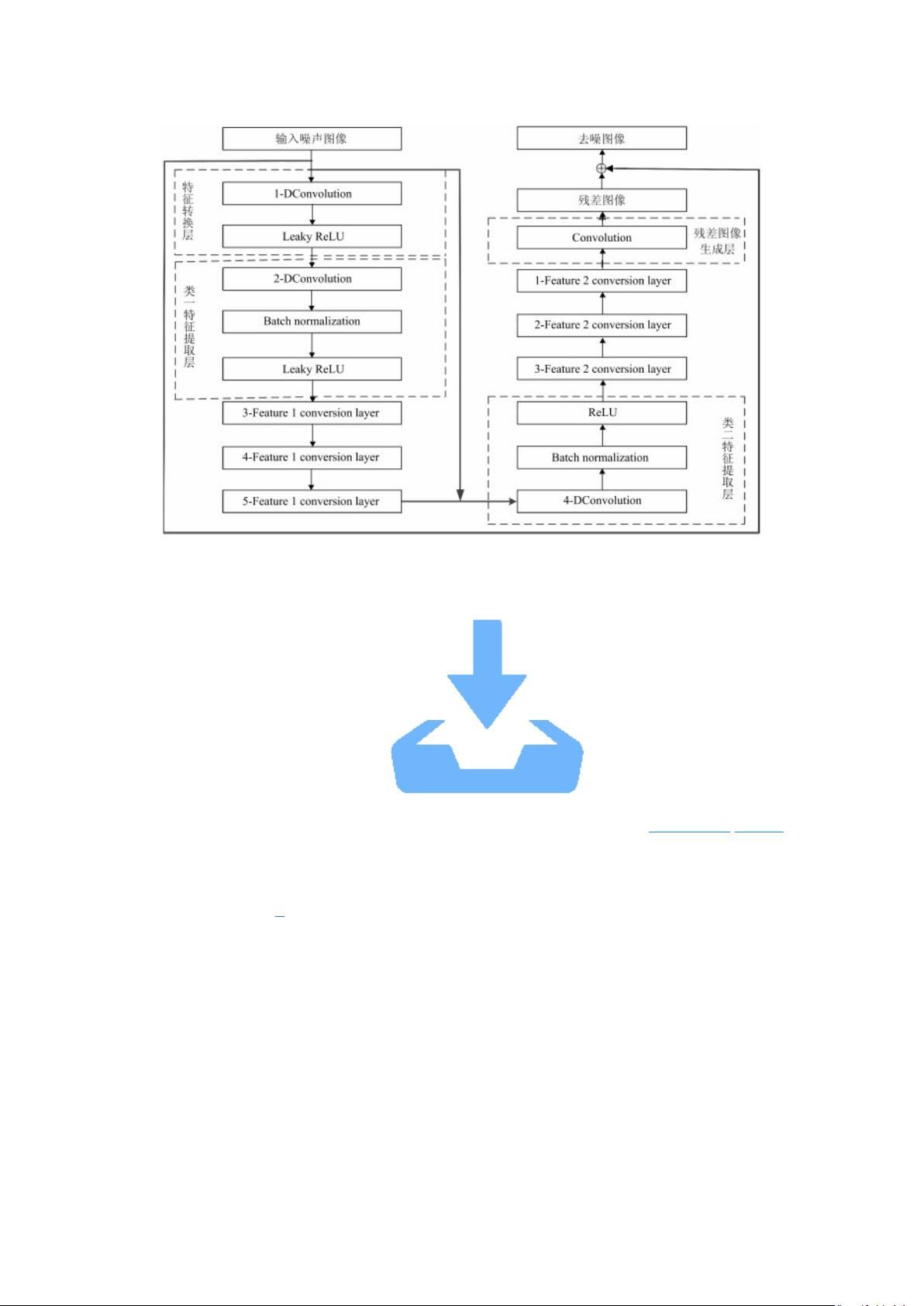

差, YY 是含噪图像.本文提出的基于对称式扩充卷积残差网络模型结构示意图如图 1 所示.

图 1 本文模型结构示意图

Fig. 1 The structure of the proposed model

下载: 全尺寸图片 幻灯片

2.1 网络深度

根据 VGGNet

[18]

中的原则, 首先移除所有的池化层, 然后改进卷积核的大小设置.目前

深度卷积神经网络中最常用的卷积核大小为 3×33×3, 相应深度为 ff 的卷积神经网络的感受

野大小为(2f+1)×(2f+1)(2f+1)×(2f+1).众所周知, 图像的上下文信息有助于对图像中损坏像

素进行恢复.我们在卷积神经网络中, 通过前向卷积操作扩大网络的感受野, 进而得到上下

文信息.尤其在高噪声环境下, 为了恢复图像中损坏的像素, 需要更大的感受野来获得上下

文信息.这增加了网络的计算负担, 需要网络付出计算复杂度和计算效率的代价.

为了解决上述问题, 本文使用一种扩充卷积在神经网络感受野的尺寸大小与网络深度

之间进行权衡.扩充卷积不但具有扩充感受野的能力, 同时也保留了传统 3×33×3 卷积的优

点而得到广泛使用.在本文构建的神经网络中, 从第 1 层至倒数第 2 层均采用扩充卷积, 其

扩充因子分别设置为 1, 2, 3, 4, 5, 4, 3, 2, 1, 最后一层使用 3×33×3 卷积, 网络总深度设置为

剩余11页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3543

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功