没有合适的资源?快使用搜索试试~ 我知道了~

基于启发式深度Q学习的多机器人任务分配算法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 98 浏览量

2023-02-23

20:14:39

上传

评论

收藏 1.23MB DOCX 举报

温馨提示

试读

14页

基于启发式深度Q学习的多机器人任务分配算法.docx

资源推荐

资源详情

资源评论

随着人工智能的发展,多机器人任务分配或任务调度

[1-3]

(multi-robot task allocation,

MRTA)技术受到人们广泛的关注,而多机器人任务分配算法的准确性和时效性直接影响了完成

任务所产生的代价,具有很高的实际研究价值,近年来国内外很多学者对此进行了深入的研究

[4-6]

。

强化学习作为多机器人任务分配领域的一个重要研究方向,主要利用智能体与环境的实时

交互和错误判断机制,获得累积最大奖赏值的方式,训练出算法的最优动作决策序列

[7-8]

。随着

强化学习相关应用领域的快速发展,强化学习在解决单机器人智能决策问题上取得了辉煌的成

就

[9]

。传统的强化学习都是应用于单机器人决策,如何将单智能体强化学习应用到多机器人强

化学习中,国内外学者进行的大量的探索,主要的实现方法为基于值函数。基于值函数的多机

器人强化学习算法主要包括 Q 学习(Q-Learning)、分层强化学习(hierarchical reinforcement

learning, HRL)和深度 Q 学习(deep Q network, DQN)算法

[10-12]

,算法通过结合值函数和奖励函

数来模拟多机器人强化学习中机器人之间的协作和竞争,进而达到全局最优的策略效果。

针对复杂环境下分层强化学习处理多机器人任务分配存在的维度灾难问题。本文提出一种

启发式深度 Q 学习(heuristically accelerated deep Q network,HADQN)算法解决复杂环境下

多机器人任务分配的问题。该算法采用神经网络进行 Q 值的存储和计算,一定程度上避免了强

化学习的维度灾难问题;同时引入轨迹池机制和动态探索因子,在提高算法学习效率、探索能

力的同时,保证了算法的收敛性。

1. 基于 HADQN 算法的 MRTA 算法研究

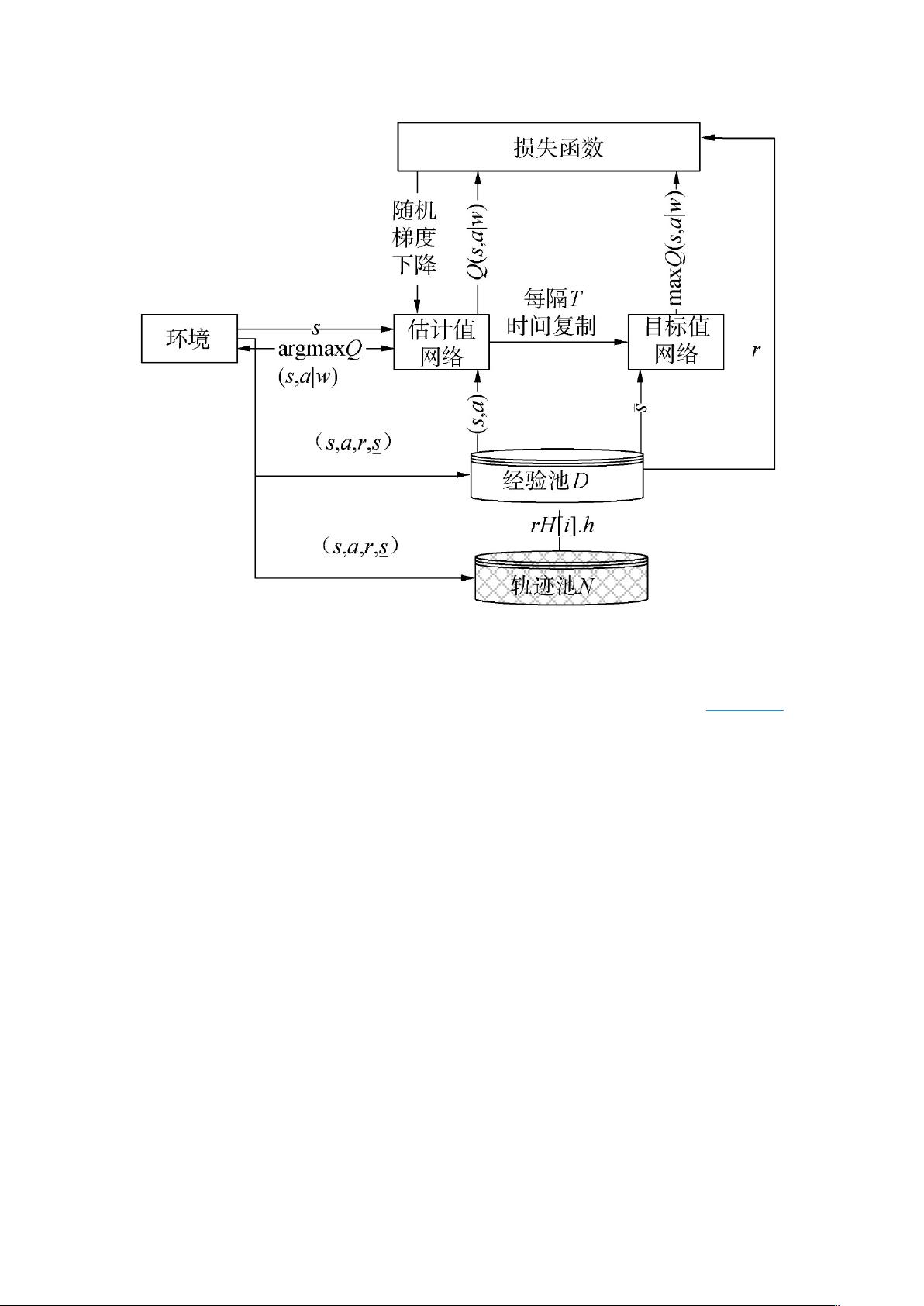

本文提出了可以处理实际应用场景的基于 HADQN 的多机器人多任务分配算法。如图 1

为 HADQN 算法在传统 DQN 算法的基础上引入了轨迹池更新经验池中的数据,促进了 DQN

算法对轨迹池中有效动作的选择。

图 1 HADQN 模型示意

Fig. 1 Schematic diagram of HADQN model

下载: 全尺寸图片

为了更加全面的对 HADQN 算法的运行机理研究,本文从状态-动作空间定义、动作选择

策略、奖赏函数设计、网络结构设计和 HADQN 算法在 MRTA 中的应用等 5 个方面进行介绍。

1.1 状态-动作空间定义

本文采用 HADQN 算法处理多机器人多任务分配问题,针对实际的应用环境对 HADQN

算法的状态空间和动作重新进行定义。

1) 首先本文所提算法在栅格化地图上进行验证,因此可以进行各个机器人位置信息的设

置,定义机器人 R

i

的位置坐标为 p

i

=(p

i

.x, p

i

.y),i∈{1, 2,…,n}(n 为环境中机器人的数目)。

p

i

.x∈{1, 2, 3…, X}(X 为当前实验地图的宽度值),p

i

.y∈{1, 2, 3…, Y}(Y 为当前实验地图的高度

值)。

2) 其次定义状态空间,状态空间要包含当前环境中的所有可能情况,即包括所有机器人

的位置信息、任务点的位置信息和任务点的完成状况。因此结合环境定义 HADQN 算法的状态

空间 S:

$$ \boldsymbol{S}=\left(R_{1}, R_{2}, \cdots, R_{n}, g_{1}, g_{2}, \cdots, g_{m}\right) $$

(1)

式中 g

j

为任务点 j 的完成情况,g

j

∈{0, 1}(0 表示该任务点 j 未完成,1 表示该任务点 j 已

经完成)。

3) 最后定义动作空间,根据环境中的机器人位置信息定义 HADQN 算法的动作空间 A:

$$ \boldsymbol{A}=\left(a_{1}, a_{2}, \cdots, a_{n}\right) $$

(2)

式中 a

i

为机器人 i 选择的动作,a

i

∈{TOP,BOTTOM,LEFT,RIGHT,CENTER},其

中 TOP 表示机器人向上移动一个单位;BOTTOM 表示机器人向下移动一个单位;LEFT 表示

机器人向左移动一个单位;RIGHT 表示机器人向右移动一个单位;CENTER 表示机器人保持

当前位置不动。

1.2 动作选择策略

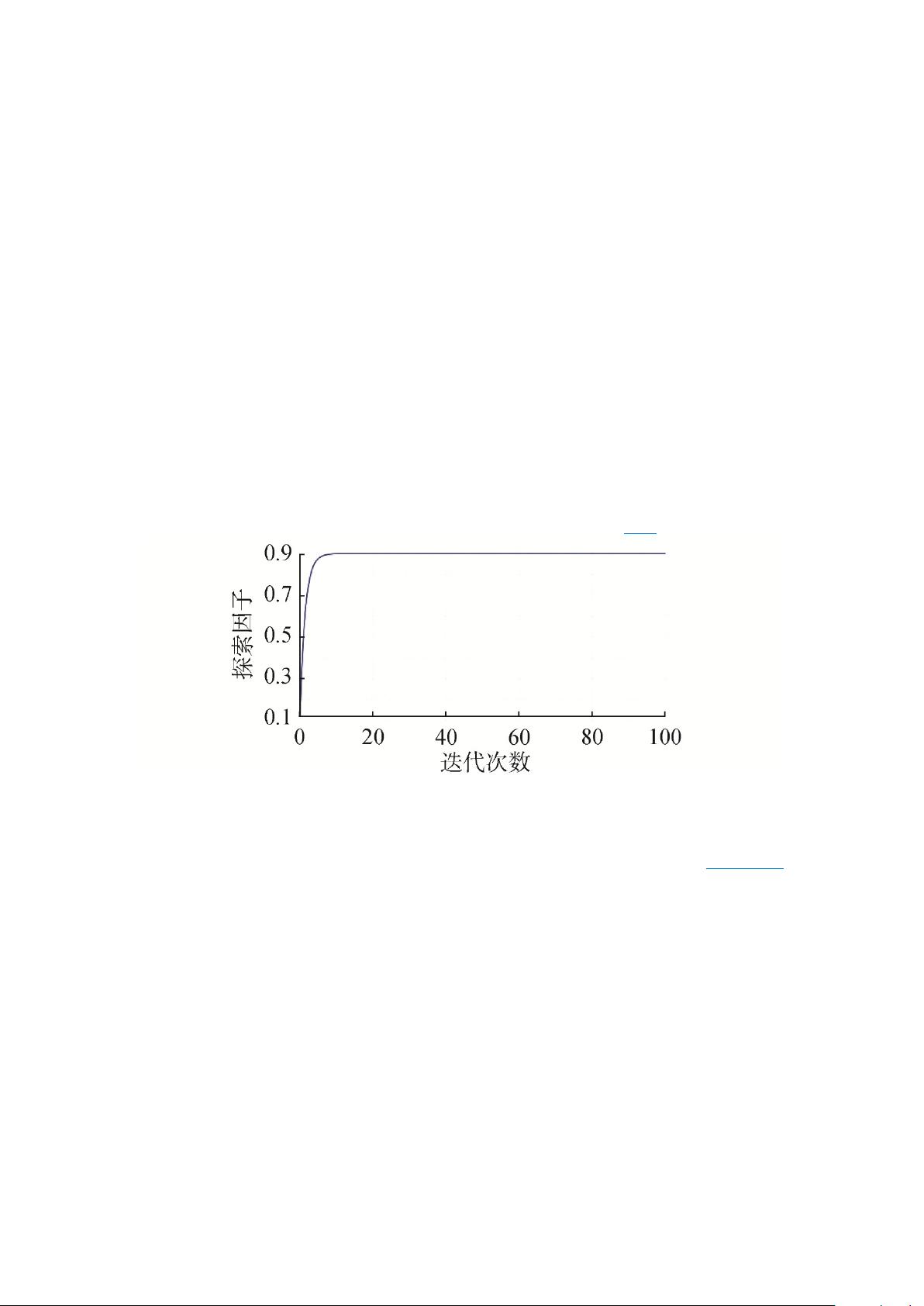

针对 ε-greedy 算法探索因子 ε 取值的问题,提出了一种动态调整 ε 的动作选择策略。即

在算法初期,将探索因子 ε 设置较低的值,保证算法对环境中未知空间的探索;随着迭代次数

的增加,算法对环境的认知能力加大,不断增加探索因子 ε 的值,提高算法对已学习经验的利

用率;同时设置探索因子 ε 的最终值,促进算法对已学习经验的利用(如图 2)。

图 2 探索因子 ε 随着迭代次数 episode 的变化趋势

Fig. 2 Exploratory factor ε change trend graph with the number of iterations

下载: 全尺寸图片

探索因子 ε 的定义为:

$$ \varepsilon=\left\{\begin{array}{l} \varepsilon_{0}+\left(\varepsilon_{\max }-\varepsilon_{0}\right) \times\left(1-\mathrm{e}^{-\text

{episod }}+\mathrm{e}^{-\zeta \times \text { max_episode }}\right) \\ \text {episode } \leqslant \zeta \times \text { max_episode } \\ \varepsilon_{\max }, \text

{ 其他 } \end{array}\right. $$

(3)

式中:ε

max

为一个实数代表探索因子 ε 的最大值,可设置范围 0≤ε

max

< 1;ε

0

为一个实数

代表探索因子 ε 初始值,可设置范围 0≤ε

0

≤ε

max

;episode 为整数变量代表算法当前迭代次数,

episode 的变化范围为[0, max_episode];max_episode 为一个正整数代表算法最大迭代次

数;ζ 为一个实数代表动态系数,可设置范围 0 < ζ < 1。

剩余13页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3542

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功