没有合适的资源?快使用搜索试试~ 我知道了~

基于强化学习的机器人认知情感交互模型.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 124 浏览量

2023-02-23

20:10:40

上传

评论

收藏 393KB DOCX 举报

温馨提示

试读

13页

基于强化学习的机器人认知情感交互模型.docx

资源推荐

资源详情

资源评论

1. 引言

近年来,随着“智能家居”、“智慧社区”以及“智慧城市”等概念的提出与落实,人机交

互成为公众日常生活中不可或缺的一部分。人们期望机器人在满足日常交互需求的同时,

具备生成高级拟人化情感的认知情感计算能力。同时随着心理学、认知科学与人工智能交

叉研究的深入,研究者发现机器智能应体现在“智商”与“情商”两个方面。因此,认知情感

计算成为当前智能机器人研究领域中的热点。

认知情感计算就是要赋予计算机类似于人一样观察、理解和生成各种情绪状态的能

力,使其能够像人一样进行自然亲切、生动有趣的交互

[1]

。近年来,在认知情感计算方

面,涌现出众多具有参考价值的情感模型。文献[2]提出基于 PAD (Pleasure-Arousal-

Dominance)的个性化情感模型,建立个性空间、心情空间与情感空间的 3 层映射关系来描

述人类情感变化规律。文献[3]提出在云、边及用户协作下利用迁移学习进行情感分析,能

有效分析用户的情感状态。文献[4]提出面向时序感知的多类别商品方面情感分析推荐模

型,可推断用户在任意时间对商品的偏好。文献[5]提出基于指导性认知重评策略 GCRs 的

情感交互模型,能降低机器人对外界情感刺激的依赖性,并在一定程度上促进机器人的积

极情感表达。文献[6]提出多情感对话系统 MECS,倾向在对话中产生连贯的情感反应,选

择最相似情感作为机器人响应情感。文献[7]提出情感驱动的自私 MANETS 节点协商机

制,模拟人类出价心理和情感变化提高节点出价竞争力。文献[8]提出 ECM 情绪聊天机,

可以在内容上和情感一致性上产生适当响应。文献[9]提出生成对抗网络 SentiGAN 模型,

在无监督情况下生成不同情绪标签通用的高质量情感文本。文献[10]提出基于句法约束的

双向异步情感会话生成方法 E-SCBA,将情感与主题引入解码增加回复响应的多样性。文

献[11]提出融合强化学习与情感编辑约束的对话生成模型,能同时保证回复生成的流畅度

与情感度。以上工作在一定程度上考虑了情感生成影响因素,但多为在“单轮交互模型”中

加入影响情感生成的不同特征进行认知情感计算,未全面考虑上下文情境对当前情感状态

生成的影响,或仅考虑了某种情感生成影响因素,容易使机器人情感回应合理性不高、参

与人丧失交互意愿。

因此,针对人机交互过程中机器人的情感生成问题,本文依据 PAD 3 维情感空间提出

一种基于强化学习的机器人认知情感交互模型,试图利用强化学习全局统筹特性,建立上

下文多轮情感状态与机器人当前情感响应之间的长期关联关系;利用强化学习奖励引导特

性,实现对参与人进行情感支持、积极性引导以及情感共鸣的情感交互动机。通过考虑多

轮多层次情感影响因素对人机交互过程中的情感生成过程建模以实现情感决策问题,得到

机器人在连续多情感状态空间中的最优响应情感值。

2. 人机交互情感分析

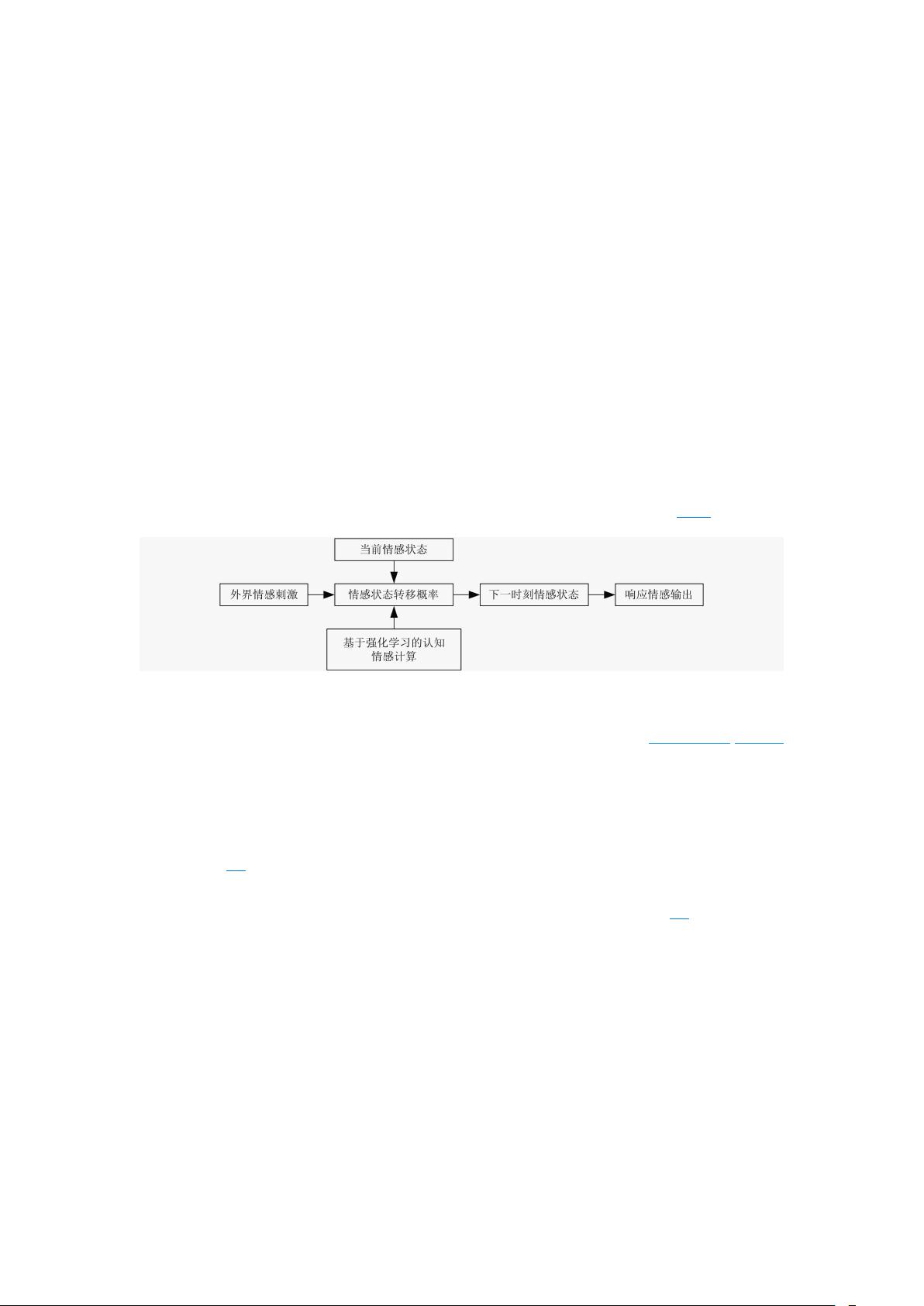

2.1 基于强化学习的认知情感计算

在人类情感生成过程中,个体情感状态响应不仅与外界情感刺激相关,还与自身情感

状态和情感交互动机有关。进行情感状态响应时,不仅要考虑上下文多轮交互情境对当前

情感状态转移概率的影响,还应考虑当前情感状态响应对后续交互关系的影响。因此,为

有效进行机器人情感策略学习,本文提出利用强化学习特性建立上下文多轮情感状态与当

前响应情感状态之间的关联关系,对机器人进行认知情感计算,计算框架如图 1 所示。

图 1 机器人情感计算框架

下载: 全尺寸图片 幻灯片

2.2 基于情感空间的情感状态分析

为便于实现参与人情感状态跟踪,对交互输入内容进行情感量化与状态评估。本文首

先依据文献[12]提供的数据与方法,对交互输入内容进行情感量化,得到其在 PAD 连续情

感空间中对应的情感值${{{E}}_i}{\rm{ = }}(p,a,d)$。其次,依据参考文献[13],对交互情

感值向量${{{E}}_i}$进行状态评估,得到其在 PAD 连续情感空间内 6 种基本情感状态作

用下的情感状态向量${{I}}({{{E}}_i})$。情感状态评估函数定义为

$${{I}}({{{E}}_i}) = [{i_1},{i_2},{i_3},{i_4},{i_5},{i_6}]\;\qquad\qquad\qquad\qquad$$

(1)

$$\left. \begin{aligned} &{i_j} = \frac{{1/{h_j}}}{{\displaystyle\sum\limits_{j = 1}^6

{1/{h_j}} }},\qquad\qquad\qquad\qquad\qquad\quad\;{h_j} \ne 0\\ &{i_1} = 0,\;{i_2} = 0,1, ··· ,\;{i_j} =

1,2, ··· ,\;{i_6} = 0, \end{aligned} \right\}$$

(2)

$${h_j} = {({{{E}}_i} - {{{E}}{_j}})}{{{C}}_j}({{{E}}_i} - {{{E}}_j})^{\rm{T}}{\rm{ ,}}\;{\rm{ }}\;\;\;\;j = 1,2,

\cdots ,6$$

(3)

其中,${{{E}}_i}$表示交互输入情感值;$j = 1,2, ··· ,6$分别表示高兴、惊讶、厌

恶、生气、恐惧、悲伤 6 种基本情感状态;${{{E}}_j}$表示基本情感$j$对应的情感值;

${{{C}}_j}$表示基本情感$j$聚类区域的协方差矩阵;${h_j}$表示${{{E}}_i}$到

${{{E}}_j}$之间的距离;${i_j}$则表示${{{E}}_i}$在${{{E}}_j}$作用下的情感状态评估

值。

3. 基于强化学习的认知情感交互模型

3.1 强化学习定义

强化学习模型原理为:一个智能体(agent),在当前状态(state)下,执行一个行为

(action)与环境(environment)进行交互并进入一个新的状态,同时从环境中获得相应的即

时奖励(reward),再根据奖励评估此行为,利于目标实现的行为其奖励值增加,不利于

目标实现的行为奖励值衰减,此过程不断循环到终止状态为止。

3.1.1 状态

状态 s 表示智能体所处的情感状态,通常由外部环境给出。为减小情感划分粒度,增

加机器人情感表达连续性与细腻性,本文将含有 151 种情感状态的 PAD 连续情感空间作为

智能体的情感状态空间,将空间中各情感状态在 6 种基本情感状态作用下的情感状态向量

${{I}}({{{E}}_i})$作为可能的交互输入响应情感状态。

3.1.2 行为

行为 a 表示智能体在交互响应过程中,选择下一轮响应情感状态时执行的一个动作,

其搜索空间为情感空间大小。智能体在情感空间中的活动过程即情感空间各情感状态间的

马尔可夫转移过程。

3.1.3 折损因子

折损因子 γ 可在环境具有随机性的情况下,用于计算状态序列累积奖励的未来奖励衰

减。本文考虑在距离当前会话越远的将来时刻,未来奖励对用于衡量下一轮会话情感状态

的满意度的影响越小。其值介于 0~1 之间,考虑对未来奖励的重视程度越大,γ 值越大;

反之,γ 值越小。

3.1.4 奖励

奖励 r 可在智能体执行相应动作 a 后,用于衡量所获得情感状态的未来满意度。人机

交互双方在交互过程中均存在一定的情感动机

[4]

。因此,依据社会心理学中人际吸引原则

剩余12页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3654

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功