没有合适的资源?快使用搜索试试~ 我知道了~

一种新型单层递归神经网络解决非光滑伪凸优化问题.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 107 浏览量

2023-02-23

20:05:12

上传

评论

收藏 962KB DOCX 举报

温馨提示

试读

21页

一种新型单层递归神经网络解决非光滑伪凸优化问题.docx

资源推荐

资源详情

资源评论

1. 引言

优化问题常出现在机器学习、图像识别等各类科学和工程应用中。研究学者在非线性

规划、微分包含等理论的基础上,提出了较多用于解决优化问题的神经网络模型。1986

年,Tank 和 Hopfield

[1]

将 Hopfield 神经网络运用到解决线性规划问题中,研究学者由此得

到启发,相继提出各种用于解决优化问题的神经网络模型。1988 年,Kennedy 和 Chua

[2]

提

出了一种包含罚参数的动态非线性规划电路(Nonlinear Programming Circuit, NPC)用于解决

非线性规划问题的神经网络模型,该模型中含有罚参数,且要求目标函数和约束函数都是

光滑的。随着 NPC 的引入,优化问题的研究得到更进一步的发展,由此之后,研究学者提

出了大量的神经网络模型用于解决优化问题。Xue 等人

[3]

基于次梯度方法,提出了一种用

于解决非光滑凸优化问题的单层递归神经网络模型,该模型需要计算精确的罚参数,但精

确罚参数的计算与选取,有时候非常困难,且计算量会很大。同样是解决文献[3]中的非光

滑凸优化问题,Qin 等人

[4]

基于 Tikhonov 正则化方法,提出了一种动态神经网络模型,该

模型不要求可行域是有界的或者目标函数是强制的。后来,Qin 等人

[5]

基于微分包含理论,

提出了一种用于解决这类非光滑凸优化问题的双层神经网络模型,该模型不需要计算精确

的罚参数,且适当放宽假设条件,遗憾的是,网络结构为双层,相对其他单层神经网络增

加了模型复杂度。

随着凸优化问题研究越来越成熟,研究学者发现不能利用上述的神经网络解决科学和

工程应用中常见的非凸优化问题。又因为伪凸优化问题是一类比较特殊的非凸优化问题,

所以,研究伪凸优化问题具有很大的理论指导意义。于是,Li 等人

[6]

基于正则化方法,提

出一种用于解决伪凸优化问题的神经网络模型。但它要求可行域有界,且初始点必须在可

行域中。文献[7]基于惩罚函数思想,提出了一种用于解决包含等式约束和方体约束的非光

滑伪凸优化问题的神经网络模型,但该模型要求计算罚参数。为避免罚参数的计算,

Hosseini

[8]

基于微分包含理论,提出了一种神经网络模型,可是它只能解决包含不等式约束

的非凸优化问题,因此该模型的应用范围受到限制。为更好地解决伪凸优化问题,Qin 等

人

[9]

提出了一种单层神经网络模型,该模型结构简单,不需要罚参数,并且能解决包含等

式约束和不等式约束的非光滑伪凸优化问题。Bian 等人

[10]

基于光滑思想理论,提出了一种

用于解决非光滑伪凸优化问题的神经网络模型,但要求初始点的选取必须在等式可行域

内,由此可知,该模型在实际应用的范围会受到限制。近年来,也有研究者运用神经网络

解决各类具体的优化问题,如高鑫等人

[11]

基于端到端的神经网络模型以提高车辆密集区域

的检测精度。

根据上述已有的神经网络模型以及前人的工作

[12-16]

,本文提出了一种新型单层递归神

经网络模型,用于解决包含等式约束和不等式约束的非光滑伪凸优化问题。与现有的神经

网络相比,本文所提出的神经网络其优势有:(1)不同于文献[5,17],本文的神经网络结构

简单仅为单层;(2)与文献[3,18,19]不同,本文的神经网络不需要计算精确罚参数;(3)与文

献[5-7,10,17,18,20]不同,本文的神经网络在初始点的选取上,没有任何特殊要求;(4)能

解决更一般的优化问题;(5)与其他论文不同,本文直接证明神经网络状态解进入可行域,

而大多数的神经网络会先证明进入等式约束集,再证明进入不等式约束集。

本文组织结构如下:第 2 节介绍研究内容和相关定义;第 3 节介绍神经网络模型;第

4 节对该神经网络模型进行理论分析;第 5 节通过仿真实验验证理论结论的正确性;第 6

节总结全文。

2. 研究内容和相关定义

2.1 主要研究内容

本文主要研究非光滑伪凸优化问题,具体描述为

$$ \left. \begin{aligned} &{{\rm{min}}\;\;\; f({\boldsymbol{x}})}\\ & {\rm{s}}.{\rm{t}}.\;\;\;\; {g({\boldsymbol{x}})

\le 0}\\ &\qquad\ {{\boldsymbol{Ax}} = {\boldsymbol{b}}} \end{aligned} \right\} $$

(1)

其中,${\boldsymbol{x}}={({x}_{1},{x}_{2}, {···},{x}_{n})}^{\rm{T}}\in

{{\mathbb{R}}}^{n}$, $f:{{\mathbb{R}}}^{n}\to {{\mathbb{R}}}$是正则伪凸函数,

${\boldsymbol{g}}={({g}_{1},{g}_{2},{···},{g}_{p})}^{\rm{T}}:{{\mathbb{R}}}^{n}\to

{{\mathbb{R}}}^{p}$是凸函数,${\boldsymbol{A}}\in {{\mathbb{R}}}^{n\times m}$是行满

秩矩阵,${\boldsymbol{b}}=({b}_{1}, {b}_{2},{···}, {b}_{m})^{\rm{T}}\!\in\!

{{\mathbb{R}}}^{m}$。定义等式约束集${{\boldsymbol{S}}}_{1}=\{{\boldsymbol{x}}\in

{{\mathbb{R}}}^{n}:{\boldsymbol{Ax}}\!=\!{\boldsymbol{b}}\}$,不等式约束集

${{\boldsymbol{S}}}_{2}=\{{\boldsymbol{x}}\in

{{\mathbb{R}}}^{n}:{\boldsymbol{g}}({\boldsymbol{x}})\le 0\}$,可行域

${\boldsymbol{S}}={{\boldsymbol{S}}}_{1}\cap {{\boldsymbol{S}}}_{2} $$ =

\{{\boldsymbol{x}}\in {{\mathbb{R}}}^{n}:{\boldsymbol{g}}({\boldsymbol{x}})\le

0,{\boldsymbol{Ax}}={\boldsymbol{b}}\}$。本文中出现的${\rm{int}} (\cdot)$表示内部,

$bd(\cdot)$表示边界上。假设优化问题式(1)有解。

2.2 相关定义

接下来,列出与本文相关的部分必要的定义,使读者更好地理解本文研究内容。

定义 1

[10]

如果对于集合${\boldsymbol{E}}\subset {{\mathbb{R}}}^{n}$上的任意

${\boldsymbol{x}}$,都存在一个对应的非空集合${\boldsymbol{F}}({\boldsymbol{x}})

\subset {{\mathbb{R}}^n}$,那么称${\boldsymbol{x}} \to

{\boldsymbol{F}}({\boldsymbol{x}})$是${\boldsymbol{E}}\to {{\mathbb{R}}}^{n}$上的集

值映射。如果对于任意的开集${\boldsymbol{V}} \supset

{\boldsymbol{F}}({{\boldsymbol{x}}_0})$,对每个点${{\boldsymbol{x}}_0}$,都存在相应

的邻域${\boldsymbol{U}}$,使得${\boldsymbol{F}}({\boldsymbol{U}}) \subset

{\boldsymbol{V}}$,那么称集值映射${\boldsymbol{F}}:{\boldsymbol{E}}\to

{{\mathbb{R}}}^{n}$在点${{\boldsymbol{x}}_0} \in {\boldsymbol{E}}$处是上半连续的。

定义 2

[21]

设${\boldsymbol{E}}\subset {{\mathbb{R}}}^{{n}^{}}$是一个非空凸集

合,如果对于任取的${\boldsymbol{x}},{\boldsymbol{y}} \in {\boldsymbol{E}}$,有

${\boldsymbol{\eta}} \in \partial f({\boldsymbol{x}}) $,${{\boldsymbol{\eta}}

^{\rm{T}}}({\boldsymbol{y}} - {\boldsymbol{x}}) \ge 0$,满足$f({\boldsymbol{y}}) \ge

f({\boldsymbol{x}})$,那么称$f:{\boldsymbol{E}}\subset {{\mathbb{R}}}$在集合

${\boldsymbol{E}}$中是伪凸函数。

定义 3

[3]

链式法则。如果$V:{{\mathbb{R}}}^{n}\to {{\mathbb{R}}}$在任意的

${\boldsymbol{x}}$处是一个正则函数,并且在$t$附近,${\boldsymbol{x}}:{\mathbb{R}}

\to {{\mathbb{R}}^n}$是 Lipschitz 且可微的,那么对于几乎所有的时间$t \in [0, + \infty )$,

有$({\rm{d}}/{\rm{d}}t)V({\boldsymbol{x}}(t)) = <

{\boldsymbol{\xi}} ,{\dot{\boldsymbol{x}}}(t) > ,\;\;\forall {\boldsymbol{\xi}} \in

$$ V({\boldsymbol{x}}(t))$。

3. 定义神经网络模型

本节提出一种单层神经网络模型解决非光滑伪凸优化问题式(1)。本文中,需要给出下

面的假设。

假设 1 存在${\hat{\boldsymbol{x}}} \in {{\mathbb{R}}^n},R > 0$,满足

${\hat{\boldsymbol{x}}} \in {\rm{int}} $$ ({{\boldsymbol{S}}_2}) \!\cap\!

{{\boldsymbol{S}}_1}$,使得${{\boldsymbol{S}}_2} \!\subset\!

B({\hat{\boldsymbol{x}}},R),\hat g \!=\! \mathop {\min }\limits_{1 \le i \le p} ( -

{g_i}({\hat{\boldsymbol{x}}})) \!>\! 0$,其中$B({\hat{\boldsymbol{x}}},R) =

\{ {\hat{\boldsymbol{x}}} \in {{\mathbb{R}}^n}:\left\| {{\boldsymbol{x}} -

{\hat{\boldsymbol{x}}}} \right\| \le R\}$。

本文基于惩罚函数的方法,为不等式约束${g_i}({\boldsymbol{x}}),i = 0,1,···,p$定义如

式(2)的惩罚函数

$$G({\boldsymbol{x}}) = \sum\limits_{i = 1}^p {\max \{ 0,{g_i}({\boldsymbol{x}})\} } $$

(2)

因为${g_i}({\boldsymbol{x}}),i = 0,1,···,p$是凸函数,所以$G({\boldsymbol{x}})$也是

凸函数。对所有的${\boldsymbol{x}} \in {{\mathbb{R}}^n}$,都存在对应的$\partial

G({\boldsymbol{x}})$,且

$$ \begin{split} &\partial G({\boldsymbol{x}}) =\\ &\left\{ \begin{aligned} &

\left\{ {\displaystyle\sum\limits_{{\boldsymbol{I}} \in {{\boldsymbol{I}}^ + }({\boldsymbol{x}})} {\partial

{g_i}({\boldsymbol{x}}) + } [0,1]\displaystyle\sum\limits_{{\boldsymbol{I}} \in

{{\boldsymbol{I}}^0}({\boldsymbol{x}})} {\partial {g_i}({\boldsymbol{x}})} } \right\}, {\boldsymbol{x}} \notin

{{\boldsymbol{S}}_2} \\ & \left\{ 0 \right\}\;,\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\, {\rm{ }}{\boldsymbol{x}} \in

{\rm{int}} ({{\boldsymbol{S}}_2}) \\ & \left\{ {[0,1]\sum\limits_{{\boldsymbol{I}} \in

{{\boldsymbol{I}}^0}({\boldsymbol{x}})} {\partial {g_i}({\boldsymbol{x}})} } \right\} ,\,\; {\boldsymbol{x}} \in

bd({{\boldsymbol{S}}_2}) \end{aligned} \right. \end{split} $$

(3)

其中,${{\boldsymbol{I}}^ + }({\boldsymbol{x}}) = \{ i \in

\{ 1,2,···,m\} :{g_i}({\boldsymbol{x}}) > 0\} ,{{\boldsymbol{I}}^0}({\boldsymbol{x}}) =

$$ \{ i \in \{ 1,2,···,m\} :{g_i}({\boldsymbol{x}}) = 0\}$。

本文中定义$L({\boldsymbol{x}}) = \left\|

{{{\boldsymbol{A}}^{\rm{T}}}{{({\boldsymbol{A}}{{\boldsymbol{A}}^{\rm{T}}})}^{ -

1}}({\boldsymbol{Ax}} - {\boldsymbol{b}})} \right\|$,得

$\{ {\boldsymbol{x}}:L({\boldsymbol{x}}) \le 0\} = \{ {\boldsymbol{x}}:{\boldsymbol{Ax}} -

{\boldsymbol{b}} = 0\} = {{\boldsymbol{S}}_1}$。

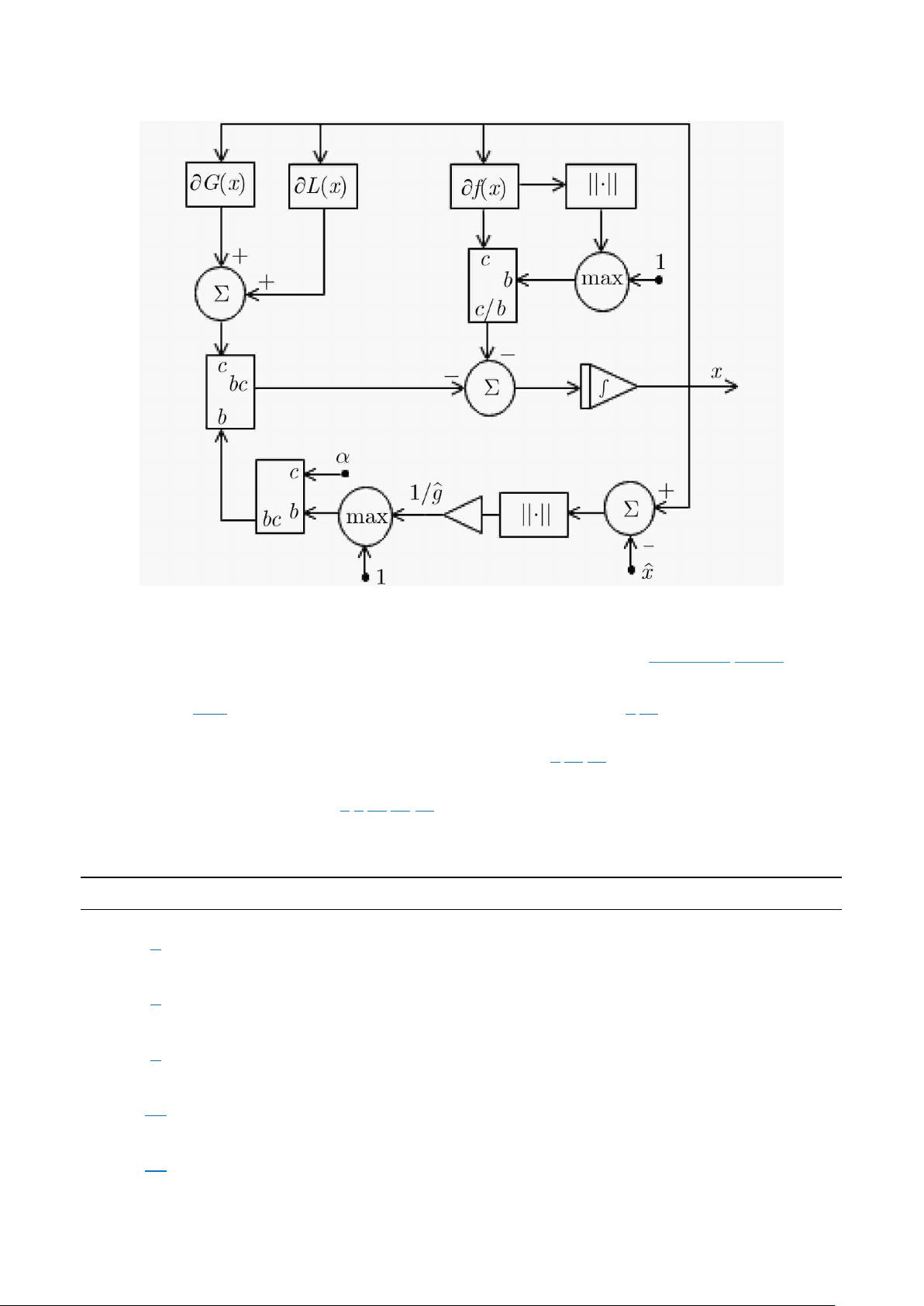

为解决包含等式约束和不等式约束条件的伪凸优化问题式(1),本文基于上述理论知识

的储备,提出如下的神经网络模型进行求解

$$ \begin{split} {\dot{\boldsymbol{x}}} \in\,& - \frac{{\partial f({\boldsymbol{x}})}}{{\max \{ \left\| {\partial

f({\boldsymbol{x}})} \right\|,\;1\} }} - \alpha \cdot \max \left\{ \frac{{\left\| {{\boldsymbol{x}} -

{\hat{\boldsymbol{x}}}} \right\|}}{{\hat g}},1\right\}\\ & \cdot (\partial G({\boldsymbol{x}}) + \partial

L({\boldsymbol{x}}))\\[-10pt] \end{split} $$

(4)

其中,$\partial f({\boldsymbol{x}}),\partial G({\boldsymbol{x}}),\partial

L({\boldsymbol{x}})$分别表示$f({\boldsymbol{x}}),G({\boldsymbol{x}}),

$$ L({\boldsymbol{x}})$的 Clark 广义次梯度,$\alpha > 1$为常量,

${\hat{\boldsymbol{x}}},\hat g$定义在假设 1 中。式(4)是神经网络的状态方程,本文所提神

经网络式(4)可以用电路实现,其具体构造及工作过程见图 1。

剩余20页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 4061

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功