没有合适的资源?快使用搜索试试~ 我知道了~

面向用户的支持用户掉线的联邦学习数据隐私保护方法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 58 浏览量

2022-06-17

16:21:15

上传

评论

收藏 302KB DOCX 举报

温馨提示

试读

17页

面向用户的支持用户掉线的联邦学习数据隐私保护方法.docx

资源推荐

资源详情

资源评论

0 引言

随着机器学习理论技术的不断成熟机器学习的隐私保护也面临着巨大挑战。

例如欧洲联盟更新的《通用数据保护条例》

将数据收集和存储限制在消费者

同意且绝对必要的处理范围内。这导致“数据孤岛”现象出现 企业拥有数据却无

法有效利用。对此 年谷歌提出了联邦学习

对“数据孤岛”现象给出了新的

解决思路。联邦学习是一种效率较高的分布式协同学习方案 企业可以通过联邦

学习基于本地隐私数据训练出更加准确的全局模型。训练过程中用户以独立且

同步的方式在本地训练好模型然后将模型参数发送给服务器服务器收集并聚合

所有用户的模型参数发送给用户如此迭代训练。联邦学习使得用户的隐私数据

不需要离开本地就能训练出一个更加准确的全局模型这不仅保护了训练数据也

实现了企业之间的互联互通。

联邦学习在信用卡欺诈检测

、通信诈骗识别

等多个领域都有应用。虽然

联邦学习能够为用户提供共享模型但是在训练过程中可能侵犯用户隐私。有研

究表明与服务器相互通信的模型信息、训练之后模型公开的 查询等会导致

用户信息泄露。文献

提出的黑盒推理攻击攻击者利用模拟数据构建多个目标

模型的影子模型并基于影子模型和目标模型的输出结果训练出一个可判断是否

为目标模型训练数据的攻击模型。文献

通过观察目标模型预测结果重建了模

型训练时使用的人脸图像数据。为了抵御这类攻击文献

发现了高度可逆模型

该模型可通过增加少量噪声变得不可逆。

针对联邦学习面临的黑盒推理攻击研究领域大多采用差分隐私

的方式进行

防御使攻击者不能以高置信度推断出训练数据的特定信息。目前的研究领域主

要包含两方面)添加噪声的工作由服务器完成。)添加噪声的工作由用户完

成。

在服务器添加噪声的研究中文献

提出了在分布式设置中的差分隐私机器

学习方法。该方法安全聚合本地模型并使用拉普拉斯噪声

来实现差分隐私但

是噪声比例与用户最小数据成反比。文献

从用户的角度提出了差分隐私联邦

优化方法在服务器的聚合参数上添加噪声在聚合的过程中隐藏了单个用户的贡

献。服务器添加噪声虽然可以实现参数扰动但在实际应用中服务器无法直接在

模型参数上添加噪声其收到的模型参数往往是经过同态加密或者安全多方计算

处理之后的

。

在用户添加噪声的研究中文献

提出在用户训练的模型参数上添加高斯

噪声但该方法没有考虑到全局隐私损失。文献

提出一种在用户模型参数上

依据概率添加噪声的方法但该方法将模型参数假定在一定范围内不能适用所有

的训练数据。用户添加噪声虽然可以实现噪声扰动但是不能控制隐私损失且目

前用户噪声添加方法没有处理用户掉线问题。如果用户因为网络故障等原因无

法上传模型参数则联邦学习迭代过程中添加的扰动不能严格满足差分隐私要求。

本文提出一种面向用户的支持用户掉线的联邦学习隐私保护方法 来有效抵

御黑盒推理攻击。实验结果表明本文所提方法能够在模型隐私性和可用性之间

达到一个平衡并且能够解决用户掉线问题适用于参数保护下的联邦学习系统。

1 相关知识

联邦学习

联邦学习是一种分布式机器学习框架。在每轮训练中 用户根据本地数据独

立计算当前模型参数的更新值并将此值传输到服务器服务器聚合用户更新以计

算新的全局模型。

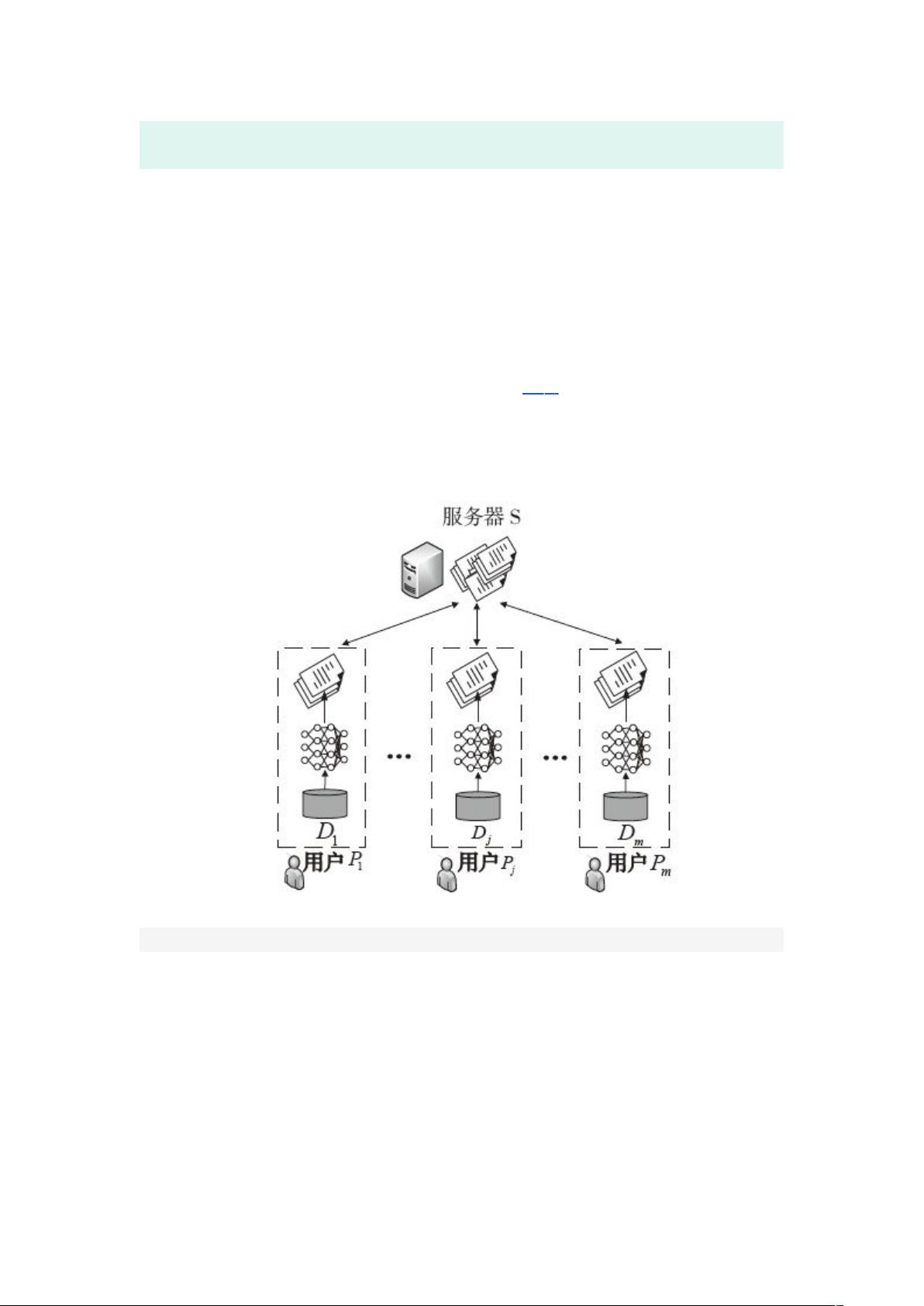

在联邦学习中用户 Pj 持有本地隐私的数据 Dj所有用户共享一个模型

架构 θ。用户数目记作 m联邦学习系统结构如图

所示具体步骤如下。

图

图 1联邦学习系统结构

) Pj 基 于 Dj 训 练 θ 计 算 得 到 Pj 的 模 型 参 数 更 新 值

Δwj=Train(θ,Dj) !。

)Pj 将 Δwj 上传到 S。

) S 聚 合 所有 用户 上 传的 Δwj 得 到模 型 参数 更新 值 的聚 合 结 果 w

′=∑j=1mΔwj"#$。

)S 将 w′"返回给用户用户计算均值更新本地模型。

)重复迭代过程直至模型收敛。

差分隐私

差分隐私(%%&&'()*+)是通过添加噪声来掩盖相邻数据之间

查询的差异性。差分隐私查询可确保在数据中增加或删除一条数据时查询结果

保持不变攻击者无法根据查询结果推断出用户隐私并且无须关心攻击者拥有的

背景知识。即使攻击者知道除一条记录信息之外的所有记录信息也无法推测出

这条记录的敏感信息。

定义 1,(ε,δ) -.!/差分隐私

给定一个隐私算法 M对于至多相差 条记录的

相 邻 数 据 D 和 D′" 如 果 M 在 这 两 个 数 据 上 的 输 出 结 果

S(S⊆range(M))0 0⊆1& 2!! 满 足 Pr[M(D)∈2 !∈,

S]≤eε×Pr[M(D′)∈S]+δ03&-42 "!∈05.则 称 M 满 足 (ε,δ) -.!/ 差 分

隐私。其中Pr[⋅]⋅表示 M 暴露隐私信息的概率参数 ε- 为隐私预算代表隐私

保护的程度。一般来说ε- 值越小D 和 D′"输出的概率分布越接近隐私保护

级别越高。当 ε=0- 时M2 针对 D 和 D′"的输出概率完全相同。然而 ε-

的取值是一个开放性的问题有些情况下更大的 ε- 值可以提供更有意义的隐私

保证。参数 δ. 是一个松弛项例如当 δ=e−5.&6 时表示只能容忍 e−5&6

的概率违反严格差分隐私。当 δ=0. 时满足 ε--/差分隐私简称 ε-DP-/。

应用差分隐私进行处理的数据主要分为两类。一类是数值型的数据 另一类

是非数值型的数据。对于数值型的数据一般采用拉普拉斯机制

或者高斯机制

对于非数值型的数据一般采用指数机制

。本文对模型参数添加差分隐私扰

动主要针对的是数值型数据。拉普拉斯机制可满足 ε−DP-6故本文采用带

有一个松弛项的高斯机制。噪声大小取决于算法的敏感度

。

定义 2,敏感度 对于查询函数 f:D→R%78D 和 D′"f% 的敏感度定义为

Δf=maxD,D′||f(D)−f(D′)||2%$9"::% !6% "!:: 。 其 中 Δf% 只 与 查 询

函数的类型有关代表相邻数据上同一查询结果的最大差异。

定义 3,高斯机制 给定 D对于任意的 f:D→R%78若 M 满足 G(D)=f(D)

+Y; !% !5<则其提供(ε,δ) -.!/DP称 M 满足高斯机制。

对 于 任意 的 δ∈(0,1)σ>2ln(1.25/δ)√Δfε.∈ !=>( ?.!%- 有 噪 声 Y

服从 Y∼N(0,σ2)<∼@ =!。其中σ= 是噪声的标准差。

本 文 采 用 差 分 隐 私 的 序 列 组 合 性

。 即 假 设 有 一 组 合 算 法 M={M1,

⋯,Mm}2A2⋯2$B若在同一个数据上分别满足 εi-/差分隐私则 M 可提供

(∑m1εi) #$-!/DP。

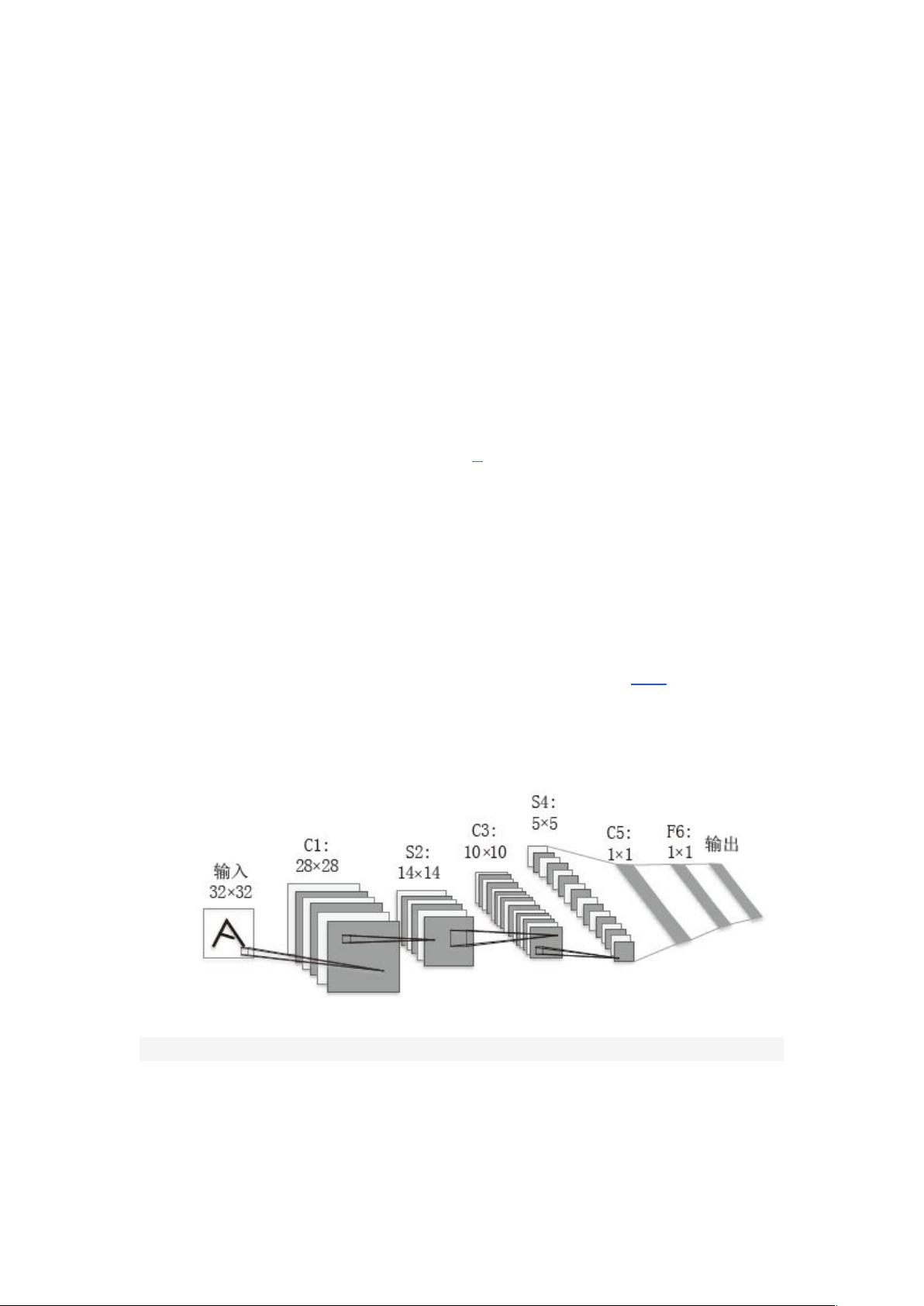

卷积神经网络

卷积神经网络(C@@)的基本结构由输入层、卷积层、全连接层及输出层

构成。典型的卷积神经网络以 D&@&'/ 为例一共包含 层如图

所示。

图

图 2卷积神经网络的基本架构

输入层输入数据是图像的像素值。

卷积层包括两个部分卷积层和池化层。C、C、C 是卷积层0、0 是

池化层。C@@ 的卷积层由多个特征面组成每个特征面由多个神经元组成神经

剩余16页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3655

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功