没有合适的资源?快使用搜索试试~ 我知道了~

基于交叉熵的安全Tri-training算法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 48 浏览量

2022-06-10

08:14:39

上传

评论

收藏 1.24MB DOCX 举报

温馨提示

试读

26页

基于交叉熵的安全Tri-training算法.docx

资源推荐

资源详情

资源评论

摘 要 半监督学习方法通过少量标记数据和大量未标记数据来提升学习

性能.Tri-training 是一种经典的基于分歧的半监督学习方法,但在学习

过程中可能产生标记噪声问题.为了减少 Tri-training 中的标记噪声对

未标记数据的预测偏差,学习到更好的半监督分类模型,用交叉熵代替错

误率以更好地反映模型预估结果和真实分布之间的差距,并结合凸优化

方法来达到降低标记噪声的目的,保证模型效果.在此基础上,分别提出

了一种基于交叉熵的 Tri-training 算法、一个安全的 Tri-training 算

法,以及一种基于交叉熵的安全 Tri-training 算法.在 UCI(University

of California Irvine)机器学习库等基准数据集上验证了所提方法的有

效性,并利用显著性检验从统计学的角度进一步验证了方法的性能.实验

结果表明,提出的半监督学习方法在分类性能方面优于传统的 Tri-

training 算法,其中基于交叉熵的安全 Tri-training 算法拥有更高的分

类性能和泛化能力.

关键词 半监督学习;Tri-training 算法;交叉熵;凸优化;样本标记

传统的分类方法通常使用有标签的数据进行训练.然而,随着人们收

集数据能力的不断提升,获得大量的未标记数据样本相对容易,而获取已

标记数据样本通常却需要付出昂贵的人力、物力和财力.如何让学习器

利用少量的标记数据和大量的未标记数据来提升学习性能,是半监督学

习(semi-supervised learning, SSL)

[1-2]

所要解决的问题.目前常用的

半监督学习方法主要包括生成式方法

[3]

、半监督支持向量机(semi-

supervised support vector machine, S3VM)

[4-5]

、图半监督 学 习

[6]

、基于分歧的方法

[7]

和半监督聚类

[8]

等.

其中,基于分歧的方法起源于协同训练

[9]

.标准的协同训练算法需要 2

个足够多的冗余视图,即属性可以自然地分为 2 组,且每组在给定类标签

的情况下有条件地独立于另一组.然而在实际应用中,并不是所有的数据

集都能满足这一特征.为了更加方便地应用到各种常见的数据挖掘场

景,Zhou 等人

[10]

提出了一种协同训练算法 Tri-training,该算法不需要

足够的冗余视图,也不需要使用不同的监督学习方法,有效提高了半监督

学习的效率.Søgaard

[11]

提出了一种带分歧的 Tri-training 算法,旨在提

升模型的薄弱点,比一般的 Tri-training 算法更具有效率.Saito 等人

[12]

提出了一种用于无监督域自适应的非对称 Tri-training 算法,通过不对

称地使用 3 个神经网络,达到对目标域未标记数据进行标记的目的,从而

提 高 了 迁 移 学 习 领 域 的 自 适 应 性 能 .Ruder 等 人

[13]

为 了 减 少 Tri-

training 过程中的时间和空间复杂度,把迁移学习思想引入半监督学习,

提出了多任务 Tri-training 算法.Ou 等人

[14]

提出了一种基于正则化局部

嵌入的 Tri-training 方法用于高光谱图像分析,解决了奇异值和过拟合

的问题, 有 效 提 高 了 高 光 谱 图 像 的 分 类 精 度 .Park 等人

[15]

结合 Tri-

training 方法和对抗学习方法构建了一个半监督学习框架,用来检测单

个音频剪辑中多个声音事件的设置和偏移.该框架先用 Tri-training 方

法标记数据,然后使用对抗学习方法来减少真实数据集和合成数据集之

间的域间隙.然而上述 Tri-training 算法依赖于初始的分类器,忽略了标

记后产生的噪声标签.研究表明

[16]

,在某些情况下,使用未标记的数据进行

半监督学习时会使性能退化 ,导致一个不安全的学习模型 ,而在 Tri-

training 训练过程中产生的不正确伪标签是性能下降的主要根源.本文

提出一种安全的半监督学习方法,即使在使用未标记数据时也不会显著

降低学习性能.

本文从降低误标记样本的角度出发,将交叉熵、凸优化分别与 Tri-

training 算法相结合,提出了 3 个不同的算法.实验结果表明,基于交叉

熵的安全 Tri-training 算法具有最优的分类性能.针对半监督分类学习

任务,本文的主要贡献有 3 个方面:

1) 将交叉熵与 Tri-training 算法相结合,提出一种基于交叉熵的

Tri-training 算法;

2) 使用铰链损失函数,提出了一个安全的 Tri-training 算法;

3) 运用凸优化方法,提出一种基于交叉熵的安全 Tri-training 学习

框架.

1 相关工作

本节主要介绍了基于分歧的半监督学习方法 Tri-training 的基本思

想、相对熵和交叉熵的相关知识,以及基于凸优化的半监督分类学习方

法.

1.1 Tri-training 算法

Tri-training 算法

[10]

不要求数据集有充足和冗余的视图,通过建立 3

个基分类器,用一种监督学习方法即可实现.基本思想是:首先,通过

Bootstrap 方法重采样原始标记数据集 L,训练得到 3 个基分类器

h

1

,h

2

,h

3

.然后,对未标记数据集 U 中的数据 x 进行标记,只需有 2 个分类

器对 x 的标记一致即可,并将该未标记样本及其分类一致的标签加入到

另外一个分类器的训练集中,重新训练基分类器,依此类推.重复迭代上

述过程,直到 3 个基分类器的性能不再改变为止.最后,采用多数投票法

确定最终的分类结果.

在标记过程中,产生的错误标记样本会对结果造成影响.为了减少标

记过程中产生的噪声样本,该算法基于 Angluin 等人

[17]

的理论结果,根据

分类噪声率和每轮训练的分类错误率决定伪标记样本是否用于分类器

更新.Zhou 等人

[10]

证明,如果新标记的训练样本足够多且满足式(1)所设

定的约束条件,则基分类器重新训练所得的分类性能会迭代提升.

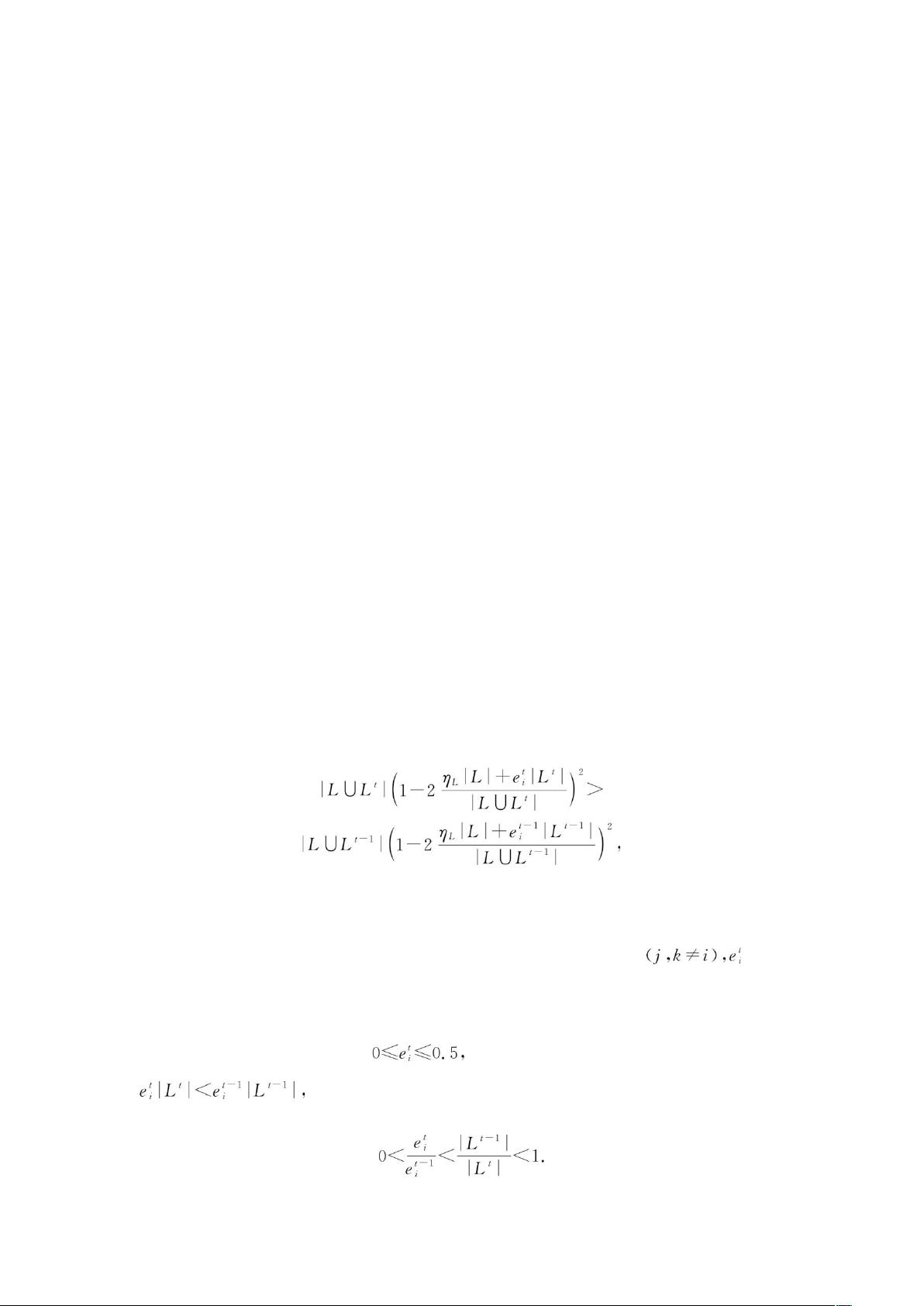

(1)

其中,L

t

表示第 t 次迭代 h

j

和 h

k

为 h

i

新标记的训练集 表示

第 t 次迭代 h

j

和 h

k

的错误率上限,η

L

表示初始训练集 L 的噪声率.通常情

况 下 η

L

很 小 , 一 般 假 定 则 当 |L|>|L

t-1

| 时 , 由 式 (1) 可 推 出

即有:

(2)

在 Tri-training 训练过程中,用式(2)来判断由 h

j

和 h

k

给出一致标记

的数据所组成的数据集 L

t

是否应该被加入到 h

i

的新训练集中.

Tri-training 不需要数据集有冗余的视图,对基学习器也没有特定

的要求,因此成为基于分歧的半监督学习方法中最常用的技术.然而该算

法在训练过程中产生的标记噪声,可能会对最后的模型产生不好的影响.

为了减少 Tri-training 算法过程中的标记噪声对未标记数据的预测偏

差,学习到更好的半监督分类模型,本文结合交叉熵和凸优化方法,提出

了一种基于交叉熵的安全 Tri-training 学习框架.

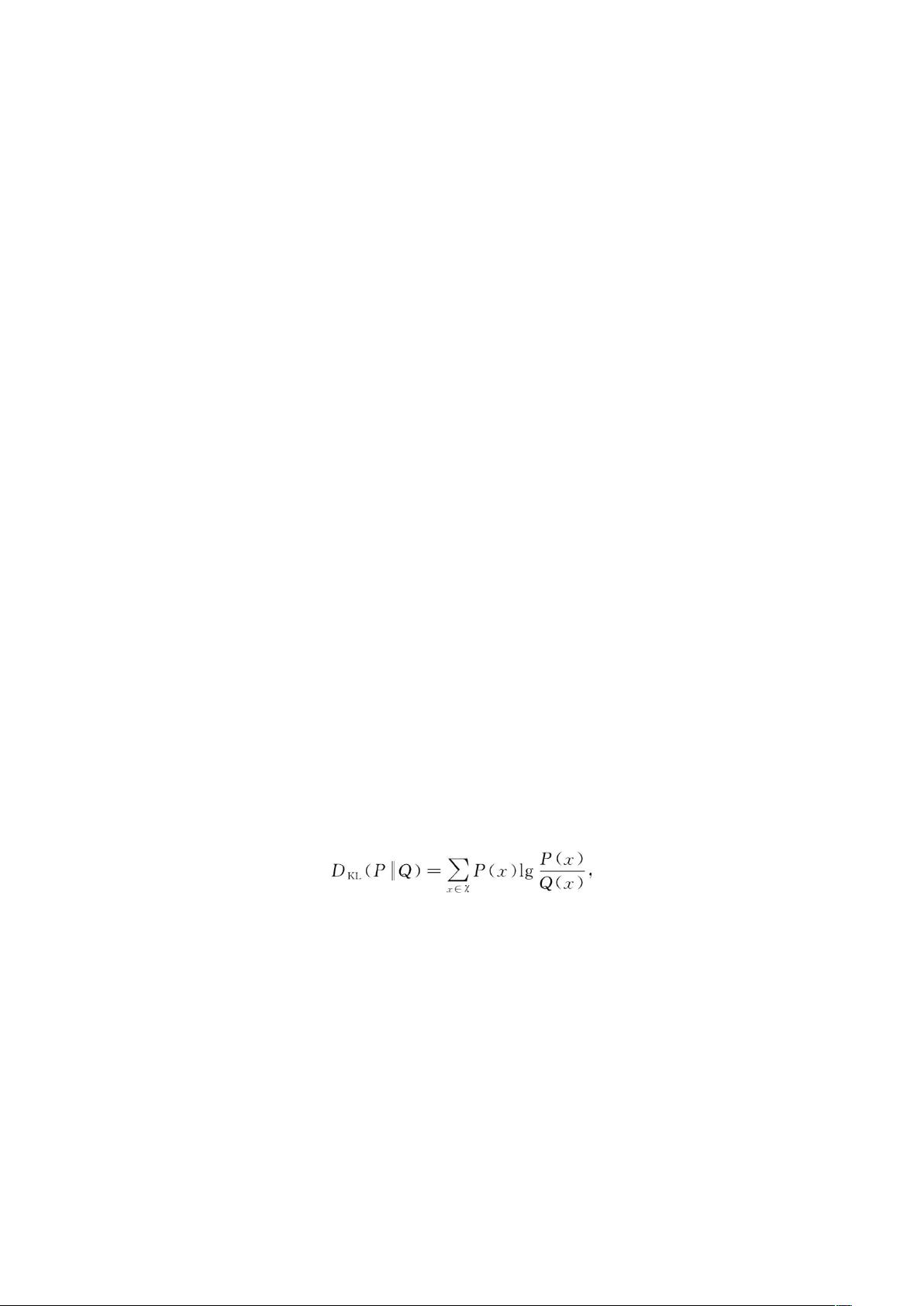

1.2 相对熵与交叉熵

相对熵又称为 KL 散度(Kullback-Leible diver-gence),是 2 个概

率分布间差异的非对称性度量

[18]

.在信息理论中,相对熵可用于表示 2 个

概率分布的信息熵的差值.假设在给定样本集 χ 上定义样本真实分布为

P,模型预测分布为 Q,则 P 和 Q 的相对熵或 KL 散度可以定义为

[19]

(3)

D

KL

值越小,表示 P 和 Q 的分布越接近.当且仅当 2 个概率分布相同

时,相对熵 D

KL

=0.

交叉主要用于描述两个事件之间的相互关系.Rubinstein

[20]

提出了

交叉熵的概念,用来度量 2 个概率分布的差异性.由式(3)变形可得:

剩余25页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3907

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功