没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

1 引言

为应对移动互联网和物联网爆炸式发展带来的千倍业务流量增长和海量设

备连接, 已经成为国内外移动通信领域的研究热点。业界普遍认为,应

该具备超高的能量效率和频谱效率,与 相比在传输速率、时延和用户体验方

面也要有较大的性能提升。为实现 网络的关键性能指标,大规模多输入多

输出( ,)系统已经成为一项起基础支撑

作用的关键技术。大规模 系统在基站或接入点上部署大量天线(可达数

百个),提升了多个用户之间的复用能力,从而在不需要增加基站密度和带宽

的条件下大幅度提高频谱效率。研究表明未来的 为了实现太赫兹通信将会使

用超大规模 系统,收发端会部署密集的天线阵列

,例如,为 传

输设计的超大规模 收发端的天线数量均为

。未来社会很有可能是

数据驱动的, 网络将会是内生智能的

,因此学习高维信道数据分布并由此

进行信道估计的生成对抗网络方法具有巨大的发挥空间。

大规模 依赖于空间多路复用,而空间多路复用又依赖于基站在上行

和 下 行 链 路 上 都 拥 有 准 确 的 信 道 状 态 信 息 ( ,

!")。上行链路获取 !"比较容易实现,终端发送导频信号给基站,基站根

据接收到的导频信号估计信道即可获取 !"。在下行链路中,!"的获取则较为

复杂。一般来说,利用时分双工(#$%$&,'')模式上下行的

互 易性 可 以 获 取 下 行 链 路 信 道 的 !" 。 当 然 不 排 除 频 分 双 工 ( ()#

$%$&,*'')模式适用于某些特定场景。后面的部分针对 ''模型

下的信道估计进行介绍。

信道估计方案大致可以归为非盲信道估计和盲信道估计。非盲信道估计

(即基于导频的信道估计)需要借助收发端都知道的参考信号(即导频),接

收端通过接收到的导频信号进行信道估计。传统的基于导频的信道估计算法有

最 小 二 乘 ( ( , +" ) 和 最 小 均 方 误 差 ( (

,",)算法。使用导频进行信道估计会占用额外的时隙资源,有效的

解决办法是通过尽量短的导频序列准确地估计信道。此外,通信环境中的高斯

加性白噪声也会影响信道估计质量,因此如何在接收端减少接收到的导频信号

中的噪声也是本文的研究内容。

2 相关研究

在关于大规模 系统中信道估计问题的研究中,基于导频的信道估计

方法大多假设导频序列的长度 -

大于或等于发射天线的数量 -

。如果不考虑

''模式的互易性,在对下行链路进行信道估计时导频序列的长度需要大于或

等于基站的天线数量,对于大规模 系统中动辄几百的天线数量,所用的

导频序列会大大占用无线资源,导致频谱效率降低。如果没有 -

.-

这个假设,

参考文献/

证明了线性最小均方误差( ",,+",)估计器的性能

会大打折扣。而目前很多信道估计的方法是基于 +", 的

0

0

1所以 -

.-

这个

假设对于很多信道估计方法都是很有利的。但是在大规模 系统中,保证

-

.-

这个假设成立是比较困难的,主要原因有 /个。首先,为了确保 -

.-

,

大量的时间资源被用来发送导频,这将导致发送数据可以使用的时间资源有所

减少,会进一步导致频谱效率降低。其次,信道估计方法的计算复杂度会随着

-

的增加而增加。最后,-

.-

可能根本就不能实现,因为 -

不能大于信道的相

干时间( ),这点通常是无法控制的。因此,在大规模

系统中,设计一种针对 -

2-

的信道估计方案是非常有必要的。

近年来,深度学习在通信领域得到了广泛的关注,原因在于数据驱动的深

度学习算法以其强大的函数拟合能力为很多缺乏有效模型的通信问题提供了潜

在的解决方案

3

04

05

0

0

0

。针对上述 -

2-

的情况,近两年有研究工作利用深度学

习算法设计信道估计器以解决这个问题。参考文献/

采用编码器#解码器的结

构进行信道估计,编码器包含一个双层神经网络,输入真实信道,输出接收端

导频的估计,其中编码器的权重矩阵即导频矩阵。解码器由一个深度神经网络

构成,负责从编码器的输出估计信道。参考 文献

使用条件生成对抗网络

($6 %$% 7 8 ,!9-)进行信道估计,其中

生成器从基站接收到的导频信号中估计信道。该方法不仅可以处理 -1

2-

的情

况,而且不需要特别设计导频序列。

另一方面,环境中的高斯白噪声也是影响信道估计质量的因素之一,因此

在进行信道估计之前对接收端的导频信号进行去噪也可以提高估计质量。得益

于卷积神经网络(% 7 8,!--)在图像处理领域的优

秀表现,越来越多的研究将基于 !--的图像去噪算法应用到信道估计方法的设

计中。这类的研究通常将接收端的导频矩阵和信道矩阵看作图片,其实数部分

和虚数部分分别对应图片的两个通道。参考文献 4

使用 '!--($6

!--)

通过监督学习的方式让神经网络从包含噪声的信道中学习到残差噪声,

然后将粗估计得到的信道输入训练好的 '!--中得到残差噪声,最后将粗估

计信道减去残差噪声就得到了更加精确的估计结果。类似地,参考文献 5

也使

用了 '!--作为去噪网络对粗估计的信道进行处理,得到更加精准的估计。

参考文献

也采用两个阶段进行信道估计,第一阶段通过 ':($6

)

3

方法训练神经网络以实现对接收到的导频信号进行去噪;第二阶段将

经过第一阶段去噪的接收端导频信号用于 +"估计器得到最终的信道估计结果。

总结来看,图像去噪技术用于信道估计主要有以下两种:在对信道进行粗

估计后使用去噪网络;在信道估计前对接收到的导频信号进行去噪。前者用得

比较多主要是因为有真实信道作为去噪网络的训练目标,基于监督学习的去噪

算法(如 '!--)可以达到很好的去噪效果,因而显著提高了估计信道的质量。

而后者由于缺乏真实数据作为训练目标,因此很难使用 '!--这样的监督算

法对接收端的导频信号进行去噪。参考文献

中使用的 ':算法是一种无监

督学习的去噪算法,其主要利用了神经网络在学习含噪图像时先学会如何复制

一张没有噪声的图像,然后才逐渐学会添加噪声。所以人为打断神经网络学习

含噪图像的训练过程,就可以得到没有噪声的图像。因此参考文献

使用 ':

算法对接收端的导频信号进行去噪时就不需要使用额外的没有噪声的导频信号。

但是 ':算法没有给出关于中止训练的判断准则,这使得参考文献

的工作

难以复现。

3 系统模型

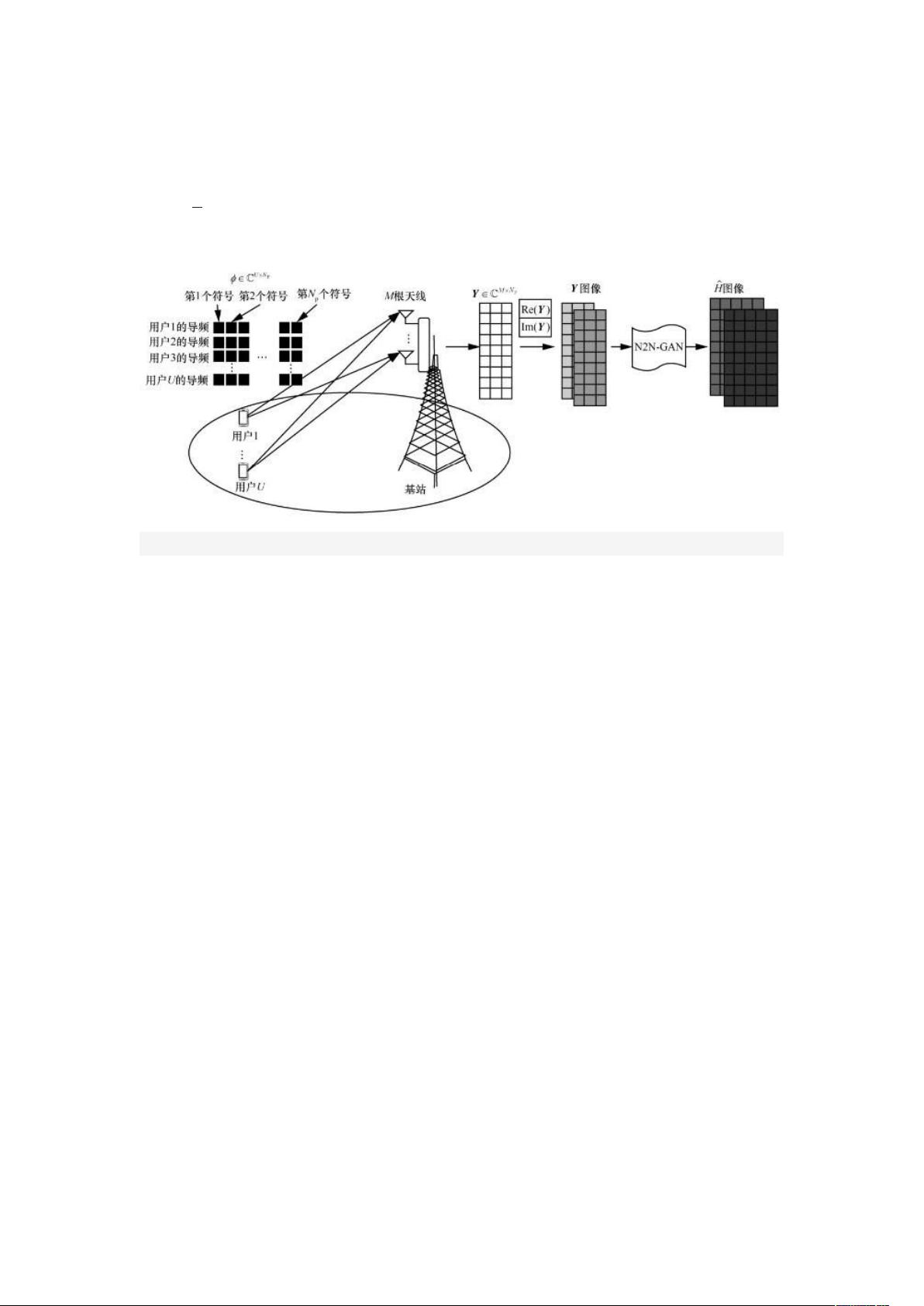

大规模 系统的信道估计框架如图

所示,考虑单基站多用户场景下

大规模 系统的上行信道估计问题。该场景中,基站上配备均匀线性阵列

( ),;+9),其中天线数量为 ,基站覆盖的小区内分布

着若干持有单天线设备的用户,数量为 ;。采用 ' 框架

4

生成基站和

用户之间的信道数据。'是专门为在毫米波和大规模 系统中使

用机器深度学习算法生成数据集的框架,其方便了研究人员对算法进行测试以

及与其他算法进行比较(基于相同数据集)。' 是根据精确的光线追

踪数据构建的,这些数据来自 <开发的光线追踪模拟器—— =

"

5

。

图 1

图 1大规模 MIMO 系统的信道估计框架

具体地,在本文考虑的场景下,针对用户 和基站之间的第 条传输路径,

光线追踪模拟器会计算以下信道参数:()基站侧的方位角 φuazi>1和发射

仰 角 ( 6 $ , 9' ) φuaod>$1; ( ) 用 户 侧 的 方 位 角

βuazi? 和到达仰角(6 %, 99)βuaod?$;(/)接收功

率 Pul:;()相位 ϕul@;()传输时延 τulA。这样就可以通过式()

计算用户 和基站之间的信道向量 hu∈CM×l∈ℂB1:

hu=∑Ll=1Pul−−−√ej(ϕul+2πτulB)a(φuazi,φuaod)

(1)CDC+:EF@GHAIJF>0>$J FJ

其 中 , + 是 传 输 路 径 的 数 量 , I 是 系 统 带 宽 ,

a(φuazi,φuaod)F>0>$J1表示基站的阵列响应向量,数学表达式为:

a(φuazi,φuaod)=F>0>$JC

[1,ejdsin(φuaod)cos(φuazi),⋯,ejd(M−1)sin(φuaod)cos(φuazi)]T (2)

0E$F>$JF>J0⋯0E$FKJF>$JF>J FJ

剩余11页未读,继续阅读

资源评论

m0_720746642023-06-16果断支持这个资源,资源解决了当前遇到的问题,给了新的灵感,感谢分享~

m0_720746642023-06-16果断支持这个资源,资源解决了当前遇到的问题,给了新的灵感,感谢分享~

罗伯特之技术屋

- 粉丝: 3543

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 学生成绩管理系统-C++版本

- 吉林大学离散数学2笔记.pdf

- 通道处理过程的模拟通常涉及对通道处理机制的理解与实现.txt

- Flume进阶-自定义拦截器jar包

- Dubins曲线算法讲解和在运动规划中的使用.pdf

- 上市公司-股票性质数据-工具变量(民企、国企、央企)2003-2022年.dta

- 上市公司-股票性质数据-工具变量(民企、国企、央企)2003-2022年.xlsx

- Reeds+Shepp曲线算法讲解和实现.pdf

- 毕业设计基于SpringBoot+MyBatisPlus+MySQL+Vue的外卖配送信息系统源代码+数据库

- 词向量(Word Embeddings)是自然语言处理(NLP)领域的一种重要技术.txt

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功