没有合适的资源?快使用搜索试试~ 我知道了~

综述视频无监督域自适应(VUDA)的小综述

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 24 浏览量

2023-05-31

18:36:25

上传

评论

收藏 3.58MB PPTX 举报

温馨提示

试读

25页

这次基于三篇有代表性的文章来讲解 Spatio-temporal contrastive domain adaptation for action recognition(CVPR2021) Partial video domain adaptation with partial adversarial temporal attentive network(ICCV2021) Interact before align: Leveraging cross-modal knowledge for domain adaptive action recognition(CVPR2022)

资源推荐

资源详情

资源评论

视频无监督域自适应(VUDA)

由于训练的公开视频数据集(源视频域)和真实视频(目标视频域)之间的域差异,训

练的基于现有数据集的视频模型在直接部署到真实世界的应用程序时,会有显著的性能下

降。此外,由于视频注释的成本较高,使用无标记的视频进行训练更加实用。为了统一解

决视频高标注成本以及性能下降的问题,引入了视频无监督域自适应(VUDA),通过减

轻视频域偏移,提高视频模型的通用性和可移植性,从标记源域适应到无标记目标域。

虽然具有深度学习的UDA通过处理领域转移大大提高了模型的通用性和可移植性,但之

前对视觉应用的研究通常集中在图像数据上。同时,通过传统的视频特征提取器获得的视

频表示主要来自于空间特征。然而,视频不仅包含空间特征,而且还包含时间特征以及其

他模式的特征,如光流和音频特征,所有这些特性都会发生域偏移。

VUDA提出背景

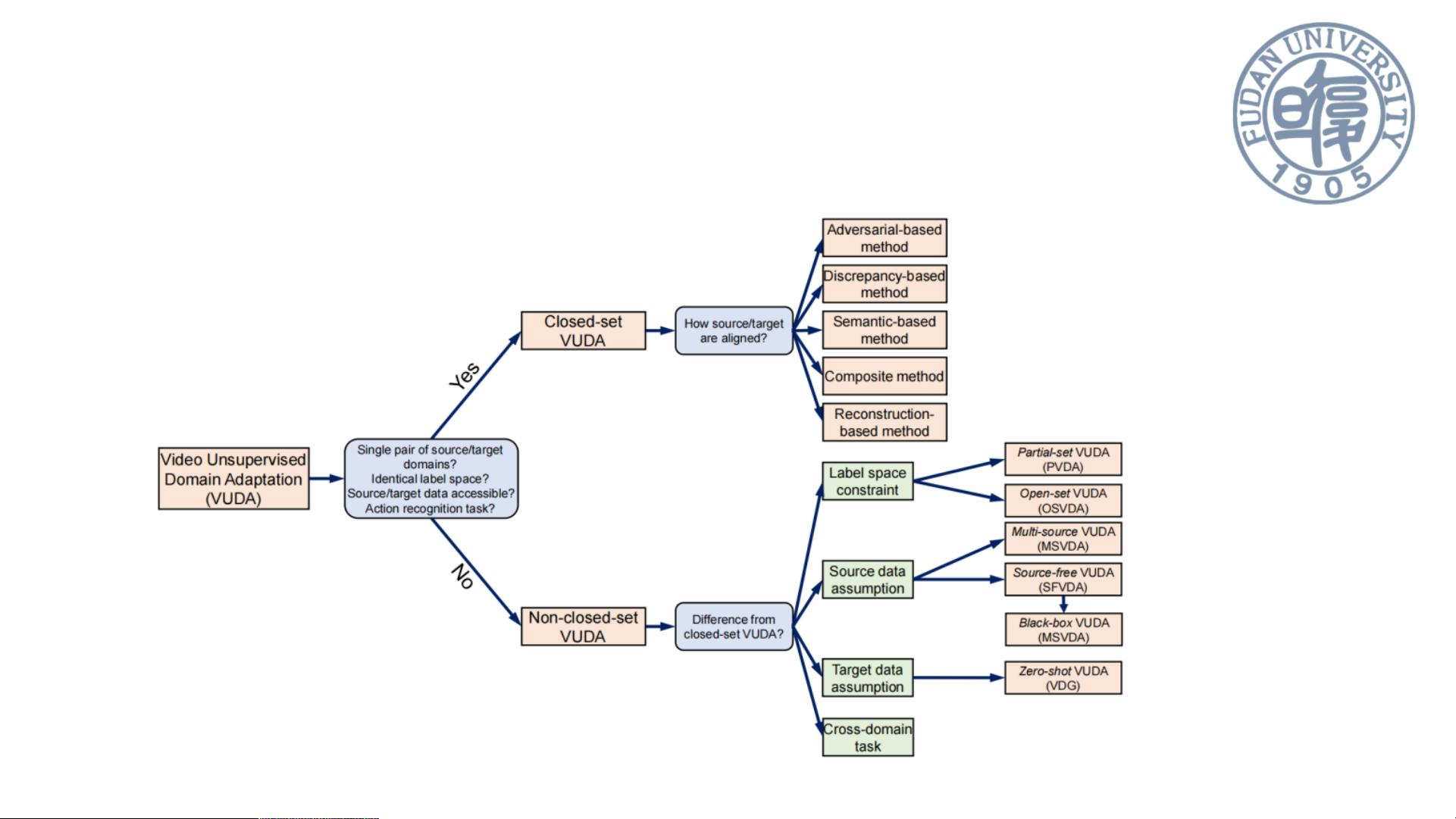

随后,人们提出了各种VUDA方法来处理视频任务的域偏移问题。一般来说,可以分为五类:

1、基于对抗的方法,特征生成器与额外的域鉴别器以对抗的方式联合训练,如果域鉴别器不能区

分它们是来自源域还是目标域,则获得域不变特征;

2、基于差异的方法,其中显式地计算了源域和目标域之间的差异,而目标域与源域通过应用度量

学习方法,优化基于度量的目标;

3、基于语义的方法,利用领域不变特征获得一定的语义约束,如互信息,聚类,对比学习;

4、复合方法,域不变的特征是通过优化不同目标的组合(即基于差异、对抗和语义);

5、基于重构的方法,其中领域不变特征由使用重构的目标数据训练的编码器提取。

VUDA方法类别

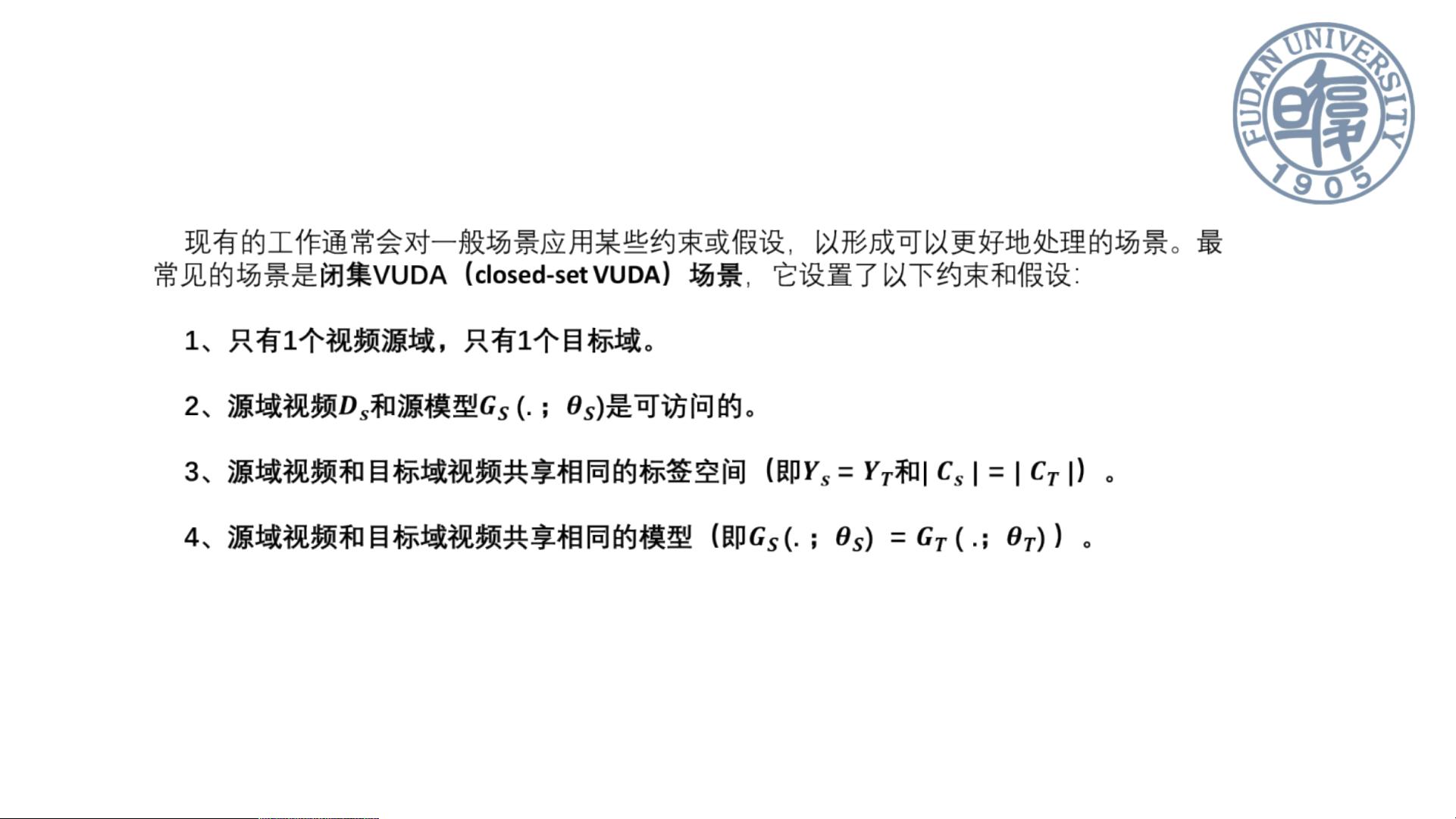

Closed-set VUDA

VUDA方法类别

剩余24页未读,继续阅读

资源评论

猫头丁

- 粉丝: 1w+

- 资源: 21

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功