神经网络与tensorflow基础(二)

需积分: 0 91 浏览量

更新于2022-01-28

收藏 5.25MB DOCX 举报

神经网络与TensorFlow基础(二)

神经网络是人工智能领域中的一种重要算法,TensorFlow是Google开发的一款开源机器学习框架。本文将对神经网络的基础知识和TensorFlow的应用进行详细的介绍。

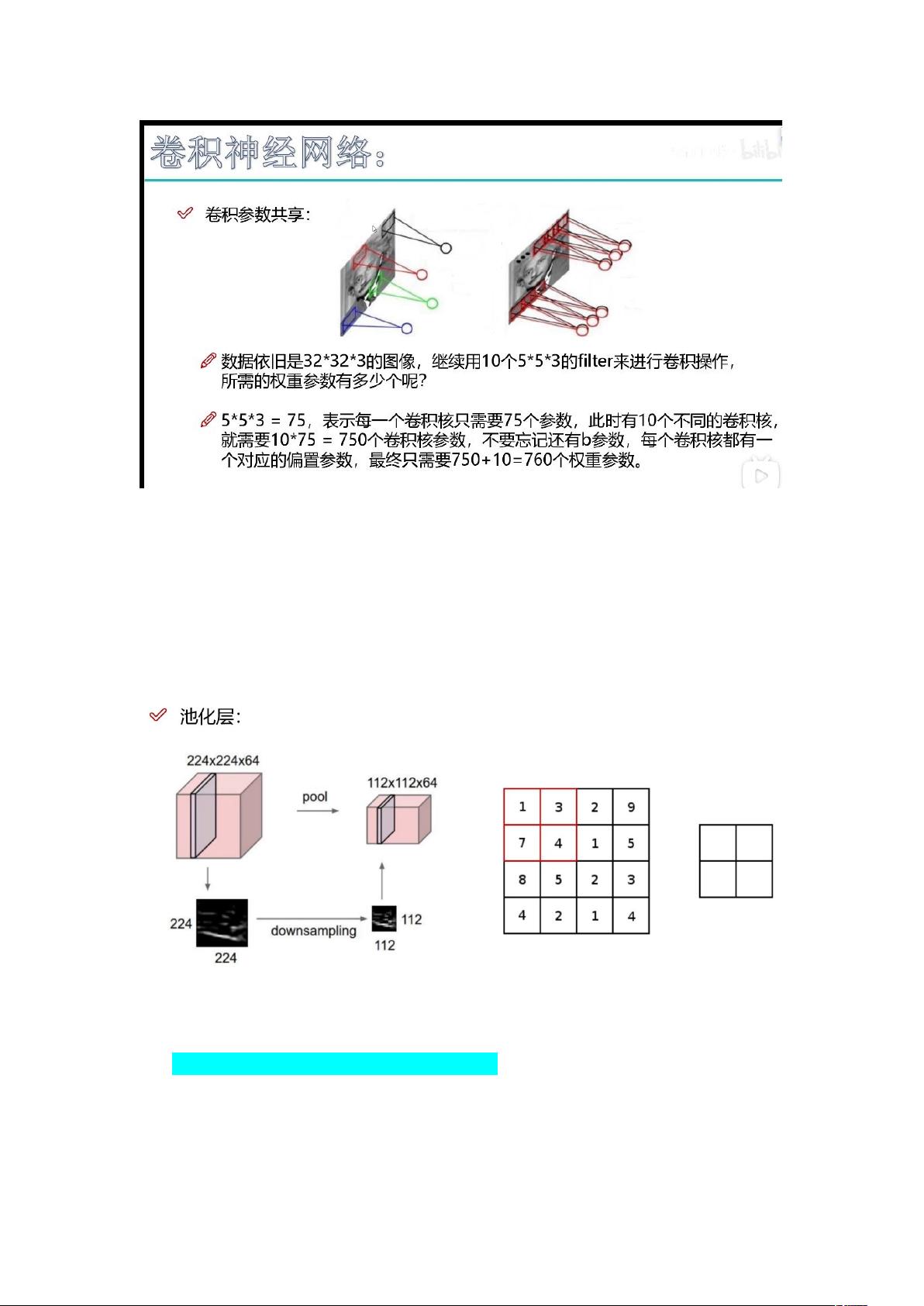

神经网络的卷积计算公式:FH与FW与卷积核大小相关。P表示添加多少圈的0。卷积参数共享是指对于图像中的某一个区域都采用相同大小的卷积核。卷积层相比于全连接层所需要的参数更少。公式为s=w*x+b。

池化层是指用于有选择性的压缩,进一步提取图像特征。常见的池化方法有最大池化(MAX POOLING)和平均池化。最大池化是指在“候选框”中选择最大数,用于压缩该“候选框”。平均池化是指对候选框中的数值进行平均值的计算。最大池化的效果比平均池化的效果更佳,因最大值池化比平均值池化所包含的干扰信息更少一些。

卷积神经网络在实际项目中的运用是指将卷积层和池化层相结合以进行特征提取。卷积层可以提取图像的特征,而池化层可以对特征进行压缩。卷积神经网络的架构可以分为CONV+RELU、POOL、CONV+RELU+POOL、FC四个部分。CONV+RELU是指卷积层和激活函数相连接。POOL是指池化层对特征图进行池化操作。CONV+RELU+POOL是指进行特征提取。FC是指最终进行全连接。

特征图的变化过程是指将三维的矩阵参数转换为一个行向量,方便与全连接层的计算。经典的网络架构有Alexnet、VGG、Resnet等。VGG网络的特点是所有的卷积核都是3*3,层数有大概16-19层。Resnet网络是针对VGG网络的问题提出来的,作者在此文中提出了一种同等映射的想法。

数据预处理是指对图像数据进行处理,以提高神经网络的训练速度和准确性。主要操作有去中心化和归一化。参数初始化是指对神经网络的参数进行初始化,以防止网络训练出来的特征图出现较大的抖动,影响后续的网络训练。

神经网络的大问题是过拟合风险较大。解决过拟合问题的操作有加入正则化惩罚项和利用DROP-OUT。DROP-OUT是指在训练阶段,需要杀死一部分神经元,以防止过拟合。在测试阶段,则不需要杀死一部分神经元。

LCH

- 粉丝: 103

- 资源: 8

最新资源

- 基于大数据技术的工程项目管理架构研究与应用

- dcs111_ui_auto.zip

- Java学生信息管理系统GUI界面+MySQL数据库+实训报告(高分项目)

- 电梯壁板自动涂胶装配生产线sw19可编辑全套技术资料100%好用.zip

- #MATLAB模拟电磁波在自由空间中传播,基于FDTD方法编写,采用ABC边界,激励源选择正弦脉冲脉冲 #程序包含详细注释,本人在2020a版本均可运行

- java学生信息管理系统(GUI+javaSwing+MySQL)源码+报告

- 动力电池及电池管理系统BMS(stp+cad+资料)全套技术资料100%好用.zip

- 无人艇、无人船usv nmpc预测控制,有详细的代码解释 能够实现动态避障都有详细的注释和代码 几乎每行都有 需要下载matlab以及casadi求解器,不然无法求解 仿真对象无人艇:WAM

- Java+Swing+Mysql实现学生信息管理系统源码+数据库+报告文档

- 二工位半自动灌袋机sw20可编辑全套技术资料100%好用.zip

- 经典的FC游戏SD快打旋风

- win32汇编环境,对话框程序源码模版

- 一款非常昂贵的java支付系统源码分享给大家学习,附带完整的安装教程和步骤-非常昂贵完善的支付,代付,收银系统java版-优雅草片翼

- Matlab计算齿轮啮合刚度计算,包括赫兹刚度弯曲刚度等子程序 以及六自由度齿轮系统动力学响应计算

- 电梯控制柜测试柜sw19可编辑全套技术资料100%好用.zip

- Multimodal Deep Learning