没有合适的资源?快使用搜索试试~ 我知道了~

击败GPT3,刷新50个SOTA!谷歌全面统一NLP范式.pdf

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 86 浏览量

2023-08-12

22:26:04

上传

评论

收藏 2.31MB PDF 举报

温馨提示

试读

14页

击败GPT3,刷新50个SOTA!谷歌全面统一NLP范式.pdf

资源推荐

资源详情

资源评论

2023/6/28 22:31

击败GPT3,刷新50个SOTA!谷歌全面统一NLP范式

https://mp.weixin.qq.com/s/oMUASBSKe3xgGVLuQz7MGg

2/14

2023/6/28 22:31

击败GPT3,刷新50个SOTA!谷歌全面统一NLP范式

https://mp.weixin.qq.com/s/oMUASBSKe3xgGVLuQz7MGg

3/14

瞬间清醒!

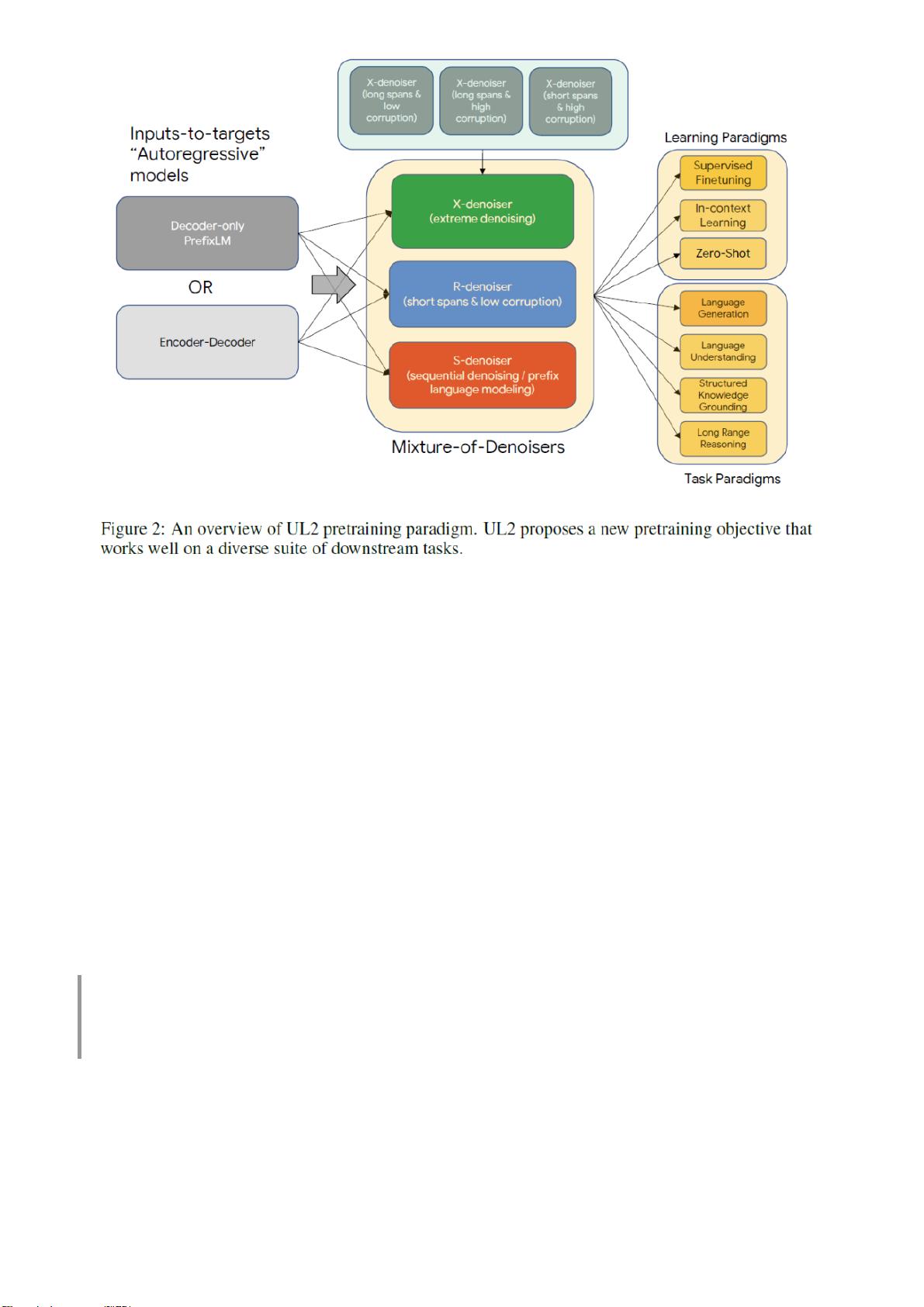

Go ogle 的 Yi Tay (and Mostafa) 团队提 出了 一个 新的 策略 Mixture-of-Denoisers, 统一 了

各大预 训 练 范 式 。

重新思考现在的预训练精调,我们有各种各样的预训练范式: decoder-only or encoder-d

ecoder , span corruption or language model , 等等, 不同的范式建模了不同的上下文

关系,也正是因为如此,不 同 的 预 训 练 范 式 适 配 不 同 类 型 的 下 游 任 务 。例如,基于双向上下

文 的 预 训 练 (span corruption , 如 T5) 更 加 适 用 于 fact completion , 基 于 单 向 上 文

(P refixLM/LM,如GPT等)更加适用于 open ended. 也就是说,具 体 的 下 游 任 务 类 型 需 要 选

用 特 定 的 预 训 练 策 略 ...

准确地说,常见有三套范式:单向文本建模的CausalLM(i.e. LM),双向文本建模的 span

corruption, 前缀文本建模的 PrefixLM.

这是大一统吗?感觉只能是小一统,总感觉还缺少一味菜!

今天,Google 把这道菜补上了!那就是:Mixture-of-Denoisers

先来感受一下效果:

剩余13页未读,继续阅读

资源评论

地理探险家

- 粉丝: 983

- 资源: 5416

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功