pytorch-contiguous() 函数.pdf

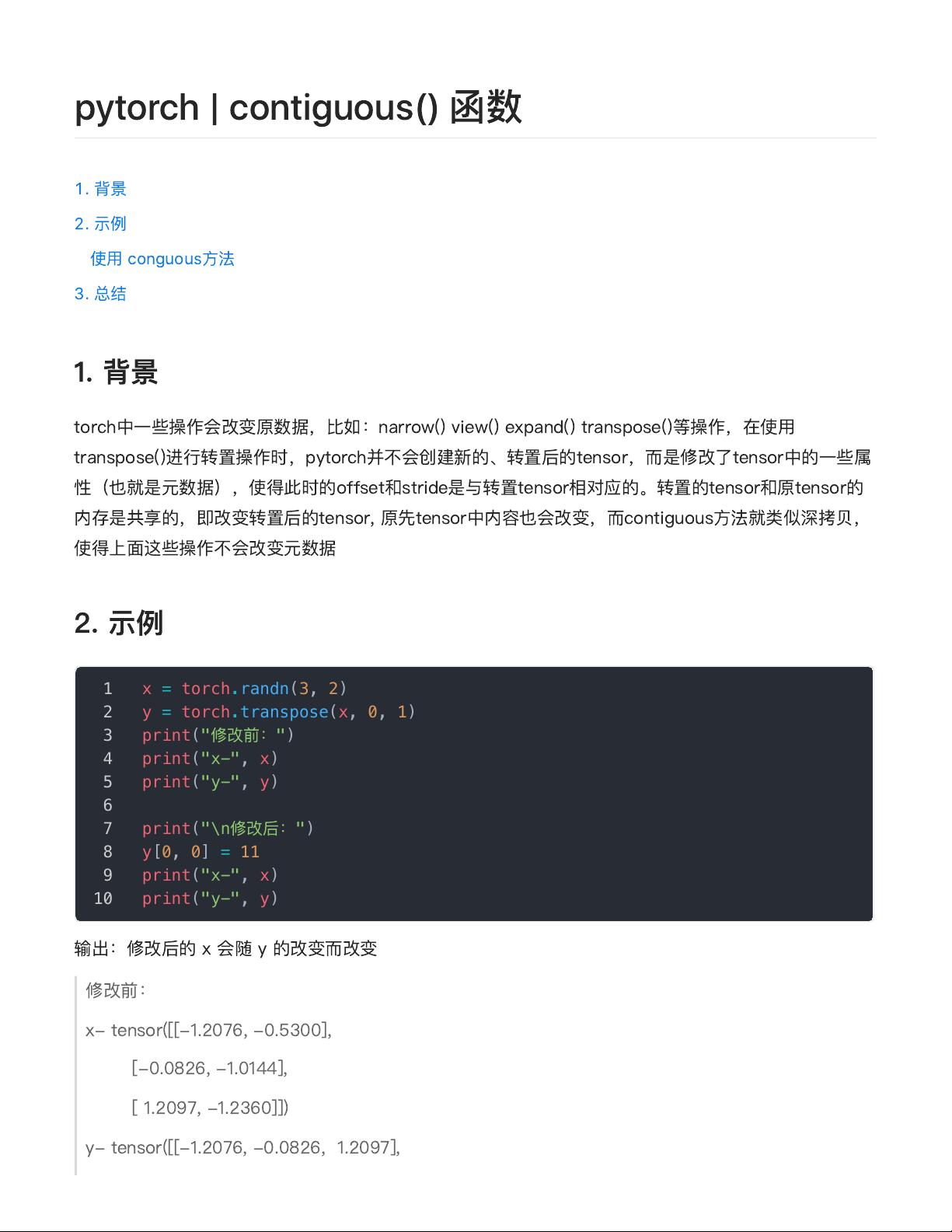

### PyTorch中contiguous()函数详解 #### 1. 背景 在深度学习领域,特别是使用PyTorch框架进行模型开发时,我们经常需要对张量(Tensor)进行各种各样的操作,比如切片(slicing)、视图(viewing)、扩展(expanding)以及转置(transposing)。这些操作有时会改变原始张量的数据结构,但并不总是会产生一个新的张量副本。了解这些操作的具体行为对于理解模型内部工作原理非常重要。 #### 2. 示例 ##### 2.1 不使用contiguous() 考虑以下示例,我们创建一个张量并对其进行转置操作: ```python import torch x = torch.randn(3, 2) y = torch.transpose(x, 0, 1) print("修改前:") print("x-", x) print("y-", y) print("\n修改后:") y[0, 0] = 11 print("x-", x) print("y-", y) ``` 输出结果: ``` 修改前: x- tensor([[ 1.3756, -0.1766], [ 0.9518, -1.7000], [-1.0423, -0.6077]]) y- tensor([[ 1.3756, 0.9518, -1.0423], [-0.1766, -1.7000, -0.6077]]) 修改后: x- tensor([[ 11.0000, -0.1766], [ 0.9518, -1.7000], [-1.0423, -0.6077]]) y- tensor([[ 11.0000, 0.9518, -1.0423], [-0.1766, -1.7000, -0.6077]]) ``` 在这个例子中,`y` 是 `x` 的转置版本,并且它们共享相同的内存空间。这意味着如果我们修改 `y` 的值,那么 `x` 的相应元素也会被修改。这种行为可能会导致意外的结果,特别是在构建复杂的神经网络时。 ##### 2.2 使用contiguous() 为了防止这种共享内存的行为,我们可以使用 `contiguous()` 方法来确保 `y` 是 `x` 的一个深拷贝,即使得 `y` 和 `x` 之间不再有内存上的关联: ```python import torch x = torch.randn(3, 2) y = torch.transpose(x, 0, 1).contiguous() print("修改前:") print("x-", x) print("y-", y) print("\n修改后:") y[0, 0] = 11 print("x-", x) print("y-", y) ``` 输出结果: ``` 修改前: x- tensor([[ 1.3756, -0.1766], [ 0.9518, -1.7000], [-1.0423, -0.6077]]) y- tensor([[ 1.3756, 0.9518, -1.0423], [-0.1766, -1.7000, -0.6077]]) 修改后: x- tensor([[ 1.3756, -0.1766], [ 0.9518, -1.7000], [-1.0423, -0.6077]]) y- tensor([[ 11.0000, 0.9518, -1.0423], [-0.1766, -1.7000, -0.6077]]) ``` 可以看到,这次当我们修改 `y` 时,`x` 的值并未发生改变,因为 `contiguous()` 方法已经创建了一个新的张量 `y`,它与原始张量 `x` 没有任何内存上的关联。 #### 3. 总结 在PyTorch中,某些张量操作(如 `narrow()`, `view()`, `expand()`, `transpose()` 等)不会创建新的张量副本,而是修改原始张量的一些属性(元数据),这样就会导致原始张量和操作后的张量共享相同的内存。为了避免这种情况,我们可以使用 `contiguous()` 方法来强制创建一个新张量,该张量具有与原张量相同的数据,但是不共享内存。这在进行复杂计算时特别有用,可以避免不必要的副作用。 理解 `contiguous()` 方法的工作原理及其如何影响张量操作对于高效地使用PyTorch进行深度学习模型开发至关重要。通过合理使用此方法,可以确保模型训练过程中的数据一致性和准确性。

- 粉丝: 3w+

- 资源: 1769

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功