没有合适的资源?快使用搜索试试~ 我知道了~

SparkApp自动化分析和故障诊断

0 下载量 15 浏览量

2021-01-27

16:42:48

上传

评论

收藏 2.32MB PDF 举报

温馨提示

试读

13页

苏宁大数据平台的计算引擎主要包括三个组成部分:离线计算、流式计算、OLAP引擎。离线这块目前主要是依赖Spark和Hive来提供离线数据的分析和挖掘能力。 流式计算这块分为准实时计算和实时流计算。准实时计算主要基于SparkStreaming来满足数秒至分钟级的业务需求,对于实时流这块,目前我们苏宁大概有1200台Openstack虚拟机(400台实体机)组成的 39个Storm集群,并且在2014年就自研了Stor

资源推荐

资源详情

资源评论

SparkApp自动化分析和故障诊断自动化分析和故障诊断

苏宁大数据计算平台架构

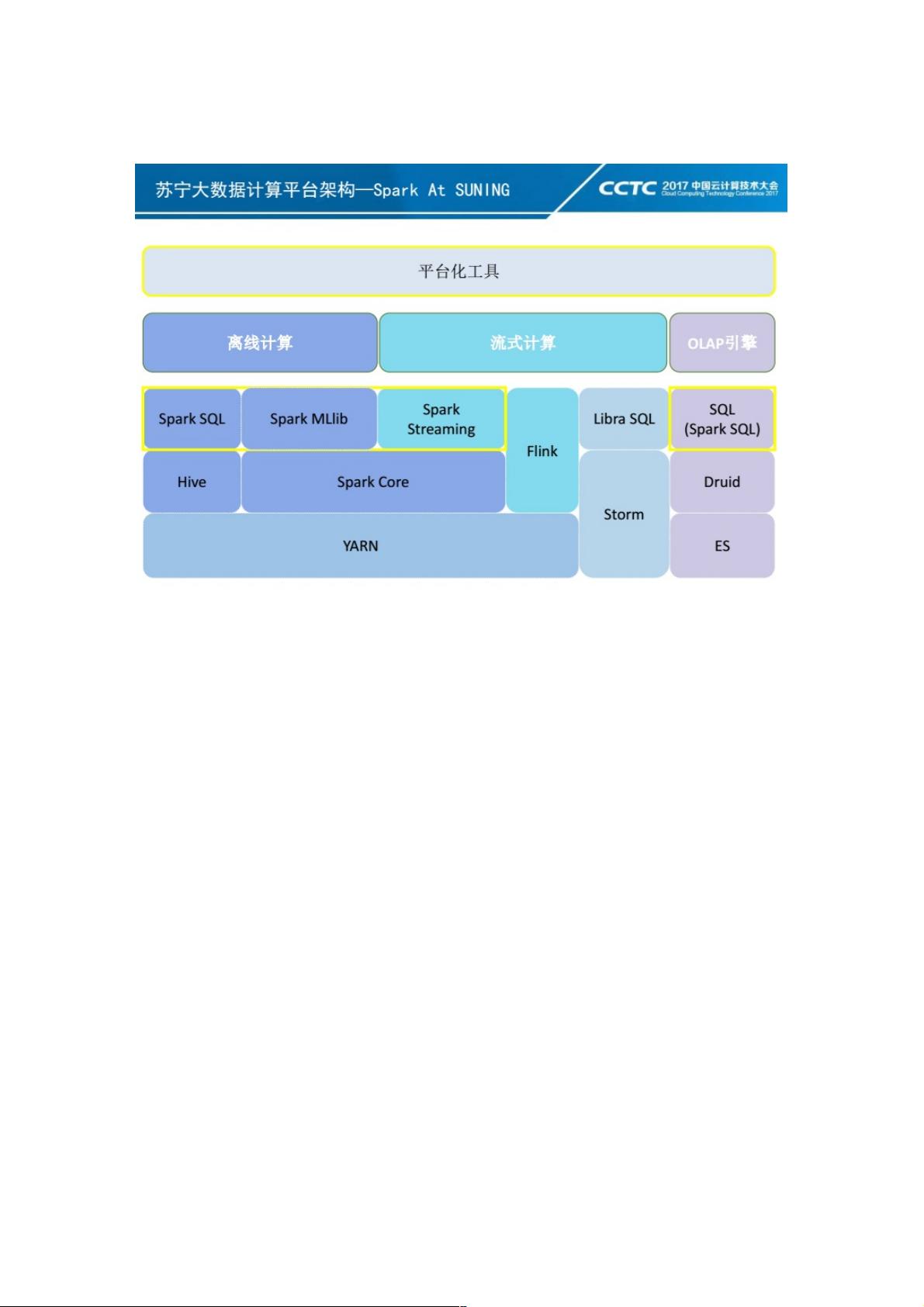

苏宁大数据平台的计算引擎主要包括三个组成部分:离线计算、流式计算、OLAP引擎。

离线这块目前主要是依赖Spark和Hive来提供离线数据的分析和挖掘能力。

流式计算这块分为准实时计算和实时流计算。准实时计算主要基于Spark Streaming来满足数秒至分钟级的业务需求,对于实

时流这块,目前我们苏宁大概有1200台Openstack虚拟机(400台实体机)组成的 39个Storm集群,并且在2014年就自研了

Storm SQL引擎Libra,为Storm业务提供SQL接口。从今年年初开始,我们开始逐步去强化Flink在我们架构中的位置,我们希

望利用Flink的强大窗口计算以及EventTime的处理能力来解决我们一些业务上的需求。

OLAP这块目前我们主推Druid和ES两款引擎。我们利用Druid的实时计算能力,来解决我们指标聚合计算上的一些需求;利用

ES快速数据索引定位能力来解决明细查询上的一些需求。

在我们整个架构中,Spark处于一个非常重要的位置。同时我们也为了Spark的平台化服务化,做了很多平台级工具。

这个是CBT任务流调度平台。它针对目前包括Spark、Spark SQL、数据交换在内多种类型任务提供一个任务和任务流管理以

及调度的能力。目前我们CBT平台集群规模在98台虚拟机,每天完成5W+任务的调度和执行。

这是SSMP平台。专门针对Spark Streaming任务提供的一个任务管理和调度的平台,为任务提供24小时LongRunning的保

障。

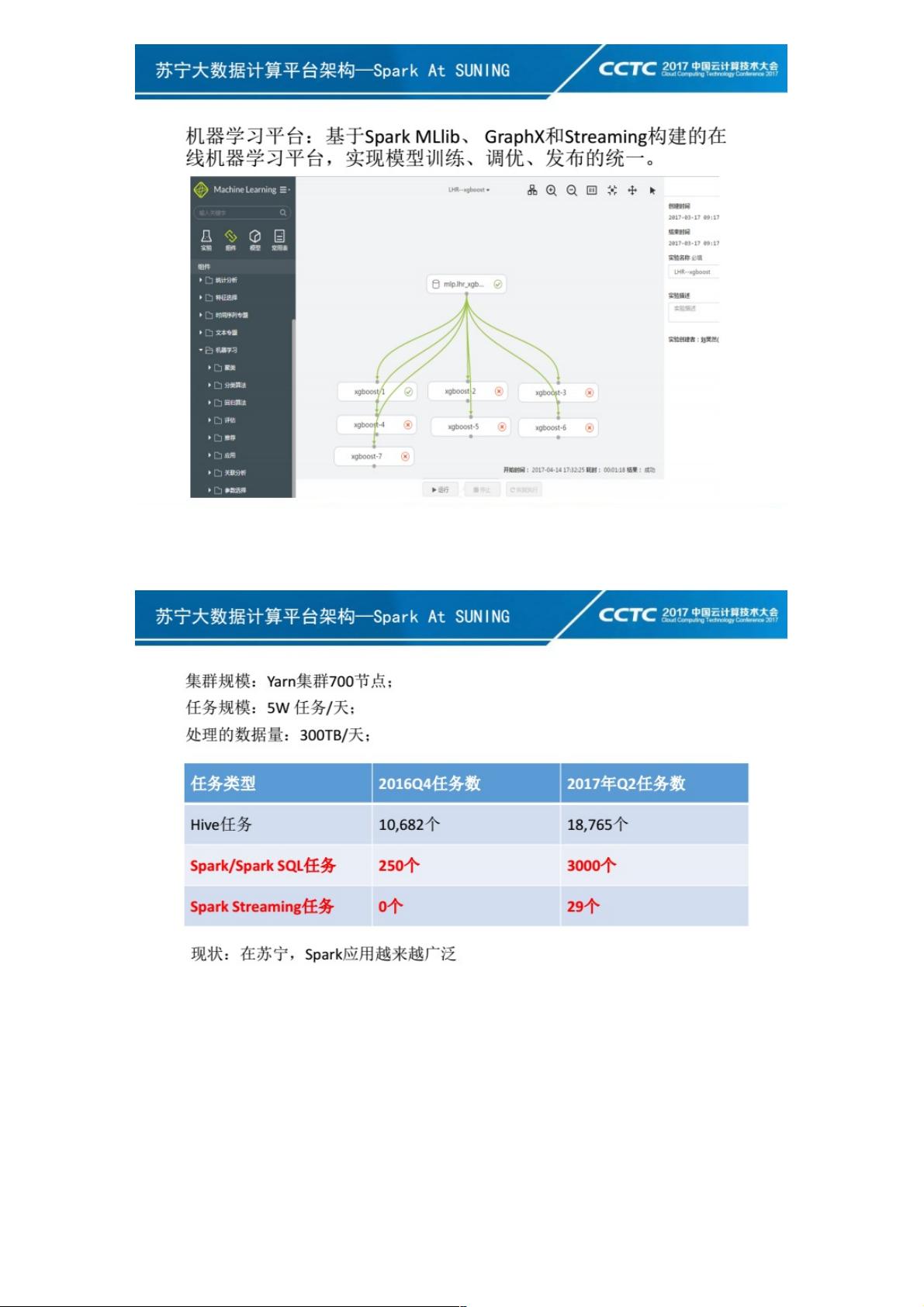

这是我们在线机器学习平台。目前该平台主要是基于Spark MLlib实现的,对GPU环境下深度学习算法的支持我们也正在开

发。目前我们支持业务在线的进行Pipeline构建、模型训练、调优,并且支持对训练后的模型一键发布到Spark Streaming应用

环境。

这是我们离线大集群的相关数据。目前我们离线这块集群节点数为700多个,每天通过CBT调度任务大概在5W+,每天处理的

数据量在300T左右。

上面表格是我们2016年Q4中期以及最近统计的《Spark和Hive任务分布情况》。当前我们苏宁业务对Hive的依赖还是比较

重,对Hive迁移到Spark SQL的工作我们也在逐步推进。另外我们单看Spark 任务变化情况:在这半年时间里,Spark任务数

增速非常快,Spark任务新增3000+,Spark Streaming任务从0增长到29个。这里要强调一下,目前这3000个Spark任务里

面,只有少少的200个任务是Spark SQL任务,在我们后续Hive迁移过程,Spark SQL任务数增速是会远远超过当前这个数

字。

整体上来说,通过我们平台化以及服务化工作的开展,我们业务已经接受Spark作为它们数据分析链路上一个核心引擎。

Spark平台化遇到的问题

但是在我们整个平台化和服务化的过程中,也遇到很多很多的问题。这些问题一部分是因为业务自身对Spark理解和应用经验

不够,还有一部分是因为我们服务化做的不够好。

剩余12页未读,继续阅读

资源评论

weixin_38735782

- 粉丝: 5

- 资源: 979

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功