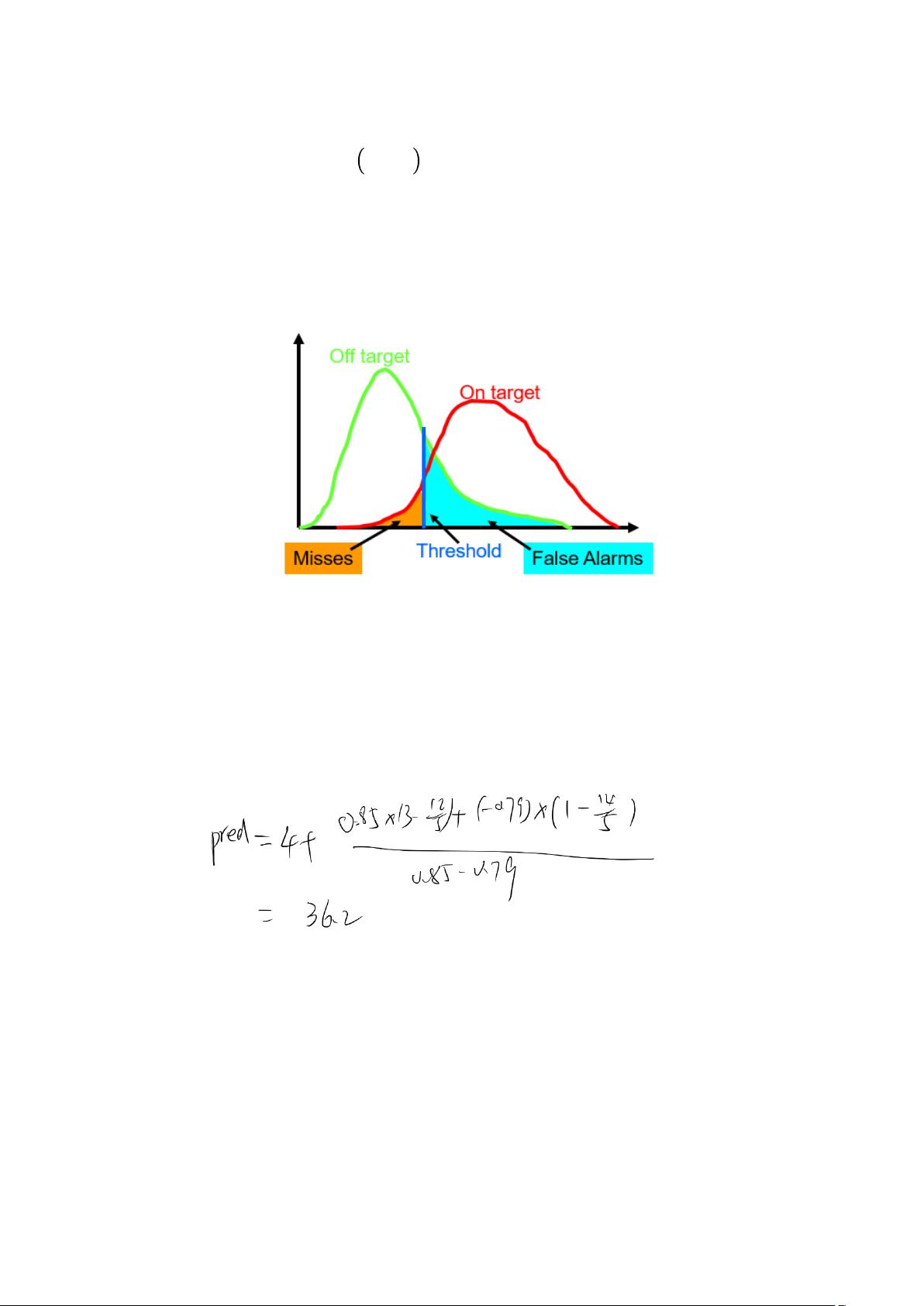

在IT领域,特别是信息检索(Information Retrieval, IR)和自然语言处理(Natural Language Processing, NLP)中,故事或文本的相似性检测是至关重要的任务。标题"IR08-课堂讨论1"可能指的是一个关于信息检索课程的讨论环节,主要探讨了几个关键问题,包括故事主题的匹配、相似度阈值设定的影响以及个性化评分的计算方法。以下是对这些知识点的详细解释: 1. 故事主题匹配: 确定两个故事是否具有相同的主题通常涉及文本相似度的计算。一种方法是建立一个基础模型(如TF-IDF或词嵌入模型如Word2Vec或BERT),然后计算两个故事向量之间的相似度(如余弦相似度)。𝑃𝑆𝑖│𝑀𝑇𝑗 表示在模型M下,故事Si与故事Tj之间的概率或相似度。设定一个阈值,如果两故事的相似度高于这个阈值,则认为它们的主题相同。 2. 相似度阈值设定的错误分析: 设定一个相似度阈值会导致两种类型的错误:False Alarm(误报)和MISS(漏检)。误报是指实际上相关的(on-topic)故事被错误地判断为不相关(off-topic),其错误率是所有on-topic故事中相似度低于阈值的比例。漏检则是相关故事被错误地判定为相关,错误率是所有off-topic故事中相似度高于阈值的比例。总误差是这两种错误率的和。 3. 打分函数的设计: 这里提到的“打分函数”是用于个性化的评分预测。例如,Alice的评分与某个用户的先验评分之间的“距离”越小,表明他们对内容的喜好可能更接近。距离的倒数作为权重,意味着距离越小,权重越大。对多个用户进行这样的计算并加权平均,可以得到一个综合考虑了用户偏好的预测分数。 4. 计算分数: 在这个步骤中,可能会利用上述打分函数,将Alice与其他用户的历史评分进行比较,计算出每个用户的权重,然后将这些权重与他们的评分相乘,最后取平均值得到对新内容的预测分数。这有助于个性化推荐系统,根据用户的偏好提供更准确的建议。 以上内容涉及到的信息检索和自然语言处理技术在现代搜索引擎、推荐系统和内容过滤等领域有着广泛应用。理解并优化这些算法对于提升用户体验和系统性能至关重要。在实际应用中,还需要考虑到效率、可扩展性以及实时性等多方面因素。

- 粉丝: 39

- 资源: 340

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

评论0