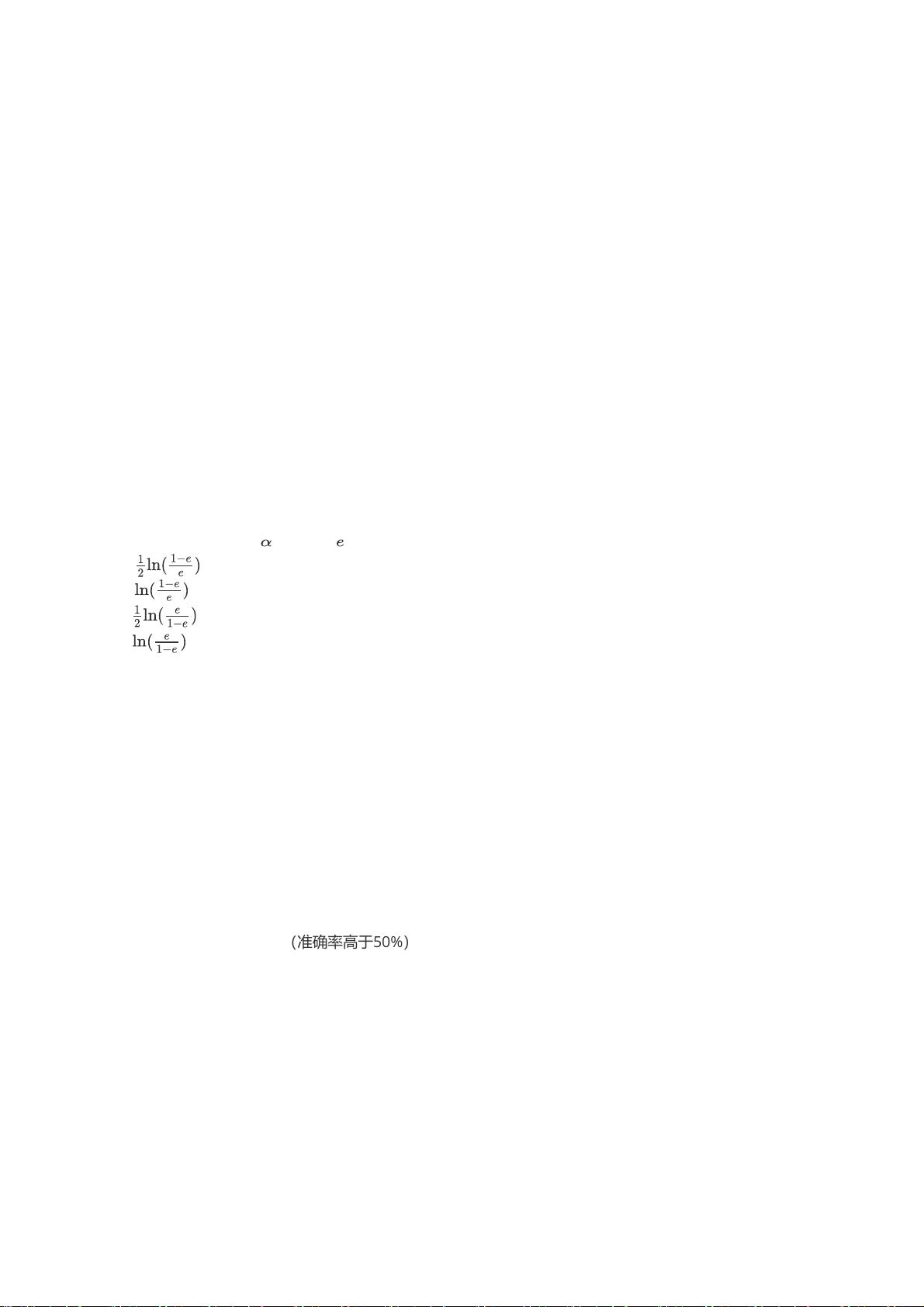

集成学习是一种强大的机器学习策略,它通过结合多个学习算法或模型的预测来提高整体的预测性能。这个概念的核心思想是“多样性与准确性”的结合,即利用多个不同的学习算法或者同一种算法的不同实例,通过某种策略整合它们的预测结果,从而得到比单个模型更稳定、更准确的预测。在《第5章 集成学习2》中,我们关注的是集成学习的理论和应用。 首先,集成学习并非一种全新的数据挖掘算法,而是建立在已有的算法基础上,通过并行或串行的方式进行整合,从而实现性能提升。选项A正确,选项B和C错误。集成学习既可以采取并行方式,如Bagging,也可以是串行方式,如Boosting。 Bootstrap采样是集成学习中常用的一种技术,尤其在Bagging中。Bootstrap采样是通过有放回地从原始样本集中抽取样本来创建新的训练集,确保新训练集的大小与原始样本集相同。因此,选项A正确,B错误。由于是“有放回”采样,所以原始数据出现在新训练集中是可能多次的,C选项表述不准确。 AdaBoost是Boosting方法的一个典型代表,其核心参数`α`与模型的错误率有关。在AdaBoost中,每个迭代都会根据上一轮的分类错误率调整样本权重,使得下一次迭代更关注之前的弱分类器处理不佳的样本。因此,选项D(没有具体的数值)无法直接判断其正确性,但我们可以理解`α`与错误率成反比,通常在(0,1)之间。 Bagging(Bootstrap Aggregating)的主要特点是:基础分类器并行生成,A选项正确;各基础分类器权重相同,B选项正确;并且基于Bootstrap采样生成训练集,D选项正确。尽管理论上较少的基础分类器可以实现Bagging,但在实际应用中,往往需要较多的分类器来获得更好的泛化能力,所以C选项并不准确。 AdaBoost的特性包括:可以构建出训练误差非常低的分类器,A选项正确;基础分类器只需要非常弱的分类能力(优于随机猜测),B选项正确;通过改变样本权重达到影响训练集的效果,C选项正确;而被当前基础分类器误分类的样本权重会增加,而不是减小,所以D选项错误。 在决策树构建中,属性选择的方法多种多样,包括信息增益、信息增益率、GINI系数等,这些都是衡量特征重要性的指标,但信息值并不是一个标准的决策树属性选择方法,所以A选项错误,B、C、D选项正确。 综上所述,集成学习是通过结合多个模型的预测来增强学习性能的技术,它可以分为并行的Bagging和串行的Boosting等多种策略。在这些策略中,Bootstrap采样、AdaBoost和决策树的属性选择都是重要的概念。理解并掌握这些知识点对于提升机器学习模型的性能至关重要。

- 粉丝: 31

- 资源: 326

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜 信息提交成功

信息提交成功

评论0