没有合适的资源?快使用搜索试试~ 我知道了~

1.PCA降维的公式及原理分析:假设对称矩阵A的所有特征值都不一样,那么: -> 对角矩阵对于矩阵Y,它的协方差假设Y=QX(此时不考虑降维),则 = = PC

资源详情

资源评论

资源推荐

1.PCA 降维的公式及原理分析:

假设对称矩阵 A 的所有特征值都不一样,那么:

A

=

U

∧

𝑈

𝑇

-> 对角矩阵

∧

=

𝑈

𝑇

𝐴𝑈

对于矩阵 Y,它的协方差

𝐶

𝑌

=

1

𝑛

𝑌

𝑌

𝑇

假设 Y=QX(此时不考虑降维),则

𝐶

𝑌

=

1

𝑛

𝑄𝑋

(𝑄𝑋)

𝑇

=

1

𝑛

𝑄𝑋

𝑋

𝑇

𝑄

𝑇

=

Q

𝐶

𝑥

𝑄

𝑇

PCA 的本质:让协方差最小,方差最大,这样可以去相关 -> 协方差矩阵的对角元最大,非

对角元为 0->对角矩阵满足

我们已经得到两个公式:

𝐶

𝑌

=

Q

𝐶

𝑥

𝑄

𝑇

和

∧

=

𝑈

𝑇

𝐴𝑈

,假设 Q =

𝑈

𝑇

可以得到:

𝐶

𝑌

=

𝑈

𝑇

𝐶

𝑥

𝑈

,因为协方差矩阵

𝐶

𝑥

是对称半正定矩阵(特征值>=0)

所以可以得到:当 Q =

𝑈

𝑇

时,

𝐶

𝑌

是对角矩阵,因此如果 Q 少取几行就实现了降维

2.极大似然估计公式及原理分析:

极大似然估计起源于贝叶斯

假设特征为 D,标签为 A,P 为概率

贝叶斯公式为:P(A|D) =

𝑃(𝐷|𝐴)𝑃(𝐴)

𝑃(𝐷)

当样本给定的时候 P(D)为常量,同时假定先验概率 P(A)是符合正态分布的,那么我们可以

得到:

P(A|D) 是正比于 P(D|A),其中 P(D|A)就是极大似然函数

对于机器学习的意义:将已知特征求标签的概率转化为已知标签求特征的概率,从无监督问

题变成了有监督问题

但是极大似然的最大问题是:不同参数的 P(A)不一定是相等的,只能说在样本不够大的时

候是近似相等的

贝叶斯算法考虑了先验概率 P(A),但同时要求先验概率要准确

极大似然的两个假设:

1. 已经发生的事件是独立重复事件,符合同一分布

2. 已经发生的事件是可能性(似然)最大的事件

3.模型调优

1. 过拟合:找更多的数据来学习,增大正则化系数,减少特征个数(不一定有效)

2. 欠拟合:找更多的特征,减少正则化系数

3. 权重分析:特征对最后结果的影响

4. 模型融合

5. 重复迭代与训练,加大分错样本的权重

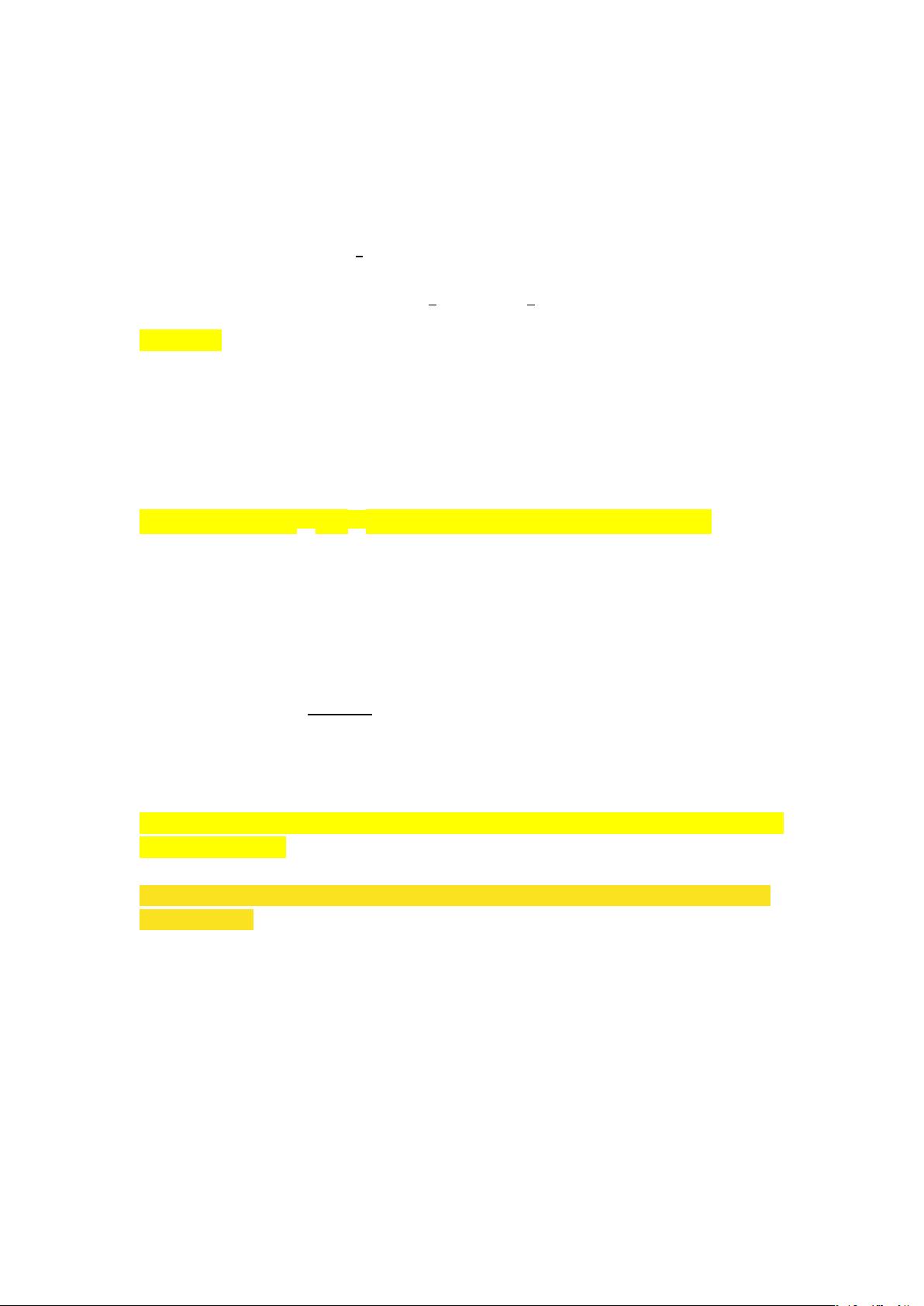

4.线性回归

公式:

h(x) =

𝜃

0

+

𝜃

1

𝑥

损失函数:

加上 L2 正则化后:

梯度下降:分别对

𝜃

0

,

𝜃

1

求导,

5.逻辑回归

LR 实际上是 sigmoid+线性回归,用于判断边界,起到分类的作用

sigmoid 公式:

如果输入 z = 线性回归,那么就是 LR

损失函数: 交叉熵

损失函数+正则化项:

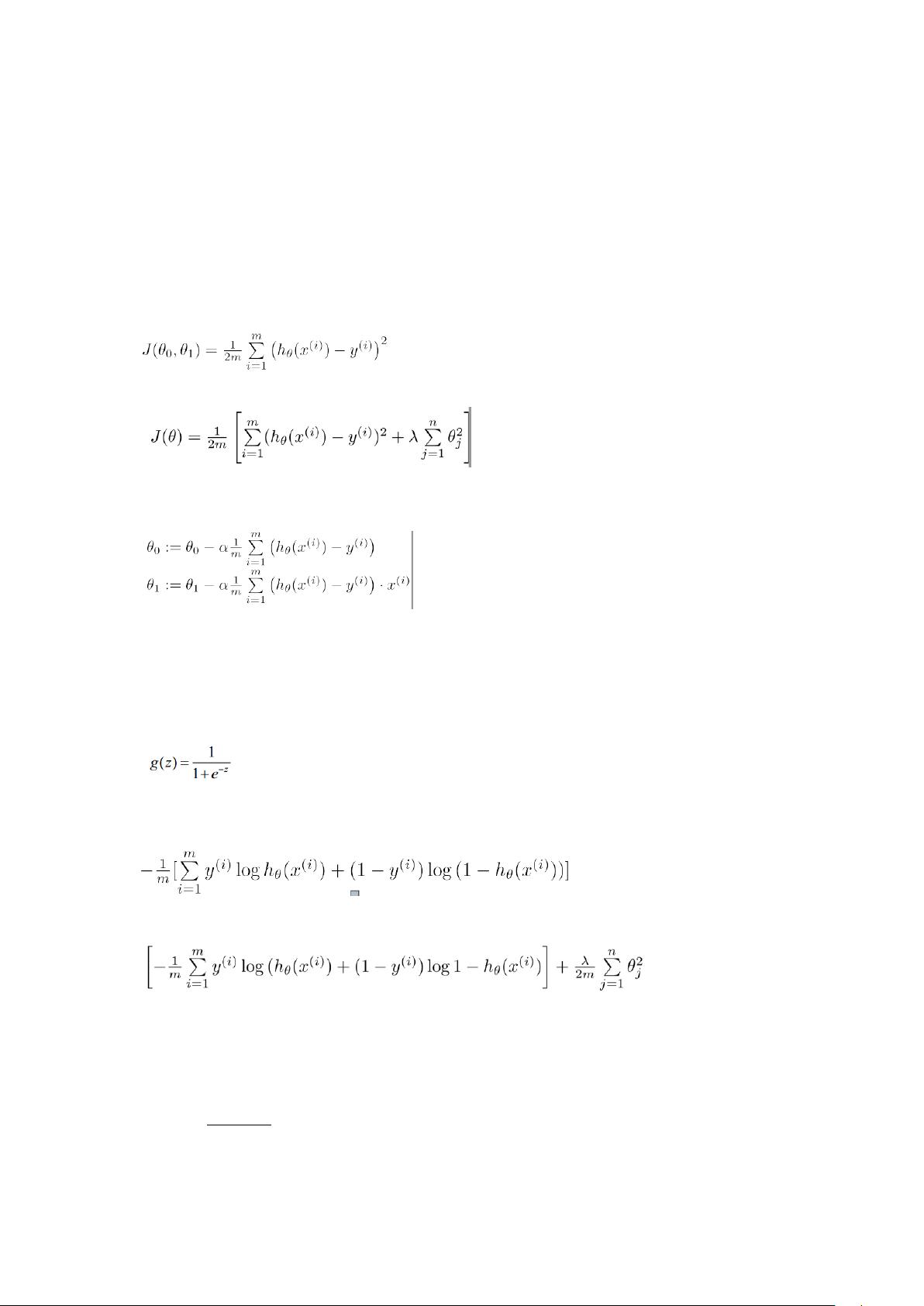

6.贝叶斯

公式:

P(A|D) =

𝑃(𝐷|𝐴)𝑃(𝐴)

𝑃(𝐷)

推导:

X,Y 同时发生的概率即联合概率P(X,Y) = P(Y|X)P(X) = P(X|Y)P(Y)->P(Y|X) =

𝑃(𝑋|𝑌)𝑃(𝑌)

𝑃(𝑋)

(贝叶斯)

朴素贝叶斯(NB):条件独立性假设,很“朴素”的近似,即:

P("邱佳豪"|S)=P(“邱”|S)P(“佳”|S)P(“豪”|S)

以垃圾邮件为例:

利用分词向量将“我司发票”拆成一个个分词

C1=P(“垃圾邮件”|“我”,“司”,“发票”) = P(“我”,“司”,“发票”|“垃

圾邮件”)P(“垃圾邮件”) | P(“我”,“司”,“发票”)

C2=P ("正常邮件" | “我”,“司”,“发票”) = P(“我”,“司”,“发票”|"正

常邮件")P("正常邮件")| P(“我”,“司”,“发票”)

C1/C2 可以把分母约掉,再加上独立性假设

C1/C2 = P(“我”|S)P(“司”|S)P(“发票”|S)P(S)除以 P(“我”|H)P

(“司”|H)P(“发票”|H)P(H),其中 H,S 分别代表垃圾邮件和正常邮件

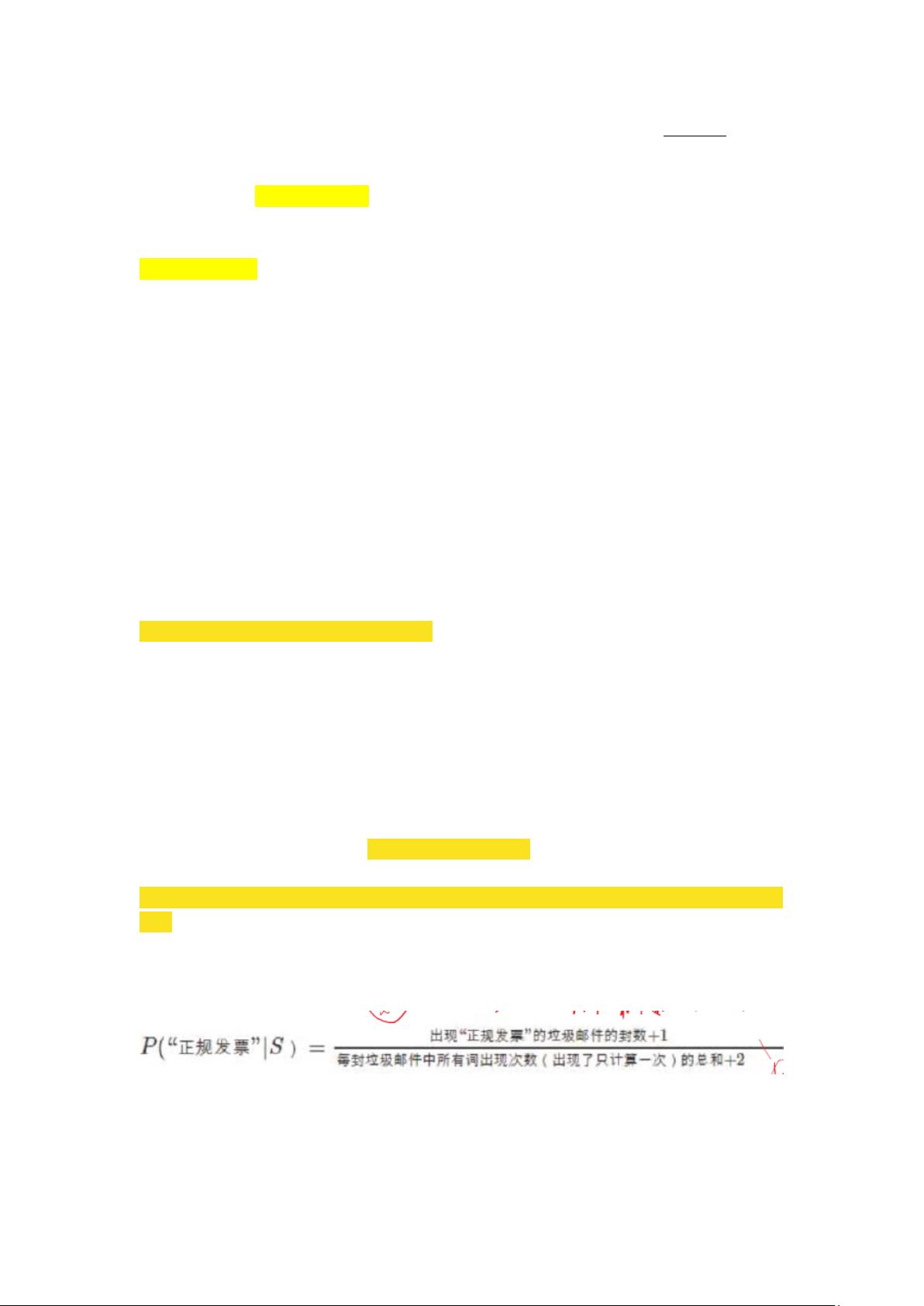

这样就化简后,每一项就特别好求,比如

P(“发票”|“垃圾邮件”) = 垃圾邮件中出现发票的次数/垃圾邮件中所有词谱出现的

次数总和

由于乘法的交换率, P(“我”|S)P(“司”|S)和 P(“司”|S) P(“我”|S)是一

样的,这样一来,贝叶斯就失去了语言里的顺序问题

1.三种模型 2.平滑 3.工程上的灵活应用

P(("代开普通发票增值税发票”)|S)这个拆开后,发票出现了 2 次

如果统计与判断的时候都计算重复的次数,称为多项式模型,即 P(发票)*P(发票)

如果训练和判断都只算一次,称为伯努利模型,即 P(发票)

如果训练的时候考虑重复的,判断的时候不考虑,即高斯分布型(假定属性/特征是服从正

态分布的)

工程中比理想情况更加复杂,这个时候要考虑平滑:如何在样本数量不是那么充足的情况

下,给未出现的新词一个概率,就是平滑最重要的事情

平滑的本质:统一给未出现的词一个概率,同时也要减少已知的概率(所有分子相加等于分

母)

如果真实情况中出现了一个测试中没有出现的词就会导致某一项 P=0,导致整个结果为 0

对于伯努利模型:(简称拉普拉斯平滑)

因为考虑重复所以是封数,分母加 2(2 效果比 1 好,未知的概率增加,已知的概率就要减

少)

对于多项式模型:(加上被统计词谱的数量,实际上是降低已知词的概率)

剩余17页未读,继续阅读

独角兽邹教授

- 粉丝: 29

- 资源: 320

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0